- •1.Эконометрика, её задача и метод.

- •2. Экономические данные и их статистические хараетристики.

- •3.Типовые распределения выборочных характеристик

- •4. Точность и надежность выборочных характеристик. Понятие надежности и доверительного интервала.

- •5. Корреляция случайных величин, уравнение регрессии. Регрессионная зависимость между случайными факторами.

- •6. Оценка параметров уравнения регрессии методом наименьших квадратов.

- •7. Геометрическая интерпретация метода наименьших квадратов.

- •8.Показатели адекватности уравнения регрессии

- •9. Связь дисперсии результирующей переменной с дисперсией регрессии

- •10. Связь дисперсии результирующей переменной с остаточной дисперсией

- •11. Точность и значимость коэффициентов регрессии.

- •12. Связь показателей адекватности и точности уравнения регрессии.

- •13. Связь коэффициентов уравнения регрессии с выборочными значениями результирующей переменной

- •14. Дисперсия коэффициентов регрессии.

- •15. Условия оптимальности мнк-оценок. Теорема Гаусса-Маркова.

- •16. Множественная линейная регрессия.

- •17. Решение системы линейных уравнений множественной регрессии

- •18. Матричная форма записи множественной линейной регрессии

- •19. Натуральная и стандартизованная формы модели множественной регрессии.

- •20. Связь коэффициентов обычной и стандартизованной регрессии.

- •21. Показатели силы связи в модели множественной регрессии.

- •22. Оптимальность коэффициентов множественной регрессии.

- •23. Оценка значимости модели множественной регрессии и ее параметров.

- •24. Прогнозирование на основе модели множественной регрессии.

- •25. Линейные регрессионные модели с гетероскедастичностью.

- •26. Нелинейные регрессионные модели и их классификация.

- •27. Регрессионная модель, линейная относительно параметров.

- •28.Обобщенный метод наименьших квадратов

- •30. Особенности включения в модели регрессии неколичественных показателей.

- •31. Модели регрессии с фиктивными переменными сдвига, наклона.

- •32. Временной ряд и его характеристики.

- •33. Корреляция временных рядов.

- •34. Определение тренда временного ряда.

- •35. Учет автокорреляции остатков временного ряда. Критерий Дарбина-Уотсона.

- •36. Сглаживание временных рядов.

- •37. Системы эконометрических моделей. Одновременные системы уравнений.

- •38. Проблема идентификации эконометрических моделей.

25. Линейные регрессионные модели с гетероскедастичностью.

Линейная регрессия (англ. Linear regression) — используемая в статистике регрессионная модель зависимости одной (объясняемой, зависимой) переменной y от другой или нескольких других переменных (факторов, регрессоров, независимых переменных) x с линейной функцией зависимости.

Модель линейной регрессии является часто используемой и наиболее изученной в эконометрике. А именно изучены свойства оценок параметров, получаемых различными методами при предположениях о вероятностных характеристиках факторов, и случайных ошибок модели. Предельные (асимптотические) свойства оценок нелинейных моделей также выводятся исходя из аппроксимации последних линейными моделями. Необходимо отметить, что с эконометрической точки зрения более важное значение имеет линейность по параметрам, чем линейность по факторам модели.

Регрессионная модель

![]() ,

,

где ![]() —

параметры модели,

—

параметры модели, ![]() —

случайная ошибка модели, называется

линейной регрессией, если функция

регрессии

—

случайная ошибка модели, называется

линейной регрессией, если функция

регрессии ![]() имеет

вид

имеет

вид

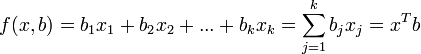

![]() ,

,

где ![]() —

параметры (коэффициенты) регрессии,

—

параметры (коэффициенты) регрессии, ![]() —

регрессоры (факторы модели), k —

количество факторов модели.

—

регрессоры (факторы модели), k —

количество факторов модели.

Коэффициенты линейной регрессии показывают скорость изменения зависимой переменной по данному фактору, при фиксированных остальных факторах (в линейной модели эта скорость постоянна):

![]()

Параметр ![]() ,

при котором нет факторов, называют

часто константой.

Формально — это значение функции

при нулевом значении всех факторов. Для

аналитических целей удобно считать,

что константа — это параметр при

«факторе», равном 1 (или другой произвольной

постоянной, поэтому константой называют

также и этот «фактор»). В таком случае,

если перенумеровать факторы и параметры

исходной модели с учетом этого (оставив

обозначение общего количества факторов —

k), то линейную функцию регрессии можно

записать в следующем виде, формально

не содержащем константу:

,

при котором нет факторов, называют

часто константой.

Формально — это значение функции

при нулевом значении всех факторов. Для

аналитических целей удобно считать,

что константа — это параметр при

«факторе», равном 1 (или другой произвольной

постоянной, поэтому константой называют

также и этот «фактор»). В таком случае,

если перенумеровать факторы и параметры

исходной модели с учетом этого (оставив

обозначение общего количества факторов —

k), то линейную функцию регрессии можно

записать в следующем виде, формально

не содержащем константу:

![]() —

вектор

регрессоров,

—

вектор

регрессоров, ![]() —

вектор-столбец параметров (коэффициентов)

—

вектор-столбец параметров (коэффициентов)

Линейная модель может быть как с константой, так и без константы. Тогда в этом представлении первый фактор либо равен единице, либо является обычным фактором соответственно.

ГЕТЕРОСКЕДАСТИЧНОСТЬ [heteroscedasticity] (неоднородность) — понятие математической статистики иэконометрии; означает ситуацию, когда дисперсия ошибки в уравнении регрессии изменяется от наблюдения к наблюдению. В этом случае приходится подвергать определенной модификации метод наименьших квадратов(иначе возможны ошибочные выводы).

26. Нелинейные регрессионные модели и их классификация.

Нелинейные регрессионные модели — модели вида

![]()

которые не могут быть представлены в виде скалярного произведения

![]()

где ![]() —

параметры регрессионной модели,

—

параметры регрессионной модели, ![]() —

свободная переменная из пространства

—

свободная переменная из пространства ![]() ,

, ![]() —

зависимая переменная,

—

зависимая переменная, ![]() —

случайная величина и

—

случайная величина и ![]() —

функция из некоторого заданного

множества.

—

функция из некоторого заданного

множества.

Значения параметров в случае нелинейной регрессии находят с помощью одного из методов градиентного спуска, например алгоритма Левенберга-Марквардта.

Нелинейная

модель. уравнение зависимости между Уи

Х может быть представлено степенной

функцией У от Х, ![]() ,

показательной

,

показательной ![]() ,

гиперболической

,

гиперболической ![]() и

д. р.

и

д. р.

Для оценки параметров в этих случаях метод наименьших квадратов можно применять после логарифмирования, либо после введения новой переменной.

Для показательной функции:

ln y=ln a+x ln b

Y α β

Y = α + х β Þ а = еα; b=еβ

Для степенной функции

ln y=ln a+b ln x

Y α X

Y = α + β X

Для гиперболической функции

у=а+b/x

1/х=Х

У=а+bХ

Нелинейные модели регрессии и их линеаризация.

Регрессии нелинейные по объясняющим переменным, но линейные по оценивающим параметрам – для расчета параметров нелинейной регрессии применяется метод наименьших квадратов, после предварительной процедуры линеаризации функции регрессии. Приводятся к линейным путем замены переменных. Нелинейная регрессия y = a + b*ln(x) приводится к линейной y = a + bx', где x' = ln(x). Регрессии нелинейные по оценивающим параметрам:

нелинейные модели внутри линейных (приводятся к линейному виду);

нелинейные модели внутри нелинейных.

Для оценки параметров нелинейной модели используется два подхода:

линеаризация модели (с помощью преобразований исходных переменных исследуемую зависимость представляют в виде линейного соотношения);

методы нелинейной оптимизации (применяются когда подобрать линеаризирующее преобразование не получается).