- •Алгоритм расчета весовой матрицы сети Хопфилда (Hopfield). Пример

- •1. Бинарные сети Хопфилда (Hopfield): структура, свойства, назначение и области применения. Непрерывные сети Хопфилда

- •2. Заданы функции активации двух формальных нейронов скрытого слоя rbf-сети в виде радиальных базисных функций

- •Динамические нейросети с внешней динамикой

- •2. Для двунаправленной ассоциативной памяти (lfg) заданы адреса и информации по этим адресам

- •1.Применение сетей Кохонена при распознавании речи и в роботах

- •1.Динамические нейросети с внутренней динамикой

- •2. Для двунаправленной ассоциативной памяти (lfg) заданы адреса и информации по этим адресам

- •1.Интерполяция и аппроксимация функций с помощью rbf-сетей

- •2. Применение частично рекуррентных сетей Жордана и Элмана для решения задач прогнозирования

- •Предварительная обработка значений признаков. Снижение размерности пространства признаков по методу главных компонент

- •Сети Кохонена, их структура и алгоритм обучения

- •Структура нечёткой интеллектуальной системы – основные блоки и их назначение. Примеры применения

- •1. Применение сетей Кохонена при распознавании речи и в роботах

- •1.Применение динамических нейронных сетей для решения задач прогнозирования и компьютерного контроля знаний

- •1. Частично рекуррентные нейросети

- •2. Динамические нейронные сети и нейрокомпьютеры. Сети с внутренней динамикой

- •1. Сети Кохонена, их структура и алгоритм обучения

- •1. Гибридные нейро-нечёткие продукционные системы – достоинства, структура и примеры применения

- •2. Для двунаправленной ассоциативной памяти (lfg) заданы адреса и информации по этим адресам

- •2. Сети радиальных базисных функций (rbf-сети): структура и назначение. Примеры применения. Применение rbf-сетей для решения задач прогнозирования и определения психометрической функции преподавателя

2. Динамические нейронные сети и нейрокомпьютеры. Сети с внутренней динамикой

В динамических нейронных сетях отображение внешней информации, и ее обработка осуществляется в виде некоторого динамического процесса, то есть процесса, зависящего от времени.

Нейрокомпьютеры - это ЭВМ нового поколения, качественно отличающиеся от других классов вычислительных систем параллельного типа тем, что для решения задач они используют не заранее разработанные алгоритмы, а специальным образом подобранные примеры, на которых учатся.

Нейрокомпьютер — устройство переработки информации на основе принципов работы естественных нейронных систем. Эти принципы были формализованы, что позволило говорить о теории искусственных нейронных сетей.

Сети с внутренней динамикой

В таких сетях динамика процессов или систем моделируется не на входе сети, а внутри. Различают 2 основных типа сетей с внутренней динамикой (сети Жордана и Элмана).

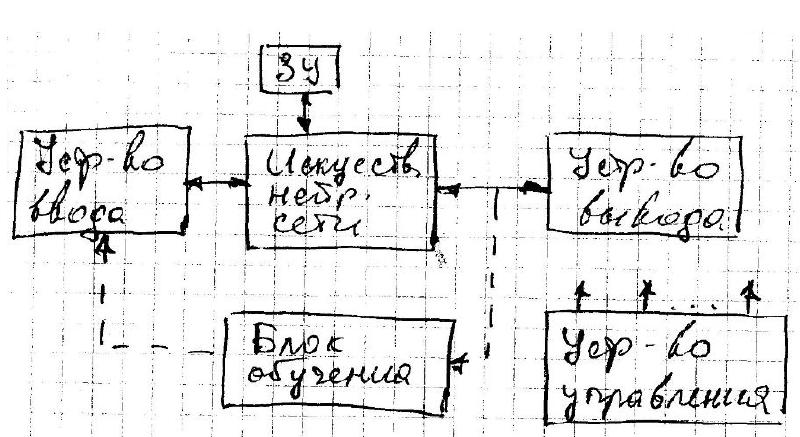

Схема нейрокомпьютера

БИЛЕТ N 14

1. Сети Кохонена, их структура и алгоритм обучения

Сеть Кохонена самоорганизующаяся.

Для обучения используют значение признаков распознаваемого образа. Сеть сама классифицирует образы.

Инициализация значений весовых векторов случайными значениями.

Сети предъявляется некоторый образ, с некоторыми характеристиками Х.

Определяется расстояние между входным вектором и весовым вектором связи: - евклидово расстояние

Нейрон Кохонена, весовой вектор которого наиболее удаленный от вектора значения признака объявляется нейроном-победителем (обозначается как нейрон С).

Осуществляется коррекция весового вектора победителя и нейронов в некоторой окрестности R. Победителя корректируют максимально η=1, а дальше – чем нейрон дальше от победителя – тем меньше степень воздействия корректировки : - получение нового значения весового вектора. - коэф. коррекции, , - близость нейрона победителя (с) и нейрона j.

Проверка по критерию сходимости: , После чего или переход к пункту 2 или стоп.

БИЛЕТ N 16

1. Гибридные нейро-нечёткие продукционные системы – достоинства, структура и примеры применения

Гибридная нейронная сеть формально по структуре идентична многослойной нейронной сети с обучением, но скрытые слои в ней соответствуют этапам функционирования нечеткой системы [5]:

- первый слой нейронов выполняет функцию введения нечеткости (fuzzification) на основе заданных функций принадлежности входов;

- второй слой отображает совокупность нечетких предикатных правил;

- в третьем слое выполняется операция логического вывода (импликация) с применением вычисленных значений истинности для предпосылок каждого правила к заключениям этого правила;

- четвертый слой реализует операцию композиции, объединяя нечеткие подмножества, назначенные переменной вывода в каждом правиле, в одно нечеткое подмножество;

- пятый слой выполняет функцию приведения к четкости (defuzzification).

Каждый из этих слоев характеризуется набором параметров (параметрами функций принадлежности, нечетких решающих правил, активационных функций, весами связей), настройка которых производится так же, как для обычных нейронных сетей.

Обучение гибридных НС позволяет не только выявлять и исправлять противоречивые правила. в исходной системе, но и автоматически формировать новые правила при изменении поля угроз. Свойство адаптивности; нейро-нечетких систем позволяет решать не только отдельно взятые задачи идентификации угроз, сопоставления поведения пользователей с имеющимися в системе шаблонами, но и реализовать систему защиты информации технической системы в целом.

БИЛЕТ N 16