- •Тема: Исследование влияния основных социально-экономических показателей на результативный признак Содержание

- •1 Классическая линейная модель множественной регрессии

- •1.2 Статистические свойства мнк-оценок в классической линейной модели множественной регрессии.

- •1.3 Проверка гипотезы о неадекватности линейной модели выборочных данных.

- •1.4 Проверка гипотез о незначимости коэффициентов в классической линейной модели множественной регрессии (клммр).

- •2. Мультиколлинеарность

- •2.1 Внешние и формальные признаки мультиколлинеарности

- •2.2 Способы устранения мультиколлинеарности.

- •1. Метод пошаговой регрессии

- •1.1 Метод пошаговой регрессии с включением переменных

2. Мультиколлинеарность

Линейная функции регрессии строится с помощью модели регрессии на основе статистических данных, матрицы Х типа «объект – свойства»:

и вектора результативного признака Y : .

При выполнении условия Гаусса-Маркова коэффициенты классической линейной модели множественной регрессии ищут из решения следующей системы:

![]() (1).

(1).

В

результате вектор МНК-оценок

![]() (2).

(2).

Если не существует обратной матрицы и нет возможности оценить коэффициенты МНК, то мультиколлинеарность называется полной (строгой). Она встречается достаточно редко, так как её сложно избежать на предварительной стадии анализа и отбора, множества объясняющих переменных путем исключения дублирующих признаков.

Реальная (частичная) мультиколлинеарность возникает в случае существования достаточно тесных линейных корреляционных связей между объясняющими переменными.

При

сильной корреляционной связи объясняющих

переменных определить матрицы

![]() будет близок к нулю.

будет близок к нулю.

Элементы

обратной матрицы

![]() вычисляются с большой погрешностью,

следовательно, и оценки МНК тоже

определяются с погрешностью.

вычисляются с большой погрешностью,

следовательно, и оценки МНК тоже

определяются с погрешностью.

Одновременно

близость определителя матрицы

к

нулю влечет за собой большие значения

диагональных элементов ковариационной

матрицы вектора оценок

![]() ,

что может привести к неверным статистическим

выводам о значимости коэффициента.

,

что может привести к неверным статистическим

выводам о значимости коэффициента.

Последствия неустранения частичной мультиколлинеарности:

Не точно с грубыми ошибками находятся МНК оценки, т.к. искажены результаты

При статистическом исследовании модель на адекватность с ошибками оцениваются модельные значения , следовательно с ошибками получим Qфак и Qост, которые используются для расчета статистики

,

а, следовательно, не верно сделаем

выводы о значимости модели.

,

а, следовательно, не верно сделаем

выводы о значимости модели.При проверке отдельных коэффициентов на значимость мы используем ковариационную матрицу вектора оценок. Следовательно, элементы этой матрицы будут искажены. На диагонали ковариационной матрицы вектора оценок стоят дисперсии оценок

,

которые необходимы для расчета

статистики

,

которые необходимы для расчета

статистики

,

при проверке значимости отдельных

коэффициентов. Следовательно, возможны,

неверны статистические выводы о

значимости коэффициентов.

,

при проверке значимости отдельных

коэффициентов. Следовательно, возможны,

неверны статистические выводы о

значимости коэффициентов. используется

при построении доверительных интервалов

для значимых коэффициентов, при искажении

можем допустить ошибки точного

характера.

используется

при построении доверительных интервалов

для значимых коэффициентов, при искажении

можем допустить ошибки точного

характера.

2.1 Внешние и формальные признаки мультиколлинеарности

Внешние (косвенные)признаки мультиколлинеарности:

не поддаются экономической интерпретации отрицательные знаки коэффициентов регрессии при

.При

увеличении числа зарегистрированных

иностранных работников объём инвестиций

увеличивается, что является неверным,

т.к инвесторы предпочитают приём

иностранных работников в случае малого

объёма инвестиций, т.к. это дешёвая

рабочая сила. Также оборот розничной

торговли на душу населения не может

возрастать при снижении объёма

инвестиций.

.При

увеличении числа зарегистрированных

иностранных работников объём инвестиций

увеличивается, что является неверным,

т.к инвесторы предпочитают приём

иностранных работников в случае малого

объёма инвестиций, т.к. это дешёвая

рабочая сила. Также оборот розничной

торговли на душу населения не может

возрастать при снижении объёма

инвестиций.среди коэффициентов статически значимыми являются

.

. превышает

свой коэффициент.

превышает

свой коэффициент.

Формальные признаки мультиколлинеарности:

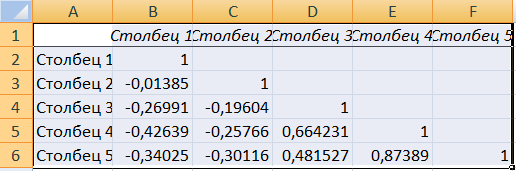

Среди коэффициентов корреляционной матрицы факторных признаков есть такие, которые по величине достаточно велики (>0,7;0,8). Это свидетельствует о возможно достаточно тесной линейной связи.

Вычислим оценки матрицы парных коэффициентов корреляции:

О

наличии мультиколлинеарности

свидетельствует

![]() .

.

2.Достаточно высокие значения множественного коэффициента детерминации одной из объясняющей переменной на другие

![]()

Рассчитаем коэффициент детерминации каждой из объясняющей переменных по всем остальным переменным:

О

наличии мультиколлинеарности

свидетельствуют значения коэффициента

детерминации:

![]() и

и

![]() .

.

3. Существование тесных линейных статистических связей между объясняющими переменными приводит к так называемой плохой обусловленности системы.

Необходимым условием плохой обусловленности системы линейных уравнений является малость определителя матрицы или малость наименьшего по модулю собственного числа.

4.Достаточным условием плохой обусловленности (мультиколлинеарности) является большое значение числа обусловленности( порядка сотни и более).

![]() ,

где

,

где

![]() - собственное число матрицы

.

- собственное число матрицы

.