- •Основные понятия.

- •Соответствие методов и множеств.

- •Общая схема безусловной оптимизации

- •Методы первого порядка (градиентные методы)

- •Градиентный метод с постоянным шагом

- •Выпуклые функции и множества

- •Cвойства выпуклых функций

- •2.Теорема:

- •4.Теорема:

- •5.Теорема:

- •Градиентные методы (продолжение)

- •2. Градиентный метод с дроблением шага.

- •3.Метод наискорейшего спуска.

- •4.Масштабирование.

- •1.2 Метод Ньютона.

- •Сравнительная таблица достоинств и недостатков градиентного метода и метода Ньютона:

- •Число обусловленности локального min.

- •1.3. Многошаговые ( двухшаговые ) методы.

- •1.4.Квазиньютоновские методы

- •1. Методы апроксимации

- •2. Метод покоординатного спуска

- •3.Метод симплексов (Нелдера- Нида)

- •4 .Метод Пауэлла (сопряженных направлений)

4.Масштабирование.

Пусть

f(x) имеет вид:![]() ,

где ai>0

сильно различаются между собой.

Поверхности уровней функции вытянуты

вдоль тех осей xi,

которым соответствуют малые ai.

,

где ai>0

сильно различаются между собой.

Поверхности уровней функции вытянуты

вдоль тех осей xi,

которым соответствуют малые ai.

Для более эффективного применения градиентных методов необходимо превращение поверхностей уровня в круги

x0

x0

Заменой

переменных

![]() можно

добиться того, чтобы у новых переменных

yi

поверхности уровней стали сферами. Для

этого достаточно принять

можно

добиться того, чтобы у новых переменных

yi

поверхности уровней стали сферами. Для

этого достаточно принять

![]() (все

коэффициенты квадр. формы- единицы)

(все

коэффициенты квадр. формы- единицы)

В

случае, когда f(x) не квадратичная, а

достаточно гладкая функция общего вида

выбирают![]() :

:

![]()

Это диагональные элементы матрицы вторых производных. Это преобразование не превратит поверхности уровня в сферы, но в некоторых случаях позволит уменьшить их вытянутость. Гарантировано исправить топографию функции f(x) можно, если учесть все, а не только диагональные элементы матрицы вторых производных и преобразования координат вида:

![]()

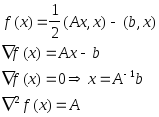

1.2 Метод Ньютона.

Разложим f(x) в ряд Тейлора до 2-го слагаемого включительно:

![]() (*)

(*)

![]() -

вектор

-

вектор

![]() -

матрица Гессе, матрица вторых производных.

-

матрица Гессе, матрица вторых производных.

Будем

рассматривать квадратичную аппроксимацию

f(x) тогда получим (*)

без

![]() то есть предполагаем, что f(x) квадратичная

форма. Эта форма имеет единственную

точку min, который является корнем

уравнения f ’(x)=0.

то есть предполагаем, что f(x) квадратичная

форма. Эта форма имеет единственную

точку min, который является корнем

уравнения f ’(x)=0.

В данном случае:

![]() Метод

Ньютона

Метод

Ньютона

Пример:

Сделаем одну итерацию метода Ньютона для квадратичной функции

Этот пример показывает связь решения системы уравнений Ax-b = 0 и поиска минимума соответствующей функции f(x).

![]() =

A - матрица вторых

производных.

=

A - матрица вторых

производных.

Одна итерация метода Ньютона:

![]()

Но это точка минимума квадратичной функции. Таким образом для квадратичной функции метод Ньютона сходится за один шаг (матрица А должна быть положительно определена и симметрична, значения собственных чисел (растянутость) не играют роли).

Точка х1 гораздо ближе к х* , чем в градиентных методах, но надо вычислить матрицу Гессе и обратить ее. Градиентный метод медленнее, но без дополнительных вычислений.

Оценим скорость сходимости метода Ньютона:

Теорема (о скорости сходимости метода Ньютона):

Пусть

f(x) дважды дифференцируема, матрица

![]() удовлетворяет условию

удовлетворяет условию

Липшица

с константой L :

![]()

f(x) сильно выпукла: 0 l I 2 f(x) и начальное приближение удовлетворяет условию:

![]()

Тогда метод Ньютона сходится х* с квадратичной скоростью

![]()

Доказательство:

Известно, что:

1)![]()

Если

на g’(x) удовлетворяет условию Липшица

![]() ,

то

,

то

Применим

это отношение к 2

f(x), тогда

Применим

это отношение к 2

f(x), тогда

Пусть x = xk , тогда

Дано

![]() (см.

условие)тогда:

(см.

условие)тогда:

![]()

Таким

образом ![]() .

.

Пусть

q1=

![]() (обозначим).

Рассмотрим полученное неравенство

(обозначим).

Рассмотрим полученное неравенство

![]()

![]()

.........................................................................

![]()

Для сильно выпуклых функций известно

Тогда

Теорема доказана.

Если начальные условия не удовлетворяют требованиям теоремы, то метод может не сходиться.

Пусть метод обеспечивает выполнение следующего неравенства

,

где d- наибольшее

из чисел, для которых выполняется это

условие, тогда d- скорость сходимости

метода.

,

где d- наибольшее

из чисел, для которых выполняется это

условие, тогда d- скорость сходимости

метода.

Если

обозначить k

= ![]() ,тогда скорость

сходимости

,тогда скорость

сходимости

d

=

![]() ,

приk0

(k

).

,

приk0

(k

).

Пусть k+1q k, 0 q 1. Для этого случая d =1- линейная скорость. Для метода Ньютона тогда k+1= const k2 d =2- поэтому скорость называется квадратичной.