- •Глава 5 линейные разделяющие функции

- •5.1. Введение

- •5.2. Линейные разделяющие функции и поверхности решений

- •5.2.1. Случай двух классов

- •5.2.2. Случай многих классов

- •5.3. Обобщенные линейные разделяющие функции

- •5.4. Случай двух линейно разделимых классов

- •5.4.1. Геометрия и принятая терминология

- •5.4.2. Процедуры основанные на методе градиентного спуска

- •5.5. Минимизация персептронной функции критерия

- •5.5.1. Персептронная функция критерия

- •5.5.2. Доказательство сходимости для случая коррекции по одной выборке

- •5.5.3. Некоторые непосредственные обобщения

- •5.6. Процедуры релаксаций

- •5.6.1. Алгоритм спуска

- •5.6.2. Доказательство сходимости

- •5.7. Поведение процедур в случае неразделяемых множеств

- •5.8. Процедуры минимизации квадратичной ошибки

- •5.8.1. Минимальная квадратичная ошибка и псевдообращение

- •5.8.2. Связь с линейным дискриминантом Фишера

- •5.8.3. Асимптотическое приближение к оптимальному дискриминанту

- •5.8.4. Процедура Видроу - Хоффа

- •5.8.5. Методы стохастической аппроксимации

- •5.9. Процедуры Хо — Кашьяпа

- •5.9.1. Процедура спуска

- •5.9.2. Доказательство сходимости

- •5.9.3. Поведение в случае неразделяемых множеств

- •5.9.4. Некоторые связанные процедуры

- •5.10. Процедуры линейного программирования

- •5.10.1. Линейное программирование

- •5.10.2. Случай линейно разделяемых множеств

- •5.10.3. Минимизация персептронной функции критерия

- •5.10.4. Замечания

- •5.11. Метод потенциальных функций

- •5.12. Обобщения для случая многих классов

- •5.12.1. Метод Кеслера

- •5.12.2. Правило постоянных приращений

- •5.12.3. Обобщение метода наименьших квадратов

- •5.13. Библиографические и исторические сведения

5.8.2. Связь с линейным дискриминантом Фишера

В данном пункте будет показано, что при соответствующем выборе вектора b функция аtу, найденная по методу минимальной квадратичной ошибки, непосредственно связана с линейным дискриминантом Фишера. Для того чтобы показать это, следует вернуться к необобщенным линейным разделяющим функциям. Предположим множество п d-мерных выборок x1,…xn принадлежат подмножеству X1, помеченному 1, а n2 – подмножеству X2 помеченному 2. Далее положим, что выборка yi образуется из хi, путем прибавления порогового компонента, и умножением полученного вектора на –1 в случае выборки, помеченной 2. Не нарушая общности,

м![]() ожно

положить, что первыеn1

выборок помечены 1,

а последующие n2помечены

1.

Тогда

матрицу Y

можно представить в следующем виде:

ожно

положить, что первыеn1

выборок помечены 1,

а последующие n2помечены

1.

Тогда

матрицу Y

можно представить в следующем виде:

где ui является вектор столбцов из ni компонент, а Хi – матрицей размера ni×d, строками которой являются выборки, помеченные i. Соответствующим образом разложим a и b:

и![]()

Можно показать, что при определенном выборе b обнаруживается связь между решением по методу наименьшей квадратичной ошибки и линейным дискриминантом Фишера.

Д оказательство

начнем, записав соотношение

(32) для а

с использованием разложенных матриц:

оказательство

начнем, записав соотношение

(32) для а

с использованием разложенных матриц:

О пределяя

выборочное среднее

mi,

и матрицу суммарного выборочного

разброса SW:

пределяя

выборочное среднее

mi,

и матрицу суммарного выборочного

разброса SW:

можно в результате перемножения матриц, входящих в (36), получить следующее выражение:

![]()

Полученное выражение может рассматриваться как пара уравнений, причем из первого можно выразить w0 через w:

где m является средним по всем выборкам. Подставив данное выражение во второе уравнение, и выполнив некоторые алгебраические преобразования, получим

![]()

Поскольку направление вектора (m1 – m2)(m1 m2)t w при любом w совпадает с направлением вектора m1 – m2, то можно записатьследующее выражение:

![]()

где α — некоторая скалярная величина. В этом случае соотношение (40) дает

ч![]() то,

за исключением скалярного коэффициента,

идентично решению для случая линейного

дискриминанта Фишера. Помимо этого,

получаем величину порогаw0

и следующее

решающее правило: принять решение ω1,

если wt(x

- m)>0;

иначе принять решение ω2.

то,

за исключением скалярного коэффициента,

идентично решению для случая линейного

дискриминанта Фишера. Помимо этого,

получаем величину порогаw0

и следующее

решающее правило: принять решение ω1,

если wt(x

- m)>0;

иначе принять решение ω2.

5.8.3. Асимптотическое приближение к оптимальному дискриминанту

Д![]() ругое

свойство решения по методу наименьшей

квадратичной ошибки, говорящее в его

пользу, состоит в том, что при условии

b=un

и при п→∞

оно в пределе приближается в смысле

минимума среднеквадратичной ошибки к

разделяющей функции Байеса

ругое

свойство решения по методу наименьшей

квадратичной ошибки, говорящее в его

пользу, состоит в том, что при условии

b=un

и при п→∞

оно в пределе приближается в смысле

минимума среднеквадратичной ошибки к

разделяющей функции Байеса

Ч![]() тобы

продемонстрировать данное утверждение,

следует предположить, что выборки взяты

независимо в соответствии с вероятностным

законом

тобы

продемонстрировать данное утверждение,

следует предположить, что выборки взяты

независимо в соответствии с вероятностным

законом

Р![]() ешение

по методу наименьшей квадратичной

ошибки с использованием расширенного

вектораy

дает разложение в ряд функции g(x)=aty,

где у=у(х).

Если определить среднеквадратичную

ошибку аппроксимации выражением

ешение

по методу наименьшей квадратичной

ошибки с использованием расширенного

вектораy

дает разложение в ряд функции g(x)=aty,

где у=у(х).

Если определить среднеквадратичную

ошибку аппроксимации выражением

то нашей задачей будет показать, что величина ε2 минимизируется посредством решения а=Y† un.

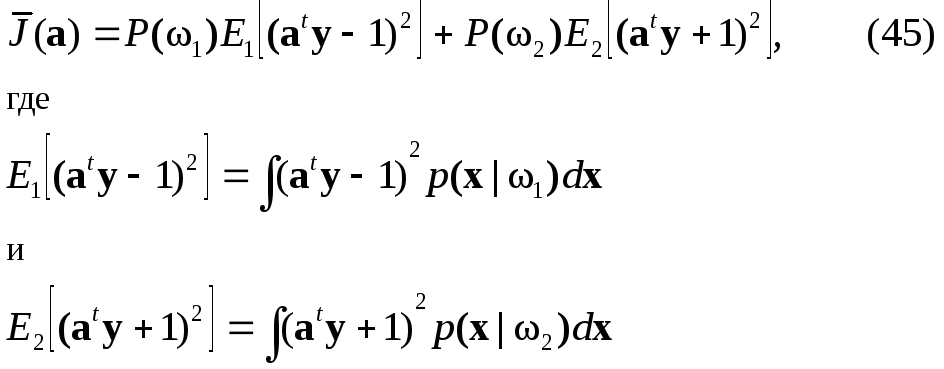

Доказательство упростится при условии сохранения различия между выборками класса 1 и класса 2. Исходя из ненормированных данных, функцию критерия Js можно записать в виде

Т аким

образом, в соответствии с законом

больших чисел при стремлениип

к бесконечности

(1/n)JS(а)

приближается с вероятностью

1 к функции

аким

образом, в соответствии с законом

больших чисел при стремлениип

к бесконечности

(1/n)JS(а)

приближается с вероятностью

1 к функции

![]() (а),

имеющей вид

(а),

имеющей вид

Т

еперь,

если мы из соотношения

(42) определим

еперь,

если мы из соотношения

(42) определим

Второй член данной суммы не зависит от весового вектора а. Отсюда следует, что а, которое минимизирует JS , также минимизирует и ε2 — среднеквадратичную ошибку между аtу и go(x).

Данный результат позволяет глубже проникнуть в суть процедуры, обеспечивающей решение по методу наименьшей квадратичной ошибки. Аппроксимируя go(x), разделяющая функция аtу дает непосредственную информацию относительно апостериорных вероятностей P(ω1|x)= 1/2(1+go) и P(ω2|x)= 1/2 (1-go). Качество аппроксимации зависит от функций уi(х) и числа членов в разложении аtу. К сожалению, критерий среднеквадратичной ошибки в основном распространяется не на точки, близкие к поверхности решения go(x)=0, а на точки, для которых значение р(х) велико. Таким образом, разделяющая функция, которая наилучшим образом аппроксимирует разделяющую функцию Байеса, не обязательно минимизирует вероятность ошибки. Несмотря на данный недостаток, решение по методу наименьшей квадратичной ошибки обладает интересными свойствами и широко распространено в литературе. Далее, при рассмотрении методов стохастической аппроксимации, еще предстоит встретиться с задачей среднеквадратичной аппроксимации функции go(x).