3. Корреляционные параметрические методы изучения связи

Корреляционные параметрические методы - методы оценки тесноты свози, основанные на использовании, как правило, оценок нормального распределения, применяются в тех случаях, когда изучаемая совокупность состоит из величин, которые подчиняются закону нормального распределения.

Параметризация уравнения регрессии: установление формы зависимости; определение функции регрессии; оценка значений параметров выбранной формулы статистической связи Методы изучения связи - форму зависимости можно установить с помощью поля корреляции. Если исходные данные (значения переменных х и у) нанести на график в виде точек в прямоугольной системе координат, то получим поле корреляции При этом значения независимой переменной x (признак-фактор) откладываются по оси абсцисс, а значения результирующего фактора у откладываются по оси ординат. Если зависимость у от x функциональная, то все точки расположены на какой-то линии. При корреляционной связи вследствие влияния прочих факторов точки не лежат на одной линии.

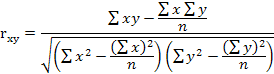

Расчет показателей силы и тесноты связей Линейный коэффициент корреляции - количественная оценка и мера тесноты связи двух переменных. Коэффициент корреляции принимает значения в интервале от -1 до +1. Считают, что если этот коэффициент не больше 0,30, то связь слабая: от 0,3 до 0,7 - средняя; больше 0,7 - сильная, или тесная. Когда коэффициент равен 1, то связь функциональная, если он равен 0, то говорят об отсутствии линейной связи между признаками.

Коэффициент детерминации - квадрат линейного коэффициента корреляции, рассчитываемый для оценки качества подбора линейной функции.

Формула нелинейного коэффициента корреляции:

![]()

Корреляция для нелинейной регрессии Уравнение нелинейной регрессии, так же как и в линейной зависимости, дополняется показателем корреляции, а именно - индексом корреляции (R):

где ![]() - общая

дисперсия результативного признака у,

- общая

дисперсия результативного признака у, ![]() -

остаточная дисперсия, определяемая

исходя из уравнения регрессии : ух

= f (х). Корреляция

для множественной регрессии. Значимость

уравнения множественной регрессии

оценивается с помощью показателя

множественной корреляции и его квадрата

- коэффициента детерминации. Показатель

множественной корреляции характеризует

тесноту связи рассматриваемого набора

факторов с исследуемым признаком, или

оценивает тесноту совместного влияния

факторов на результат. Независимо от

формы связи показатель множественной

корреляции может быть найден как индекс

множественной корреляции:

-

остаточная дисперсия, определяемая

исходя из уравнения регрессии : ух

= f (х). Корреляция

для множественной регрессии. Значимость

уравнения множественной регрессии

оценивается с помощью показателя

множественной корреляции и его квадрата

- коэффициента детерминации. Показатель

множественной корреляции характеризует

тесноту связи рассматриваемого набора

факторов с исследуемым признаком, или

оценивает тесноту совместного влияния

факторов на результат. Независимо от

формы связи показатель множественной

корреляции может быть найден как индекс

множественной корреляции:

где ![]() - общая

дисперсия результативного признака;

- общая

дисперсия результативного признака;

- остаточная дисперсия для уравнения

у = f (x1,x2,…,xp)

4. Парная регрессия на основе метода наименьших квадратов и группировки

Парная регрессия - регрессия между двумя переменными у и х, т.е. модель вида: у = f (x)+E, где у- зависимая переменная (результативный признак); x - независимая, обьясняющая переменная (признак-фактор);E- возмущение, или стохастическая переменная, включающая влияние неучтенных факторов в модели. В случае парной линейной зависимости строится регрессионная модель по уравнению линейной регрессии. Параметры этого уравнения оцениваются с помощью процедур, наибольшее распространение получил метод наименьших квадратов.

Метод наименьших квадратов (МНК) - метод оценивания параметров линейной регрессии, минимизирующий сумму квадратов отклонений наблюдений зависимой переменной от искомой линейной функции.

![]()

где уi- статические значения зависимой переменной; f (х) - теоретические значения зависимой переменной, рассчитанные с помощью уравнения регрессии.

Экономический смысл параметров уравнения линейной парной регрессии. Параметр b показывает среднее изменение результата у с изменением фактора х на единицу. Параметр а = у, когда х = 0. Если х не может быть равен 0, то а не имеет экономического смысла. Интерпретировать можно только знак при а: если а> 0. то относительное изменение результата происходит медленнее, чем изменение фактора, т. е. вариация результата меньше вариации фактора: V < V. и наоборот.

То есть МНК заключается в том, чтобы определить а и а, так, чтобы сумма квадратов разностей фактических у и у. вычисленных по этим значениям a0 и а1 была минимальной:

![]()

Рассматривая эту сумму как функцию a0 и a1 дифференцируем ее по этим параметрам и приравниваем производные к нулю, получаем следующие равенства:

![]()

![]()

n - число единиц совокупности (заданны параметров значений x и у). Это система «нормальных» уравнений МНК для линейной функции (yx)

Расчет параметров уравнения линейной регрессии:

![]() ,

a

= y

– bx

,

a

= y

– bx

Нахождение уравнения регрессии по сгруппированным данным. Если совокупность сгруппирована по признаку x, для каждой группы найдены средние значения другого признака у, то эти средние дают представление о том, как меняется в среднем у в зависимости от х. Поэтому группировка служит средством анализа связи в статистике. Но ряд групповых средних уx имеет тот недостаток, что он подвержен случайным колебаниям. Они создают колебания уx отражающие не закономерность данной зависимости, а затушевывающий ее «шум».

Групповые средние хуже отражают закономерность связи, чем уравнение регрессии, но могут быть использованы в качестве основы для нахождения этого уравнения. Умножая численность каждой группы nч на групповую среднюю уч мы получим сумму у в пределах группы Суммируя эти суммы, найдем общую сумму у. Несколько сложнее с суммой ху. Если при сумме ху интервалы группировки малы, то можно считать значение xдля всех единиц в рамках группы одинаковым Умножив на него сумму у, получим сумму произведений x на у в рамках группы и, суммируя эти суммы, общую сумму xу. Численность nx, здесь играет такую же роль, как взвешивание в вычислении средних.