- •Лекция 1. Основные понятия теории вероятности

- •Вопросы для самопроверки

- •Лекция 2. Теоремы о вероятностях

- •Теорема умножения вероятностей

- •Краткая классификация событий

- •Теорема о полной вероятностей

- •Теорема (формула) Байеса

- •Теорема сложения вероятностей

- •Принцип практической невозможности редких событий

- •Вопросы для самопроверки

- •Лекция 3. Случайные величины

- •Дискретная случайная величина

- •Числовые характеристики случайных величин

- •Характеристики положения

- •Характеристики разброса

- •Характеристики формы

- •Свойства математического ожидания

- •Свойства дисперсии

- •Правило "3-х сигм"

- •Вопросы для самопроверки

- •Лекция 4. Распределение Бернулли, Пуассона, Лапласа Распределение Бернулли

- •Биномиальные коэффициенты

- •Распределение Пуассона

- •Вопросы для самопроверки

- •Лекция 5. Распределение Лапласа

- •И нтегральная теорема Лапласа

- •Три основных формы интегральной теоремы Лапласа

- •Вопросы для самопроверки

- •Лекция 6. Непрерывная случайная величина

- •Нормальный закон распределения Гаусса

- •Показательный или экспоненциальный закон распределения

- •Квантили распределения

- •Вопросы для самопроверки

- •Лекция 7. Предельные теоремы теории вероятностей

- •Закон больших чисел

- •Центральная предельная теорема

- •Композиция распределений случайных величин

- •Функции случайного аргумента

- •Вопросы для самопроверки

- •Лекция 8. Система случайных величин

- •Закон распределения дискретной двумерной случайной величины

- •Характеристики дискретной двумерной случайной величины

- •Закон распределения непрерывной двумерной случайной величины

- •Характеристики непрерывной двумерной величины

- •Двумерный нормальный закон

- •Вопросы для самопроверки

- •Лекция 9. Проблемы математической статистики

- •Способы составления выборочных подсовокупностей

- •Статистичекое оценивание

- •Вопросы для самопроверки

- •Лекция 10. Свойства статистических оценок

- •Оценка параметров распределения

- •Статистические критерии

- •Вопросы для самопроверки

- •Лекция 11. Критерии согласия Критерий согласия Пирсона

- •Критерий согласия Колмогорова – Смирнова

- •Интервальные оценки характеристик и параметров

- •Вопросы для самопроверки

- •Лекция 12. Проверка статистических гипотез Распределение Стьюдента

- •Интервальная оценка для математического ожидания

- •Проверка гипотезы о равенстве центров двух совокупностей

- •Сравнение двух дисперсий

- •Вопросы для самопроверки

- •Лекция 13. Дисперсионный анализ

- •Ранговый дисперсионный анализ Краскала–Уоллиса

- •Время появления реакции в 4-х группах

- •Ранжированнае данные

- •Дополнение к выводу формул Краскала–Уоллиса

- •Вопросы для самопроверки

- •Лекция 14. Регрессионный анализ

- •Метод наименьших квадратов (мнк)

- •Пример расчета мнк-оценок параметров

- •Оценка тесноты принятой формы связи.

- •Однофакторная линейная зависимость

- •Нелинейные двухпараметрические модели

- •Вопросы для самопроверки

- •Лекция 15. Проблема значимости и адекватности регрессионной модели Оценка значимости регрессионной модели

- •Оценка значимости корреляционной связи

- •Проверка адекватности модели

- •Коэффициент ранговой корреляции Спирмена

- •Вывод формулы для коэффициента ранговой корреляции Спирмена

- •Вопросы для самопроверки

- •Лекция 16. Линейный регрессионный анализ в стандартизованных переменных

- •Способы составления многофакторных моделей

- •Коэффициенты частной корреляции

- •Вывод формул для дисперсий коэффициентов регрессии и расчетных значений

- •Вопросы для самопроверки

Однофакторная линейная зависимость

Для этого частного случая можно получить готовые формулы для МНК-оценок параметров модели и коэффициента корреляции.

Систему

нормальных уравнений для линейной

модели

![]()

можно

решить в общем виде и получить формулы

для расчета "коэффициента регрессии"

![]() и свободного члена

и свободного члена

![]() .

.

Из формулы для дисперсии остатка модели

![]()

получаем

коэффициент детерминации в виде:

![]() .

.

Извлекаем

корень квадратный из коэффициента

детерминации и получаем "коэффициент

парной корреляции" (Пирсона):

![]() .

.

Таким

образом, коэффициент множественной

кореляции

![]() для случая однофакторной линейной

зависимости совпадает (по модулю) с

коэффициентом парной кореляции

R = | rxy |.

В общем же случае он совпадает с

коэффициентом парної кореляції между

расчетными и наблюдаемыми значениями

для случая однофакторной линейной

зависимости совпадает (по модулю) с

коэффициентом парной кореляции

R = | rxy |.

В общем же случае он совпадает с

коэффициентом парної кореляції между

расчетными и наблюдаемыми значениями

![]() .

.

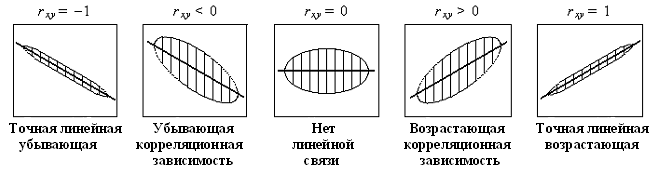

Коэффициент парной корреляции rxy и его квадрат (коэффициент детерминации R2 оценивает тесноту линейной связи. Если rxy = 0, линейной связи нет; при rxy = 1 имеем точную линейную зависимость. На рис. 14.5 изображены возможные ситуации при разных значениях rxy .

Рис. 14.5. Различные случаи тесноты связи

С использованием коэффициента парной корреляции можно записать несколько в иной форме ранее найденные формулы:

![]() ;

;

![]() .

.

Уравнение регресии удобно записать в стандартизованных переменных

![]() .

.

Если изменить направление причинно-следственных связей, то получим очень похожее уравнение "сопряженной" регресии:

![]() .

.

Если же оба показателя (x и y) являются следствиями одной и той же общей причины, то наилучшим описанием связи будет "диагональная регрессия" (Фриша):

![]() ,

,

где знак соответствует знаку ковариации sxy или знаку коэффициента корреляции rxy .

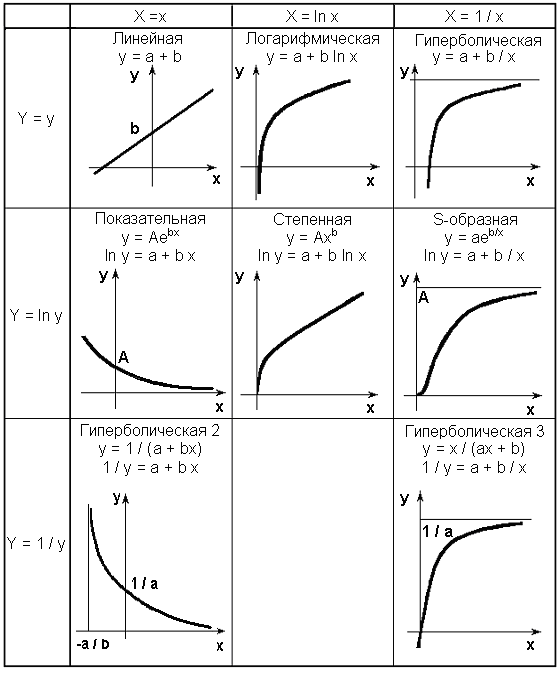

Нелинейные двухпараметрические модели

Как уже было сказано выше, для успешного применения МНК желательно, чтобы форма связи была линейной относительно параметров модели. Для двухпараметричных зависимостей, которые линейно зависят от параметров, или могут быть приведенными к такой форме функциональными преобразованиями, существует графический способ проверки их пригодности для описания данных (иными словами, существует графический способ проверки адекватности модели).

Пусть Y = F(x, y) и X = Ф(x, y) – такие функциональные преобразования, после которых форма связи формально приводится к линейному виду:

Y = a + bX.

Графиком линейной зависимости является прямая, а прямую человек уверенно выделяет среди множества других кривых. Отсюда следует такое правило – если в преобразованных координатах эмпирические точки не группируются вокруг какой-либо прямой, принятая форма связи не является адекватной. С использованием современной вычислительной техники любые графики легко строятся и преобразуются, поэтому описанный способ идентификации формы связи является достаточно эффективным.

Чаще всего используется или логарифмирование, или переход к обратным величинам. На рис. 14.6 приведены справочные сведения о нелинейных двухпараметрических зависимостях, которые могут быть сведены к линейным указанными функциональными преобразованиями. Для наглядности на рис. 14.6 в клетках таблицы приведены эскизы графиков типовых зависимостей.

Ни одна из двухпараметрических зависимостей, приведенных на рис. 14.6, не допускает существования оптимума (максимума или минимума). Если по смыслу задачи ожидается наличие экстремума (оптимума), то следует применять трехпараметрические формы связи, например, квадратичную модель. Квадратичная модель с функциональными преобразованиями переменных способна описывать довольно широкий класс зависимостей с экстремумами.

Рис. 14.6. Двухпараметрические зависимости Y = a + bX