- •Основы информатики после изучения главы вы должны знать:

- •Переход к информационному обществу

- •Информационная культура

- •Информационные ресурсы

- •Информационные продукты и услуги

- •Информатика, ее цель и задачи

- •Структура информатики

- •Измерение и представление информации

- •Измерение информации

- •Свойства информации

- •Классификация информации

- •Кодирование информации

- •Ключевые понятия

- •Вопросы для самопроверки

- •Информационные системы и технологии после изучения главы вы должны знать:

- •Информационные системы

- •Процессы в информационной системе

- •Структура информационной системы

- •Классификация информационных систем

- •Информационные технологии

- •Инструментарий информационной технологии

- •Соотношение информационной технологии и информационной системы

- •Составляющие информационной технологии

- •Этапы развития информационных технологий

- •Виды информационных технологий

- •Ключевые понятия

- •Вопросы для самопроверки

Измерение и представление информации

Информация и формы ее адекватности (см. конспект лекций)

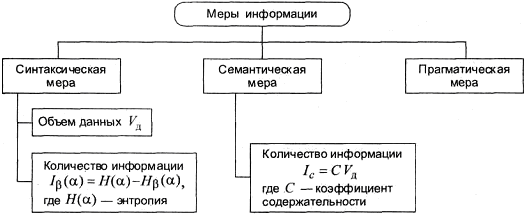

Измерение информации

Для

измерения информации вводятся два

параметра: количество информации

![]() и объем данных

и объем данных

![]() .

Эти параметры имеют разные выражения

и интерпретацию в зависимости от

рассматриваемой формы адекватности

(рис. 1.3).

.

Эти параметры имеют разные выражения

и интерпретацию в зависимости от

рассматриваемой формы адекватности

(рис. 1.3).

Рис. 1.3. Меры информации

Синтаксическая

мера

оперирует

с обезличенной информацией, не выражающей

смыслового отношения к объекту. Объем

данных

![]() в сообщении измеряется количеством

символов (разрядов) в этом сообщении.

В различных системах счисления один

разряд имеет различный вес и, в

соответствии с этим, используются

различные единицы измерения объема

данных. Например, в двоичной системе

счисления единицей измерения является

бит.

в сообщении измеряется количеством

символов (разрядов) в этом сообщении.

В различных системах счисления один

разряд имеет различный вес и, в

соответствии с этим, используются

различные единицы измерения объема

данных. Например, в двоичной системе

счисления единицей измерения является

бит.

Пример 1.2.

Сообщение 10111011 в двоичной системе

счисления имеет объем данных

![]() = 8

бит.

= 8

бит.

Количество информации на синтаксическом уровне невозможно определить без рассмотрения понятия неопределенности состояния системы (энтропии системы), поскольку получение информации о системе всегда связано с изменением степени неосведомленности потребителя о ее состоянии.

Пусть

до получения информации потребитель

имеет некоторые предварительные

(априорные) сведения о системе

![]() .

Мерой его неосведомленности о системе

является некоторая функция

.

Мерой его неосведомленности о системе

является некоторая функция

![]() .

После получения сообщения

.

После получения сообщения

![]() потребитель приобрел некоторую

дополнительную информацию

потребитель приобрел некоторую

дополнительную информацию

![]() .

Она уменьшит его априорную неосведомленность

так, что апостериорная неопределенность

состояния системы (т. е. неопределенность

состояния после получения сообщения

)

станет равной

.

Она уменьшит его априорную неосведомленность

так, что апостериорная неопределенность

состояния системы (т. е. неопределенность

состояния после получения сообщения

)

станет равной

![]() .

Тогда количество информации

.

Тогда количество информации

![]() о системе, полученной в сообщении

,

определится по формуле

о системе, полученной в сообщении

,

определится по формуле

![]() .

.

Таким образом, количество информации измеряется уменьшением неопределенности состояния системы.

Если

конечная неопределенность

обратится в нуль, то первоначальное

неполное знание заменится полным

знанием и

![]() .

Иными словами,

энтропия

системы может

рассматриваться как мера недостающей

информации.

.

Иными словами,

энтропия

системы может

рассматриваться как мера недостающей

информации.

Согласно

формуле Шеннона, энтропия

системы, имеющей

![]() возможных состояний, равна

возможных состояний, равна

![]() ,

,

где

![]() – вероятность того, что система находится

в

– вероятность того, что система находится

в

![]() -м

состоянии

-м

состоянии

.

.

Для

случая, когда все состояния системы

равновероятны, т. е.

![]() ,

ее энтропия определяется соотношением

,

ее энтропия определяется соотношением

![]() .

.

Часто информация кодируется числовыми кодами в той или иной системе счисления (например, при представлении информации в компьютере). Одно и то же количество разрядов в разных системах счисления может передать разное число состояний отображаемого объекта, которое определяется по формуле

![]() ,

,

где

– число всевозможных отображаемых

состояний,

![]() – основание системы счисления (число

различных символов, применяемых при

кодировании),

– основание системы счисления (число

различных символов, применяемых при

кодировании),

![]() – число разрядов в сообщении.

– число разрядов в сообщении.

Пример 1.3.

По каналу связи передается

![]() -разрядное

сообщение, использующее

-разрядное

сообщение, использующее

![]() различных символов. Так как количество

всевозможных кодовых комбинаций равно

различных символов. Так как количество

всевозможных кодовых комбинаций равно

![]() ,

то при равной вероятности появления

любой из них количество информации,

приобретенной абонентом в результате

получения сообщения, будет равно

,

то при равной вероятности появления

любой из них количество информации,

приобретенной абонентом в результате

получения сообщения, будет равно

![]() (формула Хартли).

(формула Хартли).

Если в качестве основания

логарифма принять

,

то

![]() .

В данном случае количество информации

будет равно объему данных (

.

В данном случае количество информации

будет равно объему данных (![]() ).

Для неравновероятных состояний системы

всегда

).

Для неравновероятных состояний системы

всегда

![]() .

.

Коэффициент информативности (лаконичность) сообщения определяется по формуле

![]() ,

причем

,

причем

![]() .

.

С

увеличением

![]() уменьшается объем работы по преобразованию

информации в системе. Поэтому стремятся

к повышению информативности, для чего

разрабатываются специальные методы

оптимального кодирования информации.

уменьшается объем работы по преобразованию

информации в системе. Поэтому стремятся

к повышению информативности, для чего

разрабатываются специальные методы

оптимального кодирования информации.

Для измерения смыслового содержания информации, т. е. ее количества на семантическом уровне, наибольшее признание получила тезаурусная мера, которая связывает семантические свойства информации со способностью пользователя принимать поступившее сообщение. Для этого используется понятие тезаурус пользователя.

Тезаурус – совокупность сведений, которыми располагает пользователь или система.

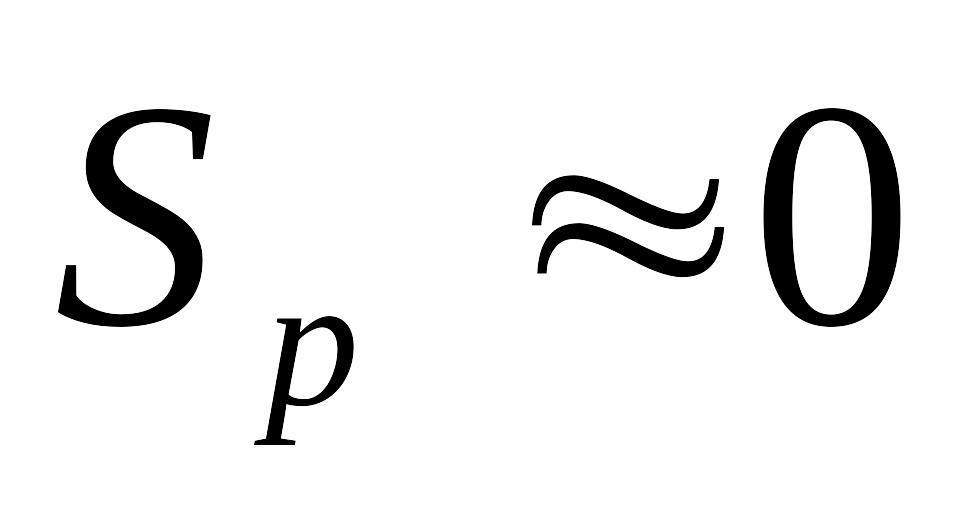

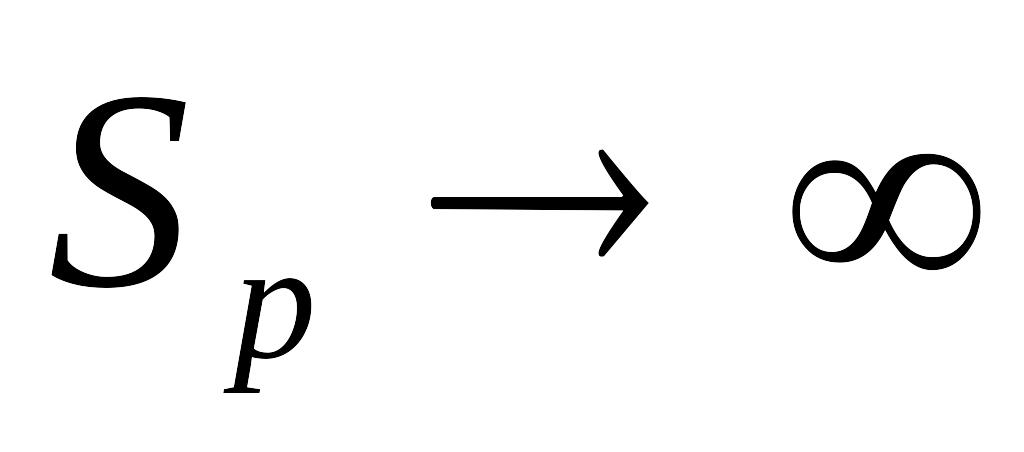

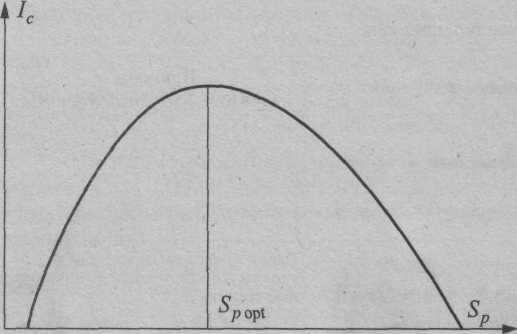

В

зависимости от соотношений между

смысловым содержанием информации

![]() и тезаурусом пользователя

и тезаурусом пользователя

![]() изменяется количество семантической

информации

изменяется количество семантической

информации

![]() ,

воспринимаемой пользователем и

включаемой им в дальнейшем в свой

тезаурус (рис. 1.4). Рассмотрим два

предельных случая, когда количество

семантической информации

равно 0:

,

воспринимаемой пользователем и

включаемой им в дальнейшем в свой

тезаурус (рис. 1.4). Рассмотрим два

предельных случая, когда количество

семантической информации

равно 0:

при

пользователь не воспринимает поступающую

информацию;

пользователь не воспринимает поступающую

информацию;при

пользователь все знает, и поступающая

информация ему не нужна.

пользователь все знает, и поступающая

информация ему не нужна.

Рис. 1.4. Зависимость количества семантической информации от его тезауруса

Максимальное

количество семантической информации

потребитель приобретает при согласовании

ее смыслового содержания

со своим тезаурусом

![]() (т. е. при

(т. е. при

![]() ),

когда поступающая информация понятна

пользователю и несет ему ранее не

известные сведения.

),

когда поступающая информация понятна

пользователю и несет ему ранее не

известные сведения.

Количество семантической информации, получаемой пользователем в сообщении, является величиной относительной. Одно и то же сообщение может иметь смысловое содержание для компетентного пользователя и быть бессмысленным (являться семантическим шумом) для пользователя некомпетентного.

Относительной

мерой количества семантической

информации является коэффициент

содержательности

![]() ,

который определяется по формуле

,

который определяется по формуле

![]() .

.

Прагматическая мера определяет ценность информации для достижения пользователем поставленной цели. Эта мера также является величиной относительной, обусловленной особенностями использования информации в той или иной системе. Ценность информации целесообразно измерять в тех же самых единицах, в которых измеряется целевая функция.

Пример 1.4. В экономической системе ценность информации можно определить приростом экономического эффекта функционирования, достигнутым благодаря использованию этой информации для управления системой, по формуле

![]() ,

,

где

![]() – ценность информационного сообщения

– ценность информационного сообщения

![]() для системы управления

для системы управления

![]() ;

;

![]() – априорный ожидаемый экономический

эффект функционирования системы

управления

;

– априорный ожидаемый экономический

эффект функционирования системы

управления

;

![]() – ожидаемый эффект функционирования

системы

при условии, что для управления будет

использована информация, содержащаяся

в сообщении

.

– ожидаемый эффект функционирования

системы

при условии, что для управления будет

использована информация, содержащаяся

в сообщении

.

Для сопоставления введенные меры информации представим в виде таблицы.

Таблица 1.1

Единицы измерения информации и примеры

Мера информации |

Единицы измерения |

Примеры из компьютерной области |

Синтаксическая: |

|

|

шенноновский подход |

Степень уменьшения неопределенности |

Вероятность события |

компьютерный подход |

Единицы представления информации |

Бит, байт, Кбайт и т. д. |

Семантическая |

Тезаурус |

Пакет прикладных программ, персональный компьютер, компьютерные сети и т. д. |

Прагматическая |

Ценность использования |

Емкость памяти, производительность компьютера, скорость передачи данных и т. д. |

|

|

Денежное выражение |

|

|

Время обработки информации и принятия решений |