- •Вопросы:

- •Лекция №1.

- •Лекция№2 Классификация методов контроля и испытаний

- •Испытания

- •Лекция №3 Измерительные приборы Основные понятия и определения

- •Классификация измерительных приборов:

- •Сущность измерения Уравнение измерения.

- •Аналоговый и цифровой методы измерения.

- •Метод отклонения. Компенсационный (нулевой) метод.

- •Погрешности измерений и причины погрешностей

- •6 Лекция Погрешности, связанные с обработкой измеренных значений.

- •Характеристики погрешностей измерительных приборов.

- •Линейная регрессия.

- •Доверительные границы для коэффициента регрессии.

- •Линейная корреляция.

- •Измерение как процесс передачи сигналов

- •Измерительные сигналы и их математическое описание

- •Временные характеристики детерминированных измерительных сигналов

- •Временные характеристики стохастических сигналов

- •Корреляционная функция

Линейная регрессия.

В измерительной технике очень часто определяют зависимость одной переменной y от другой переменной x, и с помощью линейной регрессии исследуют линейную зависимость значений.

На частном примере (х – независимая, у – зависимая переменная) рассмотрим линейную регрессию. Например: при проверке величина воспроизводимая мерой является независимой, а показания проверяемого прибора - зависимой. Не смотря на то, что мы стремимся получить линейную зависимость, измеренные значения y, как правило, не лежат на прямой. В данном случае, это происходит потому, что имеется случайная погрешность измерений.

При исследовании статистических процессов, это обусловлено также и тем, что взаимосвязь является не функциональной, а лишь статистической.

Возникает вопрос, как провести искомую прямую, называемую прямой регрессии, через точки измерений, нанесенные на (х; у) диаграмму, или как ее рассчитать.

Исходя из того, что для определенного значения независимого распределения х, величина у нормально распределена относительно математического ожидания, лежащего на прямой, и что это нормальное распределение не зависит от значения переменной х, то можно применить метод наименьших квадратов. При этом рассматриваются не расстояния точек измерения от прямой, а разность ординат точек измерения и прямой.

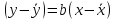

Прямую, соответствующую минимальной сумме квадратов погрешности, с наибольшей вероятностью можно рассматривать, как искомую прямую генеральной совокупности и рассчитывать по следующей формуле:

,

,

,

,

y

x

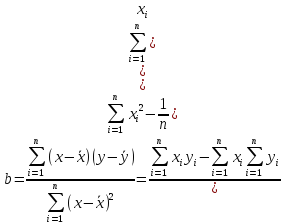

Крутизна прямой (b), называется коэффициентом регрессии и рассчитывается следующим образом:

В результате получают оценку прямой, описывающую линейную зависимость.

Доверительные границы для коэффициента регрессии.

Процедура, определения доверительных границ, следующая:

-

Выбирают доверительную вероятность (р в процентах);

-

По графику распределения Стьюдента определяют с, как функцию c=f(p%; nf), где nf – число степеней свободы;

-

Вычисляют выражения:

;

;

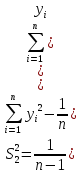

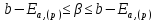

Далее определяют доверительные границы для погрешности коэффициента регрессии:

;

;

(*)

(*)

Математическое ожидание β с р(%) лежат в области (*).

На графике покажем доверительный интервал для коэффициента b линейной зависимости, определенный таким расчетом:

y

x

y

x

Если

этот интервал включает β=0, то с выбранной

доверительной вероятностью, нет основания

утверждать, что действительный коэффициент

регрессии (b)

отличен от нуля. В этом случае считают,

что линейная зависимость не установлена

с достаточной достоверностью.

Дополнительная недостоверность состоит

в том, что среднее значение

также представляет собой лишь оценку

соответствующего математического

ожидания. Поэтому «недостоверность»

является положение прямой.

также представляет собой лишь оценку

соответствующего математического

ожидания. Поэтому «недостоверность»

является положение прямой.

Линейная корреляция.

Если

пары значений

изучают с целью выявления линейной

зависимости и при этом х и у не рассматривают

как зависимые и независимые переменные,

то в этом случае говорят о корреляции.

Например, рост пар братьев и сестер –

статистически бессмысленно рассматривать:

рост одной – независимая, рост другой

– зависимая переменная. Также постановка

вопроса имеет место при сопоставлении

давление, температура и др. в различных

местах.

изучают с целью выявления линейной

зависимости и при этом х и у не рассматривают

как зависимые и независимые переменные,

то в этом случае говорят о корреляции.

Например, рост пар братьев и сестер –

статистически бессмысленно рассматривать:

рост одной – независимая, рост другой

– зависимая переменная. Также постановка

вопроса имеет место при сопоставлении

давление, температура и др. в различных

местах.

Изобразим положение переменных регрессии при различной степени линейной статистической связи пар значений (х; у).

А) у

х

Б)

у

х

В)у

х

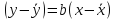

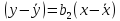

Если

пару значений

нанести на (х; у) диаграмму и искать

прямую, которая изображает возможную

линейную зависимость, то можно использовать

метод наименьших квадратов. Правда

теперь имеет смысл b1

и b2

(две

прямые) так как каждая переменная в

равной мере может быть рассмотрена, как

зависимая и как независимая.

нанести на (х; у) диаграмму и искать

прямую, которая изображает возможную

линейную зависимость, то можно использовать

метод наименьших квадратов. Правда

теперь имеет смысл b1

и b2

(две

прямые) так как каждая переменная в

равной мере может быть рассмотрена, как

зависимая и как независимая.

Если

рассматривать функцию

,,

то коэффициент b1

выбирают так, чтобы сумма всех квадратов

была бы минимальной, однако с теми же

основаниями у может рассматриваться

как свободная переменная, тогда

коэффициент b2

функции

,,

то коэффициент b1

выбирают так, чтобы сумма всех квадратов

была бы минимальной, однако с теми же

основаниями у может рассматриваться

как свободная переменная, тогда

коэффициент b2

функции

выбирают так, чтобы минимальной была

сумма всех квадратов

выбирают так, чтобы минимальной была

сумма всех квадратов

.

.

В общем случае (а), прямые не совпадают, можно показать, что b1 и b2, тем сильнее стремятся к нулю, чем более независимы х и у. При полной статистической независимости, прямые перпендикулярны b1=b2=0 (б).

Если имеет место функциональная зависимость, то b1=1/b2 и обе прямые регрессии совпадают.

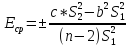

Коэффициенты регрессии, в зависимости от тесноты статистической связи изменяются между нулем и значением крутизны, соответствующей функциональной зависимости. Поэтому значения b1 и b2 в какой-то мере отражают тесноту линейной связи, но полностью охарактеризовать ее не могут, так как не зафиксирована верхняя граница b. Этого можно достичь, по средствам нормирования, следующим образом:

,

где r

– коэффициент корреляции.

,

где r

– коэффициент корреляции.

r

может принимать значения от минус 1 до

плюс 1. При строгой функциональной связи

лежат на прямой. При положительном

коэффициенте угла наклона прямой r=+1,

при отрицательном r=-1.

лежат на прямой. При положительном

коэффициенте угла наклона прямой r=+1,

при отрицательном r=-1.

Если х и у полностью статистически независимы, то r=0. Модуль коэффициента r, является мерой линейной зависимости, чем ближе пара значений расположения к прямой, тем больше |r|→1.

Замечания:

-

Из рассмотренного вытекает: если две величины независимы друг от друга, то они не коррелированны и равны нулю. Если пары значений

лежат на прямой, то r=1.

Обратные утверждения в общем случае

не верны.

лежат на прямой, то r=1.

Обратные утверждения в общем случае

не верны.

Если r=0, то это означает что имеется отсутствие линейной зависимости, то х и у вообще не зависят друг от друга.

Если r=1, то из этого не следует, что зависимость х и у линейна, а следовательно только то, что эти величины зависят друг от друга.

-

r используется как мера линейной зависимости, то необходимо учитывать, что r зависит от объема выборки n. Очевидно, что при наличии только двух пар значений, величина r всегда равна 1. Однако, как можно видеть при определении доверительных границ при малых n, доверительный интервал увеличивается при использовании r в качестве статистической характеристики, только при двух пар значений недопустимо.

-

Если пары значений лежат вблизи прямой, то из этого что r принимает значения близкие к ±1, не следует что эта линейная зависимость отображает также причинно-следственную связь.

Весьма вероятно, что имеется корреляция между числом краж и числом автомобилей в стране, возможно, что такая мнимая, лишенная смысла корреляция происходит от того, что коррелирующие явления имеют общую причину, но так бывает далеко не всегда. Гипотеза, о наличии причинно-следственной связи должна быть обусловлена в каждом отдельном смысле. Корреляция показывает лишь, не противоречат ли полученные результаты гипотезе.

Коэффициент

корреляции r

рассчитан по исходному уравнению

характеризует корреляцию выборки может

быть использован в качестве оценки

математического ожидания

коэффициента корреляции генеральной

совокупности. При этом возникает задача

статистической достоверности этого

коэффициента. При этом проверяют,

является ли отличным r

от нуля, статистически значимым.

коэффициента корреляции генеральной

совокупности. При этом возникает задача

статистической достоверности этого

коэффициента. При этом проверяют,

является ли отличным r

от нуля, статистически значимым.