- •Введение

- •Приближенное решение нелинейных алгебраических уравнений Постановка задачи

- •Приближенные (итерационные) методы решения нау

- •Метод деления отрезка пополам (дихотомии).

- •Метод простой итерации

- •Метод релаксации

- •Метод Ньютона (касательных)

- •Метод хорд

- •Методы решения систем линейных алгебраических уравнений

- •Постановка задачи

- •Прямые методы решения слау Метод Крамера

- •Метод обратной матрицы

- •Метод Гаусса

- •Метод прогонки

- •Итерационные методы решения линейных алгебраических систем Метод простой итерации

- •Метод Якоби

- •Метод Гаусса-Зейделя

- •Аппроксимация функций

- •Постановка задачи интерполяции

- •Локальная интерполяция Кусочно-постоянная интерполяция

- •Кусочно-линейная интерполяция

- •Кубический интерполяционный сплайн

- •Глобальная интерполяция

- •Полином Лагранжа

- •Подбор эмпирических формул

- •Метод наименьших квадратов

- •Численное интегрирование Постановка задачи

- •Формулы прямоугольников

- •Формула трапеций

- •Формула Симпсона

- •Численное решение обыкновенных дифференциальных уравнений Постановка задачи

- •Приближенные методы решения задачи Коши для оду первого порядка

- •Метод Эйлера

- •Модифицированный метод Эйлера

- •Методы Рунге-Кутты

- •Численные методы решения систем оду первого порядка

- •Метод конечных разностей решения краевых задач для оду Постановка задачи

- •Аппроксимация производных

- •Примеры решения задач и рекомендации к экзамену

Метод прогонки

Рассмотрим метод прогонки для СЛАУ вида:

(2.6)

(2.6)

Решение данной системы ищем в виде:

![]() (2.7)

(2.7)

Здесь i, i – неизвестные прогоночные коэффициенты. Как и метод Гаусса, метод прогонки состоит из двух этапов. На первом (прямом) этапе определяются прогоночные коэффициенты, на втором (обратном) вычисляется вектор решения.

Прямой

этап. Сравнивая

соотношение (2.7) при i=2:

![]() и следствие первого уравнения системы

(2.6):

и следствие первого уравнения системы

(2.6):

![]() ,

получим формулы для первых прогоночных

коэффициентов:

,

получим формулы для первых прогоночных

коэффициентов:

![]() .

.

Подставляя (2.7) во второе уравнение (2.6), получим:

![]() .

.

Или, после преобразования,

![]() ,

,

откуда

![]()

Сравнивая с (2.7), получим

![]() .

.

Таким

образом, можно найти все

![]() .

.

Обратный этап. Подставляя последнее прогоночное соотношение (2.7) в последнее уравнение (2.6), получим:

.

.

Затем, последовательно применяя (2.7), находим:

.

.

Таким образом, алгоритм метода прогонки можно представить в виде:

-

Находим

;

; -

Для

вычисляем

вычисляем

![]() .

.

-

Находим

.

. -

Для

находим:

находим:

.

.

Теорема.

Пусть коэффициенты

![]() ,

,

![]() системы уравнений при

системы уравнений при

![]() отличны от нуля и пусть

отличны от нуля и пусть

![]() при

при

![]() .

Тогда прогонка корректна и устойчива.

.

Тогда прогонка корректна и устойчива.

При выполнении этих условий знаменатели в алгоритме метода прогонки не обращаются в нуль и, кроме того, погрешность вычислений, внесенная на каком либо шаге расчетов, не будет возрастать при переходе к следующим шагам. Данное условие есть не что иное, как условие диагонального преобладания.

Итерационные методы решения линейных алгебраических систем Метод простой итерации

Преобразуем

исходную систему линейных уравнений

![]() к эквивалентной системе вида:

к эквивалентной системе вида:

![]() , (2.8)

, (2.8)

где

![]() –

искомый вектор, а

–

искомый вектор, а

![]() и

и

![]() – некоторые новые матрица и вектор,

соответственно. Будем решать (2.8) методом

последовательных приближений. В качестве

нулевого приближения можно взять

– некоторые новые матрица и вектор,

соответственно. Будем решать (2.8) методом

последовательных приближений. В качестве

нулевого приближения можно взять

![]() .

Следующее приближение находим по

рекуррентным формулам

.

Следующее приближение находим по

рекуррентным формулам

![]() (2.9)

(2.9)

Такой

итерационный процесс будем называть

методом простых итераций (МПИ). Так же,

как и в случае МПИ для решения нелинейных

алгебраических уравнений, метод (2.9)

сходится не для любой матрицы

![]() .

Достаточным условием сходимости МПИ

(2.9) к решению системы (2.8) при любом

начальном векторе

.

Достаточным условием сходимости МПИ

(2.9) к решению системы (2.8) при любом

начальном векторе

![]() является требование

является требование

![]() ,

где

,

где

![]() – норма матрицы

– норма матрицы

![]() .

.

Существует

несколько способов построения порождающей

матрицы

![]() ,

для которой выполняется достаточное

условие сходимости.

,

для которой выполняется достаточное

условие сходимости.

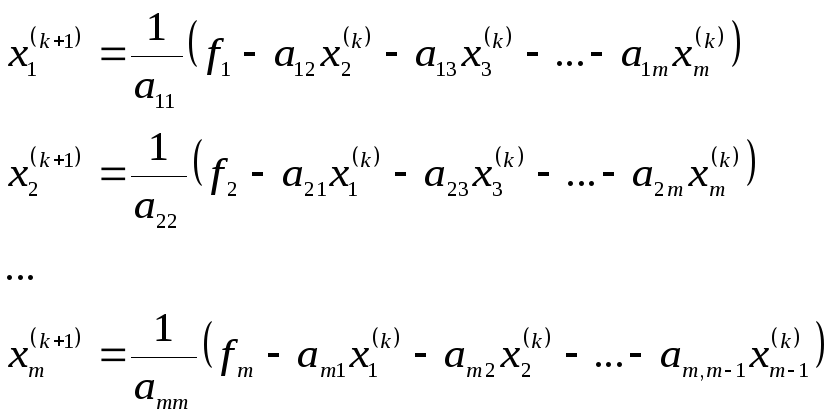

Метод Якоби

Предположим,

что диагональные элементы матрицы

![]() исходной системы не равны нулю (

исходной системы не равны нулю (![]() ,

,

![]() ).

Разрешим первое уравнение системы

относительно

).

Разрешим первое уравнение системы

относительно

![]() ,

второе относительно

,

второе относительно

![]() и т.д. Получим следующую эквивалентную

систему, записанную в скалярном виде:

и т.д. Получим следующую эквивалентную

систему, записанную в скалярном виде:

. (2.10)

. (2.10)

Зададим

вектор нулевого приближения

![]() .

Следующие приближение будем вычислять

по рекуррентным соотношениям

.

Следующие приближение будем вычислять

по рекуррентным соотношениям

(2.11)

(2.11)

В свернутом виде данную систему можно переписать как

![]() ,

i=1,

2, …, m.

,

i=1,

2, …, m.

Условием

окончания итерационного процесса служит

условие

![]() .

.

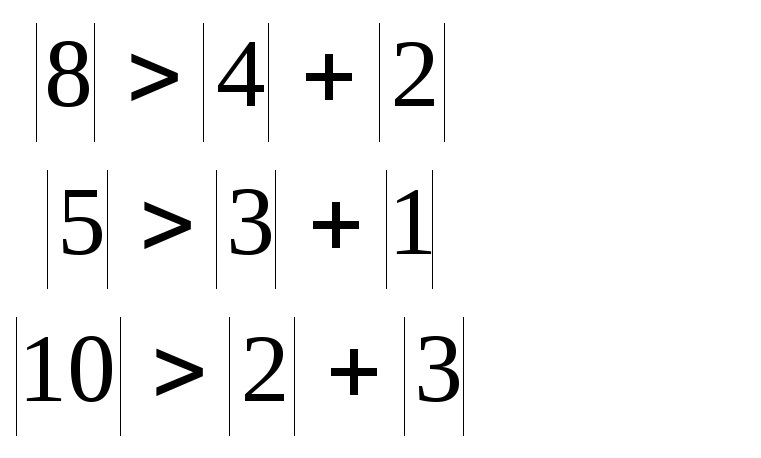

Достаточное условие сходимости. Метод Якоби является вариантом МПИ, в котором

Если

для исходной матрицы A

выполнено условие диагонального

преобладания, т.е.

![]() ,

,

![]() ,

то выполняется условие

,

то выполняется условие

![]() ,

т.е. итерационный

процесс (2.11) сходится при любом выборе

начального приближения. Если исходная

система уравнений не удовлетворяет

условию сходимости, то ее приводят к

виду с диагональным преобладанием.

Выбор начального приближения влияет

на количество итераций, необходимых

для получения приближенного решения.

Чаще всего в качестве начального

приближения берут

,

т.е. итерационный

процесс (2.11) сходится при любом выборе

начального приближения. Если исходная

система уравнений не удовлетворяет

условию сходимости, то ее приводят к

виду с диагональным преобладанием.

Выбор начального приближения влияет

на количество итераций, необходимых

для получения приближенного решения.

Чаще всего в качестве начального

приближения берут

![]() или

или

![]() .

.

Замечание. Указанное выше условие сходимости является достаточным, т.е. если оно выполняется, то процесс сходится. Но данное условие не является необходимым, процесс может сходиться и при отсутствии диагонального преобладания.

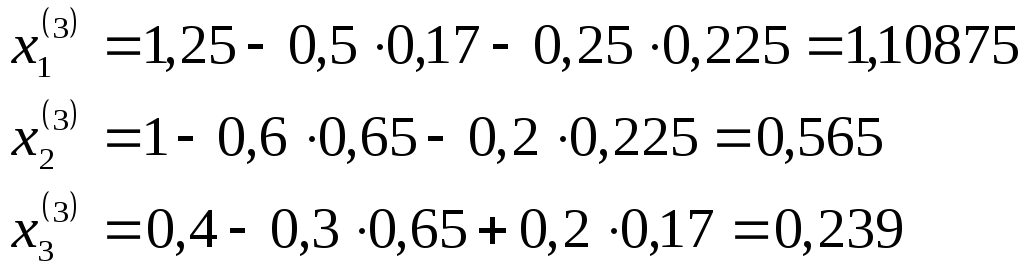

ПРИМЕР

2.5. Решить

СЛАУ из Примера 2.3 с помощью метода Якоби

с точностью

![]() .

.

С

помощью прямого метода обратной матрицы

найдено решение

![]() ,

,

![]() ,

,

![]() .

.

Найдем решение методом Якоби. Для начала проверим условие диагонального преобладания:

Приводим систему уравнений к виду (2.8):

или

или

.

.

Тогда

В

качестве начального приближения выберем

![]() .

Дальнейшие вычисления оформим в виде

таблицы:

.

Дальнейшие вычисления оформим в виде

таблицы:

|

Номер итерации |

|

|

|

|

|

0 |

0 |

0 |

0 |

- |

|

1 |

1.25 |

1 |

0.4 |

1.25 |

|

2 |

0.65 |

0.17 |

0.225 |

0.83 |

|

3 |

1.10875 |

0.565 |

0.239 |

0.45875 |

|

4 |

0.90775 |

0.28695 |

0.180375 |

0.27805 |

|

5 |

1.061431 |

0.419275 |

0.185065 |

0.153681 |

|

6 |

0.994096 |

0.326128 |

0.165426 |

0.093147 |

|

7 |

1.045579 |

0.370457 |

0.166997 |

0.051483 |

|

8 |

1.023022 |

0.339253 |

0.160418 |

0.031204 |

|

9 |

1.040269 |

0.354103 |

0.160944 |

0.017247 |

|

10 |

1.032712 |

0.34365 |

0.15874 |

0.010453 |

|

11 |

1.03849 |

0.348625 |

0.158916 |

0.005778 |

Здесь

,

,

,

,

,

,

,

,

,

,

,

и т.д.

,

и т.д.

Процесс

продолжается, пока погрешность не станет

меньше

![]() ,

что происходит на 11-ой итерации.

Следовательно, приближенное решение

имеет вид:

,

что происходит на 11-ой итерации.

Следовательно, приближенное решение

имеет вид:

![]() ,

,

![]() ,

,

![]() ,

что с точностью

совпадает с решением, полученным по

методу обратной матрицы.

,

что с точностью

совпадает с решением, полученным по

методу обратной матрицы.

При

реализации в Excel

расчетные формулы для

![]() ,

при условии, что исходные данные введены

в лист Excel,

как показано ниже,

,

при условии, что исходные данные введены

в лист Excel,

как показано ниже,

|

|

A |

B |

C |

D |

E |

F |

G |

|

1 |

|

8 |

4 |

2 |

|

|

10 |

|

2 |

A= |

3 |

5 |

1 |

|

f= |

5 |

|

3 |

|

3 |

-2 |

10 |

|

|

4 |

|

4 |

|

|

|

|

|

|

|

|

5 |

номер итерации |

|

|

|

|

|

|

|

6 |

0 |

0 |

0 |

0 |

- |

|

|

|

7 |

1 |

1.25 |

1 |

0.4 |

1.25 |

|

|

имеют вид:

![]() =1/$B$1*($G$1-$C$1*C6-$D$1*D6),

=1/$B$1*($G$1-$C$1*C6-$D$1*D6),

![]() =1/$C$2*($G$2-$B$2*B6-$D$2*D6),

=1/$C$2*($G$2-$B$2*B6-$D$2*D6),

![]() =1/$D$3*($G$3-$B$3*B6-$C$3*C6),

=1/$D$3*($G$3-$B$3*B6-$C$3*C6),

![]() {=МАКС(ABS(B8:D8-B7:D7))}.

{=МАКС(ABS(B8:D8-B7:D7))}.

Фигурные

скобки означают нажатие комбинации

клавиш ctrl+shift+enter после набора формулы.

Остальные формулы для вычисления

![]() получаются

копированием.

получаются

копированием.

Можно провести вычисления в табличном процессоре Excel и с использованием функций умножения матрицы на вектор на основе матричной формы (2.9) метода Якоби.

Здесь

= , =

, = .

.

Занесем исходные данные на рабочий лист.

|

|

A |

B |

C |

D |

E |

F |

G |

|

1 |

|

0 |

-0,5 |

-0,25 |

|

|

1,25 |

|

2 |

= |

-0,6 |

0 |

-0,2 |

|

= |

1 |

|

3 |

|

-0,3 |

0,2 |

0 |

|

|

0,4 |

|

4 |

|

|

|

|

|

|

|

|

5 |

номер итерации |

|

|

|

|

|

|

|

6 |

0 |

0 |

0 |

0 |

- |

|

|

|

7 |

1 |

1.25 |

1 |

0.4 |

1.25 |

|

|

|

8 |

2 |

|

|

|

|

|

|

Выделим ячейки B7:D7 и введем формулу (2.9):

{=МУМНОЖ($B$1:$D$3;ТРАНСП(B6:D6))+ТРАНСП($G$1:$G$3)}.

Остальные

формулы для вычисления

![]() получаются копированием.

получаются копированием.