- •Питання:

- •Області застосування і задачі паралельної обробки

- •5. Рівні розпаралелювання

- •Рівень процедур

- •6. Паралельні операції

- •7. Основні принципи паралелізму (розпаралелення)

- •8. Класифікація структур паралельної обробки

- •Тема №2 “Методи оцінки продуктивності паралельних алгоритмів і систем” Питання:

- •2. Фактори, що необхідно враховувати при оцінці продуктивності

- •3. Методи оцінки продуктивності паралельних систем

- •4. Характеристики продуктивності паралельних алгоритмів.

- •Масштабність (Scaleup)

- •Визначення для варіантів програми, що мають різну величину

- •5. Порівняння mimd і simd структур за продуктивністю

- •Висновки

- •2. Прості мережі Петрі

- •3. Розширені мережі Петрі

- •4. Приклади реалізації мереж Петрі

- •Тема 4: Розробка паралельного алгоритму

- •1. Паралелізм даних

- •2. Паралелізм задач

- •3. Етапи розробки паралельного алгоритму

- •1. Паралелізм даних

- •2. Паралелізм задач

- •3. Етапи розробки паралельного алгоритму

- •Тема №5: Структури зв’язку між процесорами

- •2. Шинні мережі

- •3. Мережі з комутаторами

- •4. Структури, що забезпечують зв'язок типу "пункт-пункт"

- •5. Методи комутацій

- •Питання:

- •2. Масивно - паралельні системи (mpp)

- •Симетричні мультипроцесорні системи (smp)

- •Системи з неоднорідним доступом до пам'яті (numa)

- •Паралельні векторні системи (pvp)

- •Кластерні системи

- •Тема №7: Схеми паралельних алгоритмів задач. Питання:

- •1. Схеми алгоритмів задач

- •2. Алгоритми перемноження матриці на матрицю і їх реалізація на структурах типу: кільцева, 2d (решітка), 3d (куб)

- •Схеми алгоритмів задач

- •2. Алгоритми перемноження матриці на матрицю і їх реалізація на структурах типу: кільцева, 2d (решітка), 3d (куб)

- •7. Збір результатів у с

- •2.Scatter b координати 3. Broadcast підматриць a

- •4. Broadcast 5. Обчислення підматриць b добутків (підматриць в c)

- •6. Збір результатів в c

- •2. Scatter b 3. Broadcast підматриць з а

- •4. Broadcast підматриць з у 5. Обчислення добутків підматриць у с)

- •6. Reduce (підсумовування)добутків 7. Gather c (збір результатів)

- •Тема №8: Мови паралельного програмування Питання:

- •2. Класифікація мов і систем паралельного програмування

- •3. Особливості організації паралельної програми

- •4. Технології паралельного програмування Message Passing Interface (mpi)

- •5. Операції обміну повідомленнями

- •Висновки

- •Література

- •Додатки Додаток а

- •Додаток б концепції паралельної обробки Співпрограми

- •Fork (розгалуження, виникнення паралельних процесів) I Join (об’єднання)

- •Процеси

- •Дистанційний виклик

- •Неявна паралельність

- •Проблеми асинхронної паралельності

- •Несумісні дані

- •Втрачена модифікація даних

- •Блокування

- •Балансування завантаження

- •Проблеми синхронної паралельності

- •Індексовані векторні операції

- •Відображення віртуальних процесорів на фізичні процесори

- •Зменшення пропускної спроможності під час підключення периферійної апаратури

- •Ширина частотної смуги комутаційних мереж.

- •Робота в режимі багатьох користувачів і толерантність до помилок.

- •Організація паралельних обчислень Навчальний посібник

- •Розподілені обчислення

- •[Ред.]Список проектів розподілених обрахунків

- •[Ред.]Список українських проектів розподілених обчислень

- •[Ред.]Біологія та медицина

- •[Ред.]Математика та криптографія

- •[Ред.]Природничі науки

- •[Ред.]пз для організації розподілених обчислень

- •[Ред.]Дивіться також

- •[Ред.]Ресурси інтернету

- •Паралельні та розподілені обчислення

- •[Ред.]Симетрична багатопроцесорність

- •[Ред.]Розподілені обчислення

- •[Ред.]Кластерні обчислення

- •[Ред.]Масово паралельні обчислення

- •[Ред.]Обчислення Ґрід

- •[Ред.]Спеціальні паралельні комп'ютери

- •[Ред.]Посилання

- •Основні етапи проектування паралельних та розподілених алгоритмів

- •8.1. Декомпозиція

- •8.2. Зв'язок

- •8.3. Синхронізація

2. Масивно - паралельні системи (mpp)

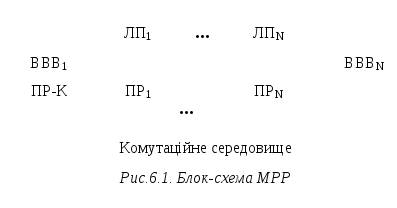

Блок-схема МРР наведена на рис.6.1, характеристики – в табл.6.1.

На рис.6.1 позначено: ЛП – локальна пам'ять, ПР – процесор, ПР-К – процесор комутаційний, ВВВ – вузол вводу-виводу. Пунктирними лініями позначені необов’язкові вузли і лінії зв’язку.

Перевагами МРР є хороша масштабованість і висока швидкодія (серед розглянутих схем – найшвидша); недоліками – великий час міжпроцесорного обміну, використання кожним ПР обмеженого об’єму локального банку даних, висока ціна програмного забезпечення.

-

Симетричні мультипроцесорні системи (smp)

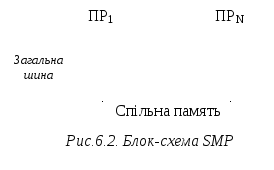

Блок-схема SМР наведена на рис.6.2, характеристики – в табл.6.2.

Перевагами SМР є: простота організації, універсальність при програмуванні, простота експлуатації, невисока ціна; недоліком – погана масштабованість.

Таблиця 6.1. Характеристики МРР

|

Архітектура |

Система складається з однорідних обчислювальних вузлів, що включають: - один чи кілька центральних процесорів (звичайно RISC); - локальну пам'ять (прямий доступ до пам'яті інших вузлів неможливий); - комунікаційний процесор чи мережний адаптер; - іноді - тверді диски (як у SP) і/чи інші пристрої введення/виведення. До системи можуть бути додані спеціальні вузли введення/виведення і вузли керування. Вузли зв'язані через деяке комунікаційне середовище (високошвидкісна мережа, комутатор і т.п.) |

|

Приклади |

IBM RS/6000 SP2, Intel Paragon/Asci Red, SGI/CRAY T3E, Hitachi SR8000, трансп’ютерні системи Parsytec. |

|

Масштабованість |

Загальне число процесорів у реальних системах досягає декількох тисяч (Asci Red, Blue Mountain). |

|

Операційна система |

Існують два основних варіанти: 1. Повноцінна ОС працює тільки на керуючій машині (front - end), на кожнім вузлі працює сильно урізаний варіант ОС, що забезпечують тільки роботу розташованих в них паралельних задач. Приклад: Cray T3E. 2. На кожнім вузлі працює повноцінна UNIX - подібна ОC (варіант , близький до кластерного підходу). Приклад: IBM RS/6000 SP + ОС AIX, що встановлюються окремо на кожнім вузлі. |

|

Модель програмування |

Програмування в рамках моделі передачі повідомлень (MPI, PVM, BSPlib) |

Таблиця 6.2. Характеристики SМР

|

Архітектура |

Система складається з декількох однорідних процесорів і масиву загальної пам'яті (звичайно з декількох незалежних блоків). Усі процесори мають доступ до будь-якої комірки пам'яті з однаковою швидкістю. Процесори підключені до пам'яті або за допомогою загальної шини (базові 2 - 4 процесорні SMP - сервери), або за допомогою crossbar - комутатора (HP 9000). Апаратно підтримується когерентність кешів |

|

Приклади |

HP 9000 V - class, N - class; SMP - сервери і робочі станції на базі процесорів Intel (IBM, HP, Compaq, Dell, ALR, Unisys, DG, Fujitsu і ін.) |

|

Масштабованість |

Наявність загальної пам'яті спрощує взаємодія процесорів між собою, прооте накладає сильні обмеження на їхнє число - не більш 32 у реальних системах. Для побудови масштабованих систем на базі SMP використовуються кластерні чи NUMA - архітектури . |

|

Операційна система |

Уся система працює під керуванням єдиної ОС (звичайно UNIX - подібної, але для Intel - платформ підтримується Windows NT). ОС автоматично (у процесі роботи) розподіляє процеси/нитки по процесорах ( scheduling), але іноді можлива і явна прив'язка. |

|

Модель програмування |

Програмування в моделі загальної пам'яті. (POSIX threads, OpenMP). Для SMP – систем існують порівняно ефективні засоби автоматичного розпаралелення. |