- •Предисловие.

- •1. Введение.

- •2. Количество информации.

- •2.1. Формула хартли.

- •2.2. Формула шеннона.

- •2.3. Свойства энтропии.

- •2.4. Энтропия в информатике и физике.

- •2.5. Вероятностный и объемный подходы к измерению количества информации.

- •2.6. Различные аспекты анализа информации.

- •3. Принципы кодирования и декодирования информации.

- •3.1. Буква (знак, символ). Алфавит.

- •3.2. Кодировщик и декодировщик.

- •3.3. Международные системы байтового кодирования.

- •3.4. Помехоустойчивое кодирование информации.

- •4. Передача информации.

- •4.1. Из истории развития передачи информации.

- •4.2 . Общая схема передачи информации.

- •4.3. Теорема котельникова.

- •4.4.Информационная емкость дискретного сигнала (сообщения). Формула шеннона.

- •4.5. Предельная скорость передачи информации по шеннону. Формула хартли - шеннона.

- •4.6. Теорема шеннона для дискретного канала с помехами.

- •5. Дискретные двоичные (бинарные) сигналы.

- •5.1. Регенерация двоичных сигналов.

- •5.2. Помехозащищенность двоичных сигналов.

- •5.3. Кодирование двоичных сигналов.

- •6. Аналоговые и дискретные процессы.

- •6.1. Аналоговые и дискретные сигналы.

- •6.2. Измерение отношения сигнал – шум.

- •6.3. Дискретизация и кодирование аналогового сигнала.

- •7. Цифровая телефонная связь.

- •8. Цифровая телеграфная связь.

- •9. Цифровое телевидение.

- •10. Системы передачи информации

- •10.1. Параметры радиосигналов.

- •10.2. Многоканальные линии связи. Уплотнение информации.

- •11. Оптоволоконная связь.

- •11.1. Из истории кабельной связи.

- •11.2. Принцип оптоволоконной связи.

- •12. Локальные сети.

- •12.1. Аппаратные средства.

- •12.2. Конфигурация локальных сетей.

- •12.3. Организация обмена информацией.

- •13. Спутниковая связь.

- •13.1. Общая характеристика спутниковой связи.

- •13.2. Принципы спутниковой связи.

- •14. Системы счисления.

- •14.1. Непозиционные системы счисления.

- •14.2. Позиционные системы счисления.

- •14.3. Перевод чисел из десятичной системы в другую систему.

- •14.4. Перевод чисел в десятичную систему из других систем.

- •14.5. Взаимные преобразования двоичных, восьмеричных и шестнадцатеричных чисел.

- •14.6. Двоично-десятичная система.

- •15. Языки программирования.

- •15.1. Языки программирования. Общая характеристика.

- •15.2. Язык программирования си. История создания. Общая характеристика.

- •15.3. Язык программирования си. Процесс создания исполняемого файла.

- •15.4. Язык программирования си. Распределение памяти программы.

- •15.5. Язык программирования си. Основные понятия.

- •15.6. Язык программирования си. Данные.

- •15.7. Язык программирования си. Структура простой программы.

- •Приложение 1. Система семибитного кодирования.

- •Приложение 2. Модифицированная альтернативная кодировка.

- •Приложение 3: клод элвуд шеннон.

- •Литература.

- •Оглавление.

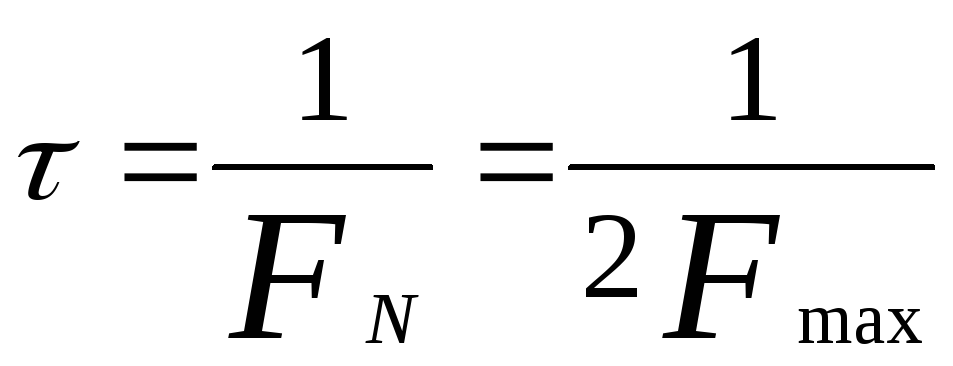

4.3. Теорема котельникова.

Теорема Котельникова называется также теоремой отсчетов или теоремой о выборках. Выборкой называется отсчет амплитуды сигнала в определенный момент времени. Термин "выборка" взят от английского слова samples.

Теорема

Котельникова определяет минимальную

частоту взятия отсчетов при равномерной

дискретизации сигнала с ограниченным

спектром, т.е.

величину,

обратную максимальному временному шагу

дискретизации (интервалу

Найквиста):

.

Минимальная

частота отсчетов значений в секунду

должна быть вдвое больше

самой высокой частоты спектра, т.е.

.

Минимальная

частота отсчетов значений в секунду

должна быть вдвое больше

самой высокой частоты спектра, т.е.

![]()

Сигнал, не содержащий в своем спектре частот выше Fm, полностью определяется 2Fm независимыми значениями в секунду.

Эта теорема позволяет на интервале длительности передачи сообщения ts заменить непрерывный сигнал с ограниченным спектром равномерной последовательностью его дискретных значений, причем их нужно не бесконечное число, а вполне определенное, равное 2Fm.ts

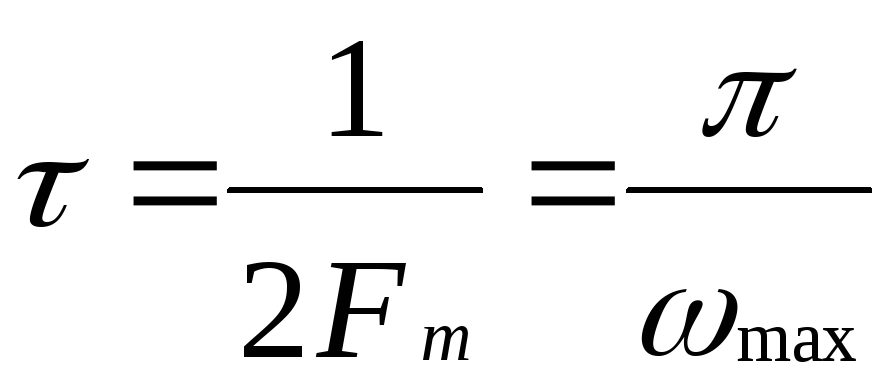

Другая формулировка теоремы Котельникова:

Любая

непрерывная функция

![]() ,

спектр которой ограничен максимальной

частотой

,

спектр которой ограничен максимальной

частотой

![]() ,

полностью определяется последовательностью

своих значений в моменты времени,

отстоящие друг от друга на интервал

Найквиста:

,

полностью определяется последовательностью

своих значений в моменты времени,

отстоящие друг от друга на интервал

Найквиста:

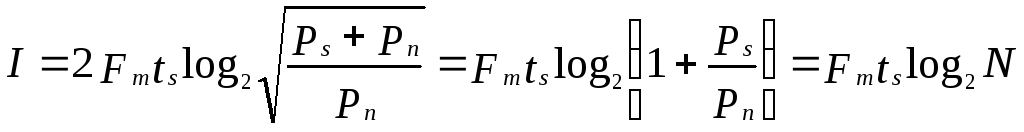

4.4.Информационная емкость дискретного сигнала (сообщения). Формула шеннона.

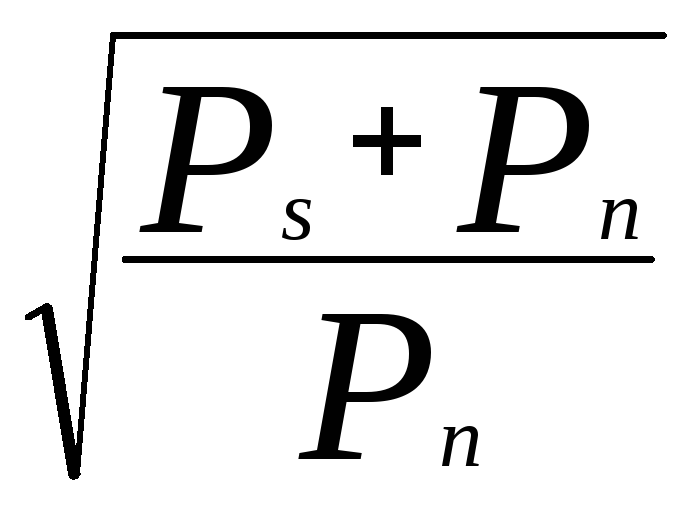

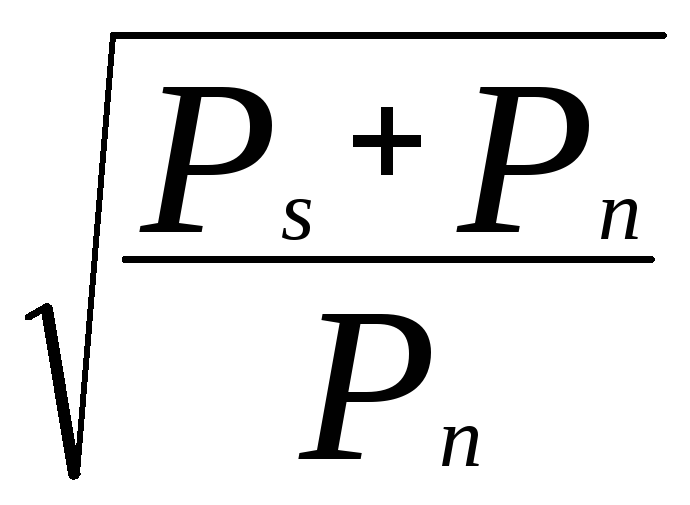

Уровень шумов (помех) не позволяет точно определить амплитуду сигнала и в этом смысле вносит некоторую неопределенность в значение отсчетов сигнала. Если бы шума не существовало, то число дискретных уровней сигнала было бы бесконечным. Величина шума определяет степени различимости отдельных уровней амплитуды сигнала. Максимально возможное число уровней (состояний) N сигнала в одной выборке из-за наличия шума равно

N= ,

где

,

где

![]() -

средняя мощность сигнала;

-

средняя мощность сигнала;

![]() -

средняя мощность шума;

-

средняя мощность шума;

Если число уровней (состояний) системы в одной выборке (на один отсчет) равно N, то это равносильно информации, даваемой i битами (Формула Хартли).

N=2i;

log2N=ilog22;

log2N=i;

i=log2N;

i=log2

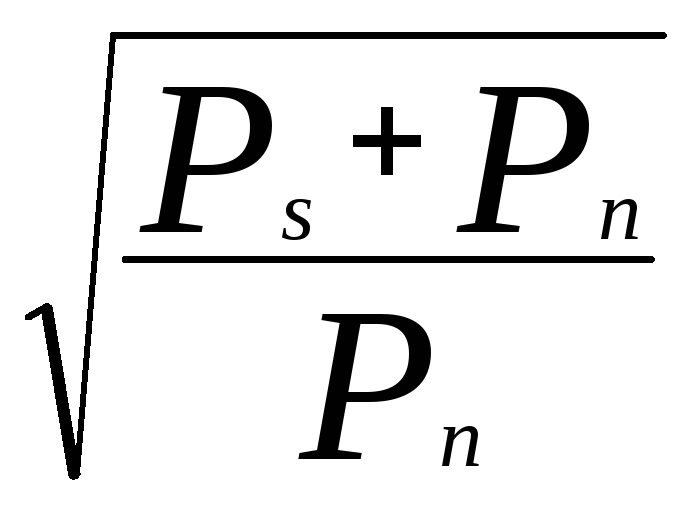

Из теоремы Котельникова следует, что на интервале длительности передачи сообщения ts непрерывный сигнал с ограниченным спектром можно заменить последовательностью из 2Fm.ts его дискретных значений. Поэтому информационная емкость дискретного сигнала (сообщения) за время передачи составит

(бит)

(бит)

![]() -

длительность передачи сообщения;

-

длительность передачи сообщения;

![]() -

максимальная частота из передаваемого

спектра частот;

-

максимальная частота из передаваемого

спектра частот;

![]() -

частота выборок по Котельникову;

-

частота выборок по Котельникову;

![]() -

количество выборок по Котельникову за

время передачи сообщения;

-

количество выборок по Котельникову за

время передачи сообщения;

-

максимально возможное число уровней N

сигнала в одной выборке из-за наличия

шума;

-

максимально возможное число уровней N

сигнала в одной выборке из-за наличия

шума;

![]() -

средняя мощность сигнала равна квадрату

амплитуды сигнала;

-

средняя мощность сигнала равна квадрату

амплитуды сигнала;

![]() -

средняя мощность шума равна квадрату

амплитуды шума.

-

средняя мощность шума равна квадрату

амплитуды шума.

Информационные возможности сигнала возрастают с расширением спектра его частот и превышением уровня сигнала над уровнем помех.

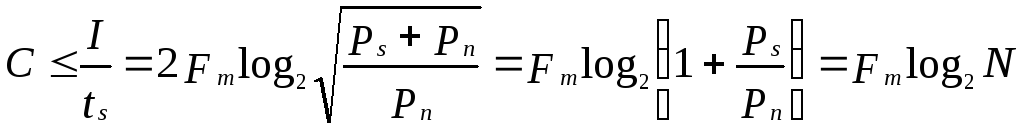

4.5. Предельная скорость передачи информации по шеннону. Формула хартли - шеннона.

Предельная скорость передачи информации относится к фундаментальным понятиям теории связи. Она служит одной из главных характеристик канала передачи информации.

(бит/с)

(бит/с)

Основными факторами, ограничивающими скорость передачи информации, являются полоса частот Fm и уровень помех Pn. Полоса частот Fm и мощность сигнала Ps входят в формулу таким образом, что для C=Const при сужении полосы Fm необходимо увеличивать мощность сигнала Ps и наоборот.

Оценка скорости передачи информации и предельных возможностей канала связи представляет большой практический и теоретический интерес. Выявление принципиальных ограничений в передаче информации является интересной физической и математической задачей.