- •Вероятностное описание погрешностей измерения

- •1. Случайные события и их вероятности

- •2. Случайные величины и их распределения

- •3. Числовые характеристики случайных величин

- •4. Распределения, часто встречающиеся в задачах метрологии

- •5. Системы случайных величин и их характеристики

- •1. Необходимые сведения из математической статистики.

- •1.1. Выборка. Статистика.

- •1.2. Оценивание параметров

- •1.3. Несмещенные и состоятельные оценки.

- •1.4. Точность оценивания параметров

- •1. Введение

- •2. Обработка результатов прямых измерений

- •2.1. Точечное оценивание

- •2.2. Оценивание с помощью доверительных интервалов

- •2.3. Примеры решения задач Опыты Милликена [1, стр.102].

- •Проверка статистических гипотез

- •1. Проверка гипотезы о равенстве математического ожидания заданному значению

- •2. Проверка гипотезы о равенстве дисперсии заданному значению

- •3. Проверка гипотезы о равенстве двух дисперсий

- •4. Резко выделяющиеся наблюдения

- •5. Примеры решения задач

- •5.1. Проверка гипотез

- •5.2. Опыты Кэвендиша [1, стр.105]

- •Обработка результатов прямых неравноточных измерений

- •1. Точечное оценивание

- •2. Оценивание с помощью доверительных интервалов

- •3. Пример неравноточных измерений

- •Обработка результатов совместных измерений

- •1. Случай линейной системы уравнений

- •2. Случай нелинейной системы уравнений

- •3. Важные частные случаи

- •3.1. Случай равноточных измерений

- •3.2. Линейная регрессия

- •3.3. Полиномиальная регрессия

- •4. Примеры совместных измерений

- •4.1. Исследование зависимости сопротивления проводника от температуры

- •4.2. Исследование зависимости поверхностного натяжения от потенциала электрода

1.4. Точность оценивания параметров

Допустим

теперь, что при оценивании параметров

научились строить

такие

функции

![]() ,

которые дают несмещенные и

состоятельные

оценки параметров

,

которые дают несмещенные и

состоятельные

оценки параметров

![]() .

В этом случае за

характеристику

точности оценок естественно выбрать

их дисперсию

.

В этом случае за

характеристику

точности оценок естественно выбрать

их дисперсию

![]() ,

т.е.

меру

разброса вокруг значения

,

т.е.

меру

разброса вокруг значения

![]() .

В математической статистике

показано,

что лучше всего за меру точности

несмещенных оценок выбрать вес оценки,

т.е. величину:

.

В математической статистике

показано,

что лучше всего за меру точности

несмещенных оценок выбрать вес оценки,

т.е. величину:

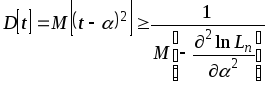

![]() . (1.5)

. (1.5)

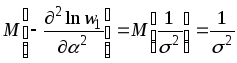

Встает вопрос, как точно можно оценивать параметры i при заданном объеме выборки n. Другими словами, как сильно можно уменьшить дисперсию (увеличить вес) оценки при заданном n? Ответ на этот вопрос дали Крамер и Рао независимо друг от друга.

Сначала

рассмотрим случай оценивания одного

параметра. Пусть

функция

правдоподобия выборки зависит от одного

параметра, так что

она имеет

вид

![]() ,

и пусть имеется статистика

,

и пусть имеется статистика

![]() несмещенная

оценка параметра .

Крамер

и Рао

показали, что в этом случае:

несмещенная

оценка параметра .

Крамер

и Рао

показали, что в этом случае:

, (1.6)

, (1.6)

где:

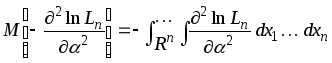

. (1.7)

. (1.7)

Величина

(1.7) при условии сходимости интеграла

называется информационным

количеством Фишера.

Эта величина не зависит от способа

оценивания ,

т.е. от статистики

![]() и представляет

собой

нижнюю границу точности любой оценки.

Другими словами, при

заданном

объеме выборки точность несмещенной

оценки параметра

будет

ограничена снизу.

и представляет

собой

нижнюю границу точности любой оценки.

Другими словами, при

заданном

объеме выборки точность несмещенной

оценки параметра

будет

ограничена снизу.

В случае повторной выборки:

![]() и

и ![]() ,

,

Тогда из (1.6), (1.7) легко подсчитать:

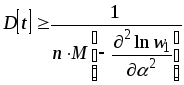

, (1.8)

, (1.8)

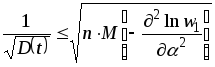

а вес оценки

.

.

В весьма широком классе несмещенных оценок вес оценки при повторной выборке не может быть больше величины, пропорциональной квадратному корню из числа наблюдений. Оценка te, для которой в неравенствах (1.6), (1.8) достигается знак равенства, называется эффективной.

Пример. Возвращаясь к примеру оценки параметра нормального распределения, получаем:

.

.

Откуда

![]() . (1.9)

. (1.9)

Для

выборочного среднего

![]() получается:

получается:

![]() . (1.10)

. (1.10)

Т.е.

оценка![]() имеет максимально возможную точность

и является эффективной.

имеет максимально возможную точность

и является эффективной.

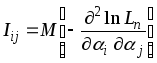

В

случае оценивания нескольких параметров

![]() функция

правдоподобия

имеет вид (1.1). Пусть статистики

функция

правдоподобия

имеет вид (1.1). Пусть статистики

![]() (1.11)

(1.11)

являются несмещенными оценками соответствующих параметров.

Составим матрицу

![]() ,

где

,

где

. (1.12)

. (1.12)

Матрица

I

называется

информационной

матрицей Фишера.

А квадратичная

форма

![]() является

положительно

полуопределенной.

Будем

считать, что

является

положительно

полуопределенной.

Будем

считать, что

![]() ,где

,где

![]() .

Тогда

.

Тогда

![]() (1.13)

(1.13)

является корреляционным эллипсоидом случайного вектора

![]() . (1.14)

. (1.14)

Теперь

рассмотрим набор несмещенных оценок

(1.11) и составим

вектор

случайных уклонений

![]() с нулевым

вектором

средних и

корреляционной матрицей

с нулевым

вектором

средних и

корреляционной матрицей

![]() . (1.15)

. (1.15)

Если

сформировать теперь квадратичную форму

![]() при любом векторе

при любом векторе

![]() ,

то имеет место следующая теорема.

,

то имеет место следующая теорема.

Теорема Рао-Крамера. При условии

существования неособенной

информационной матрицы Фишера

I (1.12) и величин

![]() ,

при любом

,

при любом

![]() имеет место неравенство:

имеет место неравенство:

![]() , (1.16)

, (1.16)

где Bt – корреляционная матрица (1.15) вектора оценок (1.11).

Если

теперь вектор

Z

такой, что

![]() ,

то из (1.16)

следует, что корреляционный эллипсоид

,

то из (1.16)

следует, что корреляционный эллипсоид

![]() охватывает

корреляционный эллипсоид

охватывает

корреляционный эллипсоид

![]() .

Т.е. с

помощью любых статистик t

нельзя получить более точных оценок

.

Т.е. с

помощью любых статистик t

нельзя получить более точных оценок

![]() ,

чем в случае, когда эти

два

эллипсоида совпадают.

,

чем в случае, когда эти

два

эллипсоида совпадают.

Статистики

ti,

дающие несмещенные оценки параметрам

i

![]() ,

для которых

эллипсоид

,

для которых

эллипсоид

![]() совпадает

с

эллипсоидом

совпадает

с

эллипсоидом

![]() ,

называется

совместно

эффективными оценками

параметров

,

называется

совместно

эффективными оценками

параметров

![]() .

.

11.5. Методы оценивания.

Основными

способами оценивания параметров в

математической статистике являются:

метод

максимального правдоподобия

и метод

моментов.

Метод моментов введен К. Пирсоном. Пусть

имеется повторная

выборка

![]() с функцией правдоподобия

с функцией правдоподобия

![]()

Составляет mвыборочных моментов

![]() .

.

При

![]()

![]() ,

,

т.е. с ростом объема выборки оценки mстановятся состоятельными.

Метод

максимального правдоподобия разработан

Д. Бернулли,

Ф. Гауссом

и К.Р. Фишером.

При этом способе за оценки

![]() выбираются

такие значения параметров, которые дают

максимальное значение

функции

правдоподобия, если их подставить на

место

выбираются

такие значения параметров, которые дают

максимальное значение

функции

правдоподобия, если их подставить на

место

![]() .

Если

.

Если

![]() для повторной выборки дифференцируема,

то пользуясь однозначностью логарифмической

функции, удобнее искать максимум не

самой функции правдоподобия, а ее

логарифма. В этом случае уравнения

правдоподобия

примут вид

для повторной выборки дифференцируема,

то пользуясь однозначностью логарифмической

функции, удобнее искать максимум не

самой функции правдоподобия, а ее

логарифма. В этом случае уравнения

правдоподобия

примут вид

![]() . (1.17)

. (1.17)

Оценки,

получаемые из уравнения (1.17) называются

оценками

максимального правдоподобия.

Они обозначаются

![]() и имеют

ряд

замечательных свойств. Данные оценки

асимптотически несмещенные, асимптотически

эффективные и асимптотически нормальные.

Как

правило,

уравнения (1.17) имеют единственное

решение.

и имеют

ряд

замечательных свойств. Данные оценки

асимптотически несмещенные, асимптотически

эффективные и асимптотически нормальные.

Как

правило,

уравнения (1.17) имеют единственное

решение.

Пример.

Оценки

![]() иs2 параметров

и 2

нормального

распределения

иs2 параметров

и 2

нормального

распределения

![]() по выборке

xi

по выборке

xi ![]() являются

оценками максимального

правдоподобия,

т.е. они получены из

решения

системы

(1.17),

записанной для функции правдоподобия

являются

оценками максимального

правдоподобия,

т.е. они получены из

решения

системы

(1.17),

записанной для функции правдоподобия

![]() из рассматриваемых в данной главе

примеров.

из рассматриваемых в данной главе

примеров.