arkhiv / лекц_тест_3

.doc

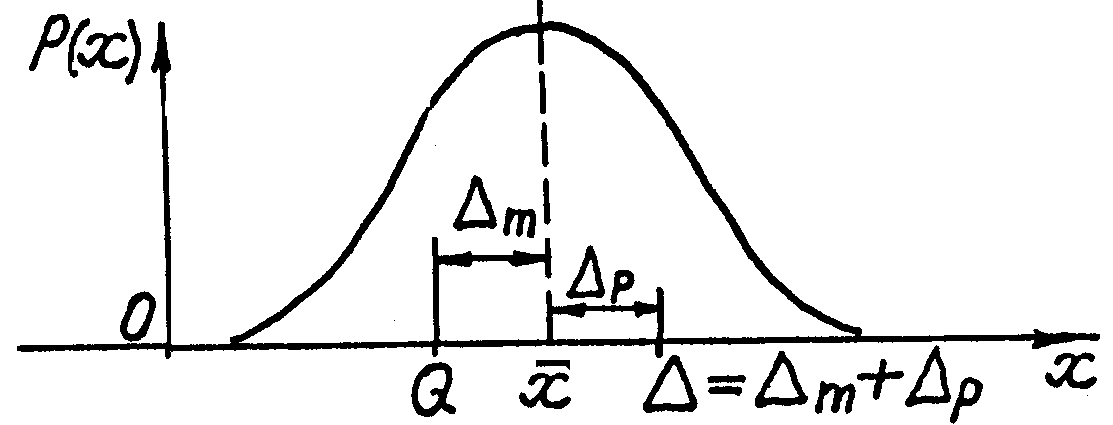

Абсолютной погрешностью прибора (меры) называют разность между показанием прибора (номинальным значением меры) и истинным значением измеряемой (воспроизводимой) величины. Если погрешности не зависят от значения измеряемой величины x, то нормируют только границы Δ = ± a, если же с увеличением x погрешность возрастает линейно, то ее пределы устанавливают по формуле Δ = ± (a + bx), где a и b – положительные числа.

Относительной погрешностью называют отношение абсолютной погрешности к значению измеряемой величины. Пределы допускаемой относительной основной погрешности находят по формуле δ = (Δ/x)⋅100 = ± q%, если границы абсолютных погрешностей можно полагать практически неизменными, и по формуле δ = (Δ/x)⋅100 = ±[c+ d(|Xk / x|−1)] %, (2.2) если границы абсолютных погрешностей можно полагать меняющимися линейно. Здесь q - отвлеченное положительное число, выбираемое из ряда, аналогичному ряду для p; Xk - больший по модулю из пределов измерений; c = b+ d; d = a/|Xk|; c и d выбирают аналогично q.

Приведенной погрешностью называют отношение абсолютной погрешности к нормируюшему значению XN (в %), в качестве которого выбирают верхний предел или диапазон измерений, длину шкалы и т.д. γ =± (Δ⋅100) /XN = ± p%. (2.1) Здесь p - положительное число, выбираемое из ряда 1⋅10n; 1,5⋅10n; 2,5⋅10n; 4⋅10n; 5⋅10n; 6⋅10n (n =1,0, −1,−2, …).

(Формула и обозначение входящих в нее величин)

σ |

Погрешность результата измерения указывают двумя цифрами, если первая 1 или 2. Иначе – одной.

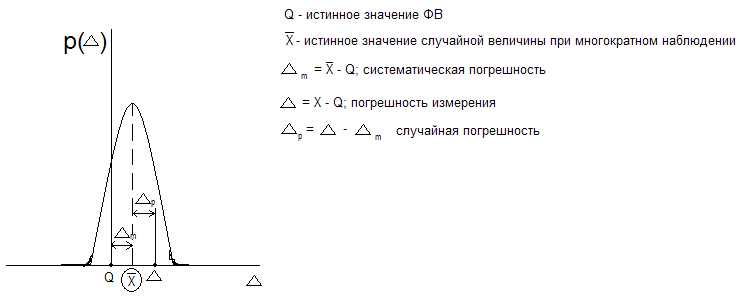

Признаком будет являться случайное изменение ФВ по величине или знаку при повторных измерениях в одних и тех же условиях.

Погрешность результата измерения указывают двумя цифрами, если первая 1 или 2. Иначе – одной.

Систематическая погрешность измерения – составляющая погрешности результата измерения, остающаяся постоянной или закономерно меняющаяся при повторных измерениях одной ФВ в одних условиях.

|