- •Оглавление

- •Аналитические технологии

- •Формализация нейронных сетей

- •Принцип обучения искусственных нейронных сетей

- •Концепция обучения нейронной сети, предложенная Хэбом

- •Сбор данных для нейронной сети

- •Прикладные возможности нейронных сетей

- •Переобучение и обобщение

- •Персептрон

- •Алгоритм обратного распространения ошибки

- •Сигмоидальный нейрон

- •Нейрон типа «адалайн»

- •Инстар и оутстар Гроссберга

- •Нейрон типа wta (Winner Takes All)

- •08.10.2011 Модель нейрона Хэбба

- •Стохастическая модель нейрона

- •Стохастические алгоритмы обучения

- •Настройка числа нейронов в скрытых слоях многослойных сетей в процессе обучения

- •Алгоритмы сокращения

- •Конструктивные алгоритмы

- •Упрощенные алгоритмы расщепления

- •Радиальная базисная сеть

- •Вероятностные нейронные сети

- •Линейные нейронные сети

- •Обучение

- •Сети с самоорганизацией на основе конкуренции

- •12.11.2011 Модели ассоциативной памяти. Сети Хопфилда

- •Когнитивные карты

- •19.11.2011 Генетические алгоритмы Естественный отбор и генетическое наследование

- •Модель эволюции в природе, реализованная программно

- •Символьная модель простого генетического алгоритма

- •Работа простого генетического алгоритма

- •26.11.2011 Шима (Schema)

- •Применение аналитических технологий

- •03.12.2011

- •Бизнес-приложения

- •Программные реализации аналитических технологий

- •Список литературы

Нейрон типа «адалайн»

Адалайн – адаптивный линейный нейрон, со следующей структурной схемой:

Рисунок 18 нейрон типа Адалайн

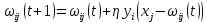

Алгоритм подбора весов:

Квадратичная ошибка:

Адаптивный подбор весовых коэффициентов осуществляется в процессе минимизации квадратичной ошибки.

Несмотря на

нелинейный характер модели, в целевой

функции присутствуют только линейные

элементы, представляющие собой сумму

взвешенных входных сигналов. В связи с

выполнением условия непрерывности

целевой функции, стало возможно применение

алгоритма градиентного обучения.

Значения весовых коэффициентов могут

утоняться либо дискретным способом:

,

либо непрерывным:

,

либо непрерывным:

В практических приложениях нейроны типа «адалайн» всегда используется группами, образуя слои, называемые «мадалайн». Каждый входящий в слой нейрон обучается по правилу адалайн.

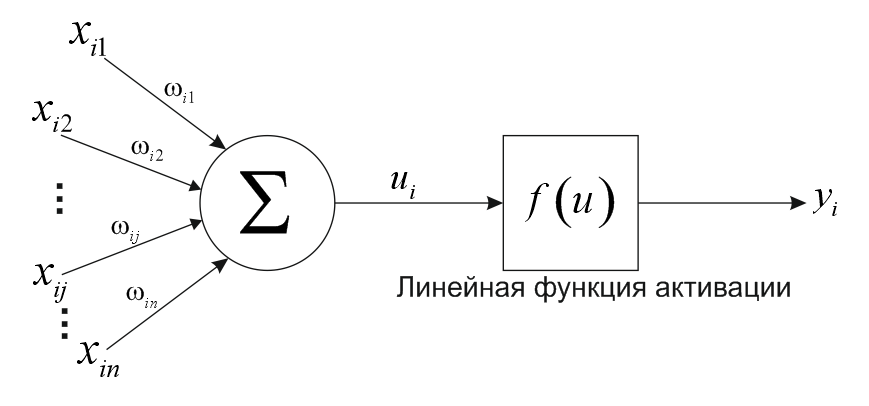

Существует три базовых схемы межнейронных соединений:

Рисунок 19 Межнейронные соединения

Сигналы

суммируются

с учетом порогового значения, установленного

раздельно для каждого типа связи. Для

схемыOR

порог имеет значение (n-1),

для AND

– (1-n),

для мажориторной схемы – нулевое

значение.

суммируются

с учетом порогового значения, установленного

раздельно для каждого типа связи. Для

схемыOR

порог имеет значение (n-1),

для AND

– (1-n),

для мажориторной схемы – нулевое

значение.

В связи с используемой функцией активации выходных сигналов y принимает значение +1, когда хотя бы один из входных сигналов имеет значение +1, когда все входные сигналы имеют значение +1, либо когда большинство сигналов имеет значение +1.

1.10.2011

Инстар и оутстар Гроссберга

Нейроны типа «инстар» и «оутстар» - взаимодополняющие эоементы. Инстра адаптирует веса связей поступающих на сумматор нейрона к входным сигналам, а оутстар согласовывает веса выходящих из нейронов связей, с узлами, в которых формируются значения выходных сигналов. Позволяет обучаться без учителя.

Рисунок 20 Инстар Гроссберга

- правило Гроссберга

(правило подстройки весов при обучении

без учителя),

- правило Гроссберга

(правило подстройки весов при обучении

без учителя),

- коэффициент обучения

- коэффициент обучения

В соответствии с

функцией активации, на выходе нейрона

вырабатывается выходной сигнал

,

равный

,

равный .

В инстаре применяется линейная функция

активации, и тогда

.

В инстаре применяется линейная функция

активации, и тогда .

Обучение инстара производится по правилу

Гроссберга, где

.

Обучение инстара производится по правилу

Гроссберга, где - коэффициент обучения, значение которого

выбирается в интервале от 0 до 1. Входные

данные, представляемые в виде вектораx,

должны быть выражены в нормализованной

форме. Нормализация выполняется по

следующей формуле:

- коэффициент обучения, значение которого

выбирается в интервале от 0 до 1. Входные

данные, представляемые в виде вектораx,

должны быть выражены в нормализованной

форме. Нормализация выполняется по

следующей формуле:

Результаты обучения

по методуГроссберга в значительной

степени зависят от коэффициента обучения

.

При выборе

.

При выборе веса

веса становятся равными значениям

становятся равными значениям уже

после первой итерации. Ввод очередного

входного вектораx

вызовет адаптацию весов к новому вектору

и абсолютное забывание предыдущих

значений. Выбор

уже

после первой итерации. Ввод очередного

входного вектораx

вызовет адаптацию весов к новому вектору

и абсолютное забывание предыдущих

значений. Выбор

приводит к тому, что в результате обучения

весовые коэффициенты

приводит к тому, что в результате обучения

весовые коэффициенты принимают усредненное значение обучающих

векторовx.

принимают усредненное значение обучающих

векторовx.

Пример:

Натренированный инстар функционирует как векторный классификатор, сопоставляющих очередной поданный на его вход вектор с вектором, сформированным в процессе обучения. В случае максимального совпадения этих вектором реакция инстара будет максимальной.

Если инстар обучался

на группе достаточно похожих векторов

с

,

то его весовые коэффициенты примут

значение, усредненное по этим векторам,

и в режиме классификации он будет лучше

всего реагировать на входные векторы,

значения которых наиболее близки

ксредним значениям векторов, входящих

в обучающую группу.

,

то его весовые коэффициенты примут

значение, усредненное по этим векторам,

и в режиме классификации он будет лучше

всего реагировать на входные векторы,

значения которых наиболее близки

ксредним значениям векторов, входящих

в обучающую группу.

Инстар может

обучаться как с учителем, так и без него.

При обучение без учителя в качестве

значения

принимается фактически значение

выходного сигнала.

принимается фактически значение

выходного сигнала.

Рисунок 21 Оутстар Гроссберга

Оутстар представляет собой комплементарное дополнение инстара. Если инстар обучается с целью распознавать вектор, подаваемый на его вход, то оутстар должен генерировать вектор, необходимый связанным с ним нейроном.

Оутстар является

линейным нейроном. Обучение состоит в

таком подборе весов, чтобы выходные

сигналы оутстара были равны ожидаемым

значениям

взаимодействующих с ними нейронов.

взаимодействующих с ними нейронов.

В режиме распознавания

в моменты активации нейрона-источника

оутстар будет генерировать сигналы,

соответствующие ожидаемым значениям

.

.