- •Оглавление

- •Аналитические технологии

- •Формализация нейронных сетей

- •Принцип обучения искусственных нейронных сетей

- •Концепция обучения нейронной сети, предложенная Хэбом

- •Сбор данных для нейронной сети

- •Прикладные возможности нейронных сетей

- •Переобучение и обобщение

- •Персептрон

- •Алгоритм обратного распространения ошибки

- •Сигмоидальный нейрон

- •Нейрон типа «адалайн»

- •Инстар и оутстар Гроссберга

- •Нейрон типа wta (Winner Takes All)

- •08.10.2011 Модель нейрона Хэбба

- •Стохастическая модель нейрона

- •Стохастические алгоритмы обучения

- •Настройка числа нейронов в скрытых слоях многослойных сетей в процессе обучения

- •Алгоритмы сокращения

- •Конструктивные алгоритмы

- •Упрощенные алгоритмы расщепления

- •Радиальная базисная сеть

- •Вероятностные нейронные сети

- •Линейные нейронные сети

- •Обучение

- •Сети с самоорганизацией на основе конкуренции

- •12.11.2011 Модели ассоциативной памяти. Сети Хопфилда

- •Когнитивные карты

- •19.11.2011 Генетические алгоритмы Естественный отбор и генетическое наследование

- •Модель эволюции в природе, реализованная программно

- •Символьная модель простого генетического алгоритма

- •Работа простого генетического алгоритма

- •26.11.2011 Шима (Schema)

- •Применение аналитических технологий

- •03.12.2011

- •Бизнес-приложения

- •Программные реализации аналитических технологий

- •Список литературы

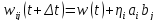

Концепция обучения нейронной сети, предложенная Хэбом

Данная концепция подразумевает, что значения веса между нейронами возрастают, если оба нейрона находятся в возбужденном состоянии:

Сбор данных для нейронной сети

Препроцессирование данных предполагает шкалирование входных значений, перевод номинальных переменных в числовые, т.е. предварительную обработку данных.

Постпроцессирование – заключительная обработка полученных значений.

Основные принципы предварительной обработки:

Данные должны соответствовать действительности;

Обучающие последовательности должны содержать все возможные наборы данных;

Разбор данных должен быть сбалансированным;

17.09.2011

Прикладные возможности нейронных сетей

Выполняемые сетью функции можно распределить на несколько основных групп:

Аппроксимация и интерполяция;

Распознавание и классификация образов;

Сжатие данных;

Прогнозирование;

Идентификация;

Управление;

Ассоциация;

В каждом из назначенных приложений нейронная сеть играет роль универсального аппроксиматора функции от нескольких переменных. Для классификации и распознавания образов сеть обучается их важнейшим признакам, отличающим образы друг от друга, которые и составляют базу для принятия решения об отнесении их к соответствующему классу.

При решении зада прогнозирования роль нейронной сети состоит в предсказании будущей реакции системы по её предшествующему поведении.. Для адаптации весовых коэффициентов используется фактическая погрешность прогнозирования и значения этой погрешности в предшествующие моменты времени.

При решении задач идентификации и управления динамическими процессами нейронная сеть выполняет несколько функций: она представляет собой нелинейную модель этого процесса, обеспечивающую выработку соответствующего управляющего воздействия.

В задачах ассоциации нейронная сеть играет роль ассоциативного запоминающего устройства. Выделяют ЗУ автоассоциативного типа, с помощью которых определяется корреляция между отдельными компонентами одного и того же входного вектора, и ЗУ гетеро ассоциативного типа, средствами которых устанавливается корреляция между двумя различными векторами.

Переобучение и обобщение

Переобучение нейронной сети заключается в том, что минимизируя ошибку на обучающем множестве, нейронная сеть перестает обладать способностью обобщать результат на новые наблюдения. Для преодоления этой проблемы используется механизм контрольной кросс-проверки. Мы резервируем часть обучающих наблюдений и не используем их в обучении. Они используются для независимого контроля результатов.

В начале работы ошибка сети на обучающем и контрольном множестве будет одинаковой. По мере обучения сети ошибка убывает, и пока обучение уменьшает действительную функцию ошибок, ошибка на контрольном множестве та же будет убывать. Если же контрольная ошибка перестала убывать и расти, то обучение следует остановить, поскольку сети переобучена. При этом необходимо уменьшить число нейронов (а иногда и слоёв) нейронной сети.

Другой проблемной обучения нейронных сетей является проблема локальных минимумов. Для их преодоления необходимо передаваясь сети входные данные не только из одного диапазона, но и имеющие значительное преимущество.