- •1. Становление теории информации

- •2. Место теории информации в рамках других наук

- •3. Виды информации и сигналов

- •4. Система связи

- •5. Дискретный источник сообщений.

- •6. Энтропия источника сообщений

- •7. Свойства энтропии

- •8. Семантическая мера информации

- •9. Прагматическая мера информации

- •10. Качество информации

- •11. Способы представления информации для ввода в компьютер

- •12. Двоичное кодирование числовой и текстовой информации

- •13. Двоичное кодирование графической и звуковой информации

- •14. Канал связи без шума

- •15. Канал связи с двумя входами и двумя выходами

- •16. Теорема Шеннона о пропускной способности канала связи

- •17. Основная теорема теории информации

- •18. Помехозащитное кодирование

- •19. Простейшие алгоритмы сжатия информации

- •20. Сжатие информации с потерями

- •21. Особенности изображений при использовании алгоритмов сжатия

- •22. Классы изображений, предназначенных для сжатия

- •23. Классы приложений для сжатия изображений

- •24. Нетрадиционные классы приложений для сжатия изображений

- •25. Требования приложений к алгоритмам компрессии

- •26. Сравнение алгоритмов компрессии

- •27. Критерии сравнения алгоритмов компрессии

- •28. Алгоритм сжатия rle

- •29. Алгоритм сжатия lzw

- •30. Алгоритм сжатия jpeg

7. Свойства энтропии

1) Энтропия любого дискретного ансамбля не отрицательна

![]()

Равенство нулю возможно лишь в том случае, когда источник генерирует одно единственное сообщение с вероятностью Р=1 в этом случае вероятности других сообщений равны нулю. Не отрицательность следует из того, что количество информации в каждом из возможных сообщений источника не отрицательно.

2) Максимально возможное значение энтропии дискретного источника с объемом алфавита N равно logN и достигается в том случае, когда все его сообщения равновероятны.

3) Энтропия объединения нескольких независимых статистических источников сообщений равна сумме энтропии исходных источников - свойство аддитивности энтропии. Не теряя общности, ограничимся рассмотрением объединения u и z с объемами алфавита соответственно N и M. Под объединением двух источников u и z понимают обобщенный источник сообщений (u∙z) характеризующейся совместными P(uizj) всех возможных комбинаций, состояния ui - источника u, zi - источника z. Энтропия обобщенного источника будет равна:

![]()

8. Семантическая мера информации

Для измерения смыслового содержания информации, т.е. ее количества на семантическом уровне, наибольшее признание получила тезаурусная мера, которая связывает семантические свойства информации со способностью пользователя принимать поступившее сообщение. Для этого используется понятие тезаурус пользователя.

Тезаурус - это совокупность сведений, которыми располагает пользователь или система.

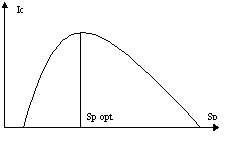

В зависимости от соотношений между смысловым содержанием информации S и тезаурусом пользователя Sp изменяется количество семантической информации Ic, воспринимаемой пользователем и включаемой им в дальнейшем в свой тезаурус. Характер такой зависимости показан на рисунке.

Рассмотрим два предельных случая, когда количество семантической информации Ic равно 0:

при Sp 0 пользователь не воспринимает, не понимает поступающую информацию;

при Sp; пользователь все знает, н поступающая информация ему не нужна.

Максимальное количество семантической информации Ic потребитель приобретает при согласовании ее смыслового содержания S со своим тезаурусом Sp (Sp = Sp opt), когда поступающая информация понятна пользователю и несет ему ранее не известные (отсутствующие в его тезаурусе) сведения.

Следовательно, количество семантической информации в сообщении, количество новых знаний, получаемых пользователем, является величиной относительной. Одно и то же сообщение может иметь смысловое содержание для компетентного пользователя и быть бессмысленным (семантический шум) для пользователя некомпетентного.

9. Прагматическая мера информации

Эта мера определяет полезность информации (ценность) для достижения пользователем поставленной цели. Эта мера также величина относительная, обусловленная особенностями использования этой информации в той или иной системе. Ценность информации целесообразно измерять в тех же самых единицах (или близких к ним), в которых измеряется целевая функция.

Пример. В экономической системе прагматические свойства (ценность) информации можно определить приростом экономического эффекта функционирования, достигнутым благодаря использованию этой информации для управления системой:

Inb(g)=П(g /b)-П(g),

где Inb(g) - ценность информационного сообщения b для системы управления g, П(g) - априорный ожидаемый экономический эффект функционирования системы управления g, П(g /b) - ожидаемый эффект функционирования системы g при условии, что для управления будет использована информация, содержащаяся в сообщении b.

Для компьютерной системы ценными свойствами являются: емкость памяти, производительность компьютера, скорость передачи данных и т.д., время обработки информации и принятия решений.