- •2.Связь эконометрики с другими науками. Эконометрические исследования: проблемы и этапы.

- •3. Случайные переменные. Ковариация, дисперсия и корреляция.

- •4.Модель парной линейной регрессии. Спецификация модели. Определение параметров уравнения парной регрессии по методу наименьших квадратов.

- •5. Модель парной регрессии. Оценка степени тесноты связи между количественными переменными, оценка стат. Значимости уравнения регрессии в целом.

- •6.Модель парной регрессии. Оценка стат.Значимости параметров уравнения регрессии. Оценка стат.Значимости коэф. Корреляции.

- •27. Косвенный метод наименьших квадратов.

5. Модель парной регрессии. Оценка степени тесноты связи между количественными переменными, оценка стат. Значимости уравнения регрессии в целом.

Ур-е регрессии всегда дополн-ся показателем тесноты связи. При исп-нии линейн. регрессии в качестве такого показателя выступает линейный коэффициент корреляции гху. Сущ-ют разные модификации формулы линейного коэффиц-та корреляции, напр.:Rxy= cov(x,y)/(Sx*Sy), Как известно, линейный коэфф-т корреляции находится в границах: -1 <Rxy< 1. Если коэфф-т регрессии Ь > 0, то 0 <Rxy< 1, и, наоборот, при Ь < 0, -1 <Rxy< 0.( величина лин-го коэфф-та корреляции оценивает тесноту связи рассм-ых признаков в ее линейной форме -> близость абсолют-й величины линейного коэфф-та корреляции к 0 еще не означает отсутствие связи между признаками. Для оценки качества подбора линейной функции Рассчит-ся квадрат линейного коэффициента корреляции - R2(коэффициент детерминации). Он характеризует долю дисперсии результативного признака, объясняемую регрессией, в общей дисперсии результати-го признака. В качестве характер-ки оценки адекватности модели или степени согласованности расчетных и фактических значений Y, желательно иметь показатель, отраж-й, в какой мере функция регрессии определется факторными переменными Х, а в какой – стохастическим возмущением - .

Правило

разложения дисперсии:

![]()

![]()

![]() . Поделим все на левую часть и получ.

долю объясненного отклонения +

необъясненное

. Поделим все на левую часть и получ.

долю объясненного отклонения +

необъясненное![]() =

=

![]() показывает,

какая доля общ. вариации анализируемой

зависимой переменной Y обусловлена

измен-ем факторных переменных. Для

случая парной регрессии

показывает,

какая доля общ. вариации анализируемой

зависимой переменной Y обусловлена

измен-ем факторных переменных. Для

случая парной регрессии

![]() = квадрату коэфф-та корреляции переменных

Y иX

(

= квадрату коэфф-та корреляции переменных

Y иX

(![]() ).

).

Табл. Чеддека

|

Значения

|

[0,1-0,3) |

[0,3-0,5) |

[0,5-0,7) |

[0,7-0,9) |

[0.9-0,99] |

|

Сила связи |

слабая |

умеренная |

заметная |

высокая |

весьма высокая |

Оценка

стат. значимости ур-я в целом проводится

по схеме проверки гипотез по F-критерию

Фишера. F=![]() ,

где

,

где![]()

![]() ЕслиFрасч>

Ft,

то коэфф-т детерминации считается

статистически значимым, а модель

адекватной.

ЕслиFрасч>

Ft,

то коэфф-т детерминации считается

статистически значимым, а модель

адекватной.

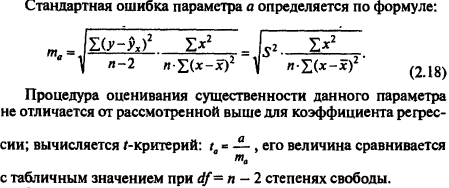

6.Модель парной регрессии. Оценка стат.Значимости параметров уравнения регрессии. Оценка стат.Значимости коэф. Корреляции.

Если

![]() табл.

и

табл.

и![]() табл.,

оба параметра ур-я модели признаются

статистически значимыми с вероятностью

95%. Проверка гипотез о значимости коэфф-в

регрессии и корреляции равносильна

проверке гипотезы о существенности

линейного ур-ия регрессии, ткtb2=tr2=Fрасч.

Для модели линейн. парной регрессии

проверке на статистическую значимость

может быть подвергнут коэфф-т корреляции

табл.,

оба параметра ур-я модели признаются

статистически значимыми с вероятностью

95%. Проверка гипотез о значимости коэфф-в

регрессии и корреляции равносильна

проверке гипотезы о существенности

линейного ур-ия регрессии, ткtb2=tr2=Fрасч.

Для модели линейн. парной регрессии

проверке на статистическую значимость

может быть подвергнут коэфф-т корреляции

![]() по

статистике Стьюдента:

по

статистике Стьюдента:![]() ,

а

,

а![]() .

Если

.

Если![]() ,

то коэфф-т корреляции признается

статистически значимым, а модель

адекватной и надежной. Для коэфф-та

корреляции может быть построен

доверительный интервал:

,

то коэфф-т корреляции признается

статистически значимым, а модель

адекватной и надежной. Для коэфф-та

корреляции может быть построен

доверительный интервал:![]() .

Чем шире интервал, тем больше неопред-ть

в оценке связи между Y иX.

.

Чем шире интервал, тем больше неопред-ть

в оценке связи между Y иX.

Интервалы прогноза по линейному уравнению парной регрессии. Средняя ошибка аппроксимации.

![]()

ошибка до 10-15% говорит о достаточной точности модели.

Нелинейная регрессия. Классификация, примеры функциональных зависимостей.

Линеаризация нелинейных моделей.

оценить параметры такой модели можно на основе МНК для многофакторной модели.

![]()

Введя подстановки lny=u , lnx=v, lna=A, получ. линейную модель u=A+bv, параметры кот. находим по МНК.

Выбор типа математической функции при построении уравнения нелинейн. регр-и. Примеры, применение Мнк для нелин моделей.

Одним

из наиб. наглядных способов подбора

функц-ой связи может быть построение

поля корреляции, по внешнему виду которой

можно предположить тип функциональной

связи. Так напр. поле коррел. на рис.

говорит о равносторонней гиперболе,

существующ. для положительных Х и Y,

как наиб. вероятной. Однако решить этот

вопрос однозначно на основе поля

корелляции достаточно сложно, необходимо

применить колич-ые оценки. Так, для

выбора среди моделей в которых у и

остаток входят линейно используется

МНК ( т.е, например между гиперболой и

полиномом или между степенной и

показательной функциями). Если же выбор

между моделью с линейным Y

(после линеаризации ) и его логарифм-й

формой, то для решения вопроса о подборе

модели применяется метод Зарембки, кот.

Сост.в след.:![]() -

Вычисляется среднее геометрическое

значений y в выборке. - Пересчитываются

наблюдения yi путем деления на среднее

геометрическое. - Оценивается регрессия

для линейной модели с использованием

y* и для логарифмической модели с

использованием log(y*)

-

Вычисляется среднее геометрическое

значений y в выборке. - Пересчитываются

наблюдения yi путем деления на среднее

геометрическое. - Оценивается регрессия

для линейной модели с использованием

y* и для логарифмической модели с

использованием log(y*)

|

11. Индекс детерминации для нелинейных моделей. Корреляция для нелинейной регрессии.

|

или

в таком виде

![]()

![]()

Коэффициент эластичности.

Коэффициенты эластичности характ-ют относит-е изменение зависимой переменной при изменении объясняющей переменной на 1%. Если уравнение модели Y=F(X), то коэфф-т эластичности рассчит-ся:

![]() ,

где

,

где

![]() – ср. величины, а производная берется

в т.

– ср. величины, а производная берется

в т.![]() .

Это эластичность в точке среднего. Также

можно рассчитать точ-ю эл-сть, для этого

вместо средних значений необходимо

подставить координаты конкретной точки

(х,у).

.

Это эластичность в точке среднего. Также

можно рассчитать точ-ю эл-сть, для этого

вместо средних значений необходимо

подставить координаты конкретной точки

(х,у).

Специфик-я линейн. модели множественной регрессии. Оценка параметров множественной регрессии.

![]()

Отбор факторов для построения множественной регрессии.

Мультиколлинеарность факторов. Последствия включения в модель, оценка мультиколлинеарности.

Уравнение регрессии в стандартизированном масштабе.

Частные уравнения регрессии. Парные и частные коэффициенты корреляции.

Если

факторные признаки различны по своей

сущности и/или имеют различ.ед-цы

измерения, то коэфф-ы регрессии

![]() при

разных факторах явл-ся несопоставимыми.

Поэтому ур-е регрессии доп-ют соизмеримыми

показателями тесноты связи фактора с

результатом, позволяющими ранжировать

факторы. К ним относят: частные

коэфф-ты эластичности, β-коэфф-ты,

частные коэфф-ты корр-ии.

при

разных факторах явл-ся несопоставимыми.

Поэтому ур-е регрессии доп-ют соизмеримыми

показателями тесноты связи фактора с

результатом, позволяющими ранжировать

факторы. К ним относят: частные

коэфф-ты эластичности, β-коэфф-ты,

частные коэфф-ты корр-ии.

Парные коэффициенты корреляции. Для измерения тесноты связи между двумя из рассм-х переменных, прим-ся парные коэфф-ты корреляции. Методика расчета таких коэфф-в и их интерпретации аналогичны линейному коэфф-ту корреляции в случае однофакторной связи.

![]()

![]()

![]() где

где

![]() -

средн.квадратич-е отклонение факторного

признака;

-

средн.квадратич-е отклонение факторного

признака;

![]() -

средн.квадратич. отклонение результативного

признака.

-

средн.квадратич. отклонение результативного

признака.

Коэффициент частной корреляции измеряет тесноту линейн. связи между отдельным фактором и результатом при устранении воздействия прочих факторов модели. Для качественной оценки тесноты связи можно исп-ть след. классификацию:

0.1- 0.3- слабая связь; 0.3-0.5 – умеренная связь; 0.5-0.7- заметная связь; 0.7-0.9- тесная связь; 0.9-0.99- весьма тесная

Для расчета частных коэффициентов корреляции могут быть использованы парные коэффициенты корреляции.

Для случая зависимости Yот двух факторов можно вычислить 2 коэффициента частной корреляции:

![]() (2-ой

фактор

(2-ой

фактор

![]() фиксирован);

фиксирован);![]() (1-ый

фактор

(1-ый

фактор

![]() фиксирован).

фиксирован).

Это коэффи-ты частной корреляции 1-ого порядка. Частные коэфф-ты корреляции, рассчит-е по таким формулам изменяются от -1 до +1.

Множественный коэффициент корреляции и множественный коэффициент детерминации

Формула индекса множественной корр-и для линейн. регрессии получила название линейного коэффициента множеств-й корр-и, или, что то же самое, совокупного коэфф-а корри.Квадрат множ-го коэфф-та корреляции называется множественным коэффициентом детерминации. Он пок-т, какая доля дисперсии результативного признака объясняется влиянием независ-х переменных.

Оценки качества модели множественной регрессии: F-критерий Фишера и частный F-критерий.

Для того, чтобы сделать вывод о качестве модели множественной регрессии, необх. сравнить получ. знач-е с табл-м, найденным с ошибкой α, степенями свободы k1=m, k2=n-m-1. Превышение расчетного значения над табличным говорит о высоком качестве модели при высоком коэф-е детерм-и.

Фиктивные переменные во множ-й регрессии.

Может оказаться необх-ым вкл- в модель фактор, имеющий 2 или более качеств-х уровней ( атрибутив-е признаки: профессия, пол, образ-е, климатич-е условия…). Чтобы ввести такие переменные в регресс-ю модель, им должны быть присвоены те или иные цифровые метки, т.е. качественные переменные, преобразованы в колич-е. Такого вида сконструированные переменные в эконометрике наз-ся фиктивными переменными. Переменная z, вводимая в модель принимает значения z=0 и z=1, а модель имеет вид напр.

y=a0+a1x+a2z. Проведя анализ статической значимости параметров или частных F-критериев можно сделать вывод о том, влияет ли фиктивная переменная на значение результата (у). А если влияние установлено, то оценить его можно с помощью коэфф-та эластичности. Если число градаций качественного признака-фактора превышает 2, то в модель ввод-ся неск. фиктивных переменных, число которых должно быть меньше числа качественных градаций. Тогда матрица исходных фиктивных переменных не будет линейно зависима и возможна оценка параметров модели их интерпретации аналогично моделям с 1 фикс. переменной.

Условия применения МНК.

Гетероскедастичность случайного члена.

Автокоррелированность случайного члена (е)

Обобщенный МНК.

При наруш-и гомоскедастичности и наличии автокорр-ии ошибок исп-ся метод наименьших квадратов . Он прим-ся к преобразованным данным и позволяет получать оценки, кот. обладают не только свойством несмещенности, но и имеют меньшие выборочные дисперсии

Параметры такой модели зависят от концепции, принятой для коэффициента пропорциональности Кi. Далее параметры находятся по обычному МНК.

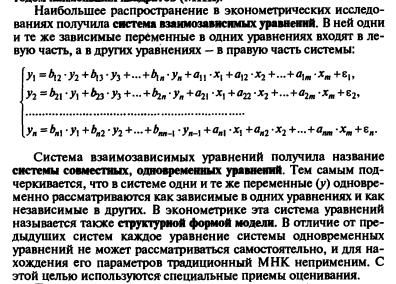

Общее понятие о системах эконометрических уравнений. Структурная и приведенная формы системы эконометрических уравнений.

Объектом статистич-го изучения в соц-х науках явл-ся сложные системы. Измерение тесноты связей между переменными, построение изолир-х ур-ий регрессии недостаточно для описания таких систем и объяснения механизма их функционирования. При исп-и отдельных ур-ий регрессииь (для экон-их расчетов, в большинстве случаев предполагается, что факторы можно изменять независ. друг от друга. Однако, практически изменение 1й переменной не может происходить при абсолют-й неизменности других. Ее изменение повлечет за собой изменения во всей системе взаимосвязанных признаков. След-о, отдельно взятое ур-е множественной регрессии не может характеризовать истинные влияния отдельных признаков на вариацию результирующей переменной.

Проблемы идентификации систем эконометрических ур-ий.

При переходе от приведенной формы модели к структурной, исследователь сталкивается с проблемой идентификации. Идентификация —единственность соотв-ия между приведенной и структурной формами модели. Модель считается идентифицируемой, если каждое ур-ие системы идентифицируемо. 3 вида структурных моделей: • идентифицируемые; • неидентифицируемые; • сверхидентифицируемые.

Модель идентифицируема, если все структурные коэфф-ты опред-ся однозначно.

Модель неидентифицируема, если число приведенных

Коэфф-в меньше числа структур-х коэфф-в, и в результате структурные коэфф-ы не могут быть оценены через коэфф-ты приведенной формы модели. Структур-я модель в полном виде, содерж-я П эндогенных и Т предопределенных переменных в каждом уравнении системы, всегда неидентифицируема.

Модель сверхидентифицируема, если число приведенных коэфф-в больше числа структурных коэфф-в. В этом случае на основе коэфф-в приведенной формы можно получить 2 или более значений 1го структур-го коэфф-та. Здесь число структурных коэфф-в меньше

числа коэфф-в приведенной формы.