- •В чем заключается отличие интеллектуальной системы от классической неинтеллектуальной сау (состоящей из п, и-регуляторов и пр.)? [вверх]

- •Являются ли инфузория-туфелька интеллектуальной системой? Поясните свое решение. [вверх]

- •Назовите несколько императивных и декларативных языков программирования. [вверх]

- •Дайте определение понятию «Знание» в контексте сии. [вверх]

- •Назовите 4 составных элемента логической модели представления знаний. [вверх]

- •Охарактеризуйте суть сетевой модели представления знаний. [вверх]

- •Как выглядит предложение-продукция в продукционной модели знаний? [вверх]

- •Дайте определение понятию «фрейм» в рамках фреймовой мпз. [вверх]

- •Представьте графически с помощью сетевой мпз область знаний «Подразделения сф ОмГту». [вверх]

- •Дайте определение понятию «предикат». [вверх]

- •Дайте определение понятию «факт» с точки зрения логики. [вверх]

- •Какие правила и методы используются в логической мпз для получения истинного высказывания. [вверх]

- •Дайте определение понятию «силлогизм». [вверх]

- •В чем заключается правило резолюций. [вверх]

- •Какие методы ии можно отнести к направлению биологического моделирования. [вверх]

- •Назовите и дайте определение двум основным подобластям направления в ии, связанного с накоплением и использованием знаний. [вверх]

- •В чем состоит задача классификации? [вверх]

- •Назовите и раскройте суть двух основных этапов формулирования задачи для решения её методами ии. [вверх]

- •Назовите причины возникновения и развития теории нечетких множеств и нечеткой логики. [вверх]

- •Укажите отличия нечеткого подмножества от четкого. [вверх]

- •Раскройте понятие функции принадлежности (характеристической функции). [вверх]

- •Дайте определению нейрону с математической точки зрение и опишите его в виде уравнения (укажите смысл используемых переменных). [вверх]

- •Для чего используется дополнительный вход нейрона обозначаемый как w0x0 (или t). [вверх]

- •Перечислите модификации линейной передаточной функции и охарактеризуйте их. [вверх]

- •Охарактеризуйте пороговую передаточную функцию и изобразите её график. [вверх]

- •Назовите 2 преимущества сигмоидальной передаточной функции и функции гиперболического тангенса над линейной и пороговой передаточными функциями. [вверх]

- •Изобразите нейрон реализующий операцию дизъюнкции. [вверх]

- •Перечислите 4-ре категории инс характеризующие способ взаимосвязи нейронов. [вверх]

- •На какие два основных класса разделяют инс. Опишите эти классы. [вверх]

- •В каком случае многослойная нс эквивалентна однослойной. [вверх]

- •В чем заключается цель обучения инс? [вверх]

- •Перечислите 3 парадигмы обучения инс и кратко их охарактеризуйте. [вверх]

- •Перечислите типы элементов составляющих перцептрон и опишите порядок их взаимодействия. [вверх]

- •Дайте общее определение алгоритма обучения инс (системы подкрепления). [вверх]

- •Запишите правило Хебба об обучении инс. [вверх]

- •О чем говорит теорема сходимости перцептрона, описанная и доказанная ф. Розенблаттом? [вверх]

- •Какие задачи решают с помощью самоорганизующихся карт Кохонена. [вверх]

- •Запишите базовое рекуррентное уравнение, вычисляющее текущие веса синапсов n-го слоя инс. [вверх]

- •На чём основывается способность нейронной сети к прогнозированию и сжатию данных. [вверх]

- •Какими характеристиками обладает инс в отличие от вм фон Неймана. [вверх]

- •Какая теорема лежит в основе генетических алгоритмов, и что она доказывает? [вверх]

- •Дайте определение понятию «эволюционные алгоритмы». [вверх]

- •Дайте определение понятию «генетические алгоритмы». [вверх]

- •Опишите шаги работы генетического алгоритма. [вверх]

- •Что определение «функции приспособленности» и укажите какую роль она играет в га. [вверх]

- •Назовите и опишите генетические операции, с помощью которых происходит получение новых решений в га. [вверх]

- •Перечислите критерии остановки генетического алгоритма. [вверх]

- •Назовите несколько областей применения генетических алгоритмов. [вверх]

- •Дайте определение понятию «экспертные системы». [вверх]

- •Изобразите структуру типичной экспертной системы. [вверх]

- •Что является ядром и самым важным компонентом экспертной системы? [вверх]

- •Зачем нужен инженер по знаниям при создании экспертной системы? [вверх]

- •В каких режимах может работать экспертная система, кратко охарактеризуйте их. [вверх]

- •Перечислите этапы разработки экспертная система и кратко охарактеризуйте их. [вверх]

В каком случае многослойная нс эквивалентна однослойной. [вверх]

Однослойные искусственные нейронные сети

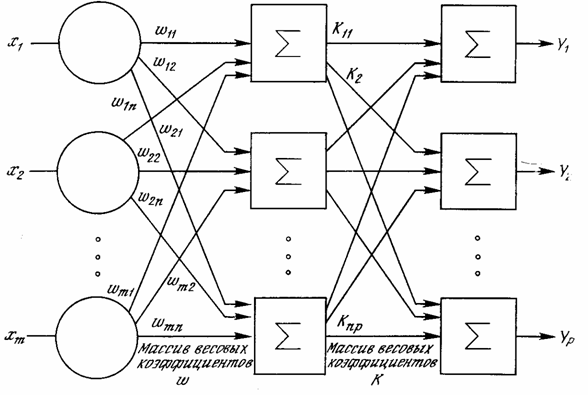

На изображениях нейронных сетей вершины-круги служат лишь для распределения входных сигналов. Они не выполняют каких-либо вычислений, и поэтому не считаются слоем. По этой причине они обозначены кругами, чтобы отличать их от вычисляющих нейронов, обозначенных квадратами

Удобно считать веса элементами матрицы W. Матрица имеет m строк и n столбцов, где m – число входов, а n – число нейронов. Например, w3,2 – это вес, связывающий третий вход со вторым нейроном.

Многослойные искусственные нейронные сети

Более крупные и сложные нейронные сети обладают, как правило, и большими вычислительными возможностями.

Хотя созданы сети всех конфигураций, какие только можно себе представить, послойная организация нейронов копирует слоистые структуры определенных отделов мозга. Многослойные сети могут образовываться каскадами слоев. Выход одного слоя является входом для последующего слоя. Подобная сеть показана на рисунке.

Многослойные сети могут привести к увеличению вычислительной мощности по сравнению с однослойной сетью лишь в том случае, если активационная функция между слоями будет нелинейной.

Вычисление выхода слоя заключается в умножении входного вектора на первую весовую матрицу с последующим умножением (если отсутствует нелинейная активационная функция) результирующего вектора на вторую весовую матрицу.

(X×W1) ×W2

Так как умножение матриц ассоциативно, то

(X×W1) ×W2 = X× (W1×W2).

Это показывает, что двухслойная линейная сеть эквивалентна одному слою с весовой матрицей, равной произведению двух весовых матриц. Следовательно, любая многослойная линейная сеть может быть заменена эквивалентной однослойной сетью. Однослойные сети весьма ограниченны по своим вычислительным возможностям. Таким образом, для расширения возможностей сетей по сравнению с однослойной сетью необходима нелинейная активационная функция.

В чем заключается цель обучения инс? [вверх]

Среди всех интересных свойств искусственных нейронных сетей важнейшее - способность к обучению. Их обучение до такой степени напоминает процесс интеллектуального развития человеческой личности что может показаться, что достигнуто глубокое понимание этого процесса.

Цель обучения.

Сеть обучается, чтобы для некоторого множества входов давать желаемое (или, по крайней мере, сообразное с ним) множество выходов. Каждое такое входное (или выходное) множество рассматривается как вектор. Обучение осуществляется путем последовательного предъявления входных векторов с одновременной подстройкой весов в соответствии с определенной процедурой. В процессе обучения веса сети постепенно становятся такими, чтобы каждый входной вектор вырабатывал выходной вектор.

Перечислите 3 парадигмы обучения инс и кратко их охарактеризуйте. [вверх]

Алгоритмы обучения.

Существует великое множество различных алгоритмов обучения, которые однако делятся на два больших класса: детерминистские и стохастические. В первом из них подстройка весов представляет собой жесткую последовательность действий, во втором – она производится на основе действий, подчиняющихся некоторому случайному процессу.

Для конструирования процесса обучения, прежде всего, необходимо иметь модель внешней среды, в которой функционирует нейронная сеть - знать доступную для сети информацию. Эта модель определяет парадигму обучения. Во-вторых, необходимо понять, как модифицировать весовые параметры сети - какие правила обучения управляют процессом настройки. Алгоритм обучения означает процедуру, в которой используются правила обучения для настройки весов.

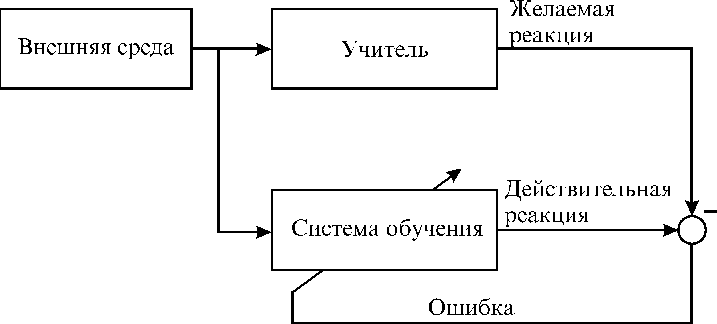

Существуют три парадигмы обучения: "с учителем", "без учителя" (самообучение) и смешанная.

Обучение с учителем предполагает, что для каждого входного вектора существует целевой вектор, представляющий собой требуемый выход. Вместе они называются обучающей парой. Обычно сеть обучается на некотором числе таких обучающих пар. Предъявляется выходной вектор, вычисляется выход сети и сравнивается с соответствующим целевым вектором, разность (ошибка) с помощью обратной связи подается в сеть и веса изменяются в соответствии с алгоритмом, стремящимся минимизировать ошибку. Векторы обучающего множества предъявляются последовательно, вычисляются ошибки и веса подстраиваются для каждого вектора до тех пор, пока ошибка по всему обучающему массиву не достигнет приемлемо низкого уровня.

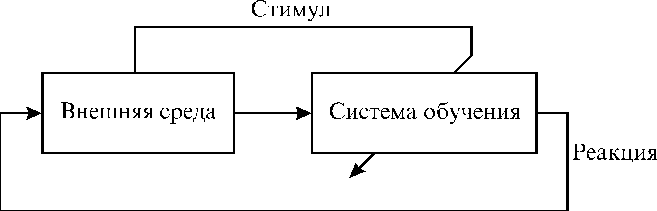

Несмотря на многочисленные прикладные достижения, обучение с учителем критиковалось за свою биологическую неправдоподобность. Трудно вообразить обучающий механизм в мозге, который бы сравнивал желаемые и действительные значения выходов, выполняя коррекцию с помощью обратной связи. Если допустить подобный механизм в мозге, то откуда тогда возникают желаемые выходы? Обучение без учителя является намного более правдоподобной моделью обучения в биологической системе. Развитая Кохоненом и многими другими, она не нуждается в целевом векторе для выходов и, следовательно, не требует сравнения с предопределенными идеальными ответами. Обучающее множество состоит лишь из входных векторов. Обучающий алгоритм подстраивает веса сети так, чтобы получались согласованные выходные векторы, т. е. чтобы предъявление достаточно близких входных векторов давало одинаковые выходы. Процесс обучения, следовательно, выделяет статистические свойства обучающего множества и группирует сходные векторы в классы. Предъявление на вход вектора из данного класса даст определенный выходной вектор, но до обучения невозможно предсказать, какой выход будет производиться данным классом входных векторов. Следовательно, выходы подобной сети должны трансформироваться в некоторую понятную форму, обусловленную процессом обучения. Это не является серьезной проблемой. Обычно не сложно идентифицировать связь между входом и выходом, установленную сетью.

Большинство современных алгоритмов обучения выросло из концепций Хэбба. Им предложена модель обучения без учителя, в которой синаптическая сила (вес) возрастает, если активированны оба нейрона, источник и приемник. Таким образом, часто используемые пути в сети усиливаются и феномен привычки и обучения через повторение получает объяснение.