- •В чем заключается отличие интеллектуальной системы от классической неинтеллектуальной сау (состоящей из п, и-регуляторов и пр.)? [вверх]

- •Являются ли инфузория-туфелька интеллектуальной системой? Поясните свое решение. [вверх]

- •Назовите несколько императивных и декларативных языков программирования. [вверх]

- •Дайте определение понятию «Знание» в контексте сии. [вверх]

- •Назовите 4 составных элемента логической модели представления знаний. [вверх]

- •Охарактеризуйте суть сетевой модели представления знаний. [вверх]

- •Как выглядит предложение-продукция в продукционной модели знаний? [вверх]

- •Дайте определение понятию «фрейм» в рамках фреймовой мпз. [вверх]

- •Представьте графически с помощью сетевой мпз область знаний «Подразделения сф ОмГту». [вверх]

- •Дайте определение понятию «предикат». [вверх]

- •Дайте определение понятию «факт» с точки зрения логики. [вверх]

- •Какие правила и методы используются в логической мпз для получения истинного высказывания. [вверх]

- •Дайте определение понятию «силлогизм». [вверх]

- •В чем заключается правило резолюций. [вверх]

- •Какие методы ии можно отнести к направлению биологического моделирования. [вверх]

- •Назовите и дайте определение двум основным подобластям направления в ии, связанного с накоплением и использованием знаний. [вверх]

- •В чем состоит задача классификации? [вверх]

- •Назовите и раскройте суть двух основных этапов формулирования задачи для решения её методами ии. [вверх]

- •Назовите причины возникновения и развития теории нечетких множеств и нечеткой логики. [вверх]

- •Укажите отличия нечеткого подмножества от четкого. [вверх]

- •Раскройте понятие функции принадлежности (характеристической функции). [вверх]

- •Дайте определению нейрону с математической точки зрение и опишите его в виде уравнения (укажите смысл используемых переменных). [вверх]

- •Для чего используется дополнительный вход нейрона обозначаемый как w0x0 (или t). [вверх]

- •Перечислите модификации линейной передаточной функции и охарактеризуйте их. [вверх]

- •Охарактеризуйте пороговую передаточную функцию и изобразите её график. [вверх]

- •Назовите 2 преимущества сигмоидальной передаточной функции и функции гиперболического тангенса над линейной и пороговой передаточными функциями. [вверх]

- •Изобразите нейрон реализующий операцию дизъюнкции. [вверх]

- •Перечислите 4-ре категории инс характеризующие способ взаимосвязи нейронов. [вверх]

- •На какие два основных класса разделяют инс. Опишите эти классы. [вверх]

- •В каком случае многослойная нс эквивалентна однослойной. [вверх]

- •В чем заключается цель обучения инс? [вверх]

- •Перечислите 3 парадигмы обучения инс и кратко их охарактеризуйте. [вверх]

- •Перечислите типы элементов составляющих перцептрон и опишите порядок их взаимодействия. [вверх]

- •Дайте общее определение алгоритма обучения инс (системы подкрепления). [вверх]

- •Запишите правило Хебба об обучении инс. [вверх]

- •О чем говорит теорема сходимости перцептрона, описанная и доказанная ф. Розенблаттом? [вверх]

- •Какие задачи решают с помощью самоорганизующихся карт Кохонена. [вверх]

- •Запишите базовое рекуррентное уравнение, вычисляющее текущие веса синапсов n-го слоя инс. [вверх]

- •На чём основывается способность нейронной сети к прогнозированию и сжатию данных. [вверх]

- •Какими характеристиками обладает инс в отличие от вм фон Неймана. [вверх]

- •Какая теорема лежит в основе генетических алгоритмов, и что она доказывает? [вверх]

- •Дайте определение понятию «эволюционные алгоритмы». [вверх]

- •Дайте определение понятию «генетические алгоритмы». [вверх]

- •Опишите шаги работы генетического алгоритма. [вверх]

- •Что определение «функции приспособленности» и укажите какую роль она играет в га. [вверх]

- •Назовите и опишите генетические операции, с помощью которых происходит получение новых решений в га. [вверх]

- •Перечислите критерии остановки генетического алгоритма. [вверх]

- •Назовите несколько областей применения генетических алгоритмов. [вверх]

- •Дайте определение понятию «экспертные системы». [вверх]

- •Изобразите структуру типичной экспертной системы. [вверх]

- •Что является ядром и самым важным компонентом экспертной системы? [вверх]

- •Зачем нужен инженер по знаниям при создании экспертной системы? [вверх]

- •В каких режимах может работать экспертная система, кратко охарактеризуйте их. [вверх]

- •Перечислите этапы разработки экспертная система и кратко охарактеризуйте их. [вверх]

Запишите базовое рекуррентное уравнение, вычисляющее текущие веса синапсов n-го слоя инс. [вверх]

Метод обратного распространения ошибки

Для обучения многослойных сетей рядом учёных, в том числе Д. Румельхартом, был предложен градиентный алгоритм обучения с учителем, проводящий сигнал ошибки, вычисленный выходами перцептрона, к его входам, слой за слоем. Сейчас это самый популярный метод обучения многослойных перцептронов. Его преимущество в том, что он может обучить все слои нейронной сети, и его легко просчитать локально. Однако этот метод является очень долгим, к тому же, для его применения нужно, чтобы передаточная функция нейронов была дифференцируемой. При этом в перцептронах пришлось отказаться от бинарного сигнала, и пользоваться на входе непрерывными значениями.

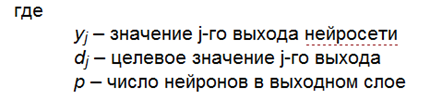

В общем случае задача обучения НС сводится к нахождению некой функциональной зависимости Y=F(X) где X – входной, а Y – выходной векторы. В общем случае такая задача, при ограниченном наборе входных данных, имеет бесконечное множество решений. Для ограничения пространства поиска при обучении ставится задача минимизации целевой функции ошибки НС, которая находится по методу наименьших квадратов:

![]()

Обучение

нейросети производится методом

градиентного спуска, т. е. на каждой

итерации изменение веса производится

по формуле

![]() , где η

– параметр, определяющий скорость

обучения

, где η

– параметр, определяющий скорость

обучения

![]() где

yj

– значение выхода j-го нейрона Sj

– взвешенная сумма входных сигналов

где

yj

– значение выхода j-го нейрона Sj

– взвешенная сумма входных сигналов

При

этом множитель

![]() где

xi

– значение i-го

входа нейрона

где

xi

– значение i-го

входа нейрона

Далее рассмотрим определение первого множителя предыдущей формулы

![]() где

k

– число нейронов в слое n+1.

где

k

– число нейронов в слое n+1.

Введем

вспомогательную переменную

![]()

Тогда мы сможем определить рекурсивную формулу для определения n-ного слоя, если нам известно следующего (n+1)-го слоя.

![]()

Нахождение же для последнего слоя НС не представляет трудности, так как нам известен целевой вектор, т. е. вектор тех значений, которые должна выдавать НС при данном наборе входных значений.

![]()

И

наконец запишем формулу

![]() в

раскрытом виде

в

раскрытом виде

![]()

![]()

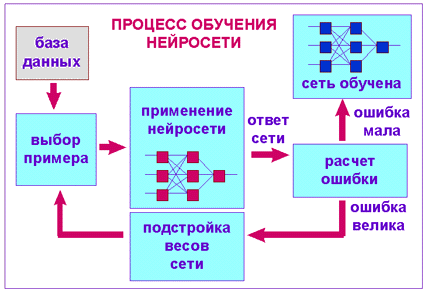

Рассмотрим теперь полный алгоритм обучения нейросети:

1. подать на вход НС один из требуемых образов и определить значения выходов нейронов нейросети;

2. рассчитать для выходного слоя НС по формуле (2) и рассчитать изменения весов выходного слоя N по формуле (3)

3. Рассчитать по формулам (1) и (3) соответственно и для остальных слоев НС, n = N-1..1;

4. Скорректировать все веса НС;

5. Если ошибка существенна, то перейти на шаг 1.

![]()

На этапе 2 сети поочередно в случайном порядке предъявляются вектора из обучающей последовательности.

На чём основывается способность нейронной сети к прогнозированию и сжатию данных. [вверх]

Топология такой сети характеризуется тем, что количество нейронов в выходном слое, как правило, равно количеству определяемых классов. При этом устанавливается соответствие между выходом нейронной сети и классом, который он представляет. Когда сети предъявляется некий образ, на одном из её выходов должен появиться признак того, что образ принадлежит этому классу. В то же время на других выходах должен быть признак того, что образ данному классу не принадлежит. Если на двух или более выходах есть признак принадлежности к классу, считается что сеть «не уверена» в своём ответе.

Принятие решений и управление

Эта задача близка к задаче классификации. Классификации подлежат ситуации, характеристики которых поступают на вход нейронной сети. На выходе сети при этом должен появиться признак решения, которое она приняла. При этом в качестве входных сигналов используются различные критерии описания состояния управляемой системы.

Кластеризация

Под кластеризацией понимается разбиение множества входных сигналов на классы, при том, что ни количество, ни признаки классов заранее не известны. После обучения такая сеть способна определять, к какому классу относится входной сигнал. Сеть также может сигнализировать о том, что входной сигнал не относится ни к одному из выделенных классов — это является признаком новых, отсутствующих в обучающей выборке, данных. Таким образом, подобная сеть может выявлять новые, неизвестные ранее классы сигналов. Соответствие между классами, выделенными сетью, и классами, существующими в предметной области, устанавливается человеком. Кластеризацию осуществляют, например, нейронные сети Кохонена.

Прогнозирование

Способности нейронной сети к прогнозированию напрямую следуют из ее способности к обобщению и выделению скрытых зависимостей между входными и выходными данными. После обучения сеть способна предсказать будущее значение некой последовательности на основе нескольких предыдущих значений и/или каких-то существующих в настоящий момент факторов

Аппроксимация

Нейронные сети — могут аппроксимировать непрерывные функции. Спомощью линейных операций и каскадного соединения можно из произвольного нелинейного элемента получить устройство, вычисляющее любую непрерывную функцию с некоторой наперёд заданной точностью. От выбора нелинейной функции может зависеть сложность конкретной сети, но с любой нелинейностью сеть остаётся универсальным аппроксиматором и при правильном выборе структуры может достаточно точно аппроксимировать функционирование любого непрерывного автомата.

Сжатие данных и Ассоциативная память

Способность нейросетей к выявлению взаимосвязей между различными параметрами дает возможность выразить данные большой размерности более компактно, если данные тесно взаимосвязаны друг с другом. Обратный процесс — восстановление исходного набора данных из части информации — называется (авто)ассоциативной памятью. Ассоциативная память позволяет также восстанавливать исходный сигнал/образ из зашумленных/поврежденных входных данных. Решение задачи гетероассоциативной памяти позволяет реализовать память, адресуемую по содержимому.