8363_НерсисянАС_ПР-3

.docx

МИНОБРНАУКИ РОССИИ

Санкт-Петербургский государственный

электротехнический университет

«ЛЭТИ» им. В.И. Ульянова (Ленина)

Кафедра информационных систем

отчет

по практической работе №3

по дисциплине «Теория информации»

Тема: Условно-энтропийный, алгоритмический, семантический и прагматический (ценностный) подходы к определению количества информации.

Студент гр. 8363 |

|

Нерсисян А. С. |

Преподаватель |

|

Писарев И. А. |

Санкт-Петербург

2020

Цель работы

Изучить понятия условной энтропии, семантической меры количества информации, организации информационного тезауруса, формулу А.А.Харкевича для оценки ценности информации.

Задание на практическую работу

2.1. Письменно ответить на вопросы

Понятие условной энтропии

Сущность алгоритмического подхода к измерению количества информации.

Понятие семантической меры количества информации.

Организация информационного тезауруса.

Формула А.А.Харкевича для оценки ценности информации.

2.2. Решить задачи

2.2.1. Требуется определить условную энтропию источника, если: число символов алфавита источника N=4; вероятности появления символов источника Px1=0.5, Px2=0.25, Px3=0.125 и Px4=0.125.

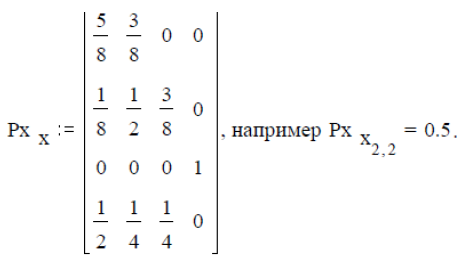

Между соседними символами имеются корреляционные связи, которые описываются матрицей условных вероятностей P(xi/xj) следующего вида:

2.2.2. Приведите примеры двух последовательностей символов некоторого алфавита и предложите сравнительную оценку количества информации на основе алгоритмического подхода А. Н. Колмогорова.

2.2.3. Составьте информационный тезаурус по теме «информатика». Приведите примеры двух различных сообщений, которые имеют одинаковую семантическую оценку в контексте составленного тезауруса. Составьте сообщение, которое содержит семантически значимое количество информации.

2.2.4. Определите ценность информации, если после получения сообщения вероятность достижения цели выросла на 0.2 и составила 1.0.

Выполнение работы

Понятие условной энтропии

Условной

энтропией случайной величины

при

условии

называется величина

называется величина

при заданном значении случайной величины Y называется величина

Сущность алгоритмического подхода к измерению количества информации.

Количество информации определяется как минимальная длина программы, позволяющей преобразовать один объект (множество) в другой. Чем больше различаются два объекта между собой, тем сложнее (длиннее) программа перехода от одного объекта к другому.

Понятие семантической меры количества информации.

Семантика изучает знаковые системы как средства выражения смысла, определенного содержания, т.е. правила интерпретации знаков и их сочетаний, смысловую сторону языка.

Организация информационного тезауруса.

Тезаурус - информация, содержащаяся в системе на данном уровне, необходимая для рецепции или генерации информации на следующем уровне.

Каждый раз, когда мы воспринимаем или генерируем информацию, нам необходимы некоторые знания (язык, математика, история, биология и т.п.), которые и составляют наш тезаурус.

Формула А.А.Харкевича для оценки ценности информации.

Прагматика рассматривает соотношение между знаковыми системами и их пользователями, или приемниками-интерпретаторами сообщений. Иными словами, к прагматике относится изучение практической полезности знаков, слов и, следовательно, сообщений, т.е. потребительский аспект изучения языка.

Для всех прагматических подходов характерно стремление связать понятие информации с целенаправленным поведением и выдвинуть те или иные количественные меры ценности информации.

А.А.Харкевич предложил связать меру ценности информации с изменением вероятности достижения цели при получении этой информации:

где

и

и

– вероятность достижения цели

соответственно до и после получения

информации.

– вероятность достижения цели

соответственно до и после получения

информации.

2.2.1. Решение

Единицы измерения количества энтропии:

при натуральном логарифме (нит) −

при двоичном логарифме (бит) –

Ввиду зависимости между символами неопределенность источника характеризуется условной энтропией H(X/X). С учетом корреляционной связи и соотношения

на основании формулы условной энтропии величины X относительно Y

условная

энтропия

2.2.2. Решение

|

|

|

|

|

|

|

|

|

|

|

|

|

А |

А |

А |

Б |

Б |

Г |

Т |

У |

Я |

Д |

|

|

Ф |

Г |

Й |

Л |

П |

Р |

В |

Я |

З |

Ц |

Суть алгоритмического измерения количества информации заключается в том, что количество информации определяется как минимальная длина программы, позволяющей преобразовать один объект (множество) в другой. Чем больше различаются два объекта между собой, тем сложнее (длиннее) программа перехода от одного объекта к другому.

Так, воспроизвести последовательность букв под номером 1 можно при помощи относительно простой программы. Несколько большей окажется длина программы, восстанавливающей последовательность по номером 2. Длина программы при этом измеряется количеством команд (операций), позволяющих воспроизвести заданную последовательность.

Таким образом, вторая последовательность содержит больше информации, чем первая.

Решение

Информатика – наука о методах и процессах сбора, хранения, обработки, передачи, анализа и оценки информации с применением компьютерных технологий, обеспечивающих возможность её использования для принятия решений.

2.2.4. Решение

СПИСОК ИСПОЛЬЗОВАННЫХ ИСТОЧНИКОВ

Чанышев О.Г. Курс лекций «Введение в искусственный интеллект» / Чанышев О.Г. – Омск: Математический факультет ОмГУ, 2005. - 178 с.

Луковкин, С.Б. Теоретические основы информатики: учеб. пособие / С.Б. Луковкин – Мурманск: Изд-во МГТУ, 2008. - 125 с.

Зверева Е.Н., Лебедько Е.Г. Сборник примеров и задач по основам теории информации и кодирования сообщений: СПб: НИУ ИТМО, 2014.-76 с.