- •Система прийняття рішень. Загальна задача прийняття рішення.

- •2. 3,4, Параментричні і непараметричні Ср. Лотерейна та Матрична ср. Приклади

- •Непараметричні ситуації прийняття рішень. Приклади.

- •5,6 Перетворення мсср у лсср. Перетворення лсср у мсрр. Еквівалентність

- •6.Перехід від лотерейної до матричної ситуації прийняття рішень та повернення до тієї ж лспр.

- •5.Перехід від матричної моделі до лотерейної

- •11, 12. Перетворення ммср і лмср при стохастичній закономірності

- •1 3. Функція корисності

- •17. Очікувана корисність. Теорема Наймана-Моргенштерна

- •18. Функція втрат. Невід’ємна функція витрат

- •19. Критерій Вальда

- •20. Критерій Севіджа

- •21. Критерій Гуровіця

- •22. Критерій Лапласа

- •23. Система принятия решения и задача решения

- •24. Частково впорядкована множина[ред.]

- •Спеціальні типи частково впорядкованих множин [ред.] Лінійно впорядковані множини [ред.]

- •Цілком впорядковані множини [ред.]

- •Повна частково впорядкована множина [ред.]

- •25. Баєсівський ризик та баєсівське рішення

- •Байєсівський ризик

- •26. Увігнутість баєсівського рішення

- •27,Рандомізація у теорії ігор та теорії рішень.

- •27 Рандомизация и смешанные решения

- •29. Допустима та баєсівська границі у зр зі скінченними просторами

- •33. Побудова байєсівських вирішуючих функції екстенсивним методом

- •35 Лема Неймана –Пірсона.

- •36. Опуклі функції. Нерівність Єнсена

- •39,Системи Підтримки прийняття рішень

- •Класифікація сппр

- •42. Вибірковий простір. Події та їх ймовірності.

- •43 Залежні й незалежні випадкові події,

- •44 Умовна ймовірність та її властивості.

- •45. Случайные величины и их распределения

29. Допустима та баєсівська границі у зр зі скінченними просторами

Розглядається спеціальна задача рішення, в якій простір Ω складається з k (k>1) точок, а простір рішень D – з m точок (m>1).

Тобто, D, Ω -- скінченні.

Всі змішані рішення задаються ймовірностями p1, p2… pm. Для задання будь-якого рішення /*(і чистого і рандомізованого )*/ нам достатньо задати ймовірності на кожному з чистих рішеннях, що призводять до такого рішення.

Тоді зрозуміло, що вектор втрат задається так: (позначимо через y(d)):

y(d) = [L(w(1,d),… , L(w(,d)]

Рішення d є M називається допустимим, якщо не існує іншого рішення d’, при якому L(wi,d’) =< L(wi,d),

при i=1,…,k, і що L(wi,d’) < L(wi,d) хоча б для одного значення і.

Припустима границя множини G:

Гп(G)={x є G : не існує y є G, такий що, для всіх i, yi =< xi i = 1..k.,

Існує j, yj < xj, j=1..k}

Баєсівська границя множини G:

Гб (G) = {x є G : не існує y, є G, для всіх i, yi<xi}

Теорема:

Вектор y(d*) належить баєсівській границі тоді і тільки тоді,

коли існує розподіл ξ параметра W, при якому d* -- баєсівське рішення.

Доведення:

1) припустимо, що d* -- баєсівське рішення при розподілі ξ ={ξ1, … ξk}. І нехай y(d*)=(y*1,… y*k). І для всіх інших d, y(d)=(y1,… yk). Тоді ξy(d*) =< ξy, оскільки ξk і >= 0 при i=1..k, і ξi > 0 хоча б для одного значення i. Нерівність yi < y*i при будь-якому і неможлива /*(бо y* -- баєсівська)*/, тому y(d*) лежить на баєсівській границі G.

2) Тепер нехай y(d*) – точка баєсівської границі. Тоді, а точці y(d*) існує опорна гіперплощина a’x=c така, що всі компоненти вектора a=(a1… aі)’ невід’ємні. Поділивши всі компоненти вектора а і сталу с на суму aі, отримаємо те ж рівняння гіперплощини, але всі компоненти вектора a будуть невід’ємні і в сумі дорівнюватимуть 1. інакше кажучи, його можна буде взяти за ймовірнісний розподіл параметра Ω. З означення опорної гіперплощини, а’у(d*)=c, a’ y>=c для всіх y є G. із цих співвідношень видно, що y(d*) дає найменше значення a’y серед всіх векторів y є G. Отже, d* -- баєсівське рішення а.

Важливий висновок з означень баєсівської/ допустимої границі –

допустима границя – це підмножина баєсівської границі. /*всі допустимі рішення – є баєсівським.*/

30. Два типи спостережень (експериментів) у задачах прийняття рішень (ЗПР).

Існує два типи спостережень у ЗПР :

1. Експеремент проводиться перед тим як прийняти рішення. Досліджуються параметри середовища(параметри що впливають на дії).

y = Function(θ,Ω)

y - результат

експеременту для певного параметра.

![]() .

Де Ω - множина параметрів. ξ - похибка

приладу. Сприймайте функцію Function як

функцію-експеремент.

.

Де Ω - множина параметрів. ξ - похибка

приладу. Сприймайте функцію Function як

функцію-експеремент.

2. Експеремент проводиться після приняття рішення. Досліджуються наслідки минулого рішення.

y = Function(c,Ω)

![]() -

наслідок з множини наслідків.

-

наслідок з множини наслідків.

У другому типі експеременту наявна дінаміка, тому що поточне рішення приймається спираючись на результат минулого. Тобто дінамічно.

Загальним

ризиком від спостереження X

і прийняття вирішальної функції

називається сума ризику

називається сума ризику

й середньої ціни спостереження

й середньої ціни спостереження

.

Статистик

повинен вибрати спостереження X

з деякого класу доступних спостереженню

випадкових величин і відповідну

байєсівскую вирішальну функцію

,

яка мінімізує загальний ризик.

Виражаючи загальний ризик у вигляді

суми ризику вирішальної функції

й середньої ціни спостереження, ми

неявно використаємо припущення про

аддитивності корисностей статистика.

.

Статистик

повинен вибрати спостереження X

з деякого класу доступних спостереженню

випадкових величин і відповідну

байєсівскую вирішальну функцію

,

яка мінімізує загальний ризик.

Виражаючи загальний ризик у вигляді

суми ризику вирішальної функції

й середньої ціни спостереження, ми

неявно використаємо припущення про

аддитивності корисностей статистика.

Розглянемо

приклад. Припустимо тепер, що ціна

спостереження випадкової величини X

дорівнює

,

,

.

Статистик може або прийняти рішення,

не спостерігаючи X, або заплатити суму

й спостерігати X перед ухваленням

рішення. При заданому апріорному

розподілі

.

Статистик може або прийняти рішення,

не спостерігаючи X, або заплатити суму

й спостерігати X перед ухваленням

рішення. При заданому апріорному

розподілі

запитується, на яку суму с

варто погоджуватися статистику?

запитується, на яку суму с

варто погоджуватися статистику?

Для

рішення цього завдання треба порівняти

мінімальне значення ризику

без обліку ціни спостереження с,

що може бути отримане на основі

спостереження X,

з мінімальним ризиком

без обліку ціни спостереження с,

що може бути отримане на основі

спостереження X,

з мінімальним ризиком

,

що відповідає байєсівскому рішенню при

відсутності спостережень. Функція

,

що відповідає байєсівскому рішенню при

відсутності спостережень. Функція

вже знайдена. Функція

вже знайдена. Функція

має вигляд

має вигляд

(2)

(2)

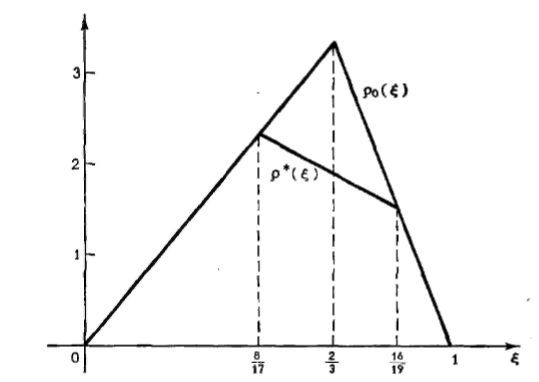

Графіки

функцій

і

зображені на мал. 8.7. Із цього малюнка

видно, що

,

якщо

,

якщо

або

або

.

Отже, при значенні апріорної ймовірності

,

що лежить в одному із цих інтервалів,

статистик може досягти й без спостереження

X

того ж значення ризику, що й при

спостереженні X

.

Отже, при значенні апріорної ймовірності

,

що лежить в одному із цих інтервалів,

статистик може досягти й без спостереження

X

того ж значення ризику, що й при

спостереженні X

Рис. 8.7. Ризики та із приклада 1.

Якщо

ж

,

то

,

то

за можливість спостереження величини

X

перед ухваленням рішення статистику

треба погоджуватися на будь-яку ціну

,

таку, що

за можливість спостереження величини

X

перед ухваленням рішення статистику

треба погоджуватися на будь-яку ціну

,

таку, що

,

Різницю між ризиками

,

Різницю між ризиками

максимальна для

максимальна для

,

де вона дорівнює

,

де вона дорівнює

.

.

У

багатьох статистичних задачах рішення

спостереження випадкової величини X

пов'язане з певними витратами, які

повинні враховуватися статистиком при

розрахунку ризику від прийняття

вирішальної функції, що використає

результати спостереження X.

Ця обставина грає особливо важливу роль

у випадку, коли статистику треба вирішити,

яку з декількох випадкових величин

краще спостерігати, або вирішити, чи

робити спостереження взагалі. Нехай

позначає ціну спостереження значення

х

величини X,

якщо

позначає ціну спостереження значення

х

величини X,

якщо

. Тоді, якщо

є о. в. п. випадкової величини W,

то середня ціна спостереження дорівнює

. Тоді, якщо

є о. в. п. випадкової величини W,

то середня ціна спостереження дорівнює

31.

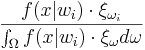

32. Побудова байєсівських вирішуючих функцій нормальним методом.

Апріорний розподіл - розподіл на Ω, який відомо до експерименту.

Апостеріорний розподіл - умовний розподіл на Ω за умови, що ми спостерігали .

Апостеріорний розподіл дає нам додаткову інформацію про параметр і може зменшити байєсівський ризик.

Формула Байєса для обчислення апостеріорного розподілу

ξω(X)=

-ймовірність настання параметра ω, якщо спостерігали .