- •11. Многомерные методы экспериментальной оптимизации.

- •12. Симплекс-метод экспериментальной оптимизации. Последовательный симплексный метод Этот метод требует проведения минимально возможного числа опытов при определении направления движения.

- •13. Метод Бокса-Уилсона.

- •14. Анализ главных компонент. Вычислительная процедура.

- •15. Анализ главных компонент. Геометрическая интерпретация.

- •16. Модель и основная теорема факторного анализа.

- •17. Основные этапы факторного анализа

- •18. Меры близости и различия в кластерном анализе. Функции расстояния и сходства Неотрицательная вещественная функция называется функцией расстояния (метрикой), если:

- •19. Метод k-средних в кластерном анализе.

- •20. Иерархический кластерный анализ. Проблема индексации.

- •21. Графическое представление результатов кластерного анализа.

- •22. Многомерное шкалирование. Метрический и неметрический подходы.

- •23. Многомерное шкалирование. Теорема Янга-Хаусхолдера. Метрическое шкалирование в метрическом шкалировании укажем два метода: ординация Орлочи и метод главных проекций Торгерсона.

- •24. Ортогональные методы многомерного шкалирования.

- •25. Неметрическое шкалирование. Схема алгоритма Каскала.

- •26. Критерии качества шкалирования.

15. Анализ главных компонент. Геометрическая интерпретация.

Геометрическая

интерпретация главных компонент.Дляn-мерного

вектора![]() с ковариационной матрицейСможно построить так называемый эллипсоид

рассеяния:

с ковариационной матрицейСможно построить так называемый эллипсоид

рассеяния:![]() ,

,

где

![]() – вектор средних значений элементов

– вектор средних значений элементов![]() .

.

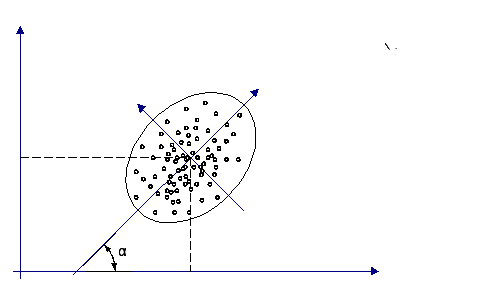

Точки, соответствующие наблюдениям вектора а, будут располагаться примерно в очертаниях этого эллипсоида. На рис. 11 приведена двумерная иллюстрация эллипсоида рассеяния.

В методе главных

компонент исходные наблюдения

предполагаются центрированными. Переход

к центрированным наблюдениям означает

перенос начала координат в точку

![]() .

Затем оси координат поворачивают на

угол

.

Затем оси координат поворачивают на

угол![]() так, чтобы ось

так, чтобы ось![]() шла вдольглавной оси эллипсоида

рассеяния. Наблюдения в новых координатах

шла вдольглавной оси эллипсоида

рассеяния. Наблюдения в новых координатах![]() и

и![]() станут независимыми.

станут независимыми.

Рис.11. Двумерный эллипсоид рассеяния

Чем теснее наблюдения

группируются около главной оси эллипсоида

рассеяния, являющейся теперь новой

координатой

![]() ,

тем менее значащим является для

исследователя разброс точек в направлении

оси

,

тем менее значащим является для

исследователя разброс точек в направлении

оси![]() ,

а следовательно, и сама эта координата

(рис.12).

,

а следовательно, и сама эта координата

(рис.12).

Рис.12. «Вытянутый» эллипсоид рассеяния

16. Модель и основная теорема факторного анализа.

В отличие от метода

главных компонент факторный анализ

заранее объясняет ковариационную (либо

корреляционную) матрицу исходных

переменных (признаков) наличием небольшого

числа гипотетических факторов,

присутствующих в исходных переменных.

На языке корреляций это можно

интерпретировать следующим образом.

Вначале анализируется на значимость

исходная корреляционная матрица, т.е.

отличается ли корреляционная матрица

значимо от единичной. Если это имеет

место, то возникает вопрос: существует

ли скрытая, иначе латентная, случайная

величина

![]() такая, что попарные корреляции между

исходными переменными станут равными

нулю, если влияние

такая, что попарные корреляции между

исходными переменными станут равными

нулю, если влияние![]() уже учтено? Пусть после этого элементы

корреляционной матрицы все еще отличны

от нуля. Тогда пытаются найти две

случайные величины

уже учтено? Пусть после этого элементы

корреляционной матрицы все еще отличны

от нуля. Тогда пытаются найти две

случайные величины![]() и

и![]() такие, что корреляции между исходными

переменными станут нулевыми, если

влияние

такие, что корреляции между исходными

переменными станут нулевыми, если

влияние![]() и

и![]() уже учтено, и так далее.

уже учтено, и так далее.

Тем самым корреляция

между nнаблюдаемыми признаками![]() связывается с тем фактом, что эти признаки

зависят от меньшего числа других,

непосредственно неизмеряемых переменных

связывается с тем фактом, что эти признаки

зависят от меньшего числа других,

непосредственно неизмеряемых переменных![]() ,

которые принято называть общими

факторами.

,

которые принято называть общими

факторами.

Модель

факторного анализаВ общем случае

нельзя гарантировать, что каждый из

исходных признаков зависит лишь отmобщих факторов, одних и тех же для всех

признаков. Поэтому в факторном анализе

постулируется, что наблюдаемый признакxi

(i=1,2,…,n)

зависит также и от некоторой

характерной для себя остаточной (шумовой)

случайной компоненты![]() .

Итак, линейная модель факторного анализа

имеет вид:

.

Итак, линейная модель факторного анализа

имеет вид:

![]() ,

(11.1)

,

(11.1)

где

коэффициенты

![]() называютнагрузкойj-го

общего фактора наi-й

исходный признак, а матрицу

называютнагрузкойj-го

общего фактора наi-й

исходный признак, а матрицу![]() ,i=1,2,…,n;j=1,2,..,m–факторным

отображением, либо матрицей

факторных нагрузок.

,i=1,2,…,n;j=1,2,..,m–факторным

отображением, либо матрицей

факторных нагрузок.

Предпосылки

факторного анализа. Предполагают,

что исходные признаки подчиняются

многомерному нормальному распределению;

общие факторы некоррелированы, а их

дисперсии равны единице, следовательно,

корреляционная матрица![]() общих факторов является единичной, т.е.

общих факторов является единичной, т.е.![]() ;

характерные (остаточные) факторы

;

характерные (остаточные) факторы![]() – нормально распределенные случайные

величины, не зависимые друг от друга и

от общих факторов. Это означает, что

корреляционная матрицаVхарактерных факторов имеет диагональный

вид. Все случайные величины имеют нулевое

математическое ожидание.

– нормально распределенные случайные

величины, не зависимые друг от друга и

от общих факторов. Это означает, что

корреляционная матрицаVхарактерных факторов имеет диагональный

вид. Все случайные величины имеют нулевое

математическое ожидание.

Факторные нагрузки

![]() и дисперсии

и дисперсии![]() характерных факторов являются неизвестными

параметрами, подлежащими оценке.

характерных факторов являются неизвестными

параметрами, подлежащими оценке.

Вводя векторные

обозначения:

![]() ,

,

перепишем

модель факторного анализа (11.1) в виде:

![]() .

(11.1а)

.

(11.1а)

Ковариационная

матрица

![]() исходных признаков с учетом их

центрированности по определению естьCx

= M[xx/],

исходных признаков с учетом их

центрированности по определению естьCx

= M[xx/],

где математическое ожидание берется по множеству реализаций вектора x.

Подставим

в

![]() выражение (11.1а):Cx

= M[(Ay+u)(Ay+u)′]

= M[(Ay+u)(y′A′+u′)].

выражение (11.1а):Cx

= M[(Ay+u)(Ay+u)′]

= M[(Ay+u)(y′A′+u′)].

Раскрывая скобки в последнем выражении и учитывая, что общие и характерные факторы некоррелированы и, следовательно, M[u′y]=0, M[yu′]=0, а также неслучайный характер матрицыA, что позволяет выноситьАза знакМ, получаемCx = AM[yy′]A′+M[uu′].

M[yy′]

есть не что иное, как ковариационная

матрица![]() общих факторов, аM[uu′]

ковариационная матрицаVхарактерных факторов. Таким образом,

общих факторов, аM[uu′]

ковариационная матрицаVхарактерных факторов. Таким образом,![]() .

(11.2)

.

(11.2)

Согласно предпосылкам

факторного анализа

![]() есть единичная диагональная матрица.

Следовательно,

есть единичная диагональная матрица.

Следовательно,

![]() .

(11.2а)

.

(11.2а)

Соотношение (11.2) либо (11.2а) иногда называют фундаментальной теоремой факторного анализа. Она утверждает, что ковариационная матрица исходных признаков может быть воспроизведена с помощью матрицы факторных нагрузок и дисперсионной матрицы характерных факторов.

На практике обычно

используют не ковариационную

![]() ,

а корреляционную матрицуR

исходных признаков. Переход от

ковариационной к корреляционной матрице

означает, что исходные центрированные

переменные подвергаются нормированию

делением значений каждого признака на

среднее квадратическое отклонение

этого признака. Такое преобразование

позволяет избежать влияния масштаба

измерения на результаты анализа.

Преобразованные признаки будут иметь,

очевидно, единичную дисперсию, их

ковариационная матрица совпадает с

корреляционной, а соотношение (11.2) примет

вид:

,

а корреляционную матрицуR

исходных признаков. Переход от

ковариационной к корреляционной матрице

означает, что исходные центрированные

переменные подвергаются нормированию

делением значений каждого признака на

среднее квадратическое отклонение

этого признака. Такое преобразование

позволяет избежать влияния масштаба

измерения на результаты анализа.

Преобразованные признаки будут иметь,

очевидно, единичную дисперсию, их

ковариационная матрица совпадает с

корреляционной, а соотношение (11.2) примет

вид:![]() ,

(11.3)

,

(11.3)

где ВиWимеют тот же смысл, чтоAиV, но для нормированных признаков.

Для диагональных

элементов матрицы Rвыполняется соотношение:![]() ,

,

где

![]() – диагональные элементы матрицыW.

– диагональные элементы матрицыW.

Сумму квадратов

нагрузок общих факторов называют

общностью:![]() .

(11.4)

.

(11.4)

Общность указывает

ту долю единичной дисперсии исходного

признака, которую можно приписать общим

факторам. Часть единичной дисперсии,

которая не связана с общими факторами,

называют характерностью![]() :

:![]() .

(11.5)

.

(11.5)

Характерность

иногда разбивают на две составляющих,

одна из которых,

![]() ,

называется специфичностью, а другая,

,

называется специфичностью, а другая,![]() ,

является дисперсией, обусловленной

ошибкой, т.е.

,

является дисперсией, обусловленной

ошибкой, т.е.![]() .

.

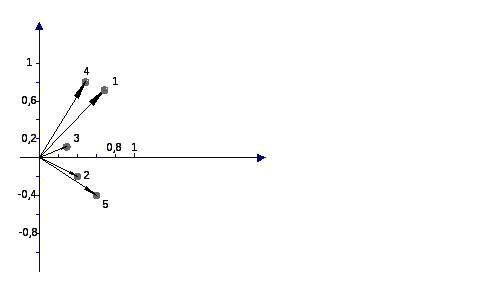

Факторное изображение

допускает геометрическую интерпретацию.

Согласно (11.1) точка в n-мерном

пространстве исходных признаков

представляется в виде линейной комбинацииm+nкоординат точки в пространстве общих

и характерных факторов, называемом

также полным факторным пространством.

Так как нагрузки общих факторов однозначно

определяют дисперсии характерных

факторов, то достаточно представлять

признаки вm-мерном

ортогональном пространстве общих

факторов. Поскольку пространство общих

факторов имеет размерность наnменьшую размерности полного факторного

пространства, в факторном анализе

используют обычно пространство общих

факторов. Строки матрицыВфакторных нагрузок рассматривают как

точки в пространстве общих факторов.

Координатыi-й

точки есть![]() .

Соединяя эти точки с началом координат,

получаемnвекторов-признаков. Длина вектора,

отвечающегоi-му

признаку, равняется, как видно из (11.4),

корню квадратному из общности.

.

Соединяя эти точки с началом координат,

получаемnвекторов-признаков. Длина вектора,

отвечающегоi-му

признаку, равняется, как видно из (11.4),

корню квадратному из общности.

На рис. 13 в качестве примера приведена графическая иллюстрация факторного отображения.

Рис.13. Графическая иллюстрация факторного отображения

Числа 1,2,…,5 около точек соответствуют номерам строк матрицы В, иначе номерам исходных признаков.