- •15. Основные понятия методов нелинейного программирования.

- •16.Что положено в основу градиентных методов.

- •Понятие градиента

- •17. Сущность безградиентного метода поиска целевой функции.

- •18. Условие критерия окончания поиска оптимума целевой функции.

- •20. Метод сканирования и его достоинства.

- •21. Особенности и назначение метода случайного поиска в определении оптимума целевой функции.

- •22. Отличие градиентных и безградиентных методов и их особенности.

- •23. Сущность метода дихотомии.

- •24. Сущность метода итерации.

- •25. Блок – схема метода итерации.

- •27. Блок – схема метода Ньютона.

17. Сущность безградиентного метода поиска целевой функции.

Безградиентные методы решения задач оптимизации

При использовании градиентных методов для определения величины и направления шага поиска требовался предварительный анализ произ водных оптимизируемой функции по всем независимым переменным. Для сложной целевой функции это связано с выполнением большого объема вычислений, особенно при большом числе переменных.

Безградиентные методы основаны на использовании в процессе поиска информации, получаемой от сравнительной оценки значений целевой функции в результате выполнения очередного шага.

С использованием безградиентных методов может быть реализован как одномерный поиск (для случая, когда целевая функция зависит от одной независимой переменной), так и многомерный поиск. При одномерном поиске используются следующие методы: одномерного сканирования, локализации экстремума функции, "золотого сечения" и др. Методы многомерного поиска - покоординатного спуска, многомерного сканирования, Хука-Дживса, симплексный - могут использовать методы одномерного поиска как вспомогательные.

Вначале рассмотрим методы одномерного поиска. Для всех методов постановка задачи следующая - определить положение экстремума на интервале [Umin,Umin].

18. Условие критерия окончания поиска оптимума целевой функции.

Критерием окончания поиска оптимума является достижение такой точки, при движении из которой по любому осевому направлению дальнейшего убывания функции не происходит. На практике, в качестве признака оптимума часто применяется условие: (5.40)

![]()

Условие(5.40) может быть использовано в том случае, когда оптимум лежит внутри допустимой области изменения независимых переменных. Если же оптимум попадает на границу области допустимого изменения переменных V, то критерий (5.40) не пригоден и вместо него следует применять условие положительности всех производных по допустимым осевым направлениям. При этом допустимым осевым будет направление внутри области V .

Алгоритм спуска для выбранного осевого направления может быть записан в виде : (5.41)

![]()

Причем :

Ukj - значение изменяемой переменной на к-ом шаге спуска *

hk - величина к-го шага , которая может изменять свое значение в зависимости от номера шага*

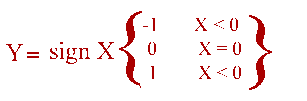

sign - функция знака ("сигнум ")

UP - вектор точки, в которой последний раз производилось вычисление производных целевой функции.