- •Учебно-методические материалы к изучению дисциплины «Эконометрика»

- •Введение

- •1 Эконометрика и математическая статистика

- •Особенности статистических данных. Источники информации

- •1.2. Выборочная ковариация и выборочная дисперсия

- •Потребительские расходы на бензин и его реальная цена в условных единицах

- •Расчет выборочной ковариации

- •1.3 Метод Монте-Карло

- •2. Метод наименьших квадратов

- •2.1. Модель парной регрессии

- •2.2. Регрессия по методу наименьших квадратов

- •2.3. Формулы для коэффициентов регрессии. Обязательные свойства линии регрессии. Недостатки метода наименьших квадратов

- •2.4. Объясненная и необъясненная дисперсия зависимой переменной. Коэффициент r2, его связь с коэффициентом корреляции

- •Расчетная таблица

- •3 Свойства коэффициентов регрессии

- •3.1 Теорема Гаусса - Маркова. Смысл условий теоремы

- •Расчеты значений y

- •Результаты оценки значений a и b

- •Результаты расчетов значений y

- •Результаты оценки значений a и b

- •3.2. Стандартные отклонения и стандартные ошибки коэффициентов регрессии

- •Результаты расчетов стандартных ошибок

- •Результаты расчетов

- •4. Проверка гипотез

- •4.1. Выбор нулевой и альтернативной гипотезы

- •4.2. Уровень значимости

- •4.3 Ошибки I и II рода, степени свободы критическое значение, доверительный интервал. Т-тест для коэффициентов регрессии

- •4. 4. Односторонние и двусторонние тесты

- •4.7. Связь между тестами

- •5. Нелинейная регрессия. Простейшие модели

- •5.1. Нелинейность по переменным и нелинейность по параметрам

- •Соотношение между ежегодным потреблением бананов и годовым доходом

- •5.2. Логарифмирование

- •5.3. Эластичность и ее моделирование

- •5.4 Случайный член как множитель

- •5.5. Тест Бокса – Кокса (решетчатый поиск). Подбор функции методом Зарембки

- •Регрессии расходов на питание и жилье

- •Результаты оценивания регрессий для расходов

- •Алгоритмы вычисления эконометрических показателей

- •Список рекомендуемых литературных источников

3 Свойства коэффициентов регрессии

3.1 Теорема Гаусса - Маркова. Смысл условий теоремы

Коэффициент регрессии, вычисленный методом наименьших квадратов, — это особая форма случайной величины, свойства которой зависят от свойств остаточного члена в уравнении. Мы продемонстрируем это сначала теоретически, а затем посредством контролируемого эксперимента. В частности, мы увидим, какое значение, для оценки коэффициентов регрессии имеют некоторые конкретные предположения, касающиеся остаточного члена.

В ходе рассмотрения мы постоянно будем иметь дело с моделью парной регрессии, в которой связан с следующей зависимостью:

![]() ,

(3.1)

,

(3.1)

и на основе выборочных наблюдений будем оценивать уравнение регрессии.

![]() .

(3.2)

.

(3.2)

Мы также будем предполагать, что - это неслучайная экзогенная переменная. Иными словами, ее значения во всех наблюдениях можно считать заранее заданными и никак не связанными с исследуемой зависимостью.

Во-первых,

заметим, что величина

состоит из двух составляющих. Она

включает неслучайную составляющую

![]() ,

которая не имеет ничего общего с законами

вероятности

,

которая не имеет ничего общего с законами

вероятности

![]() и

и

![]() могут быть неизвестными, но тем не менее

это постоянные величины), и случайную

составляющую

могут быть неизвестными, но тем не менее

это постоянные величины), и случайную

составляющую

![]() .

.

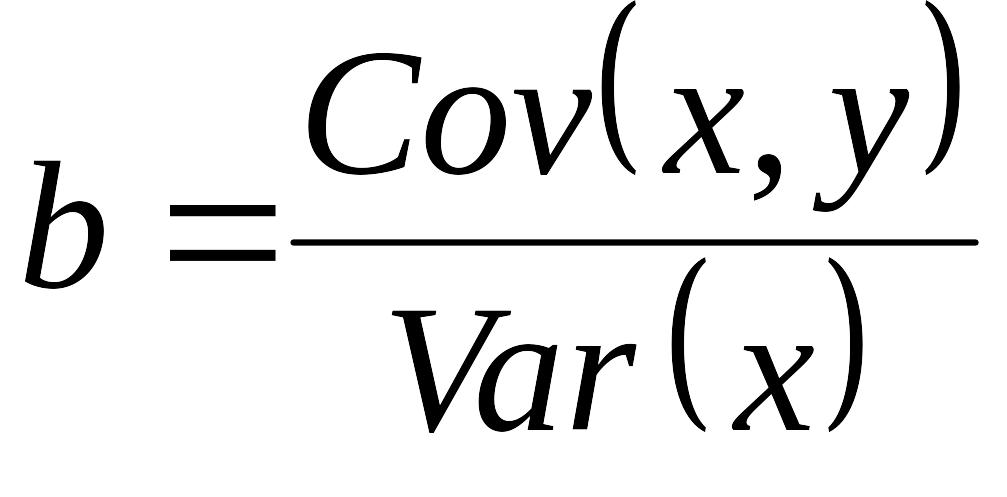

Отсюда следует, что, когда мы вычисляем b по обычной формуле:

,

(3.3)

,

(3.3)

также

содержит случайную составляющую.

![]() зависит от значений

,

а

зависит от значений

.

зависит от значений

,

а

зависит от значений

.

Если

случайная составляющая принимает разные

значения в

![]() наблюдениях, то мы получаем различные

значения

и, следовательно, разные величины

и

.

наблюдениях, то мы получаем различные

значения

и, следовательно, разные величины

и

.

Теоретически мы можем разложить на случайную и неслучайную составляющие. Воспользовавшись соотношением (3.1), а также правилом расчета ковариации, получим:

![]() .

(3.4)

.

(3.4)

По

ковариационному правилу 3, ковариация

![]() равна нулю. По ковариационному правилу

2, ковариация

равна нулю. По ковариационному правилу

2, ковариация

![]() равна

равна

![]() .

Причем величина

.

Причем величина

![]() это то же, что и

это то же, что и

![]() .

Следовательно, мы можем записать:

.

Следовательно, мы можем записать:

![]() ,

(3.5)

,

(3.5)

и, таким образом,

.

(3.6)

.

(3.6)

Итак,

мы показали, что коэффициент регрессии

,

полученный по любой выборке, представляется

в виде суммы двух слагаемых: 1) постоянной

величины, равной истинному значению

коэффициента

;

2) случайной составляющей, зависящей от

![]() ,

которой обусловлены отклонения

коэффициента

от константы

.

Аналогичным образом можно показать,

что

имеет постоянную составляющую, равную

истинному значению

,

плюс случайную составляющую, которая

зависит от случайного фактора

.

,

которой обусловлены отклонения

коэффициента

от константы

.

Аналогичным образом можно показать,

что

имеет постоянную составляющую, равную

истинному значению

,

плюс случайную составляющую, которая

зависит от случайного фактора

.

Следует заметить, что на практике мы не можем разложить коэффициенты регрессия на составляющие, так как не знаем истинных значений и и фактических значений в выборке. Они интересуют нас потому, что при определенных предположениях позволяют получить некоторую информацию о теоретических свойствах и .

В главе 1.3 мы уже познакомились с сутью метода Монте-Карло и с основными особенностями использования эксперимента по методу Монте-Карло в математической статистике. Рассмотрим подробней, как, используя этот метод, проверить качество полученных коэффициентов регрессии.

Простейший возможный эксперимент состоит из трех частей. Во-первых:

1) выбираются истинные значения и ;

2) в каждом наблюдении выбирается значение ;

3) используется некоторый процесс генерации случайных чисел (или берется последовательность из таблицы случайных чисел) для получения значений случайного фактора в каждом из наблюдений.

Во-вторых, в каждом наблюдении генерируется значение с использованием соотношения (3.1) и значений , , и .

В-третьих, применяется регрессионный анализ для оценивания параметров и с использованием только полученных указанным образом значений и данных для . При этом вы можете видеть, являются ли и хорошими оценками и , и это позволит почувствовать пригодность метода построения регрессии.

На первых двух шагах проводится подготовка к применению регрессионного метода. Мы полностью контролируем модель, которую создаем, и знаем истинные значения параметров, потому что сами их определили. На третьем этапе мы определяем, может ли поставленная нами задача решаться с помощью метода регрессии, т. е. могут ли быть получены хорошие оценки для и при использовании только данных об и . Заметим, что проблема возникает вследствие включения случайного фактора в процесс получения . Если бы этот фактор отсутствовал, то точки, соответствующие значениям каждого наблюдения, лежали бы точно на прямой (3.1) и точные значения и можно было бы очень просто определить по значениям и .

Произвольно

положим

![]() и

и

![]() ,

так что истинная зависимость имеет вид:

,

так что истинная зависимость имеет вид:

![]() .

(3.7)

.

(3.7)

Предположим

для простоты, что имеется 20 наблюдений

и что

принимает значения от 1 до 20. Для случайной

остаточной составляющей и будем

использовать случайные числа, взятые

из нормально распределенной совокупности

с нулевым средним и единичной дисперсией.

Нам потребуется набор из 20 значений,

обозначим их

![]() ,

…,

,

…,

![]() .

Случайный член

.

Случайный член

![]() в первом наблюдении просто равен

,

и т. д.

в первом наблюдении просто равен

,

и т. д.

Зная значения и в каждом наблюдении, можно вычислить значения , используя уравнение (3.7); это сделано в табл. 3.1. Теперь при оценивании регрессионной зависимости от получим:

![]() .

(3.8)

.

(3.8)

В данном случае оценка приняла меньшее значение (1,63) по сравнению с (2,00), a немного выше (0,54 по сравнению с 0,50). Расхождения вызваны совместным влиянием случайных членов в 20 наблюдениях.

Очевидно, что одного эксперимента такого типа едва ли достаточно для оценки качества метода регрессии. Он дал довольно хорошие результаты, но, возможно, это лишь счастливый случай. Для дальнейшей проверки повторим эксперимент с тем же истинным уравнением (3.7) и с теми же значениями , но с новым набором случайных чисел для остаточного члена, взятых из того же распределения (нулевое среднее и единичная дисперсия). Используя эти значения и значения , получим новый набор значений .

В целях экономии места таблица с новыми значениями и не приводится. Вот результат оценивания регрессии между новыми значениями и :

![]() (3.9)

(3.9)

Таблица 3.1