- •Глава 1

- •1.2. Процедурные языки

- •1.3. Языки, ориентированные на данные

- •1.4. Объектно-ориентированные языки

- •1.5. Непроцедурные языки

- •1.6. Стандартизация

- •1.7. Архитектура компьютера

- •1.8. Вычислимость

- •1.9. Упражнения

- •Глава 2

- •2.2. Семантика

- •2.3. Данные

- •2.4. Оператор присваивания

- •2.5. Контроль соответствия типов

- •2.7. Подпрограммы

- •2.8. Модули

- •2.9. Упражнения

- •Глава 3

- •3.1. Редактор

- •3.2. Компилятор

- •3.3. Библиотекарь

- •3.4. Компоновщик

- •3.5. Загрузчик

- •3.6. Отладчик

- •3.7. Профилировщик

- •3.8. Средства тестирования

- •3.9. Средства конфигурирования

- •3.10. Интерпретаторы

- •3.11. Упражнения

- •Глава 4

- •4.1. Целочисленные типы

- •I: Integer; -- Целое со знаком в языке Ada

- •4.2. Типы перечисления

- •4.3. Символьный тип

- •4.4. Булев тип

- •4.5. Подтипы

- •4.6. Производные типы

- •4.7. Выражения

- •4.8. Операторы присваивания

- •4.9. Упражнения

- •Глава 5

- •5.1. Записи

- •5.2. Массивы

- •5.3. Массивы и контроль соответствия типов

- •Подтипы массивов в языке Ada

- •5.5. Строковый тип

- •5.6. Многомерные массивы

- •5.7. Реализация массивов

- •5.8. Спецификация представления

- •5.9. Упражнения

- •Глава 6

- •6.1. Операторы switch и case

- •6.2. Условные операторы

- •6.3. Операторы цикла

- •6.4. Цикл for

- •6.5. «Часовые»

- •6.6. Инварианты

- •6.7. Операторы goto

- •6.8. Упражнения

- •Глава 7

- •7.1. Подпрограммы: процедуры и функции

- •7.2. Параметры

- •7.3. Передача параметров подпрограмме

- •7.4. Блочная структура

- •7.5. Рекурсия

- •7.6. Стековая архитектура

- •7.7. Еще о стековой архитектуре

- •7.8. Реализация на процессоре Intel 8086

- •7.9. Упражнения

- •Глава 8

- •8.1 . Указательные типы

- •8.2. Структуры данных

- •8.3. Распределение памяти

- •8.4. Алгоритмы распределения динамической памяти

- •8.5. Упражнения

- •Глава 9

- •9.1. Представление вещественных чисел

- •9.2. Языковая поддержка вещественных чисел

- •9.3. Три смертных греха

- •Вещественные типы в языке Ada

- •9.5. Упражнения

- •Глава 10

- •10.1. Преобразование типов

- •10.2. Перегрузка

- •10.3. Родовые (настраиваемые) сегменты

- •10.4. Вариантные записи

- •10.5. Динамическая диспетчеризация

- •10.6. Упражнения

- •Глава 11

- •11.1. Требования обработки исключительных ситуаций

- •11.2. Исключения в pl/I

- •11.3. Исключения в Ada

- •11.5. Обработка ошибок в языке Eiffei

- •11.6. Упражнения

- •Глава 12

- •12.1. Что такое параллелизм?

- •12.2. Общая память

- •12.3. Проблема взаимных исключений

- •12.4. Мониторы и защищенные переменные

- •12.5. Передача сообщений

- •12.6. Язык параллельного программирования оссаm

- •12.7. Рандеву в языке Ada

- •12.9. Упражнения

- •Глава 13

- •13.1. Раздельная компиляция

- •13.2. Почему необходимы модули?

- •13.3. Пакеты в языке Ada

- •13.4. Абстрактные типы данных в языке Ada

- •13.6. Упражнения

- •Глава 14

- •14.1. Объектно-ориентированное проектирование

- •В каждом объекте должно скрываться одно важное проектное решение.

- •14.3. Наследование

- •14.5. Объектно-ориентированное программирование на языке Ada 95

- •Динамический полиморфизм в языке Ada 95 имеет место, когда фактический параметр относится к cw-типу, а формальный параметр относится к конкретному типу.

- •14.6. Упражнения

- •Глава 15

- •1. Структурированные классы.

- •15.1. Структурированные классы

- •5.2. Доступ к приватным компонентам

- •15.3. Данные класса

- •15.4. Язык программирования Eiffel

- •Если свойство унаследовано от класса предка более чем одним путем, оно используется совместно; в противном случае свойства реплицируются.

- •15.5. Проектные соображения

- •15.6. Методы динамического полиморфизма

- •15.7. Упражнения

- •5Непроцедурные

- •Глава 16

- •16.1. Почему именно функциональное программирование?

- •16.2. Функции

- •16.3. Составные типы

- •16.4. Функции более высокого порядка

- •16.5. Ленивые и жадные вычисления

- •16.6. Исключения

- •16.7. Среда

- •16.8. Упражнения

- •Глава 17

- •17.2. Унификация

- •17.4. Более сложные понятия логического программирования

- •17.5. Упражнения

- •Глава 18

- •18.1. Модель Java

- •18.2. Язык Java

- •18.3. Семантика ссылки

- •18.4. Полиморфные структуры данных

- •18.5. Инкапсуляция

- •18.6. Параллелизм

- •18.7. Библиотеки Java

- •8.8. Упражнения

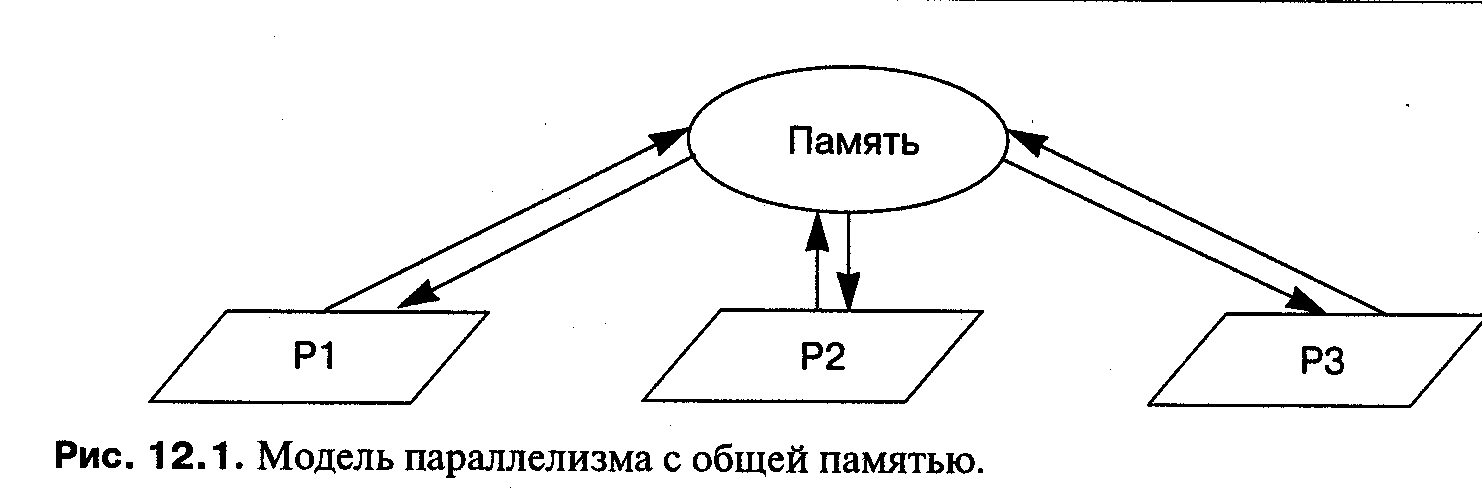

12.2. Общая память

Самая простая модель параллельного программирования — это модель с общей памятью (см. рис. 12.1). Два или несколько процессов могут обращаться к одной и той же области памяти, хотя они также могут иметь свою собственную частную, или приватную, (private) память. Предположим, что у нас есть два процесса, которые пытаются изменить одну и ту же переменную в общей памяти:

procedure Main is

N: Integer := 0;

task T1;

task T2;

task body T1 is

begin

for I in 1 ..100 loop N := N+1; end loop;

end T1;

task body T2 is

begin

for I in 1 ..100 loop N := N+1; end loop;

end T2;

begin

null;

end Main;

Рассмотрим теперь реализацию оператора присваивания:

load R1,N Загрузить из памяти

add R1,#1 Увеличить содержимое регистра

store R1,N Сохранить в памяти

Если каждое выполнение тела цикла в Т1 завершается до того, как Т2 выполняет свое тело цикла, N будет увеличено 200 раз. Однако каждая задача может быть выполнена на отдельном компьютере со своим набором регистров. В этом случае может иметь место следующая последовательность событий:

• Т1 загружает N в свой регистр R1 (значение равно и).

• Т2 загружает N в свой регистр R1 (значение равно «).

• Т1 увеличивает R1 (значение равно п + 1).

• Т2 увеличивает R1 (значение равно и + 1).

• Т1 сохраняет содержимое своего регистра R1 в N (значение равно п + 1).

• Т2 сохраняет содержимое своего регистра R1 в N (значение равно п + 1).

Результат выполнения каждого из двух тел циклов состоит только в том, что N увеличится на единицу. Результирующее значение N может лежать между 100 и 200 в зависимости от относительной скорости каждого из двух процессоров.

Важно понять, что это может произойти даже на компьютере, который реализует многозадачный режим путем использования единственного ЦП. Когда ЦП переключается с одного процесса на другой, регистры, которые используются заблокированным процессом, сохраняются, а затем восстанавливаются, когда этот процесс продолжается.

В теории параллелизма выполнение параллельной программы определяется как любое чередование атомарных команд задач. Атомарная команда — это всего лишь команда, которую нельзя выполнить «частично» или прервать, чтобы продолжить выполнение другой задачи. В модели параллелизма с общей памятью команды загрузки и сохранения являются атомарными.

Если говорить о чередующихся вычислениях, то языки и системы, которые поддерживают параллелизм, различаются уровнем определенных в них атомарных команд. Реализация команды должна гарантировать, что она выполняется атомарно. В случае команд загрузки и сохранения это обеспечивается аппаратным интерфейсом памяти. Атомарность команд высокого уровня реализуется с помощью базисной системы поддержки времени выполнения и поддерживается специальными командами ЦП.