- •19. Экспертные системы. База знаний, механизм вывода, механизмы приобретения и объяснения знаний.

- •20. Экспертные системы. Примеры практических экспертных систем.

- •21. Экспертные системы. Формализация этапов экспертной деятельности.

- •22. Экспертные системы. Инженерия знаний.

- •23. Экспертные системы. Организация базы знаний. Продукционная модель для представления знаний.

- •24. Экспертные системы. Семантические сети для представления знаний.

- •25. Экспертные системы. Жизненный цикл экспертной системы

- •Формализация.

- •Реализация

- •Тестирование

- •26. Нейронные сети. Понятие нейронной сети

- •27. Нейронные сети как тип моделей ии. Применение нс

- •28. Нейронные сети. Структура и функции нейрона.

- •29. Нейронные сети. Модель искусственного нейрона.

- •30 Нейронные сети. Элементная база нейрокомпьютеров- аналоговая, цифровая, гибридная. Стандартные процессоры обработки сигналов.

- •31 Нейронные сети. Преимущества и недостатки различных типов элементной базы аппаратных нейрокомпьютеров.

- •32 Нейронные сети. Нейро-эмуляторы, их преимущества и недостатки.

- •33 Нейронные сети. Секторы рынка нейросетевых программных продуктов: нейро-пакеты и готовые решения на основе нейросетей.

- •34 Нейронные сети. Инструменты разработки нейроприложений.

- •35 Нейронные сети. Классификация базовых нейроархитектур по типу связей и типу обучения

- •36. Нейронные сети. Методы обучения нс. Машинное обучение

- •37. Нейронные сети. Обучение с учителем. Эффекты обобщения и переобучения

- •38. Нейронные сети. Персептроны: архитектура, возможности и решаемые задачи.

- •39. Нейронные сети. Однонаправленные многослойные нейронные сети

- •48 Генетический алгоритм. Мутация, ее роль в алгоритме. Механизмы реализации процесса мутации.

- •49 Генетический алгоритм. Методы скрещивания, применяемые в генетических алгоритмах и их эффективность.

- •50 Генетический алгоритм. Способы реализации отбора и их эффективность.

- •51 Генетический алгоритм. Метод штрафных функций.

37. Нейронные сети. Обучение с учителем. Эффекты обобщения и переобучения

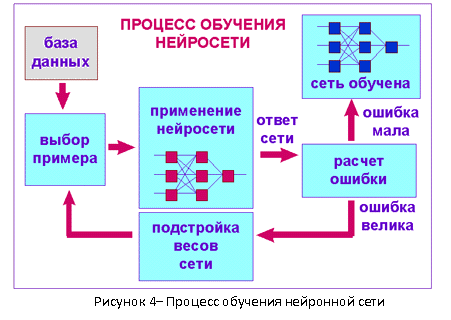

Самым важным свойством нейронных сетей является их способность обучаться на основе данных окружающей среды и в результате обучения повышать свою производительность. Повышение производительности происходит со временем в соответствии с определенными правилами. Обучение нейронной сети происходит посредством интерактивного процесса корректировки синаптических весов и порогов. В идеальном случае нейронная сеть получает знания об окружающей среде на каждой итерации процесса обучения.

С понятием обучения ассоциируется довольно много видов деятельности. С позиций нейронной сети, вероятно, можно использовать следующее определение:

Обучение – это процесс, в котором свободные параметры нейронной сети настраиваются посредством моделирования среды, в которую эта сеть встроена. Тип обучения определяется способом подстройки этих параметров.

Это определение процесса обучения нейронной сети предполагает следующую последовательность событий:

• В нейронную сеть поступают стимулы из внешней среды.

• В результате первого пункта изменяются свободные параметры нейронной сети.

• После изменения внутренней структуры нейронная сеть отвечает на возбуждения уже иным образом.

Вышеуказанный список четких правил решения проблемы обучения нейронной сети называется алгоритмом обучения. Несложно догадаться, что не существует универсального алгоритма обучения, подходящего для всех архитектур нейронных сетей. Существует лишь набор средств, представленный множеством алгоритмов обучения, каждый из которых имеет свои достоинства. Алгоритмы обучения отличаются друг от друга способом настройки синаптических весов нейронов. Еще одной отличительной характеристикой является способ связи обучаемой нейронной сети с внешним миром. В этом контексте говорят о парадигме обучения, связанной с моделью окружающей среды, в которой функционирует данная нейронная сеть.

Существуют два концептуальных подхода к обучению нейронных сетей: обучение с учителем и обучение без учителя.

• Обучение нейронной сети с учителем предполагает, что для каждого входного вектора из обучающего множества существует требуемое значение выходного вектора, называемого целевым. Эти вектора образуют обучающую пару. Веса сети изменяют до тех пор, пока для каждого входного вектора не будет получен приемлемый уровень отклонения выходного вектора от целевого.

Переобучение (обобщение исходя из переобучения можно рассказать. Ничего отдельно по эф.обобщения не нашла)

Суть этой проблемы лучше всего объяснить на конкретном примере. Пусть обучающие примеры порождаются некоторой функцией, которую нам и хотелось бы воспроизвести. В теории обучения такую функцию называют учителем. При конечном числе обучающих примеров всегда возможно построить нейросеть с нулевой ошибкой обучения, т.е. ошибкой, определенной на множестве обучающих примеров. Для этого нужно взять сеть с числом весов большим, чем число примеров. Действительно, чтобы воспроизвести каждый пример у нас имеется P уравнений для W неизвестных. И если число неизвестных меньше числа уравнений, такая система является недоопределенной и допускает бесконечно много решений. В этом-то и состоит основная проблема: у нас не хватает информации, чтобы выбрать единственное правильное решение - функцию-учителя. В итоге выбранная случайным образом функция дает плохие предсказания на новых примерах, отсутствовавших в обучающей выборке, хотя последнюю сеть воспроизвела без ошибок. Вместо того, чтобы обобщить известные примеры, сеть запомнила их. Этот эффект и называется переобучением.