- •Конспект лекцій з курсу « Теорія ймовірності та випадкові процеси» Розділ 1 Вступ. Поняття ймовірності.

- •Коротка історична довідка.

- •Непарні

- •Властивості ймовірності подій

- •2. Основні формули комбінаторики.

- •Статистичне визначення ймовірності подій

- •1. Для лінійного випадку

- •2. Для плоского випадку

- •1.Умовна ймовірність.

- •Л) незалежні події. Теорема множення незалежних подій.

- •Часто ймовірність події ā позначають

- •0) Наслідки із додавання і множення.

- •1)Теорема додавання ймовірностей сумісних подій.

- •Р(в) – ймовірність попадання другого.

- •Розділ 2: послідовності незалежних випробовувань. Формула бернуллі

- •Вивід формули Бернуллі:

- •Б) Локальна теорема Лапласа (без доведення)

- •Розділ 3. Основні поняття математичної статистики. Випадкові величини та їх числові характеристики. А. Поняття випадкової величини. Дискретні та неперервні випадкові величини.

- •В. Приклади: біноміальний закон розподілу. Закон розподілу Пуассона.

- •1) Біноміальний закон.

- •2) Розподіл Пуассона.

- •Г. Інтегральна та диференціальна функції розподілу випадкової величини, їх властивості та функція розподілу (крива розподілу).

- •Математичне сподівання та дисперсія випадкових величин.

- •Математичне сподівання має властивості:

- •Властивості дисперсії.

- •Сталий множник можна виключити

- •Якщо ξ: η- незалежні випадкові величини, то

- •Моменти к-того порядку.

- •Є. Ймовірність попадання випадкової величини в заданий інтервал. Нормальний закон розподілу неперервної випадкової величини

- •Правило трьох „σ”.

- •Ж. Поняття про функції випадкового аргументу і її закон розподілу.

- •Дискретна випадкова величина.

- •Неперервні випадкові величини

- •З. Закон великих чисел. Нерівність Чебишева , теореми Чебишева та Бернулі. Поняття про теорему Ляпунова.

- •Теорема Бернулі.

- •Теорема Ляпунова. (Поняття).

- •Теореми Чебишева, Бернулі. Та теорема Ляпунова складають закон великих чисел.

- •Вибірка з генеральної сукупності. Розподіл вибірки. Вибіркові характеристики. Загальні поняття математичної статистики.

- •Надійний інтервал для математичного сподівання ознаки γ нормальним законом розподілу і відомим середньоквадратичним відхиленням.

- •Приклад.

- •Інтервал надійності для оцінки математичного сподівання з нормальним розподілом випадкової величини та не відомим значенням σ.

- •Довірчий інтервал, інтервал надійності оцінки середньоквадратичного відхилення з нормальним законом розподілу.

- •В) .Поняття про умовні варіанти. Метод добутків для знаходження вибіркових середніх і дисперсії.

- •Дисперсія вибірки , де

- •Складаємо наступну розрахункову таблицю

- •Г)Багатовимірні випадкові величини.

- •Розділ 5. Елементи теорії кореляції. А. Функціональна та статистична залежності.

- •Б) Знаходження кореляційного зв‘язку між випадковими величинами у вигляді рівняння лінії регресії.

- •В. Додавання дисперсій

- •Перевірка статистичних гіпотез.

Перевірка статистичних гіпотез.

Статистична гіпотеза – твердження відносно того чи іншого значення параметра розподілу, або про сам розподіл.

Гіпотеза,

що провіряють, називають нульовою

гіпотезою і позначають

.

.

Гіпотеза,

що конкурує з

називається

альтернативною і позначається

Наприклад. Перевіряється гіпотеза яка стверджує, що значення математичного сподівання завади завжди нульове

а=0 – це гіпотеза

Альтернативною гіпотезою є

а>0 або а<0

Якщо гіпотеза містить лише одне припущення то вона проста (а=5)

Складною гіпотезою є гіпотеза, що містить кілька, або кількість припущень.

Наприклад а=5

Нульова гіпотеза є домінуючою, тобто при рівних по силі твердженнях для та незмінною залишається !

Все базується на принципі, згідно якого гіпотеза (теорія) відхиляється, якщо існує факт, що їй (теорії) суперечить.

Але не обов’язково повинна прийматись, якщо таких фактів поки що немає. Правило, за яким приймається рішення про прийняття, чи відхилення гіпотези називається статистичним критерієм. Перевірку здійснюють за допомогою вибірки. З неї формують функцію вибірки (функцію результатів спостережень) яка називається перевірочною статистикою.

Значення статистики, при яких гіпотеза відкидається утверджують критичну абсолютну гіпотезу, яку перевіряють.

Наприклад.

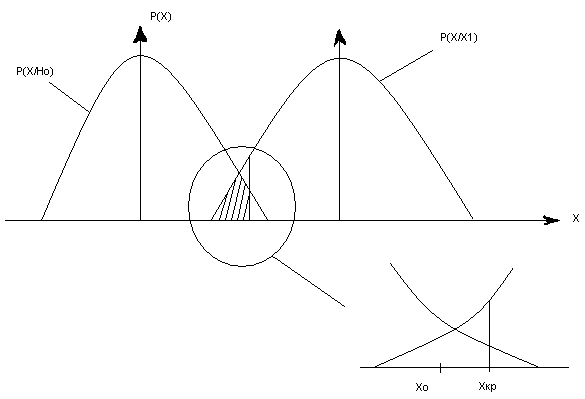

Нехай

на виході деякого приймача отримано

сигнал

необхідно прийняти рішення про те з чим

ми маємо справу чи з сигналом, чи з

завадою.

необхідно прийняти рішення про те з чим

ми маємо справу чи з сигналом, чи з

завадою.

Нехай - сигналу немає

- є.

Тобто базовим рахуємо відсутність сигналу.

Нехай

після дослідний розподіл

для першої та другої гіпотез буде мати

вигляд

для першої та другої гіпотез буде мати

вигляд

Нехай в t = Х0 маємо Х = Х0

Необхідно

прийняти рішення це

чи

випадок. Експериментатор із за певних

умов приймає значення

,

що задає область для перевірки.

,

що задає область для перевірки.

Якщо

то

відкидається.

то

відкидається.

Якщо

то

не відкидається.

то

не відкидається.

При перевірці можуть виникнути два типи помилки, пов’язанні з прийняттям рішення.

1)Помилка першого роду.

- вірна, але ми її відкинули

2)Помилка другого роду.

Якщо - вірна, а ми залишили .

Нехай ймовірність помилки першого роду

(відхилили

/

- вірна)

(відхилили

/

- вірна)

(прийняли

/

- хибна)

(прийняли

/

- хибна)

За введеними значеннями

1

1

Ймовірність - це площа під кривою

-

крива від Хкр

Р

– це площа під кривою

-

крива від Хкр

Р

– це площа під кривою

зліва від Хкр

зліва від Хкр

- це ймовірність хибної кривої

- це признак сигналу

Ймовірність відхилення нульової гіпотези коли вона справедлива називають значимість.

Ймовірність

- не допустити помилки 2 роду називають

потужністю критерію.

- не допустити помилки 2 роду називають

потужністю критерію.

Різна значимість результатів помилки можна вирахувати через відповідні коефіцієнти. Співвідношення (порівняння та ) дає можливість встановити Хкр.