Нейронные сети (ИПОВС) / 4 курс - Рычагов М.Н. / Лекции / Lektsiya_3_Neyronnyie_seti_pryamogo_rasprostraneniya

.pdf

Многослойный перцептрон. Нейронные сети

прямого распространения.

Лекция 3

Рычагов М.Н., профессор, д.ф.-м.н.

Сепарабельность пространства данных

Два множества точек (данных) в 2-мерном пр-ве → сепарабельны, если они могут быть разделены на два класса единственной прямой.

В n-мерном пространстве Два множества (набора) точек (данных) в n-мерном пр-ве → линейно сепарабельны, если они могут быть разделены n-1-мерной гиперплоскостью.

Два множества (набора) точек (данных) А и B в n-мерном пр-ве → линейно сепарабельны, если n+1

действительных чисел w1,w2, . . . ,wn : (x1 , x2 , … , xn ) A

n |

|

|

|

|

удовлетворено wi xi wn+1 |

и для (x1 , x2 , … , xn ) B |

|||

i=1 |

n |

|

|

|

|

|

|

||

также удовлетворено |

wi xi |

wn+1 . |

wn+1 = |

|

|

i=1 |

|

|

|

|

|

|

|

|

© 2019 МИЭТ, Нейронные сети |

2 |

© 2019 МИЭТ, Нейронные сети |

2 |

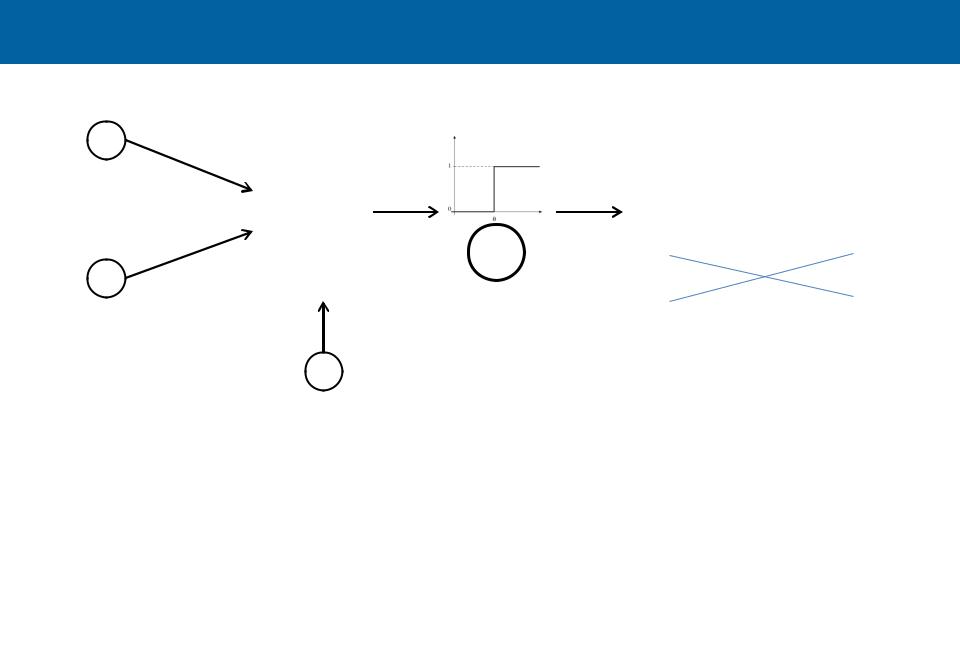

Разделение пространства

Проверка условия

0.9x1 + 2x2 1

Разделение пространства данных с помощью перцептрона

Перцептрон представляет собой вычислительный элемент с порогом , который при получении n действительных значений x1 , …, xn осуществляет их (взвешенное)

суммирование с весами w1,w2, . . . ,wn , при этом его

n

выходной сигнал равен 1, если wi xi и 0 - в противном

случае. |

i=1 |

© 2019 МИЭТ, Нейронные сети |

3 |

© 2019 МИЭТ, Нейронные сети |

3 |

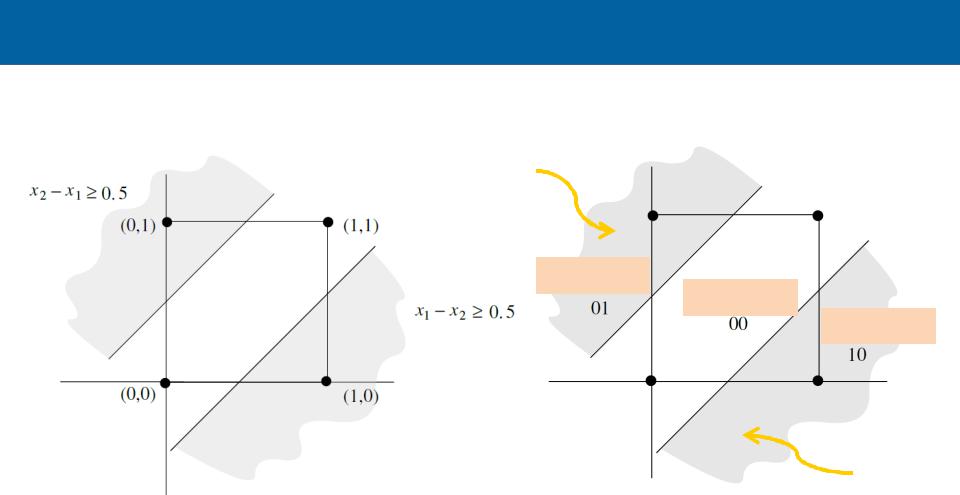

Исключающее ИЛИ (сложение по модулю 2)

1 |

w1 |

|

|

|

|

|

|

Вариант решения: |

|||

|

|

|

|

|

|

||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

y |

|

w1 = w2 =1 |

|

|

|

|

|

|

|

|

|

|

|

|

|||

2 |

|

|

|

b |

|

f |

0 & 0 |

||||

|

|

|

|

|

|

||||||

w |

|

|

|

|

|

|

|||||

|

|

|

|

|

|

|

|

|

|

||

|

2 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|

|

|

|

|

|

|

|

||

|

σ1 |

σ2 |

|

Ϛ |

|

Условие |

|

||||

|

+1 |

+1 |

-1 |

|

+ w1 + w2 − 0 |

|

|||||

|

|

|

|

|

|

|

|

|

|

|

|

|

+1 |

-1 |

-1 |

|

+ w1 − w2 − 0 |

|

|||||

|

|

|

|

|

|

|

|

|

|

|

|

|

-1 |

+1 |

-1 |

|

− w1 + w2 − 0 |

|

|||||

|

|

|

|

|

|

|

|

|

|

|

|

|

-1 |

-1 |

-1 |

|

− w1 − w2 − 0 |

|

|||||

© 2019 МИЭТ, Нейронные сети |

4 |

© 2019 МИЭТ, Нейронные сети |

4 |

Исключающее ИЛИ: разделяющая граница (1)

2 |

Значение -1 |

|

|

|

Значение +1 |

+1

|

|

|

|

|

1 |

Разделяющая |

|

|

|

|

|

|

|||

−1 |

+1 |

||||||

граница 1 |

|||||||

|

|

|

−1 |

|

|

||

|

|

|

|

|

|

|

|

© 2019 МИЭТ, Нейронные сети |

5 |

© 2019 МИЭТ, Нейронные сети |

5 |

Исключающее ИЛИ: разделяющая граница (2)

2 |

Значение -1 |

|

|

|

Значение +1 |

+1

|

|

|

|

1 |

Разделяющая |

|

|

|

|

|

|||

−1 |

+1 |

|||||

граница 2 |

||||||

−1

© 2019 МИЭТ, Нейронные сети |

6 |

© 2019 МИЭТ, Нейронные сети |

6 |

Разделение пространства 2-х слойной НС

2-я область линейного разделения

Область A

Область B

Область C

|

1-я область |

|

линейного разделения |

Разделение пространства данных |

Разметка областей |

двуслойной нейронной сетью |

в пространстве данных |

© 2019 МИЭТ, Нейронные сети |

7 |

© 2019 МИЭТ, Нейронные сети |

7 |

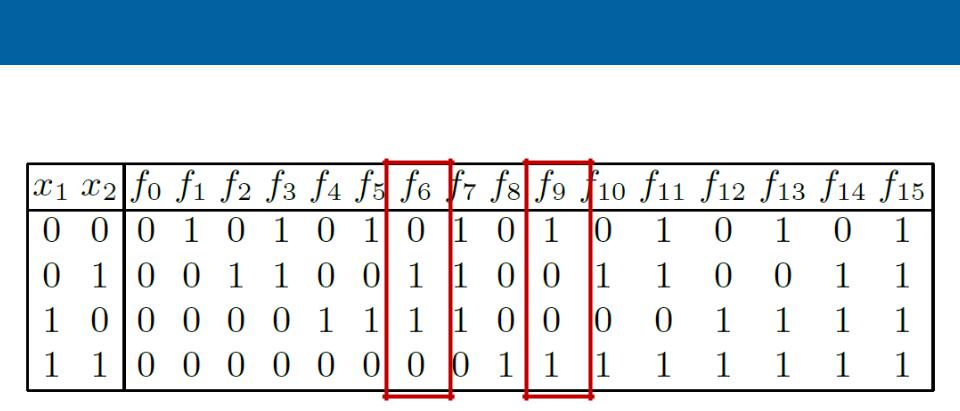

16 булевых функций двух переменных

Таблицы истинности

Линейно не сепарабельные функции

▪f6 - сложение по модулю два («Исключающее ИЛИ»)

▪f9 - эквиваленция

© 2019 МИЭТ, Нейронные сети |

8 |

© 2019 МИЭТ, Нейронные сети |

8 |

{−1, +1}

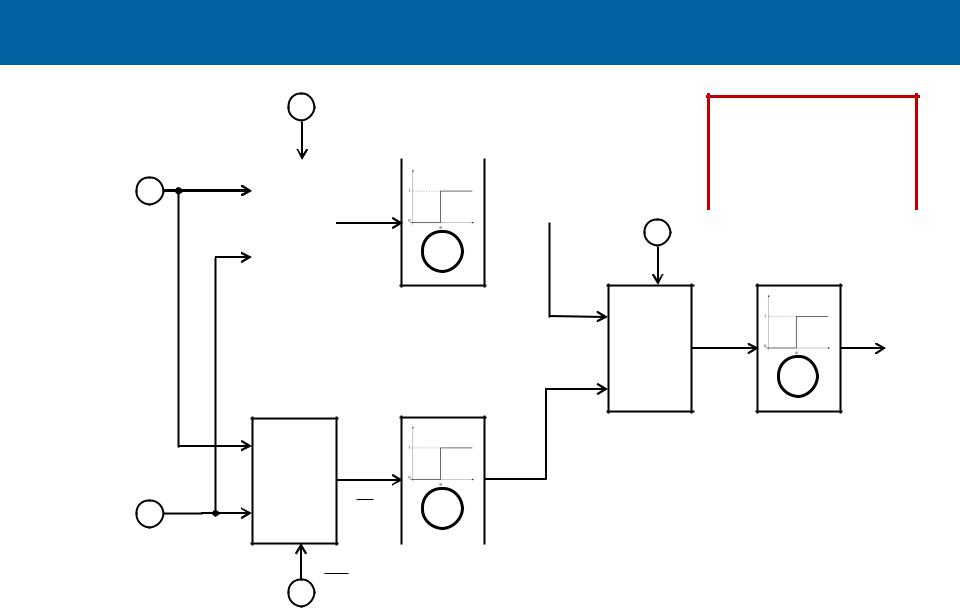

Архитектура 2-х слойного перцептрона

|

|

|

|

|

|

|

|

|

|

1 |

|||||

1 |

w1,1 |

|

|

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

|||

|

|

|

|

|

|

||

|

|

|

h |

||||

|

|

|

|

1 |

|||

w1, 2 |

w 2,1 |

||||||

2 |

h2 |

|

w 2, 2 |

|

2 |

1 {−1;+1}

|

|

s |

1 |

|

S1 {−1;+1} |

|

|

|

|||

|

|

|

|

||

|

|

1 |

|||

|

|

|

|||

f |

|

||||

w1,1 |

|

|

|

|

|

|

|

|

|

w1,2 |

|

H 1 |

f |

S 1 |

|

|

|

||

|

|

|

|

Вариант решения:

f |

s |

2 |

w1,1 = w1, 2 = w 2, 2 |

=w 2, 2 |

=1 |

||||

|

|

||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

1=1; 2= −1 |

|

|

||||

|

|

|

|

|

|||||

|

|

|

w1,1 =− 2; w2,1 =1 |

|

|||||

1 = 2

© 2019 МИЭТ, Нейронные сети |

9 |

© 2019 МИЭТ, Нейронные сети |

9 |

Реализация элемента «Исключающее ИЛИ»

Преобразование сигнала

▪Состояние «скрытых» нейронов

2

s j = sign (hj ) =sign ( wij i − j ) ( j =1, 2)

i=1

▪ Состояние нейрона выходного слоя

2

Sk = sign (H k ) =sign ( wjk s j − k )

j =1

© 2019 МИЭТ, Нейронные сети |

10 |

© 2019 МИЭТ, Нейронные сети |

10 |