- •1. Назвати основні сфери застосування високопродуктивних систем опрацювання даних і коротко їх охарактеризувати.

- •2. Навести класифікацію обчислювальних систем згідно з м.Флінном.

- •3. Навести класифікацію обчислювальних систем згідно з р.Хокні.

- •4. Навести основні архітектури високопродуктивних систем опрацювання даних.

- •5.Архітектура мрр

- •6.Архітекттура smp

- •8. Охарактерізуваті архітектуру numa.

- •9. Охарактеризувати кластерні системи.

- •10. Охарактерізуваті архітектуру grid.

- •11.Навести переваги використання багатоядерних процесорних систем у порівнянні з багатопроцесорними системами.

- •12. Навести переваги використання спеціалізованих графічних процесорів (gpu) у порівнянні з центральними процесорами (cpu) комп'ютерних систем для високопродуктивних обчислень.

- •13.Як визначається час виконання паралельного алгоритму?

- •14. Мінімальний можливий час виконання паралельного алгоритму визначається довжиною максимального шляху обчислювальної схеми алгоритму:

- •15 Основною характеристикою алгоритму, визначальною ефективність його виконання на багатопроцесорній системі є його ступінь паралелізму.

- •16. Ефективність паралельних обчислень сильно залежить від об'єму обміну у виконуваному застосуванні і від свойст коммуникатора.

- •17.Закон Амдала

- •18.Закон Густавсона – Барсиса

- •20.Навести основні принципи, яких необхідно дотримуватись при розробці паралельних алгоритмів.

- •21. Навести та охарактеризувати основні типи апаратних комунікаційних інтерфейсів для організації високопродуктивних систем опрацювання даних.

- •22. Охарактеризувати спеціалізований комунікаційний інтерфейс sci (Scalable Coherent Interface).

- •23.Охарактеризувати спеціалізований комунікаційний інтерфейс Myrinet

- •24.Охарактеризувати комунікаційний інтерфейс Gigabit Ethernet.

- •26 Охарактеризувати принципи роботи технології виклику віддалених процедур, методів, обєктів

- •27 Дати означення терміну маршалізація даних при виклику віддалених процедур

- •28 Дати означення терміну серіалізація обєктів

- •29. Пояснити причини використання клієнтської та серверної заглушок (stub) при написанні програм виклику віддалених процедур та методів.

- •30. Навести основні проблеми, які виникають при використанні технологій виклику віддалених процедур, методів, об'єктів.

- •31. Охарактеризувати технологію rpc.

- •32.Архітектура rmi.

- •1.Rmi (англ. Remote Method Invocation) - програмний інтерфейс виклику видалених методів в мові Java.

- •35. Охарактерізуваті технологію dcom

- •36. Проаналізувати використання программ з багатьма підпроцесами для організації високопродуктивних систем опрацювання даних.

- •37.Дати означення термінам семафор, м'ютекс, критична секція.

- •38.Навести основні проблеми, які виникають при використанні програм з багатьма підпроцесами, зокрема гонка процесів, вхід/вихід з критичних секцій, синхронізація підпроцесів.

- •39.Проаналізувати використання програм зі з'єднанням на основі сокетів для організації високопродуктивних систем опрацювання даних.

- •40.Дати означення терміну сокет, мережевий сокет, unix-сокет.

- •42. Охарактеризуйте технологію mpi, її призначення і реалізації

- •43. Навести приклад найпростішої програми на мові с з використанням технології mpi, яка виводить прізвище студента

- •44 Описати процес компіляції і виконання програми засобами середовища OpenMpi та компілятора gcc.

- •45.Навести необхідні функції mpi для ініціалізації і завершення mpi-коду програми.

- •46Охарактеризувати поняття групи і комунікатора у технології mpi.

- •47Навести і охарактеризувати основні типи даних mpi.

- •48Охарактеризувати основні методи для обміну повідомленнями між окремими процесами технології mpi.

- •50. Навести і охарактеризувати віртуальні топології mpi.

- •52Директива parallel

- •53Навести конструкції технології OpenMp на мові с для паралельного виконання циклу області технології OpenMp.

- •58. Охарактеризувати технологію pvm.

- •59 Проаналізувати можливість використання технології OpenMp, mpi та mpi/openmp на архітектурах mpp, smp та кластерній

- •60 Охарактеризувати високодоступні кластери

- •61 Охарактеризувати високопродуктивні кластери

- •62. Які є базові операції rpc?

- •63.Які є етапи виконання rpc.

- •64.Навести основні етапи розробки паралельних алгоритмів.

- •65.Завдання множення матриці на вектор визначається співвідношеннями

- •66.Навести і описати паралельні методи множення матриць.

- •67. Навести і описати паралельні методи розв'язку систем лінійних рівнянь.

- •67. Навести і описати паралельні методи сортування.

- •69.Навести і описати паралельні методи опрацювання графів.

- •70.Навести і описати паралельні методи розв'язання диференціальних рівнянь у частинних похідних.

- •71.Навести і описати паралельні методи багатоекстремальної оптимізації

- •72. У вихідному коді програми на мові с вставити пропущені виклики процедур підключення мрі, визначення кількості процесів і рангу процесів.

- •73. Програма, яка виводить «Hello Word from process I for n».

- •74. Програма генерації чисел в одному процесі і сумування їх у іншому процесі і надсилення результату в перший процес.

- •85.Налаштувати обчислювальний кластер засобами OpenMosix і пояснити принципи його роботи

- •88.Пояснити що таке mfs і продемонструвати прозору взаємодію файлових систем кластера

- •89. Написати програму з використанням бібліотеки Posix threads на мові с з метою тестування роботи кластера під керуванням OpenMosix. Тестування провести з замірами часу.

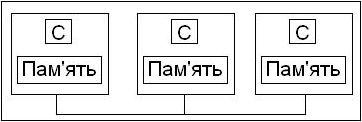

8. Охарактерізуваті архітектуру numa.

Для вирішення проблем, що виникають в симетричних багатопроцесорних системах, було вирішено пожертвувати однорідністю і організувати неоднорідний доступ до пам'яті (Non-Unifom Memory Access, NUMA) при збереженні єдиного для всіх процесорів адресного простору.

С истема

состоит из однородных базовых модулей

(плат), состоящих из небольшого числа

процессоров. C каждым модулем обычно

связан один или несколько блоков памяти.

Модули объединены с помощью высокоскоростного

коммутатора. Поддерживается единое

адресное пространство для всех модулей.

Аппаратно поддерживается доступ к

удаленной памяти, т. е. к блокам памяти

приписанным другим модулям. Скорость

доступа из модуля к блокам памяти

приписанным данному модулю в несколько

раз быстрее, чем к остальным блокам

памяти.

истема

состоит из однородных базовых модулей

(плат), состоящих из небольшого числа

процессоров. C каждым модулем обычно

связан один или несколько блоков памяти.

Модули объединены с помощью высокоскоростного

коммутатора. Поддерживается единое

адресное пространство для всех модулей.

Аппаратно поддерживается доступ к

удаленной памяти, т. е. к блокам памяти

приписанным другим модулям. Скорость

доступа из модуля к блокам памяти

приписанным данному модулю в несколько

раз быстрее, чем к остальным блокам

памяти.

У випадку, якщо апаратний підтримується когерентність кешів у всій системі (звичайно це так), говорять про архітектуру cc-NUMA (cache-coherent NUMA).

Масштабованість NUMA-систем обмежується об'ємом адресного простору, можливостями апаратури піддіжі когерентності кешів і можливостями операційної системи по управлінню великим числом процесорів. На справжній момент, максимальне число процесорів в NUMA-системах складає 256 (Origin2000). Іншим представником даного класу багатопроцесорних систем є IBM pSeries 690.

9. Охарактеризувати кластерні системи.

Кластер — зв'язаний набір повноцінних комп'ютерів, використовуваний як єдиний обчислювальний ресурс.

З точки зору простоти збірки і простоти використання кластер володіє великим числом переваг перед MPP системами.

Кластер також легко масштабований по числу процесорних вузлів як і MPP системи. (За винятком проблем пов'язаних з об'ємом енергії, що виділяється і споживаної.)

Для управління кластером не потрібно ставити спеціальну операційну систему.

Комунікаційне середовище зазвичай реалізоване поверх відомих і достатньо популярних мережевих технологій.

Для створення кластерів зазвичай використовуються як «прості» однопроцесорні персональні комп'ютери, так і багатопроцесорні сервери SMP(NUMA). При цьому не накладаються ніяких обмежень на склад і архітектуру вузлів. Кожен з вузлів функціонує під управлінням своєї власної операційної системи. Найчастіше використовуються распростаненные ОС: Linux, FREEBSD, Solaris, AIX, Windows NT.

Види кластерів:

Гетерогенні (різне АЗ а іноді і ПЗ)

Гомогенні (однакове Пз та АЗ)

Мережеві технології для кластера:

Gigabit Ethernet.

Технології, розроблені спеціально для кластера: SCI фірми Scali Computer (~100 MB/s) і Mirynet (~120 MB/ s); (SUN, HP, Silicon Graphics).

Як правило програмування для подібних систем, здійснюється в рамках моделі передачі повідомлень. Як реалізація моделі передачі повідомлень використовується одна з доступних реалізацій MPI. Наприклад: OPENMPI, mpich, INTEL-MPI, Scali MPI, рої для устаткування від IBM.

Переваги:

Можуть бути утворені на базі окремих комп'ютерів, що вже існують у споживачів, або ж сконструйовані з типових комп'ютерних елементів;

Підвищення обчислювальної потужності окремих процесорів дозволяє будувати кластери з порівняно невеликої кількості окремих комп'ютерів (lowly parallel processing)

Для паралельного виконання в алгоритмах досить виділяти тільки крупні незалежні частини розрахунків (coarse granularity).

Недоліки:

Організація взаємодії обчислювальних вузлів кластера за допомогою передачі повідомлень зазвичай приводить до значних тимчасових затримок

Додаткові обмеження на тип паралельних алгоритмів, що розробляються, і програм (низька інтенсивність потоків передачі даних)