- •1. Случайное событие. Вероятность случайного события. Классическое и статистическое определение вероятности. Понятие о совместных и несовместных событиях. Закон (теорема) сложения вероятностей.

- •2. Понятие о зависимых и независимых событиях. Условная вероятность, закон (теорема) умножения вероятностей. Формула Байеса.

- •4. Основные понятия математической статистики. Генеральная совокупность и выборка. Статистическое распределение (вариационный ряд). Гистограмма. Полигон частот.

- •5. Характеристики положения (мода, медиана, выборочное среднее) и рассеяния (выборочная дисперсия и выборочное среднее квадратическое отклонение).

- •6. Оценка параметров генеральной совокупности по ее выборке (точечная и интервальная). Доверительный интервал и доверительная вероятность.

- •7. Общая постановка задачи проверки гипотез. Параметрические и непараметрические статистические критерии.

- •8. Проверка гипотез относительно генеральных средних и относительно генеральных дисперсий.

- •9. Закон распределения случайной величины. Проверка гипотез о законах распределения случайных величин.

- •10. Функциональная и корреляционная зависимости. Коэффициент линейной корреляции и его свойства.

- •11.Ошибка выборочного коэффициента линейной корреляции. Проверка гипотезы о значимости выборочного коэффициента линейной корреляции.

- •12. Выборочное уравнение линейной регрессии. Нелинейная регрессия. Коэффициент корреляции рангов Спирмена.

- •13. Определение дисперсионного анализа (да). Основные понятия и виды да.

- •14. Условия проведения дисперсионного анализа (да). Однофакторный да.

- •15. Анализ двухфакторных комплексов. Понятие о многофакторном комплексе.

- •16. Предмет и задачи информатики. Основные направления информатики. Признаки, условия и последствия информатизации общества. Кибернетика и информатика.

- •17. Информация и ее свойства. Меры информации. Информационная система (ис). Структура и классификация ис.

- •18. Информационные технологии (ит). Классификация ит. Новые информационные технологии (нит).

- •19. Форма представления информации в эвм. Единицы измерения информации. Классификация эвм по этапам создания, по размерам и функциональным возможностям, по назначению.

- •20. Структурная схема эвм. Процессор, его характеристики. Запоминающее устройство. Устройства ввода и вывода информации.

- •21. Структурная схема персонального компьютера (пк). Системный блок. Мониторы: классификация и основные параметры. Клавиатуры, группы клавиш клавиатуры. Средства мультимедиа.

- •22. Программные продукты и их классификация. Защита программных продуктов ( правовая и программная). Цели и направления защиты.

- •23. Системное программное обеспечение (базовое и сервисное). Операционная система (ос). Операционная оболочка. Графическая операционная система Windows.

- •24. Прикладные программные продукты. Текстовые редакторы. Текстовый процессор ms Word и его возможности.

- •25. Электронные таблицы. Табличный процессор ms Excel. Типовая структура интерфейса Excel. Функциональные и графические возможности Excel.

- •26. Базы данных (бд). Система управления базами данных (субд). Классификация баз данных. Типовая структура интерфейса ms Access. Медицинские бд.

- •27. Экспертная система (эс). Структура эс. Этапы построения эс. Классификация эс. Медицинские эс.

- •28. Графические редакторы. Виды и примеры графических редакторов. Интерфейс, возможности и инструменты графического редактора Paint.

- •29. Компьютерные сети, их классификация. Локальные компьютерные сети: виды, топология, техническое и программное обеспечение, возможности.

- •30. Глобальная компьютерная сеть Интернет: типы соединения компьютеров, система адресации, протокол. Ресурсы Интернет. Применение в медицине и здравоохранении.

- •30. Глобальная компьютерная сеть Интернет: типы соединения компьютеров, система адресации, протокол. Ресурсы Интернет. Применение в медицине и здравоохранении.

- •31. Группы медицинской информации. Определение медицинской документации. Характеристика групп стандартной медицинской документации.

- •33. Определение медицинской информатики. Составные элементы медицинской информатики. Разделы медицинской информатики.

- •34. Классификация информационных технологий (ит) в медицине. Ит управления медицинскими учреждениями. Ит клинической информатики(-).

- •35. Понятие медицинской информационной системы. Единая информационная система (еис) в сфере здравоохранения и социального развития.

- •36. Понятие о телемедицине. Стратегические задачи использования информационных технологий в медицине.

- •37. Моделирование как метод познания. Определение модели, ее свойства и характеристики. Классификация моделей.

- •38. Математические модели: определение, классификация, требования, особенности и преимущества. Основные этапы моделирования.

- •41. Информатизация медицинского технологического процесса в лпу. Арм врача: классификация, назначение, аппаратное и программное обеспечение.

- •42. Определение мис. Цели, задачи и функции мис лпу. Классификация мис.

- •43. Принципы создания мис. Требования, условия и этапность при построении мис. Структура мис.

- •44. Основы функционирования мис. Подсистемы мис "Поликлиника" и "Электронная регистратура".

- •45. Основы функционирования мис. Подсистемы мис "Электронная история болезней" и "Архив функциональных исследований “

9. Закон распределения случайной величины. Проверка гипотез о законах распределения случайных величин.

Выдвигают нулевую гипотезу Н0: неизвестная функция распределения F(x) исследуемой случайной величины X распределена по некоторому теоретическому закону, например, по нормальному закону: H0: F(x)=Fтеор(х).

В качестве этой теоретической модели Fтеор(х) может быть рассмотрен любой закон, например, экспоненциальный или биномиальное распределение. Это определяется сущностью изучаемого явления, а также результатами предварительной обработки наблюдений: формой графика распределения, соотношения между выборочными данными.

Выдвигается альтернативная гипотеза, что данная генеральная совокупность не распределена по закону Fтеор(х):

Н1:

F(x) Fтеор(х).

Fтеор(х).

Задается уровень значимости, например, α≤0,05.

Если хотим проверить, согласуются эмпирические данные с нашим гипотетическим предложением относительно теоретической функции распределения или нет, то используем критерий согласия.

Критерий согласия – это критерий проверки гипотезы о предполагаемом законе неизвестного распределения.

Рассмотрим один из них, использующий Х2 распределение и получивший название критерий согласия Пирсона. Этот критерий не требует никаких пердположений о параметрах совокупности, из которых извлечена выборка. Это непараметрический критерий.

Применим критерий Х2 (хи-квадрат) к проверке нулевой гипотезы Н0, что генеральная совокупность распределена по нормальному закону.

Критерий предполагает, что результаты наблюдений группированы в вариационный ряд и разбиты на классы.

По выборке объема n построим эмпирическое распределение Fэмп(х):

варианты х1, х2, …, хn

эмпирические частоты n1, n2, …, nn

и сравним его с предполагаемым теоретическим распределением, вычисленным в предположении нормального закона распределения.

Теоретические частоты: n1’, n2’, …, nn’/

То есть фактически Н0: nэмп=nтеор’.

В качестве критерия проверки нулевой гипотезы примем случайную величину:

,

,

где k – число классов.

Из таблиц находим Хкрит2(α≤0,05, f=k-3).

Сравниваем, если Хнабл2<Хкрит2(α, f) => Н0 – данное распределение подчиняется нормальному закону.

Если наоборот, то не подчиняется нормальному закону.

10. Функциональная и корреляционная зависимости. Коэффициент линейной корреляции и его свойства.

Функциональная зависимость – это зависимость вида y=f(x), когда каждому возможному значению случайной величины Х соответствует одно возможное значение случайной величины Y.

Корреляционная зависимость – это статистическая зависимость, проявляющаяся в том, что при изменении одной из величин изменяется среднее значение другой:

=f(x).

=f(x).

Для изучения корреляционной связи данные о статистической зависимости удобно задавать в виде корреляционной таблицы или в виде двумерной выборки.

|

Xi |

x1 |

x2 |

… |

xn |

|

Yi |

y1 |

y2 |

… |

yn |

Схема эксперимента следующая: пусть имеется выборка объема n из генеральной совокупности N. На каждом объекте выборки определяют числовые значения признаков, между которыми требуется установить наличие или отсутствие связи. Таким образом, получаем 2 ряда числовых значений.

Для наглядности полученного материала каждую пару можно представить в виде точки на координатной плоскости. По оси абсцисс откладывают значения одного вариационного ряда – xi, а по оси ординат – другого – yi.

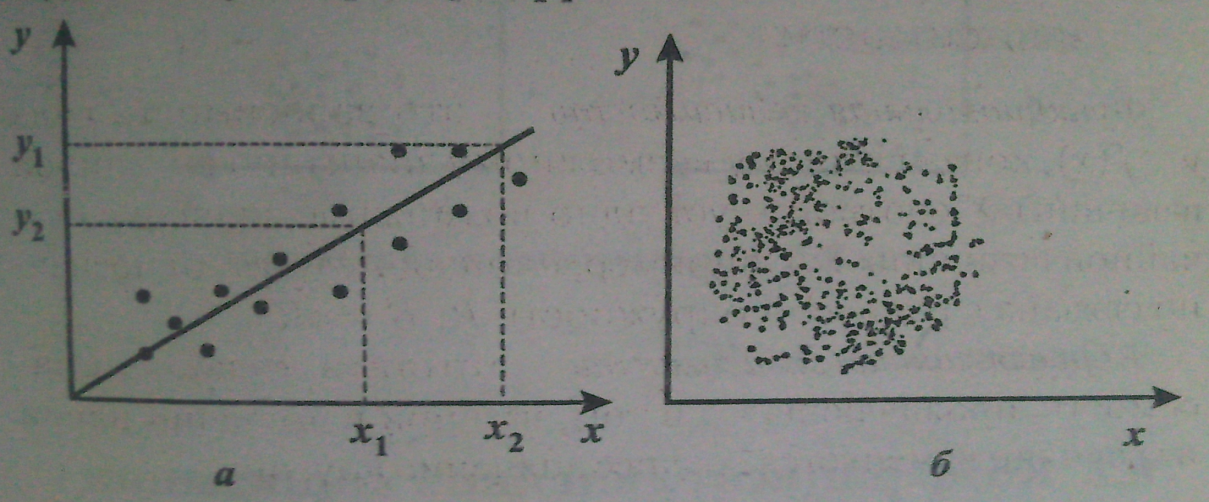

Такое изображение статистической зависимости называется полем корреляции, или корреляционным полем точек. Оно создает общую картину корреляции.

А) точки сгруппированы вдоль некоторого направления, это говорит о наличии линейной корреляционной связи между признаками.

Б) точки распределены неравномерно , это говорит о том, что линейная корреляция отсутствует

На практике исследователя часто может интересовать не сама зависимость одной переменной от другой, а именно характеристика тесноты связи между ними, которую можно было бы выразить одним числом. Эта характеристика называется выборочным коэффициентом линейной корреляции r.

Требования к корреляционному анализу: корреляционный анализ – это метод, используемый, когда данные можно считать случайными и выбранными из совокупностей, распределенных по нормальному закону.

Выборочный коэффициент линейной корреляции r характеризует тесноту линейной связи между количественными признаками в выборке:

Если r>0, то корреляционная связь между переменными прямая, при r<0 – связь обратная.

СВОЙСТВА КОЭФФИЦИЕНТА КОРРЕЛЯЦИИ r:

Они проявляются при достаточно большом объеме выборки n.

Коэффициент корреляции принимает значения на отрезке -1≤r≤1. В завасимости от того, насколько |r| приближается в 1, различают связи:

r<0.3 – слабая связь

r=0,3 – 0,5 – умеренная связь

r=0,5 – 0,7 – заметная(значительная)

r=0,7 – 0,8 – достаточно тесная

r=0,8 – 0,9 – тесная(сильная)

r> 0,9 – очень сильная

При r=1 – функциональная зависимость y=f(x)

Чем ближе |r| к 0, тем слабее связь

При r=0 линейная корреляционная связь отсутствует.

rxy=ryx – случайные переменные симметричные

x и y могут взаимозаменяться, не влияя на величину r.

Если все значения переменных увеличить (уменьшить) на одно и то же число или в одно и то же число раз, то величина коэффициента корреляции не изменится

Коэффициент корреляции величина безразмерная.