- •Лекція № 10 Тема: Ймовірнісні моделі джерел повідомлень

- •1. Ймовірнісні моделі джерел дискретних повідомлень

- •2. Ентропія джерел дискретних повідомлень

- •3. Умовна ентропія

- •4. Щільність ентропії стаціонарного ддп

- •4. Однорідний ланцюг Маркова як модель джерела дискретних повідомлень

- •6. Ймовірнісні моделі джерел неперервних повідомлень та їх ентропійні властивості

2. Ентропія джерел дискретних повідомлень

Нехай

ДДП описується деякою дискретною

ймовірнісною моделлю

.

.

Означення.

Ентропією

ДДП (або ентропією випадкового символу

)

називається величина, яка визначається

функціоналом

)

називається величина, яка визначається

функціоналом

(1)

(1)

де

– символ математичного сподівання.

– символ математичного сподівання.

Якщо

в (l) логарифм береться за основою

,

то ентропія вимірюється вбітах

(bit = binary digit), а якщо використовується

натуральний логарифм за основою

,

то ентропія вимірюється вбітах

(bit = binary digit), а якщо використовується

натуральний логарифм за основою

,

то ентропія вимірюється унатах

(nat = naturаl digit).

,

то ентропія вимірюється унатах

(nat = naturаl digit).

Ми

будемо користуватися логарифмом за

основою

,

отже, вимірювати ентропію в бітах.

,

отже, вимірювати ентропію в бітах.

Зауваження.

Невизначеність

,

що зустрічається в (1) розв’язується

таким чином:

,

що зустрічається в (1) розв’язується

таким чином: .

.

Зауваження. Вперше поняття ентропії було введено Хартлі в 1928 р. у вигляді

(2)

(2)

для

випадкового символу

з

з рівноймовірними

значениями,

тому (2) іноді і тепер називають ентропією

Хартлі. Ентропія в загальному вигляді

(1) називається ентропією Шеннона.

рівноймовірними

значениями,

тому (2) іноді і тепер називають ентропією

Хартлі. Ентропія в загальному вигляді

(1) називається ентропією Шеннона.

Сформулюємо основні властивості функціонала ентропії.

Функціонал ентропії набуває невід’ємних значень:

,

він обертається в 0 тільки для виродженого

розподілу:

,

він обертається в 0 тільки для виродженого

розподілу:

,

,

,

, ,

, .

.

(Вироджений

розподіл відповідає випадку, коли символ

не є випадковим:

не є випадковим: ).

).

Ентропія ДДП з алфавітом потужності

має максимальне значення

має максимальне значення

,

,

яке

досягається, якщо дискретний розподіл

– рівномірний, тобто всі

– рівномірний, тобто всі значень символів рівноймовірні:

значень символів рівноймовірні: .

.

Наслідок.

Чим більше потужність

алфавіту, тим більше ентропія Хартлі

(максимально можлива ентропія).

алфавіту, тим більше ентропія Хартлі

(максимально можлива ентропія).

(властивість адитивності) Якщо випадкові символи

,

, повідомлення незалежні, то сумісна

ентропія дорівнює сумі ентропій:

повідомлення незалежні, то сумісна

ентропія дорівнює сумі ентропій:

.

.

Наслідок.

Якщо незалежні в сукупності

випадкових символів

випадкових символів ,

, ,

…,

,

…, ,

то їх спільна ентропія адитивна:

,

то їх спільна ентропія адитивна:

Додавання до алфавіту символів одного символу з нульовою ймовірністю, а отже, і будь-якої кількості таких символів не змінює ентропії ДДП.

3. Умовна ентропія

Щоб вивчити нові важливі властивості ентропії, які використовуються в криптосистемах, введемо поняття умовної ентропії.

Нехай

визначений випадковий

-вектор

символів

-вектор

символів

з

деяким

з

деяким -вимірним

дискретним розподілом ймовірностей

-вимірним

дискретним розподілом ймовірностей

,

,

де

.

Нехай задано натуральне число

.

Нехай задано натуральне число ,

, і визначений

і визначений -вимірний

дискретний розподіл ймовірностей

підвектора

-вимірний

дискретний розподіл ймовірностей

підвектора за умови, що зафіксований підвектор

за умови, що зафіксований підвектор :

:

.

.

(Тут використана формула множення ймовірностей).

Означення.

Умовною

ентропією підвектору

за умови, що зафіксований підвектор

за умови, що зафіксований підвектор називається функціонал

називається функціонал

(3)

(3)

Означення.

Умовною

ентропією підвектору

символів

відносно випадкового підвектору символів

відносно випадкового підвектору символів називається

функціонал,

отриманий усереднюванням (3):

називається

функціонал,

отриманий усереднюванням (3):

(4)

(4)

Продовжимо дослідження властивостей ентропії і умовної ентропії з урахуванням введених понять.

Теорема

1.

Якщо підвектори випадкових символів

,

незалежні, то умовна ентропія збігається

з безумовною:

,

незалежні, то умовна ентропія збігається

з безумовною:

Теорема

2.

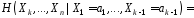

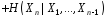

Для будь-якої послідовності

випадкових символів повідомлення

ентропія маєвластивість

ієрархічної адитивності:

випадкових символів повідомлення

ентропія маєвластивість

ієрархічної адитивності:

.

.

Наслідок.

Якщо випадкові

символи

повідомлення незалежні в сукупності,

то ентропія має властивість адитивності

3:

повідомлення незалежні в сукупності,

то ентропія має властивість адитивності

3:

Теорема 3. Умовна ентропія не може перебільшувати безумовну:

.

.

Наслідок 1. При додаванні умов умовна ентропія не збільшується:

.

.

Наслідок

2. Ентропія

послідовності

випадкових символів

повідомлення не перебільшує суми

ентропій кожного символу:

випадкових символів

повідомлення не перебільшує суми

ентропій кожного символу:

Теорема

4. При дискретному

функціональному перетворенні

повідомлення ентропія не збільшується:

повідомлення ентропія не збільшується:

,

,

причому

рівність досягається тоді і тільки

тоді, коли

– бієкція.

– бієкція.

Введений

в (1) функціонал ентропії Шеннона має

всі властивості, які необхідно вимагати

від кількісної міри невизначеності.

Тому ентропію Шеннона

і використовують в криптології як

кількісну міру невизначеності повідомлення

і використовують в криптології як

кількісну міру невизначеності повідомлення .

Причому функціонал ентропії Шеннона є

єдиним функціоналом, що має вивчені

властивості. Має місце теорема

.

Причому функціонал ентропії Шеннона є

єдиним функціоналом, що має вивчені

властивості. Має місце теорема

Теорема

5

(єдиності функціоналу ентропії).

Нехай для будь-якого натурального числа

функція

функція змінних

змінних

,

,

,

,

неперервна по сукупності аргументів і має наступні три властивості:

а) максимальне значення функції досягається при рівномірному розподілі:

б) ієрархічна аддитивність:

в)

додавання до алфавіту, що складається

з

символів, одного символу

символів, одного символу

з

нульовою ймовірністю ( )

не змінює значення ентропії:

)

не змінює значення ентропії:

.

.

Тоді

ця функція

необхідно має шенноновський вигляд:

необхідно має шенноновський вигляд:

де

– довільна додатна константа.

– довільна додатна константа.