- •Нейрокомпьютерная техника: Теория и практика

- •Предисловие

- •Благодарности

- •Введение

- •Почему именно искусственные нейронные сети?

- •Свойства искусственных нейронных сетей

- •Обучение

- •Обобщение

- •Абстрагирование

- •Применимость

- •Исторический аспект

- •Искусственные нейронные сети сегодня

- •Перспективы на будущее

- •Искусственные нейронные сети и экспертные системы

- •Соображения надежности

- •Литература

- •Глава 1. Основы искусственных нейронных сетей

- •Биологический прототип

- •Искусственный нейрон

- •Активационные функции

- •Однослойные искусственные нейронные сети

- •Многослойные искусственные нейронные сети

- •Нелинейная активационная функция

- •Сети с обратными связями

- •Терминология, обозначения и схематическое изображение искусственных нейронных сетей

- •Терминология

- •Дифференциальные уравнения или разностные уравнения

- •Графическое представление

- •Обучение искусственных нейронных сетей

- •Цель обучения

- •Обучение с учителем

- •Обучение без учителя

- •Алгоритмы обучения

- •Литература

- •Глава 2. Персептроны персептроны и зарождение искусственных нейронных сетей

- •Персептронная представляемость

- •Проблема функции исключающее или

- •Линейная разделимость

- •Преодоление ограничения линейной разделимости

- •Эффективность запоминания

- •Обучение персептрона

- •Алгоритм обучения персептрона

- •Дельта-правило

- •Трудности с алгоритмом обучения персептрона

- •Литература

- •Глава 3. Процедура обратного распространения

- •Введение в процедуру обратного распространения

- •Обучающий алгоритм обратного распространения

- •Сетевые конфигурации

- •Многослойная сеть.

- •Обзор обучения

- •Дальнейшие алгоритмические разработки

- •Применения

- •Предостережение

- •Паралич сети

- •Локальные минимумы

- •Размер шага

- •Временная неустойчивость

- •Литература

- •Глава 4. Сети встречного распространения

- •Введение в сети встречного распространения

- •Структура сети

- •Нормальное функционирование

- •Слои Кохоненна

- •Слой Гроссберга

- •Обучение слоя кохонена

- •Предварительная обработка входных векторов

- •Выбор начальных значений весовых векторов

- •Режим интерполяции

- •Статистические свойства обученной сети

- •Обучение слоя гроссберга

- •Сеть встречного распространения полностью

- •Приложение: сжатие данных

- •Обсуждение

- •Литература

- •Глава 5. Стохастические методы

- •Использование обучения

- •Больцмановское обучение

- •Обучение Коши

- •Метод искусственной теплоемкости

- •Приложения к общим нелинейным задачам оптимизации

- •Обратное распространение и обучение коши

- •Трудности, связанные с обратным распространением

- •Трудности с алгоритмом обучения Коши

- •Комбинирование обратного распространения с обучением Коши

- •Обсуждение

- •Литература

- •Глава 6. Сети Хопфилда

- •Конфигурации сетей с обратными связями

- •Бинарные системы

- •Устойчивость

- •Ассоциативная память

- •Непрерывные системы

- •Сети Хопфилда и машина Больцмана

- •Термодинамические системы

- •Статистичекие сети Хопфилда

- •Обобщенные сети

- •Приложения

- •Аналого-цифровой преобразователь

- •Задача коммивояжера

- •Обсуждение

- •Локальные минимумы

- •Скорость

- •Функция энергии

- •Емкость сети

- •Литература

- •Глава 7. Двунаправленная ассоциативная память

- •Структура дап

- •Восстановление запомненных ассоциаций

- •Кодирование ассоциаций

- •Емкость памяти

- •Непрерывная дап

- •Адаптивная дап

- •Конкурирующая дап

- •Заключение

- •Литература

- •Глава 8. Адаптивная резонансная теория

- •Архитектура apt

- •Описание apt

- •Упрощенная архитектура apt

- •Функционирование сети apTв процессе классификации

- •Реализация apt

- •Функционирование сетей apt

- •Пример обучения сети apt

- •Характеристики apt

- •Инициализация весовых векторов т

- •Настройка весовых векторов Вj

- •Инициализация весов bij

- •Теоремы apt

- •Заключение

- •Литература

- •Глава 9. Оптические нейронные сети

- •Векторно-матричные умножители

- •Электронно-оптические матричные умножители

- •Сети Хопфилда на базе электронно-оптических матричных умножителей

- •Голографические корреляторы

- •Объемные голограммы

- •Оптическая сеть Хопфилда, использующая объемные голограммы

- •Заключение

- •Литература

- •Глава 10. Когнитрон и неокогнитрон

- •Когнитрон

- •Структура

- •Обучение

- •Неокогнитрон

- •Структура

- •Обобщение

- •Вычисления

- •Обучение

- •Заключение

- •Литература

- •Приложение а. Биологические нейронные сети

- •Человеческий мозг: биологическая модель для искусственных нейронных сетей

- •Организация человеческого мозга

- •Мембрана клетки

- •Компьютеры и человеческий мозг

- •Приложение б. Алгоритмы обучения

- •Обучение с учителем и без учителя

- •Метод обучения хэбба

- •Алгоритм обучения Хэбба

- •Метод сигнального обучения Хэбба

- •Метод дифференциального обучения Хэбба

- •Входные и выходные звезды

- •Обучение входной звезды

- •Обучение выходной звезды

- •Обучение персептрона

- •Метод обучения уидроу-хоффа

- •Методы статистического обучения

- •Самоорганизация

- •Литература

Метод сигнального обучения Хэбба

Как мы видели, выход NETпростого искусственного нейрона является взвешенной суммой его входов. Это может быть выражено следующим образом:

![]()

где NETj– выход NETнейронаj; OUTi – выход нейрона i;wij– вес связи нейронаiс нейрономj.

Можно показать, что в этом случае линейная многослойная сеть не является более мощной, чем однослойная сеть; рассматриваемые возможности сети могут быть улучшены только введением нелинейности в передаточную функцию нейрона. Говорят, что сеть, использующая сигмоидальную функцию активации и метод обучения Хэбба, обучается по сигнальному методу Хэбба. В этом случае уравнение Хэбба модифицируется следующим образом:

![]()

wij(t+1) =wij(t) + OUTiOUTj

где wij(t) – сила синапса от нейронаiк нейронуjв момент времени t; OUTi– выходной уровень пресинаптического нейрона равный F(NETi); OUTj –выходной уровень постсинаптического нейрона равный F(NET).

Метод дифференциального обучения Хэбба

Метод сигнального обучения Хэбба предполагает вычисление свертки предыдущих изменений выходов для определения изменения весов. Настоящий метод, называемый методом дифференциального обучения Хэбба, использует следующее равенство:

wij(t+1) =wij(t) + [OUTi(t) – OUTi(t–1)][ OUTj(t) – OUTj(t–1)],

где wij(t) – сила синапса от нейронаiк нейронуjв момент времени t; OUTi(t) – выходной уровень пресинаптического нейрона в момент времени t; OUTj(t)–выходной уровень постсинаптического нейрона в момент времени t.

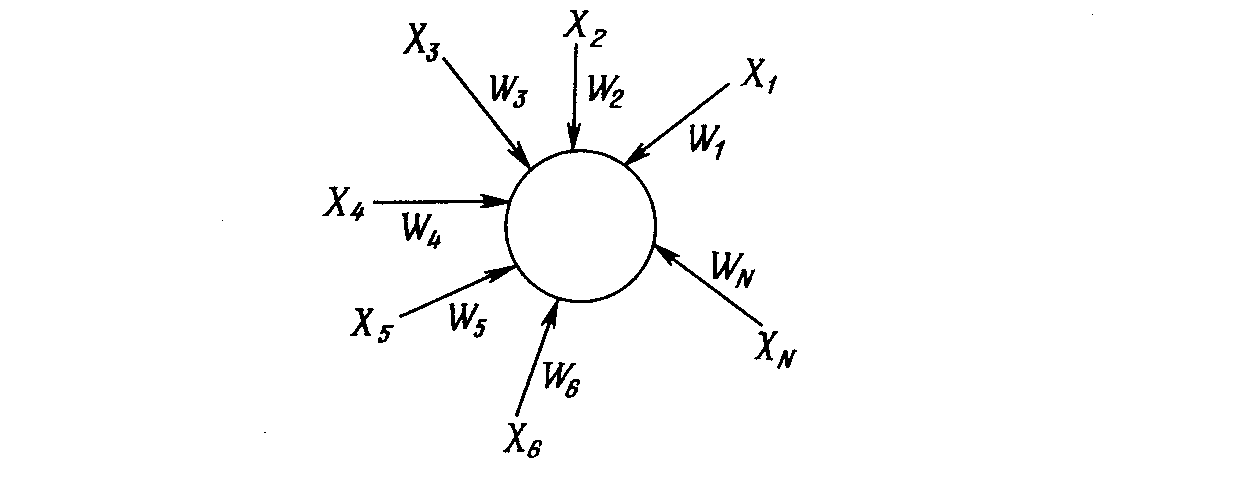

Рис. Б.1. Сеть «Инстар» Гроссберга

Входные и выходные звезды

Много общих идей, используемых в искусственных нейронных сетях, прослеживаются в работах Гроссберга; в качестве примера можно указать конфигурации входных и выходных звезд [I], используемые во многих сетевых парадигмах. Входная звезда, как показано на рис. Б.1, состоит из нейрона, на который подается группа входов через синапсические веса. Выходная звезда, показанная на рис. Б.2, является нейроном, управляющим группой весов. Входные и выходные звезды могут быть взаимно соединены в сети любой сложности; Гроссберг рассматривает их как модель определенных биологических функций. Вид звезды определяет ее название, однако звезды обычно изображаются в сети иначе.

Рис. Б.2. Сеть «Аутстар» Гроссберга

Обучение входной звезды

Входная звезда выполняет распознавание образов, т. е. она обучается реагировать на определенный входной вектор Хи ни на какой другой. Это обучение реализуется путем настройки весов таким образом, чтобы они соответствовали входному вектору. Выход входной звезды определяется как взвешенная сумма ее входов, как это описано в предыдущих разделах. С другой точки зрения, выход можно рассматривать как свертку входного вектора с весовым вектором, меру сходства нормализованных векторов. Следовательно, нейрон должен реагировать наиболее сильно на входной образ, которому был обучен.

Процесс обучения выражается следующим образом:

wi(t+1) =wi(t) +[xi–wi(t)],

где wi– вес входахi;хi–i–й вход;– нормирующий коэффициент обучения, который имеет начальное значение 0,1 и постепенно уменьшается в процессе обучения.

После завершения обучения предъявление входного вектора Хбудет активизировать обученный входной нейрон. Это можно рассматривать как единый обучающий цикл, еслиустановлен в 1, однако в этом случае исключается способность входной звезды к обобщению. Хорошо обученная входная звезда будет реагировать не только на определенный единичный вектор, но также и на незначительные изменения этого вектора. Это достигается постепенной настройкой нейронных весов при предъявлении в процессе обучения векторов, представляющих нормальные вариации входного вектора. Веса настраиваются таким образом, чтобы усреднить величины обучающих векторов, и нейроны получают способность реагировать на любой вектор этого класса.