NST4

.docx

Лабораторная работа № 4

Нейросетевая компрессия информации

Цель: исследовать особенности сжатия данных с помощью нейронных сетей.

Задание:

В соответствии с вариантом задания построить нейронную сеть, осуществляющую понижение размерности пространства признаков.

Для этого

-

Сформировать обучающую и тестовую выборки

-

Выполнить предварительную обработку данных;

-

Построить многослойный персептрон типа «бутылочное горлышко» и выполнить ее обучение;

-

Выполнить интерпретацию полученных результатов;

-

Протестировать сеть;

-

На основе полученной сети построить две нейронные сети, осуществляющие кодирование и декодирование информации;

-

Оценить точность работы полученных сетей.

Варианты заданий

|

Номер варианта |

Количество переменных |

Диапазон изменения переменных |

Степень сжатия, % |

||

|

Min |

Max |

||||

|

6 |

6 |

-44 |

16 |

41 |

|

Ход работы:

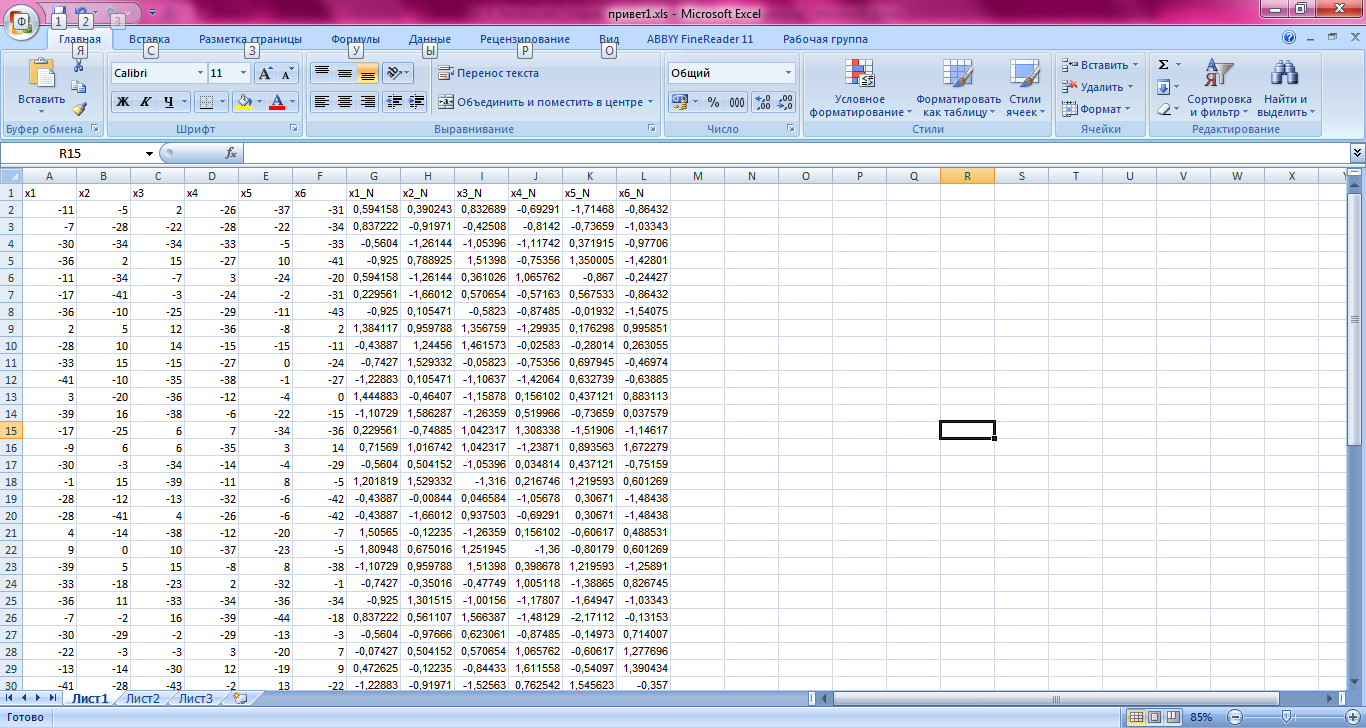

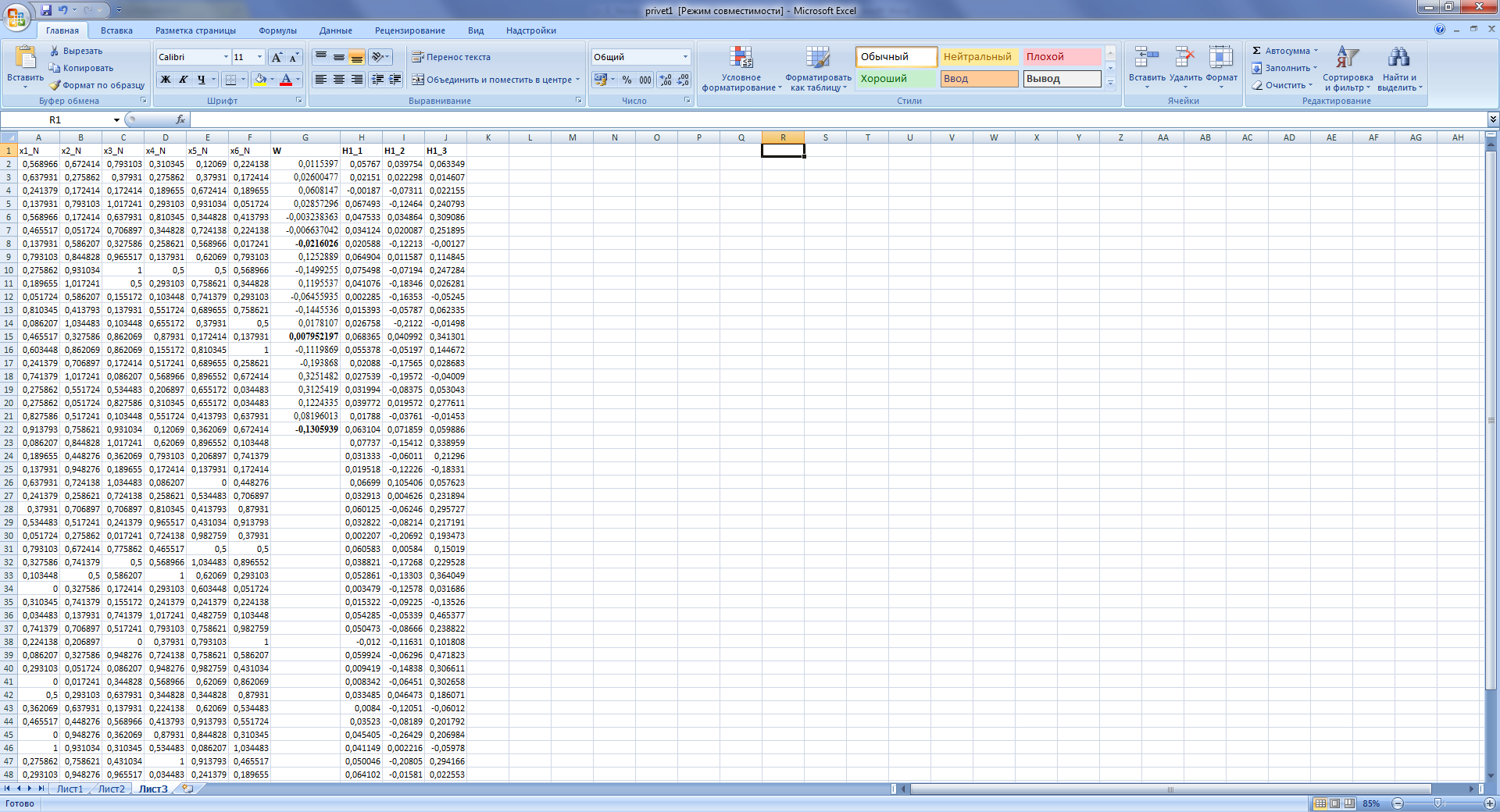

Рисунок 1 – Исходные нормализованные данные

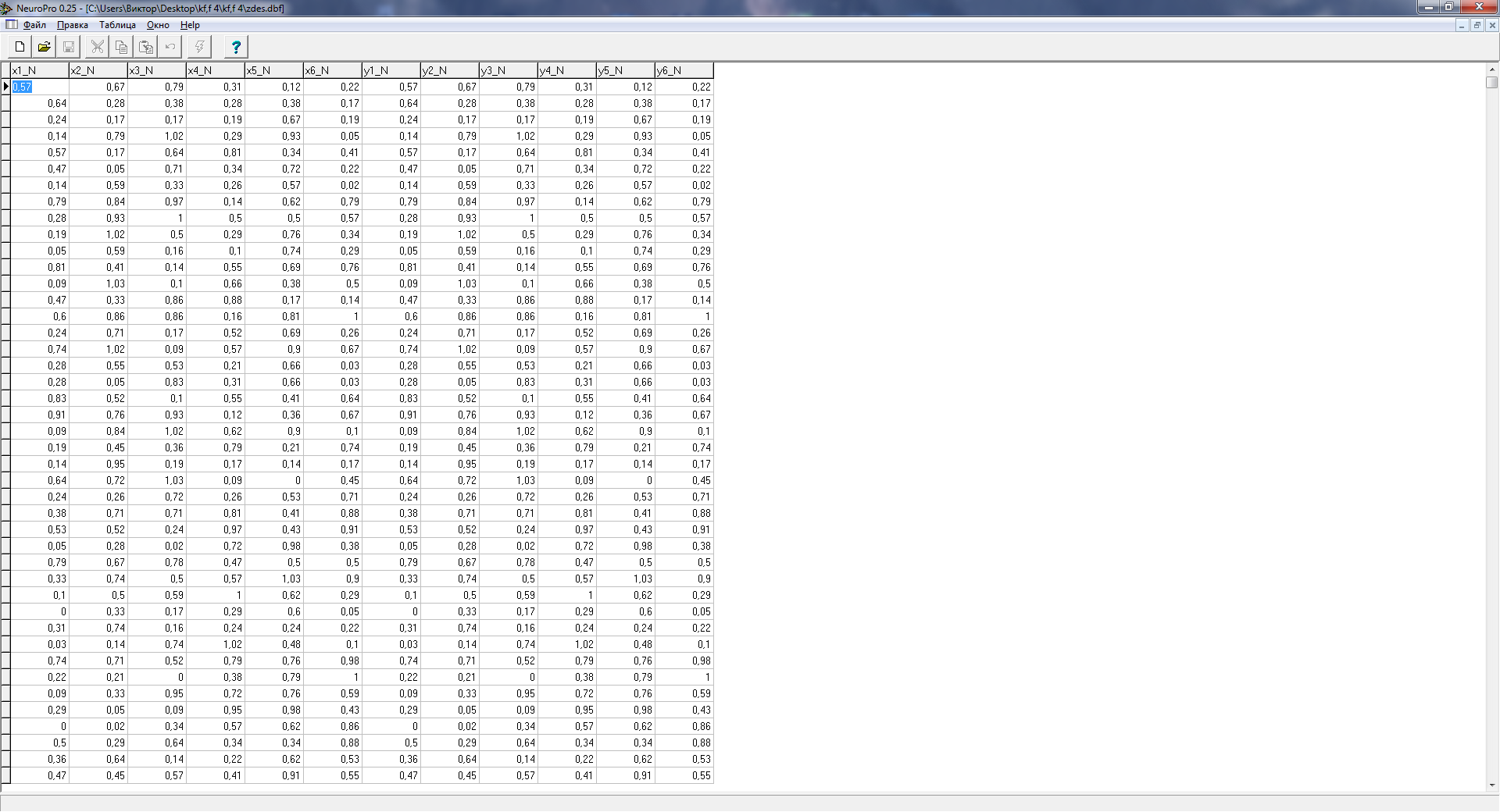

Рисунок 2 – Подключение таблицы из Excel в NeuroPro

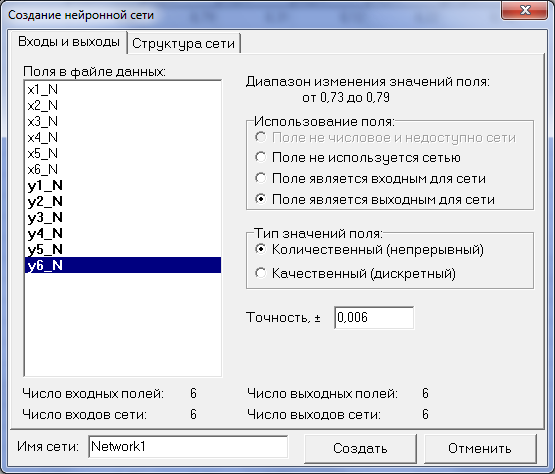

Рисунок 3 – Задание входных и выходных параметров, создание структуры сети

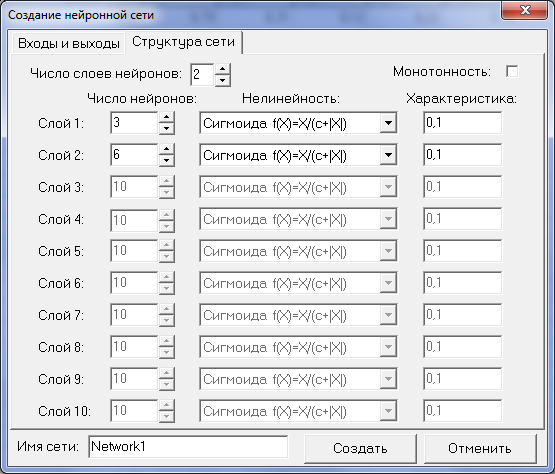

Предобработка входных полей БД для подачи сети:

x1_N=(x1_N-0,5)/0,5

x2_N=(x2_N-0,515)/0,515

x3_N=(x3_N-0,515)/0,515

x4_N=(x4_N-0,525)/0,495

x5_N=(x5_N-0,515)/0,515

x6_N=(x6_N-0,525)/0,505

Функциональные преобразователи:

Сигмоида1(A)=A/(0,1+|A|)

Сигмоида2(A)=A/(0,1+|A|)

Синдромы 1-го уровня:

Синдром1_1=Сигмоида1( 0,0115397*x1_N+0,02600477*x2_N+0,0608147*x3_N+0,02857296*x4_N-0,003238363*x5_N-0,006637042*x6_N-0,0216026 )

Синдром1_2=Сигмоида1( 0,1252889*x1_N-0,1499255*x2_N+0,1195537*x3_N-0,06455935*x4_N-0,1445536*x5_N+0,0178107*x6_N+0,007952197 )

Синдром1_3=Сигмоида1( -0,1119869*x1_N-0,193868*x2_N+0,3251482*x3_N+0,3125419*x4_N+0,1224335*x5_N+0,08196013*x6_N-0,1305939 )

Синдромы 2-го уровня:

Синдром2_1=Сигмоида2( Синдром1_1-0,9620309*Синдром1_2-0,9397595*Синдром1_3-0,1877135 )

Синдром2_2=Сигмоида2( 0,5116369*Синдром1_1+0,1438671*Синдром1_2-0,2523591*Синдром1_3+0,09993099 )

Синдром2_3=Сигмоида2( 0,7052032*Синдром1_1-0,5454418*Синдром1_2+0,2004363*Синдром1_3+0,02592951 )

Синдром2_4=Сигмоида2( 0,5537018*Синдром1_1+Синдром1_2-0,4033887*Синдром1_3+0,2543466 )

Синдром2_5=Сигмоида2( -0,8101635*Синдром1_1-0,3095433*Синдром1_2-0,2513136*Синдром1_3-0,3230497 )

Синдром2_6=Сигмоида2( Синдром1_1-0,9315369*Синдром1_2-0,9004921*Синдром1_3+0,01486009 )

Конечные синдромы:

y1_N=9,619367E-5*Синдром2_1+0,0006514195*Синдром2_2-0,0008888671*Синдром2_3-0,001115586*Синдром2_4-0,0003539126*Синдром2_5-0,0002791153*Синдром2_6-0,0002235144

y2_N=-Синдром2_1+0,2438735*Синдром2_2+0,3874097*Синдром2_3+0,7686111*Синдром2_4+0,4181506*Синдром2_5+0,9655285*Синдром2_6-0,2861143

y3_N=-0,376925*Синдром2_1+0,9231987*Синдром2_2+0,2727058*Синдром2_3-0,3485212*Синдром2_4-0,1072141*Синдром2_5+0,6964793*Синдром2_6-0,2496327

y4_N=0,9999743*Синдром2_1+0,2746642*Синдром2_2-0,07537657*Синдром2_3-0,1223722*Синдром2_4-Синдром2_5-0,7910941*Синдром2_6-0,08014203

y5_N=-Синдром2_1-0,160685*Синдром2_2+0,6367071*Синдром2_3+0,1824809*Синдром2_4+0,3069167*Синдром2_5+0,5815507*Синдром2_6+0,06958075

y6_N=0,8382754*Синдром2_1-Синдром2_2+0,5680104*Синдром2_3+0,5931747*Синдром2_4+0,04971866*Синдром2_5-0,3855123*Синдром2_6+0,3214951

Постобработка конечных синдромов:

y1_N=((y1_N*0)+1,51999998092651)/2)

y2_N=((y2_N*0,0600000023841858)+1,52000004053116)/2)

y3_N=((y3_N*0,0600000023841858)+1,52000004053116)/2)

y4_N=((y4_N*0,0600000023841858)+1,52000004053116)/2)

y5_N=((y5_N*0,0600000023841858)+1,52000004053116)/2)

y6_N=((y6_N*0,0600000023841858)+1,52000004053116)/2)

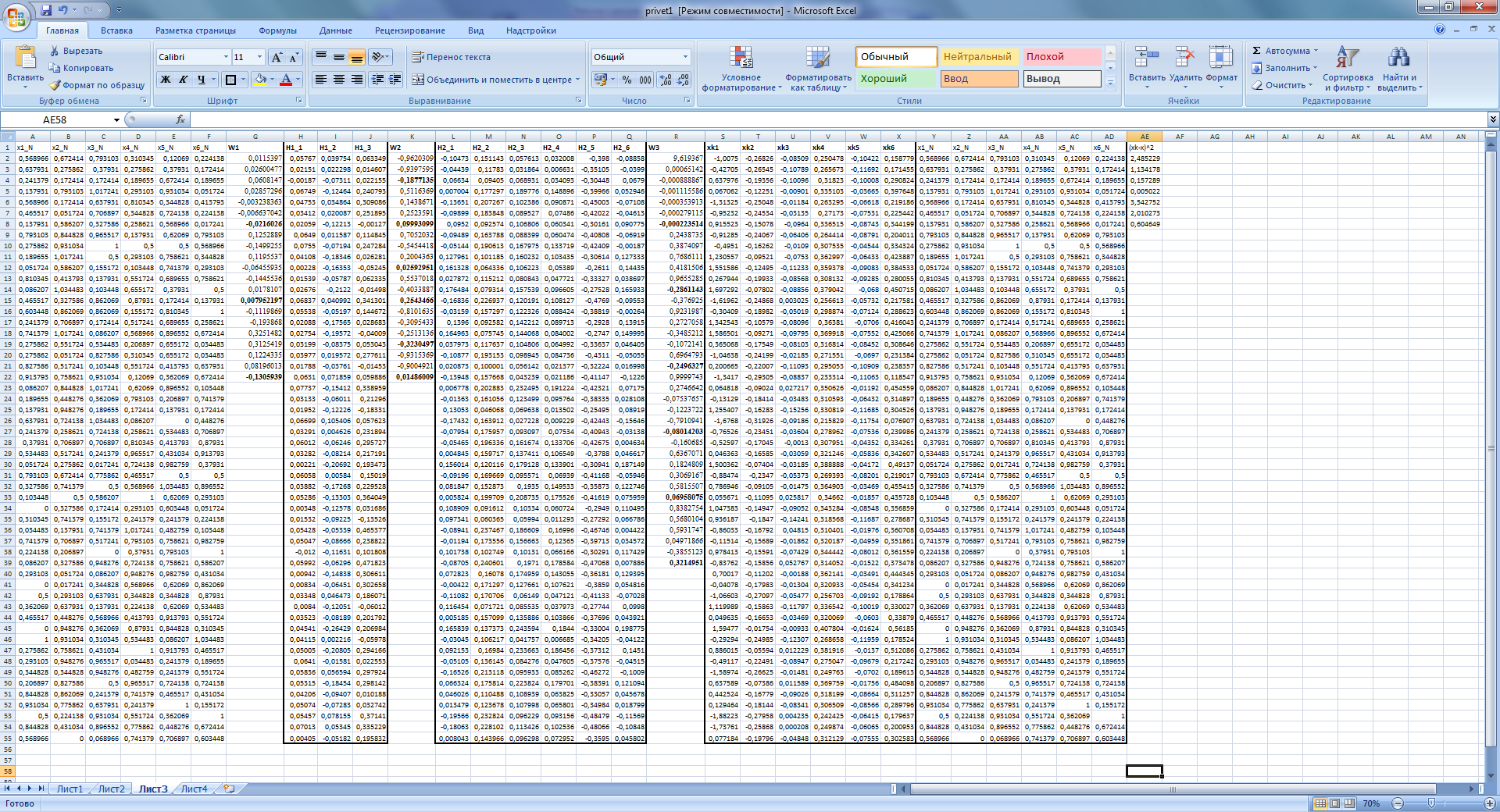

Рисунок 4 – Кодирование информации

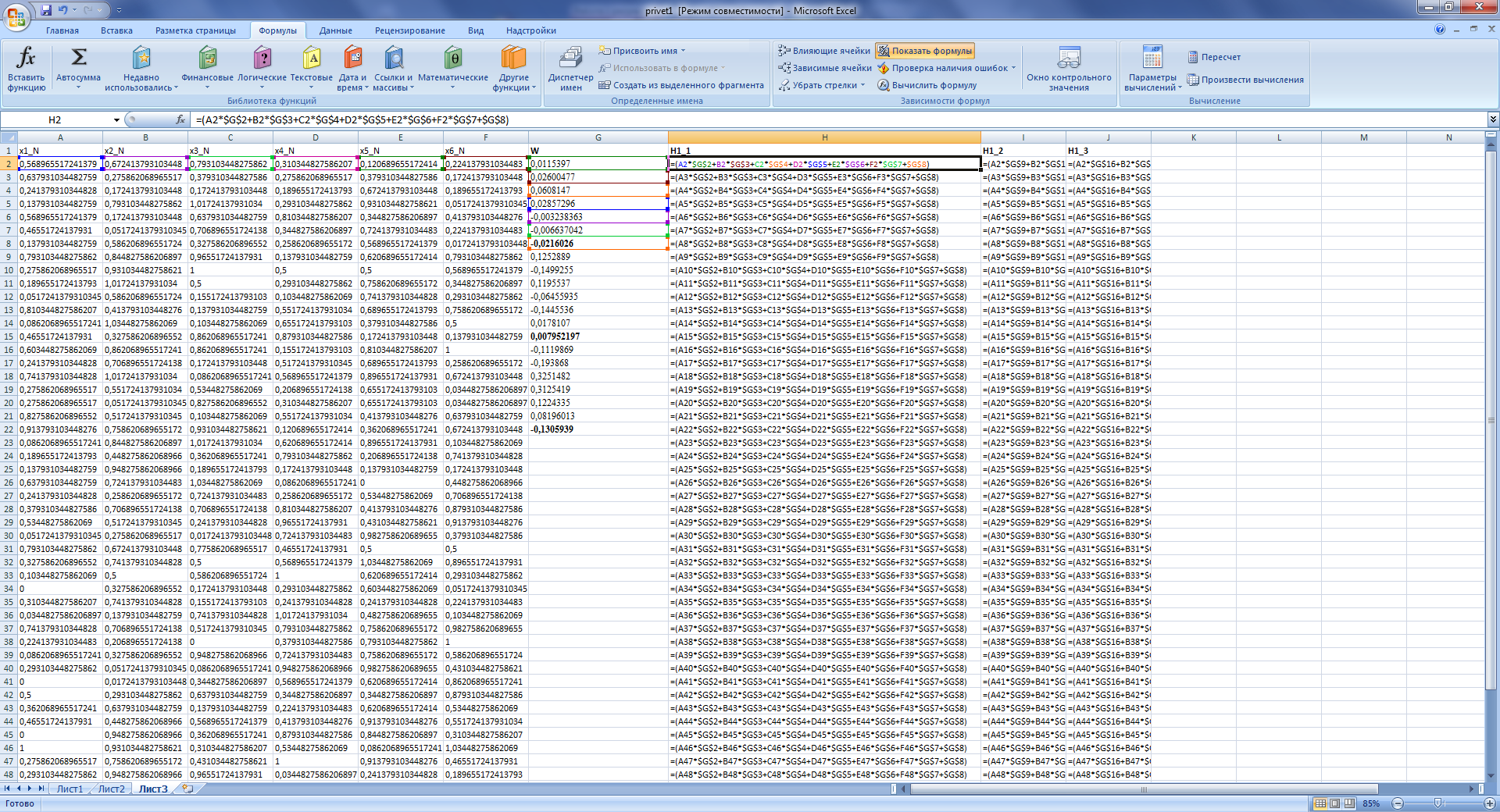

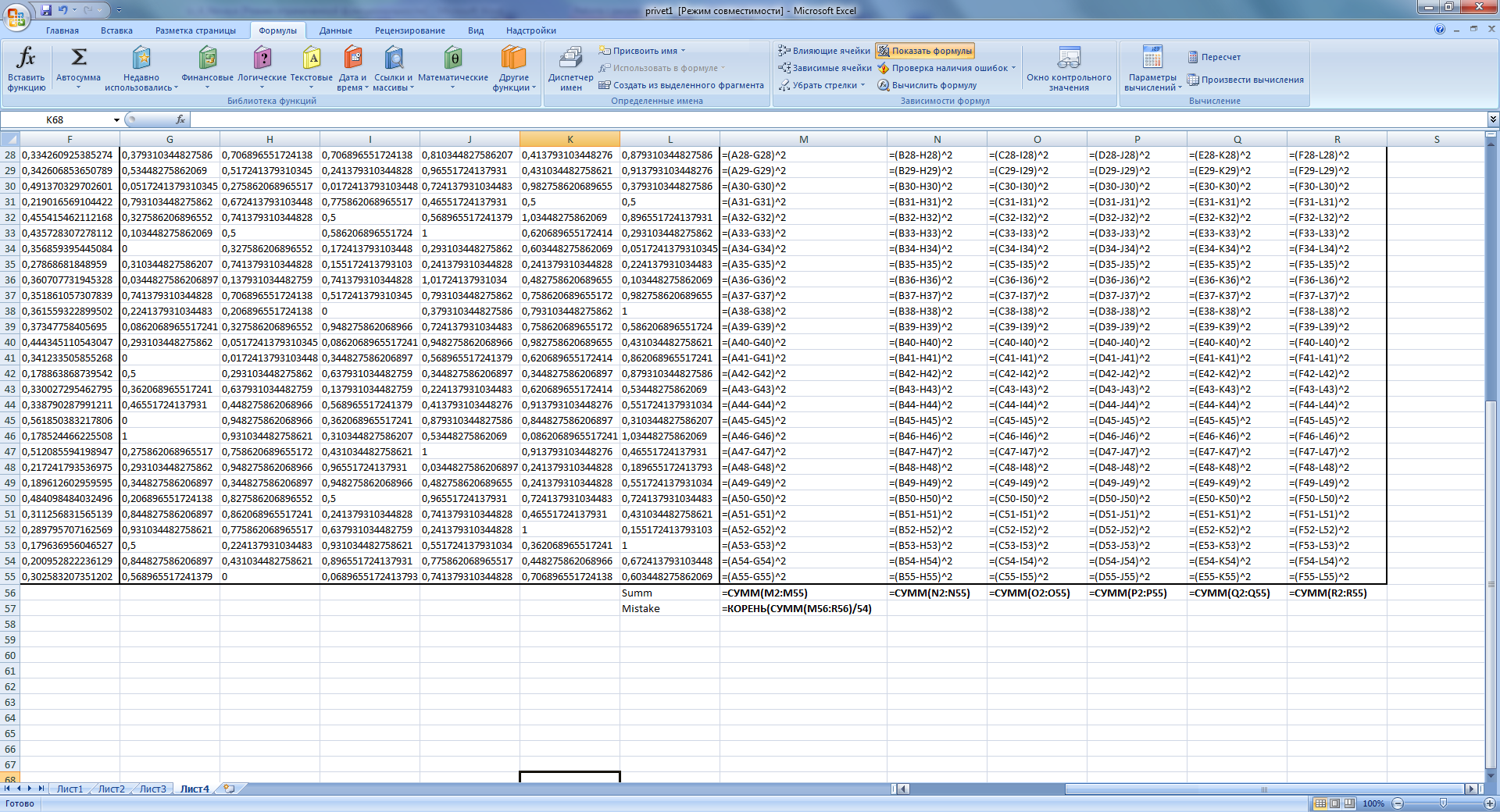

Рисунок 5 – Лист с формулами

Рисунок 6 – Декодирование информации

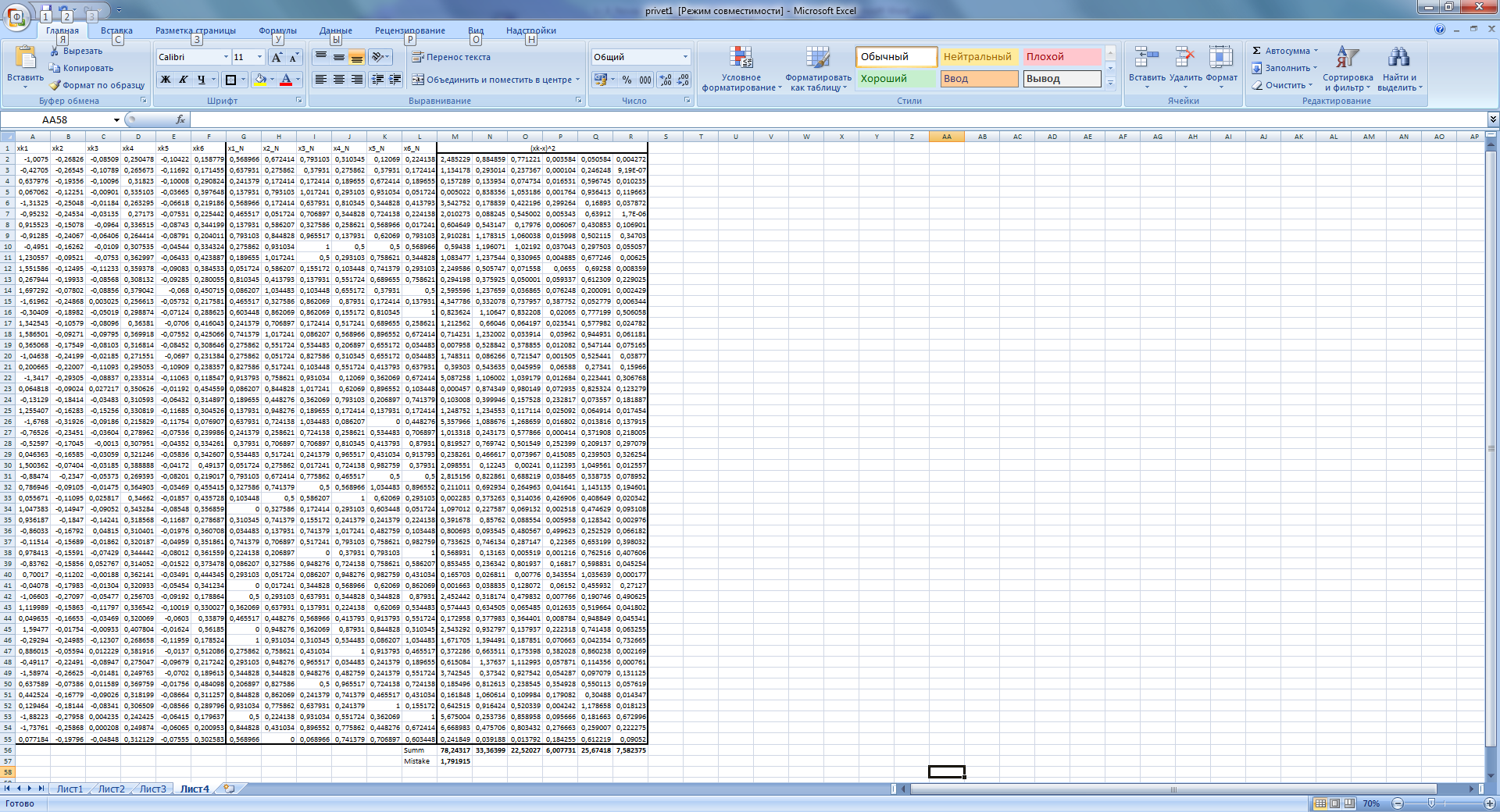

Рисунок 7 – Определение ошибки

Рисунок 8 – Лист с формулами

Вывод: в результате данной лабораторной работы я исследовала особенности сжатия данных с помощью нейронных сетей; построила нейронную сеть, осуществляющую понижение размерности пространства признаков. Построен многослойный персептрон типа «бутылочное горлышко» (степень сжатия 41%, т.е. 3 нейрона в самом узком скрытом слое), выполнено его обучение и тестирование, на основе полученной сети построены две нейронные сети, осуществляющие кодирование и декодирование информации, а так же оценена степень потерь при сжатии.