- •1 Основные разделы кибернетики.

- •2 Основоположники кибернетики

- •3 Категория управления

- •4 Определение Шеннона

- •6 Дискретная (цифровая) и непрерывная (аналоговая) информация

- •7 Процесс дискретизации

- •9 Теорема Найквиста

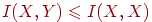

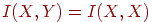

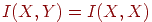

- •10 Вероятностный подход к измерению дискретной и непрерывной информации

- •11 Информационная энтропия

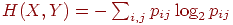

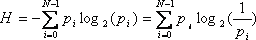

- •12 Энтропия Шеннона

- •13 Измерение количества информации

- •14 Измерение количества энтропии

- •16 Источник информации

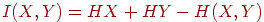

- •18 Условная энтропия

- •19 Полная энтропия Энтропия — это количество информации, приходящейся на одно элементарное сообщение источника, вырабатывающего статистически независимые сообщения. Математические свойства

- •20 Случайная средняя энтропия

9 Теорема Найквиста

Частота Найквиста — в цифровой обработке сигналов частота, равная половине частоты дискретизации. Названа в честь Гарри Найквиста. Из теоремы Котельникова следует, что при дискретизации аналогового сигнала потерь информации не будет только в том случае, если (спектральная плотность) наивысшая частота полезного сигнала равна половине или меньше частоты дискретизации.

В

области цифровой обработки сигналов Теорема

Котельникова (в

англоязычной литературе — теорема

Найквиста — Шеннона, или

теорема отсчётов) связывает

аналоговыеидискретныесигналы

и гласит, что, еслианалоговый

сигнал![]() имеет

конечный (ограниченный по ширине)спектр,

то он может быть восстановлен однозначно

и без потерь по своимотсчётам,

взятым с частотой, большей или равной

удвоенной верхней частоте

имеет

конечный (ограниченный по ширине)спектр,

то он может быть восстановлен однозначно

и без потерь по своимотсчётам,

взятым с частотой, большей или равной

удвоенной верхней частоте![]() :

:

![]()

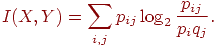

10 Вероятностный подход к измерению дискретной и непрерывной информации

В

основе теории информации лежит

предложенный Шенноном способ измерения

кол-ва инф, содержащейся в одной случ

величине, отн-но др случ величины, Этот

способ приводит к выражению кол-ва инф

числом. Для дискретных случ величин ![]() и

и ![]() ,

заданных законами распределения

,

заданных законами распределения ![]() ,

, ![]() и

совместным распределением

и

совместным распределением ![]() , кол-во

инф,

содержащейся в

, кол-во

инф,

содержащейся в ![]() отн-но

отн-но ![]() ,

равно

,

равно

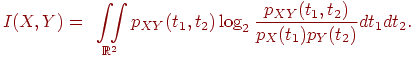

Для

непрерывных случ величин, ![]() и

и ![]() ,

заданных плотностями распределения

вероятностей

,

заданных плотностями распределения

вероятностей ![]() ,

, ![]() и

и ![]() ,

аналогичная формула имеет вид

,

аналогичная формула имеет вид

.

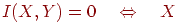

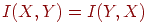

Очевидно, что

.

Очевидно, что

и,

следовательно,

и,

следовательно,

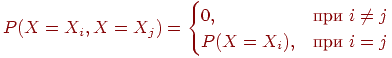

11 Информационная энтропия

Информационная

энтропия —

мера неопределённости или

непредсказуемости информации,

неопределённость появления какого-либо

символа первичного

алфавита.

При отсутствии информационных потерь

численно равна количеству информации

на символ передаваемого сообщения.

Энтропия —

это кол-тво инф, приходящейся на одно

элементарное сообщение источника,

вырабатывающего статистически независимые

сообщения. Энтропия дискретной

случ величины ![]() в

теории инф определяется формулой

в

теории инф определяется формулой

![]()

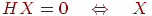

Св-ва меры инф и энтропии:

,

,  и

и  независимы;

независимы; ;

; -

константа;

-

константа; ,

где

,

где  ;

; .

Если

.

Если  ,

то

,

то  -

ф-ция от

-

ф-ция от  .

Если

.

Если  -

инъективная функция от

-

инъективная функция от  ,

то

,

то .

.

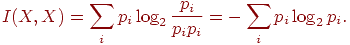

12 Энтропия Шеннона

В общем случае, энтропия H и количество получаемой в результате снятия неопределенности информацииI зависят от исходного количества рассматриваемых вариантов N и априорных вероятностей реализации каждого из них P: {p0, p1, …pN-1}, т.е. H=F(N, P). Расчет энтропии в этом случае производится по формуле Шеннона, предложенной им в 1948 году в статье "Математическая теория связи".

В частном случае, когда все варианты равновероятны, остается зависимость только от количества рассматриваемых вариантов, т.е. H=F(N). В этом случае формула Шеннона значительно упрощается и совпадает с формулой Хартли, которая впервые была предложена американским инженером Ральфом Хартли в 1928 году, т.е. не 20 лет раньше. Формула Шеннона имеет следующий вид:

(1)

(1)

Знак

минус в формуле (1) не означает, что

энтропия – отриц величина. Объясняется

это тем, что pi£1 по

определению, а логарифм числа меньшего

единицы - величина отрицательная. По

свойству логарифма  ,

поэтому эту формулу можно записать и

во втором варианте, без минуса перед

знаком суммы.

,

поэтому эту формулу можно записать и

во втором варианте, без минуса перед

знаком суммы.

интерпретируется

как частное кол-во инф

интерпретируется

как частное кол-во инф![]() ,

получаемое в случае реализации i-ого

варианта. Энтропия в формуле Шеннона

является средней характеристикой –

математическим ожиданием распределения

случ величины {I0, I1, … IN-1}.

,

получаемое в случае реализации i-ого

варианта. Энтропия в формуле Шеннона

является средней характеристикой –

математическим ожиданием распределения

случ величины {I0, I1, … IN-1}.