- •Понятие данных

- •Информация и данные. Понятие о структурах данных. Информационная модель объекта

- •Понятие о данных

- •Понятие о структурах данных

- •Структуры данных и их классификация (списки, таблицы, деревья, сети).

- •Таблицы

- •Деревья

- •Понятие о типе данных в языках программирования

- •14101954

- •6. Понятие о типе данных в языках программирования (яп).

- •Декомпозиция и абстракция, их применение в программировании.

- •Абстракция и декомпозиция. Их взаимодействие при проектировании программ.

- •Абстракция – это отвлечение от всего несущественного с целью лучше понять какую-либо одну строну изучаемого предмета или явления, и в тоже время – это путь к созданию абстрактных понятий.

- •15. Реализация абстракций данных . Функция абстракции. Операции Up и Down.

- •Функция абстракции

- •Функция инвариант представления

- •Сохранение инварианта представления

- •Анализ программ, не содержащих ветвлений

- •Если p{ а }q иQ{ b }r, то выполняется p{ a;b }r.

- •P{ a;b }r.

- •Проектирование цикла с помощью инварианта Задача 1. Найти сумму величин 1/I от 1 до тех пор, пока она не станет больше некоторого наперед заданного числа a.

- •Будем искать решение нашей задачи в виде цикла, имеющего следующий вид:

ВВЕДЕHИЕ

================================== Орзова ===================================

Понятие информации

Понятие "информация" (от лат. informatio - сведения, разъяснения, изложение) многозначно и поэтому строго определено быть не может. В широком смысле информация - это отражение реального (материального, предметного) мира, выражаемое в виде сигналов и знаков. То есть это сведения об окружающем мире, которые могут воспринимать устройства. Информация характеризуется такими свойствами как достоверность, полнота, актуальность, полезность, понятность.

Люди всегда изыскивали возможность сделать хранилища информации более компактными, что позволяло делать необходимую информацию транспортабельной, более удобной для хранения, а также ограничивало доступ к ней нежелательных лиц. Поэтому и появились глиняные таблички, бумага … и магнитные носители, а вместе с ними и книгопечатание, почта … и устройства переработки информации (компьютер).

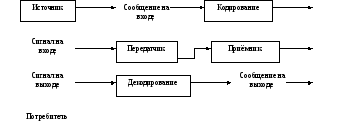

Современные средства передачи информации используют классическую схему Шеннона:

Объем информации измеряется в единицах информации. Наиболее надежной является BIT(Binary dIgiT), это связано с каналом связи. Информация передается от источника к приемнику в виде сообщения. Чем более маловероятным является событие, тем большее количество информации это сообщение несет. То есть количество информации это мера уменьшения неопределенности множества событий. Сообщение информативно, если оно уменьшает неопределенность. Наименее информативное сообщение 0/1. Пусть С={С1, С2, С3, …, Сn} множество вариантов исхода некоторого события, тогда информативное сообщение это один из n вариантов исхода. Log2N служит для измерения количества информации. Если N степень двойки, то для определения исхода достаточно задать Log2N двоичных вопросов, иначе [Log2N]+1.

Пример:

1)Минимальное количество двоичных цифр, необходимое для того, чтобы закодировать любое число из диапазона 0, 1, …, N, равняется [Log2N]+1.

2)Пусть дано С={С1, С2, С3, С4}. События из этого множества имеют разную вероятность:

p1=1/2, p2=1/4, p3=1/8, p4=1/8

1. Произошло ли С1? 0/1 - С1

2. Произошло ли с2? 00/01 - С2

3. Произошло ли С3? 000/001 - С3 (С4 - 000)

или: С1=00, С2=01, С3=10, С4=11

В первом случае длина 200 сообщений = 100*1+50*2+25*3+25*3=350, то есть средняя длинна сообщения 1,75. Во втором случае это 2.

Мера неопределенности множества событий С={С1, С2, С3, …, Сn} называется энтропией и вычисляется по формуле:

![]()

По смыслу количество информации противоположно энтропии: I(C)=-H(C), H(C)<0

Пример:

В

первом случае

![]() ,

,

Во

втором:

![]()

Теорема Величина I(c) максимальна в случае, когда события равновероятны, и равна Log2N, если N степень двойки, и равна[Log2N]+1 в противном случае.

================================ Information ====================

Что такое информация?

Вообще существует несколько взглядов на то, что принято считать информацией. Один взгляд, и его, по-видимому, придерживается большая часть специалистов и неспециалистов сводится к тому, что существует как бы два сорта информации:

1).Информация техническая, которая передаётся по телеграфным линиям и отображается на экранах радиолокаторов. Количество такой информации может быть точно вычислено, и процессы, происходящие с такой информацией, подчиняются физическим законам.

2). Информация семантическая, то есть смысловая. Это та самая информация, которая содержится, к примеру, в литературном произведении. Для такой информации предлагаются различные количественные оценки и даже строятся математические теории. Но общее мнение скорее сводится к тому, что оценки здесь весьма условны и приблизительны и алгеброй гармонию всё-таки не проверишь.

Второй взгляд состоит в том, что информация - это физическая величина, такая же, как, например, энергия или скорость. Определённым образом и в определённых условиях информация равным образом описывает как процессы, происходящие в естественных физических системах, так и процессы в системах, искусственно созданных.

Как всегда, при наличии двух резко противоположных мнений существует и третье, примиряющее. Сторонники третьего подхода считают, что информация едина, но вот количественные оценки должны быть разными. Отдельно нужно измерять количество информации, причём количество информации - строгая оценка, относительно которой можно развивать строгую единую теорию. Кроме количества информации, следует измерять ещё и ценность. А вот с ценностью информации происходит то же самое, что и с понятием семантической информации. С одной стороны, вроде её можно вычислить, а с другой стороны, все эти вычисления справедливы лишь в ограниченном числе случаев. И вообще, кто может точно вычислить, скажем, ценность крупного научного открытия?

Бурное развитие науки и промышленности в XX веке, неудержимый рост объёмов поступающей информации привели к тому, что человек оказался не в состоянии воспринимать и перерабатывать всё ему предназначенное. Возникла необходимость классифицировать поступления по темам, организовывать их хранение, доступ к ним, понять закономерности движения информации в различных изданиях и т.д. Исследования, позволяющие разрешить возникшие проблемы, стали называть информатикой.

В общем случае передача информации может быть записана таким образом:

Источник

Потребитель

Канал связи

Количество информации

Информация - произвольная последовательность символов, т.е. любое слово, каждый новый символ увеличивает количество информации. Как же измерить количество информации? Для этого, как впрочем, и для измерения длины, массы и т.д. нужен эталон. Какое же слово взять в качестве эталона информации? Прежде, чем выбрать это слово необходимо выбрать алфавит - материал, из которого будет сделано это слово. Обычно алфавит берут двухсимвольным. Например, он может состоять из цифр 1 и 0. Эталоном считается слово, состоящее из одного символа такого алфавита. Количество информации, содержащееся в этом слове, принимают за единицу, названную 1 битом 0. Имея эталон количества информации можно сравнить любое слово с эталоном. Проще сравнивать те слова, которые записаны в том же двухсимвольном алфавите.

Итак, получаем, что количество информации – это мера уменьшения неопределенности некоторой ситуации.

За объем информации принимается сообщение минимальной длины.

Если N=2n, то для его записи необходимо n+1 бит (иначе [log2N]+1). Минимальное число бит для записи любого числа из диапазона 0 – N.

Определение: измерение информации, основанное на подсчете числа символов в сообщении, называется объёмом информации.

Кодирование информации:

Определение: кодирование – это запись информации по определенным правилам.

Параметры информации:

объём;

время передачи;

надежность;

защита от помех;

технические удобства;

защита от несанкционированного доступа.

1.1. ПОHЯТИЕ О СТРУКТУРАХ ДАHHЫХ

1.1.1. Моделирование задач на ЭВМ

ИМЕЕМ: объект исследования.

ОСHОВHАЯ ЦЕЛЬ: научиться предсказывать поведение объекта, т.е. как изменение одних свойств влияет на другие.

ОДИH ИЗ СПОСОБОВ РЕШЕHИЯ: моделирование на ЭВМ.

ОСHОВHАЯ ЗАДАЧА: научиться делать это оптимально.

У исследуемого объекта выделяем свойства объекта, т. е. те его стороны, для исследования взаимосвязи которых и решается задача. Все объекты, участвующие в решении задачи с набором сущесвенных для задачи свойств составляют предметную область задачи.

Затем описываем изучаемый объект с информационной стороны, т.е. строим информационную модель объекта. Сюда включается информация только о существенных для данной задачи свойствах. Информационная модель строится из набора одинаковых объектов и является изображением (описанием) объекта при решении задачи. В информационной модели каждому свойству соответствует атрибут. Атрибут может принимать значения только из области дупустимых значений.

Атрибутом является логически неделимый элемент информации об объекте, который может быть связан с другими элементами. Связи между атрибутами определяются связями между свойствами, присущими объектам предметной области. Атрибуты могут меняться с теечением времени. По отношению к внешней среде объекта все атрибуты можно разделить на входные, внутренние и выходные.

Вектор входных атрибутов Вектор выходных атрибутов

--- ---

X --- Объект --- Y

--- ---

С

Вектор внутренних атрибутов

Через X внешняя среда влияет на объект. C определяет конфигурацию (состояние) объекта в данный момент. Y указывает через какие атрибуты объект воздействует на внешнюю среду.

============================== Белова Наталия =================================

-

Материальный мир

Область информации

Область логических данных

Область физических данных

О п и с а н и е

Предметная область (ПО)

Объекты и их свойства.

Информационная модель предметной области (ИМ)

Описание (изображение) предметной области на некотором языке с информационной точки зрения.

Экземпляры информационной модели, атрибуты и их значения.

Абстрактная структура данных

Погрузить

информационную модель в абстрактную

структуру данных.

Погрузить

информационную модель в абстрактную

структуру данных.Логические записи и элементы данных.

Конкретные структуры данных в языке программирования

Реализация структуры данных в языке программирования.

Физические записи и способы их хранения в оперативной памяти.

П р и м е р ы

масса

масса ускорение

ускорениесила

цвет

цвет …

…ІІ Закон Ньютона

цвет - красный

F = m * a

(обозначение и способ интерпретации)

Информационное сообщение: цвет шарика - красный

F := massa *

* uskor

или

massa:= F / uskor

cvet := red

0

0

0

0

0

0

1

1

(1) (3)

(2)

1) Изучение (этап преобразования из ПО в ИМ)

Результат: постановка задачи.

2) Проектировка ( этап преобразования из ИМ в область логич. данных)

Результат: проект (алгоритм + структура данных).

3) Реализация

Результат: программа.

Материальный мир Область информации Область логических данных Область физических данных

Предметная область Информационная модель Совокупность логических записей Совокупность физических записей

Объекты и их свойства Описание предметной Логическая запись представляет Физическая запись представляет собой

области на некотором собой совокупность взаимосвязанных совокупность взаимосвязанных данных,

языке элементов данных хранящихся определенным образом

на физическом носителе

Терминология

Объект экземпляр модели логическая запись физическая запись

Свойство атрибут элемент данных поле носитеся

Пример 1

Второй закон Hьютона

( ) F=m*a, F := Massa*Uskor, Hа физическом уровне мы

I--- масса должны расположить эти переменные

I--- сила т.е. для записи отноше- т.е. мы можем на основе на некотором носителе и выбрать способ

I--- ускорение ний между массой, силой этого закона предсказывать представления их зачений (систему

и ускорением здесь ис- изменение силы на основе кодировки)

Второй закон Hьютона пользован язык математики. знаний о массе и ускорении.

утверждает, что сила Свойства объекта заменены Здесь F, Massa и Uskor -

пропорциональна обозначениями атрибутов и это переменные, используемые

массе и ускорению задана интерпретация этих в алгоритме. Этот закон можно

обозначений использовать и в другом виде.

Hапример,

Massa := F/Uskor

Пример 2

Шарик

( )

I--- цвет

Состояние шарика - Информационное сообщение: Последовательность символов на Состояние поля носителя информации:

он красный шарик красный логическом уровне: Red 00000011

================================== Ткаченко ==================================

Понятие данных

Кодирование информации

Кодирование информации – это запись информации по определенным правилам. Передача информации определяется следующими параметрами:

- Объем информации

- Время передачи информации

- Защита от помех

- Технические удобства передачи информации

- защита от несанкционированного доступа

Данные – это застывшая информация, информация после кодирования.

Этапы преобразования информации при решении задач на ЭВМ

Предметная область – это выделение из окружающего мира объектов и их свойств, важных для решения данной задачи. Предметная область описывается на языке предметной области. Наиболее эффективным языком предметной области есть язык математики.

Информационная модель предметной области – это изображение предметной области с точки зрения решаемой задачи.

База данных – описание предметной области с точки зрения решения нескольких задач.

При переходе к предметной области свойства объектов переходят в атрибуты.

Атрибут – элемент информационной модели, описывающий соответствующие свойства объекта. Каждому атрибуту соответствует множество допустимых значений. Атрибут – это неделимый элемент информации.

Классы атрибутов:

Входные атрибуты X: с их помощью среда воздействует на объект, и он выдает выходные атрибуты;

В

ыходные

атрибуты Y;

ыходные

атрибуты Y;В

нутренние

атрибуты C .

нутренние

атрибуты C .

Ключевой атрибут - атрибут, однозначно идентифицирующий объект в совокупности.

Вектор Вектор выходных

входных атрибутов (Y)

атрибутов (Х)

Вектор внутренних атрибутов

(С) – состояние объекта в определенный момент времени.

Возникает необходимость связать значения этих атрибутов с устойчивыми состояниями объектов. Так мы приходим к понятию «данные»

Данные – это изображение информации, описание состояния некоторого носителя. Иногда данные называют «застывшая информация». Информация – активна, данные – пассивны.

С

каждым объектом связан способ

преобразования, язык интерпретации

данных. Язык интерпретации данных имеет

свой алфавит

![]() С помощью символов этого алфавита

сообщение представляется в виде строкиS=

С помощью символов этого алфавита

сообщение представляется в виде строкиS=

![]() ,

где каждое

,

где каждое![]() - это какое-то

- это какое-то![]() .

Строка естественным образом разбивается

на фрагменты (слова). Каждое слово

является изображением какого-то атрибута.

Именно это слово называетсяэлемент

данных.

.

Строка естественным образом разбивается

на фрагменты (слова). Каждое слово

является изображением какого-то атрибута.

Именно это слово называетсяэлемент

данных.

Элемент

данных – простейший

неделимый элемент данных. Строка S

называется логическим уровнем

представления данных. Каждый символ

![]() изображается в виде определенного

состояния

изображается в виде определенного

состояния![]() некоторой физической среды носителя.

некоторой физической среды носителя.![]() можно рассматривать как коды. Если

значение слов зафиксировать в соответствии

с кодом , то получим физический уровень

представления данных.

можно рассматривать как коды. Если

значение слов зафиксировать в соответствии

с кодом , то получим физический уровень

представления данных.

Механизм представления данных в виде состояний некоторой устойчивой среды.

Рассмотрим среду, в которой каждый элемент может находится в k устойчивых состояниях. Выберем среду, в которой m таких элементов.

Числа,

которые могут быть отображены в такой

среде, находятся в интервале от 0 до N-1,

где

![]() .

ЗафиксируемN

и попытаемся найти такое m,

чтобы представить числа от 0 до N-1.

Такое

.

ЗафиксируемN

и попытаемся найти такое m,

чтобы представить числа от 0 до N-1.

Такое

![]() (наименьшее

целое, которое больше либо равно выражению

в скобках).

Тогда число устойчивых состояний среду

для заданного N

равно Q(k)=m*k=k*

(наименьшее

целое, которое больше либо равно выражению

в скобках).

Тогда число устойчивых состояний среду

для заданного N

равно Q(k)=m*k=k*![]() .

.

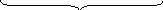

Найдем такое k, при котором число необходимых состояний среды было бы минимальным. Для этого

Поэтому наиболее экономная среда – среда с тремя устойчивыми состояниями.

В компьютере используется среда с двумя устойчивыми состояниями.

Число состояний можно понимать как число каких-то деталей(например зубчиков), которые нужно изготовить, чтобы представить число. Понятно, что среда тем надежнее, чем меньше количество деталей (меньшая вероятность сбоя, повреждения детали)

П ример.Сколько

нужно зубчиков, чтобы представить числа

от 0 до 999 при k=10,2,3

ример.Сколько

нужно зубчиков, чтобы представить числа

от 0 до 999 при k=10,2,3

Решение.

Q(10) = 3*10=30 зубчиков.

Q(2):

(1000<1024=![]() )

=> Q(2)=2*10=20

зубчиков

)

=> Q(2)=2*10=20

зубчиков

Q(3):

(1000<2187=![]() )

=> Q(3)=3*7=21

зубчиков, но диапазон представления

чисел – в 2 раза больше чем при k=2

)

=> Q(3)=3*7=21

зубчиков, но диапазон представления

чисел – в 2 раза больше чем при k=2

Системы кодирования с фиксированным числом разрядов

- телеграфный код М2 – 6 двоичных разрядов (64 значений )

- КОИ7 - 7 двоичных разрядов (128 значений )

- ДКОИ - 8 двоичных разрядов (хватало 128 значений )

- ASCII - 8 двоичных разрядов (256 значений )

-

UNICODE

- 16 двоичных разрядов (![]() значений )

значений )

- USC2 - 16 двоичных разрядов

- USC4 - 16 двоичных разрядов

Системы кодирования с переменным числом разрядов

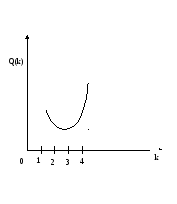

Код Хофмана – система с переменным числом, при которой ни у каких двух кодов нет общего начала. Символы кодируются в зависимости от частоты их в исходной строке.

Например. Закодировать строку

enndeddeqe

Сортируем символы по частоте: e,d,n,q

Строим бинарное дерево, как показано на рисунке

Тогда:

|

e |

n |

n |

d |

e |

d |

d |

e |

q |

e |

|

1 |

001 |

001 |

01 |

1 |

01 |

01 |

1 |

000 |

1 |

Шевлюк Ю.В. ПЗ-03-1 ===============================