- •1 Основные понятия и структурная схема приборного комплекса.

- •17 Принципы построения измерителей навигационных параметров в живом организме.

- •2.Комплексы оборудования самолетов.

- •10 . Основные направления развития исследований и систем искусственного интеллекта

- •4. Основные характеристики и требования, предъявляемые к системам отображения информации.

- •5. Навигационные комплексы. Общие сведения и классификация.

- •11.Диалоговые системы искусственного интеллекта.

- •12 Бионика, как наука.

- •6.Основные закономерности построения навигационных комплексов.

- •7.Навигационные комплексы на базе микропроцессоров.

- •8.Иерархические структуры навигационных комплексов. Системы искусственного интеллекта в навигационных комплексах.

- •18 Общие принципы построения биологических навигационных комплексов.

- •22 Интеллектуальный биологический навигационный комплекс.

- •9.Понятие об искусственном интеллекте. Интеллектуальные системы.

- •13 Обобщенная модель живого организма.

- •14 Основные функции живого организма.

- •15 Навигационная бионика. Общность задач и основных принципов навигации в живой природе и технике.

- •16 Общая характеристика методов навигации.

- •19 Информационное обеспечение пространственной навигации животных.

- •20 Обеспечение точности и надежности функционирования навигационных биосистем.

- •21 .Накопление априорной информации в биологических навигационных комплексах при обучении.

- •23 Основные особенности биологических навигационных комплексов.

- •24 Системы искусственного интеллекта – системы, базирующиеся на знаниях.

- •25 Основные структуры систем искусственного интеллекта.

- •26 Представление знаний.

- •27. Семантические сети.

- •28 Фреймовые модели.

- •29 Логические модели знаний и системы логического вывода.

- •30 Продукции и продукционные системы.

- •31. База знаний систем искусственного интеллекта.

- •32 Стратегия управления и механизм вывода в системах искусственного интеллекта.

- •33 Прямая цепочка рассуждений. База знаний. Обобщенный алгоритм работы.

- •34 Обратная цепочка рассуждений. Дерево решений. База знаний. Обобщенный алгоритм работы.

- •35 Общие методы поиска решений в пространстве состояний.

- •41)Нечеткие множества и лингвистические переменные.

- •42)Операции с нечеткими множествами.

- •37 Особенности разработки баз знаний бортовых экспертных систем.

- •43)Нечеткие алгоритмы.

- •47) Программная и аппаратная реализация нечетких регуляторов.

- •44)Общие принципы построения интеллектуальных систем управления на основе нечеткой логики.

- •45) Процедура синтеза нечетких регуляторов.

- •46) Синтез адаптивной сау с эталонной моделью на основе нечеткой логики.

- •48)Общая характеристика проблемы построения искусственных нейронных сетей. История проблемы.

- •49)Моделирование механизмов человеческого мышления. Модели нейронов.

- •50_Реализация логических функций на формальных нейронах. Проблема «Исключающего или».

- •51 .Искусственные нейронные сети. Общие положения.

- •52 . Персептрон ф. Розенблатта.

- •53 .Адаптивный пороговый элемент.

- •55. Общие принципы построения интеллектуальных сау с использованием нейронных сетей.

- •39 Нечеткая логика: история проблемы, практические приложения.

- •54. Многослойные персептроны. Алгоритм обратного распространения.

- •57 Применение нейронных сетей в задачах адаптации алгоритмов управления нелинейными объектами.

- •62. Нейрокомпьютер фирмы аас.

- •61. Способы реализации нейронных сетей. Примеры реализации нейрокомпьютеров.

- •1. Нейрокомпьютеры на базе транспьютеров.

- •58. Применение нейронных сетей в задачах идентификации математических моделей динамических объектов.

- •59 Обзор возможных вариантов построения нейронных сетей.

- •63.Генетические алгоритмы. Особенности построения и реализации

- •38 Системы искусственного интеллекта с использованием нечеткой логики.

- •36.Проблемы разработки бортовых оперативно-советующих экспертных систем.

54. Многослойные персептроны. Алгоритм обратного распространения.

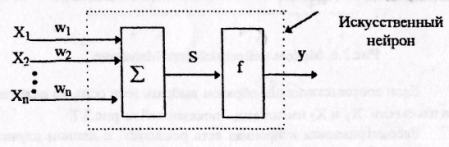

Прежде чем дать общую характеристику принципов построения многослойных персептронов и особенностей их функционирования, рассмотрим обобщенную модель нейроподобного элемента (нейрона). Данная модель приведена на рис. :

На

нейрон поступает набор входных сигналов

На

нейрон поступает набор входных сигналов

образующих входной вектор,

образующих входной вектор, который передает сигналы от других

нейронов. Каждый входной сигнал

который передает сигналы от других

нейронов. Каждый входной сигнал умножается на соответствующий ему вес

связи

умножается на соответствующий ему вес

связи и поступает на суммирующий блок,

обозначенный

и поступает на суммирующий блок,

обозначенный .

Каждый вес

.

Каждый вес соответствует «силе» одной биологической

синаптической связи.

соответствует «силе» одной биологической

синаптической связи.

Суммирующий блок

складывает алгебраически взвешенные

входы и затем передает данный сигнал

на выход, обеспечивая тем самым

определенный.уровень возбуждения

элемента

нейрона

нейрона

Здесь запись

означает скалярное произведение

векторов

означает скалярное произведение

векторов и

и .

.

Сигнал на выходе

нейрона

определяется путем пропускания

суммарного возбуждения

определяется путем пропускания

суммарного возбуждения через нелинейную функцию

через нелинейную функцию

Таким образом, различают два такта функционирования нейрона:

1) вычисление

величины суммарного возбуждения

,

полученного нейроном;

,

полученного нейроном;

2) определение

выходного сигнала

;

;

В приведенной модели нейрона пренебрегают многими известными характеристиками биологического прототипа: не учитывается нелинейность пространственно-временного суммирования, что особенно проявляется для сигналов, приходящих по возбуждающим и тормозящим синапсам; различного рода временные задержки; эффекты синхронизации и частотной модуляции и т.д.

Несмотря на это, нейронные сети, построенные на основе таких простых нейроподобных элементов, демонстрируют ассоциативные свойства, качественно близкие к передаточным характеристикам биологических нейронов

Входной вектор подается на входной слой, а выходной вектор определяется путем поочередного вычисления уровней активности элементов каждого слоя (от крайнего левого до последнего правого) с использованием уже известных значений активности элементов предшествующих слоев.

Общая схема построения многослойного персептрона, представляющего собой НС. прямого распространения, приведена на рис. 30.11. На этом рисунке кружками обозначены элементарные преобразователи информации - нейроны, описываемые моделью вида рис. 30.9, а стрелками - связи между этими нейронами, имеющие разную «силу» (веса синаптических связей). Как видно из рисунка, многослойный персептрон состоит из нескольких слоев нейронов: входного слоя; одного или более скрытых или промежуточных слоев (называемых так в силу того, что они «не видны» пользователю); выходного слоя нейронов. Входной вектор подается на входной слой, а выходной вектор определяется путем поочередного вычисления уровней активности (суммарного возбуждения) элементов каждого слоя (от крайнего левого до последнего правого), с использованием уже известных значений активности элементов предшествующих слоев. Отличительные особенности персептрона:

-

нейроны каждого слоя не связаны между

собой;

-

нейроны каждого слоя не связаны между

собой;

- входной сигнал каждого нейрона поступает на входы всех нейронов следующего слоя;

- нейроны входного слоя не осуществляют преобразования входных сигналов, их функция заключается в распределении этих сигналов между нейронами 1-го скрытого слоя.

С точки зрения

применения многослойной НС. для решения

задач распознавания образов входной

вектор

соответствует набору признаков, а

выходной вектор

соответствует набору признаков, а

выходной вектор -

классу образов. Скрытые слои применяются

для представления области знаний.

-

классу образов. Скрытые слои применяются

для представления области знаний.

Алгоритм обратного распространения

Рассмотрим особенности реализации алгоритма обратного распространения на следующем примере. Допустим, что устройство распознавания образов представлено НС., показанной на рис.

Входы данного

устройства

и

и соединены с фотоприемниками, реагирующими

на освещенность верхнего и нижнего

поля карты. Будем полагать, что карты,

предъявляемые НС. для распознавания,

соответствуют одному из 4-х типов Рис:

соединены с фотоприемниками, реагирующими

на освещенность верхнего и нижнего

поля карты. Будем полагать, что карты,

предъявляемые НС. для распознавания,

соответствуют одному из 4-х типов Рис:![]() Здесь светлое (освещенное) поле карты

фиксируется на входе сети как «1», а

темное – как «0».

Здесь светлое (освещенное) поле карты

фиксируется на входе сети как «1», а

темное – как «0».

Потребуем, чтобы

сеть относила к 1-й группе

карты с одинаковой освещенностью полей

(оба поля - темные, или оба поля - светлые),

а ко 2-й группе - карты с различной

освещенностью верхнего и нижнего поля.

Таким образом, обучающая выборка

карты с одинаковой освещенностью полей

(оба поля - темные, или оба поля - светлые),

а ко 2-й группе - карты с различной

освещенностью верхнего и нижнего поля.

Таким образом, обучающая выборка может быть представлена в виде табл.

30.2.

может быть представлена в виде табл.

30.2.

Рассматриваемая

модель НС. формально считается двухслойным

персептроном, т.к. входной слой нейронов

не осуществляет преобразования

информации

не осуществляет преобразования

информации

,

а лишь перераспределяет сигналы

,

а лишь перераспределяет сигналы и

и на входе сети между нейронами скрытого

слоя

на входе сети между нейронами скрытого

слоя .

Весовые коэффициенты

.

Весовые коэффициенты - веса синаптических связей НС.

настраиваемые в процессе обучения.

Активационные функции нейронов

- веса синаптических связей НС.

настраиваемые в процессе обучения.

Активационные функции нейронов

скрытого и выходного

слоя имеют сигмоидный вид, т.е.

.В

качестве начальных условий для проведения

процесса обучения НС выберем:

.В

качестве начальных условий для проведения

процесса обучения НС выберем:

;

;

- скорость обучения

;

;

- максимально

допустимая ошибка обучения НС:

;

;

- максимальное

количество шагов обучения:

.

.