3 курс (заочка) / Доклад - Data Mining / Полезности по теме / Data Mining хорошая методичка

.pdf

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

О |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Г |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

О |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

К |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

С |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

В |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Е |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Ш |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

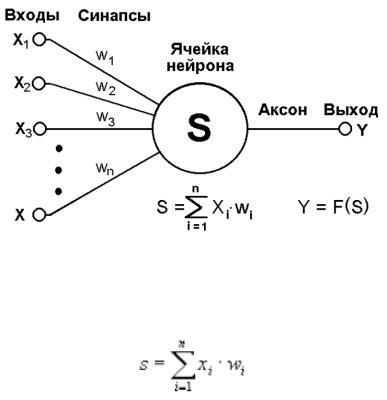

Рис.16 |

Искусственный нейрон |

|

|

|

Ы |

|

|

|

|

|

|

|

||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Н |

|

|

|

|

|

|

|

|

||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Р |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

ЧЕ |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Каждый синапс характеризуется величиной синаптической связи (ее |

||||||||||||||||||||||||||||||||

|

|

|

|

|

весом wi). Текущее состояние нейрона определяется как взвешенная. |

сумма его |

|||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Г |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

входов: |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

. |

|

|

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Н |

|

|

|

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

НИ |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Е |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

М |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

И |

: y=f(s). |

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|

|

|

|

|

Выход нейрона есть функция его состоянияТ |

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Е |

называют характеристической |

|||||||||||||

|

|

|

|

|

|

|

Активационная функция, которую такжеТ |

||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

И |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

функцией, - |

|

это |

|

|

|

|

|

|

|

|

|

|

С |

вычисляющая |

выходной сигнал |

|||||||||||||||||||

|

|

|

|

|

|

нелинейная функция, |

|||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Р |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

формального нейрона. |

|

|

|

|

|

|

Е |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||

|

|

|

|

|

|

|

|

|

|

В |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

И |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Часто используемые активационные функции: |

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

У |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|

|

|

|

|

|

|

1. |

Жесткая пороговаяН |

функция. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Й |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

2. |

Линейный порог. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Н |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

3. |

СигмоидальнаяЫ |

функция. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||

|

|

|

|

|

|

|

Выбор активационнойН |

функции определяется спецификой поставленной |

|||||||||||||||||||||||||||||||

|

|

|

|

|

задачи |

либо |

|

|

|

|

Е |

|

|

, накладываемыми некоторыми алгоритмами |

|||||||||||||||||||||||||

|

|

|

|

|

|

ограничениямиВ |

|||||||||||||||||||||||||||||||||

|

|

|

|

|

обучения. |

|

|

|

|

Т |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

|

|

|

С |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||

|

|

|

|

|

|

|

|

|

|

|

Р |

преобразователь - это элемент искусственного нейрона, |

|||||||||||||||||||||||||||

|

|

|

|

|

|

|

НелинейныйА |

||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

Д |

текущее состояние нейрона (выходной сигнал адаптивного |

||||||||||||||||||||||||||||

|

|

|

|

|

преобразующийУ |

||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

С |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

О |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

сумматора) в выходной сигнал нейрона по некоторому нелинейному закону |

||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

Г |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Й |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

(активационной функции). |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||

|

|

|

|

|

|

ИТочка |

|

ветвления (выход) |

|

- это |

элемент формального |

|

нейрона, |

||||||||||||||||||||||||||

|

|

|

|

|

|

К |

|

|

|

|

его выходной сигнал по нескольким адресам и имеющий один |

||||||||||||||||||||||||||||

|

|

|

|

|

посылающийС |

||||||||||||||||||||||||||||||||||

|

|

|

|

|

В |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

О |

|

|

несколько выходов. На |

|

вход точки |

ветвления |

обычно |

|

подается |

||||||||||||||||||||||||||

|

|

|

Т |

вход и |

|

|

|||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

А |

|

выходной сигнал нелинейного преобразователя, который затем посылается на |

|||||||||||||||||||||||||||||||||||

|

Р |

|

|

||||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

А |

|

|

|

входы других нейронов. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||

С |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||

|

|

|

|

|

|

Архитектура нейронных сетей. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||||||

Нейронные сети могут быть синхронные и асинхронные.

Всинхронных нейронных сетях в каждый момент времени свое состояние меняет лишь один нейрон.

Васинхронных - состояние меняется сразу у целой группы нейронов, как правило, у всего слоя.

61

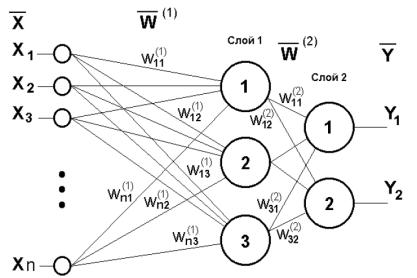

Можно выделить две базовые архитектуры - слоистые и полносвязные сети. Ключевым в слоистых сетях является понятие слоя.

Слой - один или несколько нейронов, на входы которых подается один и тот же общий сигнал.

|

|

|

|

|

|

|

Слоистые нейронные сети - нейронные сети, в которых нейроны |

|||||||||||||||||||||||||||||

|

|

|

|

|

разбиты на отдельные группы (слои) так, что обработка информации |

|||||||||||||||||||||||||||||||

|

|

|

|

|

осуществляется послойно. |

В слоистых сетях нейроны i-го слоя получают |

||||||||||||||||||||||||||||||

|

|

|

|

|

входные |

сигналы, преобразуют |

их и через |

|

|

|

|

|

|

|

|

|

|

|

О |

|||||||||||||||||

|

|

|

|

|

точки ветвления передаютГ |

|||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

О |

|

|

|

|

|

|

нейронам (i+1) слоя. И так до k-го слоя, который выдает выходные сигналыК |

|||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

С |

|

|

|

|

|

|

|

для интерпретатора и пользователя. Число нейронов в каждом слое не связано |

|||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

В |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Е |

|

|

|

|

|

|

|

|

|

с количеством нейронов в других слоях, может быть произвольным. |

|

|

|

|

|||||||||||||||||||||||||||

|

|

|

|

|

|

|

В рамках |

одного |

слоя данные обрабатываются |

|

|

|

Ш |

|

|

|

в |

|||||||||||||||||||

|

|

|

|

|

|

|

параллельно, а |

|||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Ы |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Н |

|

|

|

|

|

|

|

|

|

|

|

масштабах всей сети обработка ведется последовательно - от слоя к слою. К |

|||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Р |

|

|

|

|

|

|

|

|

|

|

|

|

слоистым |

|

нейронным |

|

|

сетям |

|

относятся, |

|

например, |

многослойные |

|||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

ЧЕ |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

. |

, некогнитрон, |

|||||||

|

|

|

|

|

персептроны, сети радиальных базисных функций, когнитронГ |

|||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

сети ассоциативной памяти. |

|

|

|

|

|

|

|

Н |

|

|

|

|

|

|

|

|

|

||||||||||||||

|

|

|

|

|

|

|

Cигнал не всегда подается на все нейроны слоя. В когнитроне, например, |

|||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

НИ |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

каждый нейрон текущего слоя получает сигналыЕ |

только от близких ему |

||||||||||||||||||||||||||||||

|

|

|

|

|

нейронов предыдущего слоя. |

|

|

|

|

М |

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||||

|

|

|

|

|

|

|

|

|

И |

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Слоистые |

|

сети, в |

|

свою |

очередь, |

Т |

|

|

быть |

однослойными |

и |

||||||||||||||||||

|

|

|

|

|

|

|

|

|

могут |

|||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Е |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

многослойными. |

|

|

|

|

|

|

|

|

|

|

Т |

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

И |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

из одного слоя. |

|

|

|

|

|

|

|

|

|||||

|

|

|

|

|

|

|

Однослойная сеть - сеть, состоящаяС |

|

|

|

|

|

|

|

|

|||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Р |

|

|

несколько слоев. |

|

|

|

|

|

|

|

|||||

|

|

|

|

|

|

|

Многослойная сеть - сеть, имеющаяЕ |

|

|

|

|

|

|

|

||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

В |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

В многослойной сети первыйИ слой называется входным, последующие - |

|||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Н |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

внутренними или скрытыми,Упоследний слой - выходным. Таким образом, |

|||||||||||||||||||||||||||||||

|

|

|

|

|

промежуточные слои - это Йвсе слои в многослойной нейронной сети, кроме |

|||||||||||||||||||||||||||||||

|

|

|

|

|

входного |

и выходного. |

Ы |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||

|

|

|

|

|

Входной слой сети реализует связь с входными |

|||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Н |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Н |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

данными, выходной - с выходными. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Е |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

В |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Нейроны могут быть входными, выходными и скрытыми. |

|

|

|

|

|

|

|||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

Т |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

С |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Входной слой организован из входных нейронов (input neuron), которые |

|||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

Р |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

А |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

получают данные и распространяют их на входы нейронов скрытого слоя сети. |

|||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

Д |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

У |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Скрытый нейрон (hidden neuron) - это нейрон, находящийся в скрытом слое |

|||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

С |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

нейроннойО сети. Выходные нейроны (output neuron), из которых организован |

|||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

Г |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

выходной слой сети, выдает результаты работы нейронной сети. |

|

|

|

|

|

|

|||||||||||||||||||||||||

|

|

|

|

|

|

|

Й |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

И |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

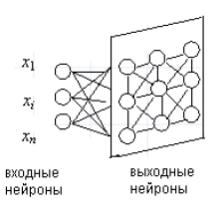

К |

В полносвязных сетях каждый нейрон передает свой выходной сигнал |

|||||||||||||||||||||||||||||

|

|

|

|

|

С |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

остальным нейронам, включая самого себя. Выходными сигналами сети могут |

|||||||||||||||||||||||||||||||

|

|

|

|

|

В |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Обыть все или некоторые выходные сигналы нейронов после нескольких тактов |

||||||||||||||||||||||||||||||||

|

|

|

Т |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

А |

|

функционирования сети. Все входные сигналы подаются всем нейронам. |

|

|

||||||||||||||||||||||||||||||

|

Р |

|

|

|

|

|||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

А |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

С |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Эпоха - одна итерация в процессе обучения, включающая предъявление всех примеров из обучающего множества и, возможно, проверку качества обучения на контрольном множестве.

Процесс обучения осуществляется на обучающей выборке. Обучающая выборка включает входные значения и соответствующие им

|

|

|

выходные значения набора данных. В ходе обучения нейронная сеть находит |

|||||||||||||||||||||||||||||||||||||||

|

|

|

некие зависимости выходных полей от входных. |

|

|

|

|

|

|

|

|

|

|

|

|

О |

||||||||||||||||||||||||||

|

|

|

|

|

Таким образом, |

|

|

ставится |

вопрос |

|

- |

какие |

входные |

поля |

|

|

|

|

|

|||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

(признакиГ) |

|||||||||||||||||||||||||||||||||

|

|

|

необходимо |

|

|

|

использовать. |

Первоначально |

|

выбор |

|

|

|

|

|

|

|

|

О |

|

||||||||||||||||||||||

|

|

|

|

|

|

|

осуществляетсяК |

|||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

С |

|

|

|

|

|

эвристически, далее количество входов может быть изменено. |

|

|

|

|

|

В |

|

|

|||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

Е |

|

|

|

||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Ш |

|

|

|

|

|

|

|

|

|

|

Сложность может вызвать вопрос о количестве наблюдений в наборе |

|||||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Ы |

|

|

|

|

|

||

|

|

|

данных. |

Количество |

|

|

необходимых |

наблюдений |

зависит от |

|

|

сложности |

||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Н |

|

|

|

|

|

|

|

|

|

|

|

решаемой |

|

задачи. При |

|

увеличении |

|

количества |

|

|

Р |

|

|

количество |

|||||||||||||||||||||||||||

|

|

|

|

|

|

признаков |

|

|

||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

ЧЕ |

|

|

|

|

|

|

|

|

|

|

|

|

|

наблюдений возрастает нелинейно, эта проблема носит название "проклятие |

|||||||||||||||||||||||||||||||||||||||

|

|

|

размерности". |

|

|

При |

|

|

недостаточном |

количестве |

|

. |

|

рекомендуется |

||||||||||||||||||||||||||||

|

|

|

|

|

|

|

данныхГ |

|

||||||||||||||||||||||||||||||||||

|

|

|

использовать линейную модель. |

|

|

|

|

|

|

|

|

|

. |

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

Н |

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

НИ |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Необходимо определить количество слоев в сети и количество нейронов |

|||||||||||||||||||||||||||||||||||||

|

|

|

в каждом слое, назначить такие значения весов иЕсмещений, которые смогут |

|||||||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

М |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

минимизировать |

ошибку |

решения. |

Веса |

И |

смещения |

|

автоматически |

||||||||||||||||||||||||||||||||

|

|

|

|

и |

|

|||||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Т |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

настраиваются |

|

|

таким |

|

|

образом, |

чтобы |

|

Е |

|

|

|

|

|

разность между |

||||||||||||||||||||||||

|

|

|

|

|

|

|

|

минимизировать |

||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Т |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

И |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

желаемым и полученным на выходе сигналами, которая называется ошибка |

|||||||||||||||||||||||||||||||||||||||

|

|

|

обучения. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

С |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Р |

|

|

нейронной сети вычисляется путем |

||||||||||||||||

|

|

|

|

|

Ошибка обучения для построеннойЕ |

|||||||||||||||||||||||||||||||||||||

|

|

|

сравнения |

выходных |

и |

|

|

В |

(желаемых) |

значений. |

Из |

|

полученных |

|||||||||||||||||||||||||||||

|

|

|

целевыхИ |

|

||||||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Н |

ошибок. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||

|

|

|

разностей формируется функцияУ |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||||||||||

|

|

|

|

|

Функция ошибок - этоЙ целевая функция, требующая минимизации в |

|||||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Ы |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

процессе |

управляемого |

Н |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||||

|

|

|

|

обучения нейронной сети. С помощью функции |

||||||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Н |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Е |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|

ошибок можно оценить качество работы нейронной сети во время обучения. |

|||||||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

В |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Т |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Например, сумма квадратов ошибок. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

С |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Р |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

От качества обучения нейронной сети зависит ее способность решать |

|||||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

А |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|

|

|

|

|

|

Д |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|

поставленные перед ней задачи. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||||||

|

|

|

|

|

|

|

У |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

С |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Переобучение нейронной сети. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||||||

|

|

|

|

|

Г |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

ПриОобучении нейронных сетей часто возникает серьезная трудность, |

|||||||||||||||||||||||||||||||||||||

|

|

|

|

|

Й |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

называемая проблемой переобучения (overfitting). |

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||||||||||||||

|

|

|

|

И |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

К |

Переобучение, или чрезмерно близкая подгонка - излишне точное |

||||||||||||||||||||||||||||||||||||||

|

|

|

С |

|

||||||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

В |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

соответствие нейронной сети конкретному набору обучающих примеров, при |

|||||||||||||||||||||||||||||||||||||||

|

|

Т |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

А |

Окотором сеть теряет способность к обобщению. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

Р |

|

|

|

Переобучение |

|

возникает |

в |

случае |

|

слишком |

долгого |

|

обучения, |

|||||||||||||||||||||||||||||

С |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

А |

|

|

недостаточного числа обучающих примеров или переусложненной структуры |

|||||||||||||||||||||||||||||||||||||||

|

|

|

нейронной |

|

сети. |

Переобучение |

связано |

с |

|

тем, |

что |

выбор |

|

обучающего |

||||||||||||||||||||||||||||

|

|

|

(тренировочного) множества является случайным. С первых шагов обучения |

|||||||||||||||||||||||||||||||||||||||

|

|

|

происходит уменьшение ошибки. На последующих шагах с целью |

|||||||||||||||||||||||||||||||||||||||

|

|

|

уменьшения ошибки (целевой функции) параметры подстраиваются под |

|||||||||||||||||||||||||||||||||||||||

|

|

|

особенности |

|

обучающего |

множества. |

|

|

Однако |

при |

этом |

|

|

происходит |

||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

63 |

"подстройка" не под общие закономерности ряда, а под особенности его части - обучающего подмножества. При этом точность прогноза уменьшается.

|

|

|

|

|

|

|

|

|

Один из вариантов борьбы с переобучением сети - деление обучающей |

|||||||||||||||||||||||||||||||||

|

|

|

|

|

выборки на два множества (обучающее и тестовое). |

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

На обучающем множестве происходит обучение нейронной сети. На |

|||||||||||||||||||||||||||||||||

|

|

|

|

|

тестовом множестве осуществляется проверка построенной модели. Эти |

|||||||||||||||||||||||||||||||||||||

|

|

|

|

|

множества не должны пересекаться. |

С каждым шагом параметры модели |

||||||||||||||||||||||||||||||||||||

|

|

|

|

|

изменяются, |

|

однако постоянное уменьшение |

значения целевой |

|

|

|

О |

||||||||||||||||||||||||||||||

|

|

|

|

|

|

функцииГ |

||||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

О |

|

|

|

|

|

|

происходит именно на обучающем множестве. При разбиении множестваК на |

|||||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

С |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

В |

|

|

|

|

|

|

|

|

два мы можем наблюдать изменение ошибки прогноза на тестовом множестве |

|||||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Е |

|

|

|

|

|

|

|

|

|

параллельно |

|

с |

|

наблюдениями |

над |

обучающим |

|

|

|

|

|

|

Ш |

|

|

|

|

||||||||||||||||||||

|

|

|

|

|

|

|

множеством. Какое-то |

|||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Ы |

|

|

|

|

|

|

|

|

|

|

количество шагов |

ошибки прогноза |

уменьшается |

на |

|

обоих |

|

множествах. |

||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Н |

|

|

|

|

|

|

|

|

|

|

|

Однако на определенном шаге ошибка на тестовом |

|

|

Р |

|

|

|

|

|

|

||||||||||||||||||||||||||||

|

|

|

|

|

множестве начинает |

|||||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

ЧЕ |

|

|

|

|

|

|

|

|

|

|

|

|

|

возрастать, |

|

при |

|

этом |

|

ошибка |

на |

обучающем |

множестве |

|

продолжает |

||||||||||||||||||||||||||

|

|

|

|

|

уменьшаться. Этот |

|

момент считается концом |

|

|

|

|

. |

или |

настоящего |

||||||||||||||||||||||||||||

|

|

|

|

|

|

|

реальногоГ |

|||||||||||||||||||||||||||||||||||

|

|

|

|

|

обучения, с него и начинается переобучение. |

|

|

|

. |

|

|

|

|

|

|

|

|

|

||||||||||||||||||||||||

|

|

|

|

|

|

|

|

Н |

|

|

|

|

|

|

|

|

|

|

||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

НИ |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Прогноз на тестовом множестве является проверкой работоспособности |

|||||||||||||||||||||||||||||||||

|

|

|

|

|

построенной |

|

модели. |

|

Ошибка |

на тестовом |

|

множествеЕ |

может |

являться |

||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

М |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

ошибкой прогноза, |

|

|

|

|

|

|

|

|

|

|

И |

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||

|

|

|

|

|

|

если тестовое множество максимально приближено к |

||||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Т |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

текущему моменту. |

|

|

|

|

|

|

|

|

Е |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

Т |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|

|

|

|

|

|

|

Модели нейронных сетей. |

|

|

И |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||

|

|

|

|

|

|

|

|

|

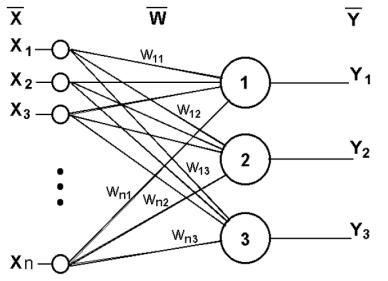

Рассмотрим наиболее простые моделиС |

нейронных сетей: однослойный и |

||||||||||||||||||||||||||||||||

|

|

|

|

|

многослойный персептрон. |

|

Р |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||||||

|

|

|

|

|

Е |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

В |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Однослойный персептронИ (персептрон Розенблатта) - однослойная |

|||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Н |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

нейронная сеть, все нейроныУкоторой имеют жесткую пороговую функцию |

|||||||||||||||||||||||||||||||||||||

|

|

|

|

|

активации. |

|

|

|

|

|

|

|

|

|

|

Й |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Ы |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Н |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Однослойный персептрон имеет простой алгоритм обучения и способен |

|||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Н |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Е |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

решать лишь самые простые задачи. Классический пример такой нейронной |

|||||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

В |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Т |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

сети - однослойный трехнейронный персептрон - представлен на рис.17. |

|

|

|||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

С |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Р |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

А |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Д |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

У |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

С |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

О |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|