3 курс (заочка) / Доклад - Data Mining / Полезности по теме / Data Mining хорошая методичка

.pdfподстановки в уравнение регрессии параметров значений объясняющих переменных. Решение задачи классификации осуществляется таким образом:

|

|

|

|

|

линия регрессии делит все множество объектов на два класса, и та часть |

|||||||||||||||||||||||||||||||||||

|

|

|

|

|

множества, где значение функции больше нуля, принадлежит к одному классу, |

|||||||||||||||||||||||||||||||||||

|

|

|

|

|

а та, где оно меньше нуля, - к другому классу. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||||||||||

|

|

|

|

|

|

|

|

Рассмотрим основные задачи регрессионного анализа: установление |

||||||||||||||||||||||||||||||||

|

|

|

|

|

формы зависимости, определение функции регрессии, |

|

оценка неизвестных |

|||||||||||||||||||||||||||||||||

|

|

|

|

|

значений зависимой переменной. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

О |

||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Г |

||||||||||||||||||

|

|

|

|

|

|

|

|

Установление формы зависимости. |

|

|

|

|

|

|

|

|

|

|

|

|

О |

|

||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

К |

|

|

|||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

С |

|

|

|

||

|

|

|

|

|

|

|

|

Характер и |

|

форма |

зависимости |

между |

переменными |

В |

могут |

|||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Е |

|

|

|

|

|

|

|

|

|

|

|

|

образовывать следующие разновидности регрессии: |

|

|

|

|

|

Ш |

|

|

|

|

|

|

|

||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Ы |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

положительная линейная регрессия (выражается в равномерном |

||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

росте функции); |

|

|

|

|

|

|

|

|

|

|

|

|

Н |

|

|

|

|

|

|

|

|

||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Р |

|

|

|

|

|

|

|

|

|

||||||||

|

|

|

|

|

|

|

|

|

|

|

положительная равноускоренно возрастающая ЧЕрегрессия; |

|

|

|

|

|

|

|

||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Г |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

положительная равнозамедленно возрастающая регрессия; |

|

|

|

|

|

|

||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Н |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

отрицательная линейная регрессия (выражается в равномерном |

||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

падении функции); |

|

|

|

|

|

|

|

|

НИ |

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Е |

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

М |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

отрицательная равноускоренно убывающая регрессия; |

|

|

|

|

|

|

|

|

||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

И |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

отрицательная равнозамедленно убывающая регрессия. |

|

|

|

|

|

|

|

|||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Т |

|

не в чистом виде, а в |

||||||||||||

|

|

|

|

|

|

|

|

Описанные разновидности обычно встречаютсяЕ |

||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Т |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

сочетании друг с другом. В таком случаеИговорят о комбинированных формах |

|||||||||||||||||||||||||||||||||||

|

|

|

|

|

регрессии. |

|

|

|

|

|

|

|

|

|

|

|

|

|

С |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Р |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Е |

|

. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Определение функции регрессииВ |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

И |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Вторая |

задача |

|

|

|

Н |

к |

выяснению |

действия |

на |

|

зависимую |

|||||||||||||||||||||

|

|

|

|

|

|

|

|

|

сводится |

|

|

|||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

У |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

переменную главных факторов или причин, при неизменных прочих равных |

|||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Й |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Ы |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

условиях, и при условии исключения воздействия на зависимую переменную |

|||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Н |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

случайных |

|

|

|

|

|

Н |

|

|

|

|

|

|

регрессии |

определяется |

в |

|

|

|

виде |

||||||||||||||||

|

|

|

|

|

|

элементов. Функция |

|

|

|

|||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Е |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

В |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

математического уравнения того или иного типа. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

Т |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

С |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Оценка неизвестных значений зависимой переменной. |

|

|

|

|

|

|

|

|

|

|||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

А |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Решение этойР |

задачи сводится к решению задачи одного из типов: |

|

|

|

|

|||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

1.ДОценка |

|

|

значений |

зависимой |

переменной |

|

|

внутри |

|||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

У |

рассматриваемого |

|

интервала |

исходных |

данных, |

|

|

|

т.е. |

||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

С |

|

|

|

|

||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

О |

|

пропущенных |

|

значений; |

при |

этом |

|

решается |

|

задача |

|||||||||||||||||||||

|

|

|

|

|

|

|

|

Г |

|

|

|

|

|

|||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

Й |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

И |

|

|

|

интерполяции. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||

|

|

|

|

|

|

К |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|

|

|

С |

|

|

|

|

2. |

Оценка |

|

будущих |

|

значений зависимой переменной, |

|

|

т.е. |

||||||||||||||||||||||

|

|

|

|

О |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Т |

В |

|

|

|

|

|

|

нахождение значений вне заданного интервала исходных |

|||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

данных; при этом решается задача экстраполяции. |

|

|

|

|

|

|

|

|

||||||||||||||||||||||

|

|

А |

|

|

|

|

Обе |

|

задачи |

решаются |

путем |

подстановки в |

уравнение |

регрессии |

||||||||||||||||||||||||||

|

Р |

|

|

|

|

|

|

|||||||||||||||||||||||||||||||||

А |

|

|

|

найденных оценок параметров значений независимых переменных. Результат |

||||||||||||||||||||||||||||||||||||

С |

|

|

|

|

||||||||||||||||||||||||||||||||||||

решения уравнения представляет собой оценку значения целевой (зависимой) переменной.

Рассмотрим некоторые предположения, на которые опирается регрессионный анализ.

41

Предположение линейности, т.е. предполагается, что связь между рассматриваемыми переменными является линейной. Так диаграмма

|

|

|

|

|

рассеивания (изображения точек (x,y) с координатами переменных) обычно |

||||||||||||||||||||||||||||||||||||

|

|

|

|

|

отображает вид зависимости. Если же на диаграмме рассеивания переменных |

||||||||||||||||||||||||||||||||||||

|

|

|

|

|

видно явное отсутствие линейной связи, т.е. присутствует нелинейная связь, |

||||||||||||||||||||||||||||||||||||

|

|

|

|

|

следует использовать нелинейные методы анализа. |

|

|

|

|

|

|

|

|

|

|

||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

Предположение |

|

о |

|

нормальности |

|

остатков. |

Оно |

допускает, |

что |

||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

О |

|

|

|

|

|

распределение разницы предсказанных и наблюдаемых значений являетсяГ |

||||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

О |

|

|

|

|

|

|

нормальным. Для визуального определения характера распределения можноК |

||||||||||||||||||||||||||||||||||||

|

|

|

|

|

воспользоваться гистограммами остатков. |

|

|

|

|

|

|

|

|

|

|

|

С |

|

|

||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

В |

|

|

||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|

|

|

|

|

|

При |

использовании |

регрессионного анализа |

следует |

|

|

|

Е |

|

его |

||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

учитывать |

||||||||||||||||||||||||||||||||

|

|

|

|

|

основное |

ограничение. |

|

Оно |

состоит |

|

в |

|

том, что |

|

|

|

|

|

Ш |

|

анализ |

||||||||||||||||||||

|

|

|

|

|

|

|

|

регрессионный |

|

||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Ы |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Н |

|

|

|

|

|

|

|

|

|

|

|

позволяет обнаружить лишь зависимости, а не связи, лежащие в основе этих |

||||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Р |

|

|

|

|

|

|

|

|

|

|

|

|

зависимостей. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

ЧЕ |

|

|

|

|

|

|

|

||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Регрессионный анализ дает возможность оценить Гстепень связи между |

|||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

переменными путем вычисления предполагаемого значенияН |

|

переменной на |

||||||||||||||||||||||||||||||||||

|

|

|

|

|

основании нескольких известных значений. |

|

НИ |

|

|

|

|

|

|

|

|

|

|||||||||||||||||||||||||

|

|

|

|

|

|

|

|

Уравнение регрессии. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Е |

|

|

|

|

|

|

|

|

|

|

||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

М |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Уравнение регрессии выглядит следующим образом: Y=a+b*X. |

|

|

|

|

|||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

И |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Т |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

При помощи этого уравнения переменная Y выражается через константу |

|||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Е |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Т |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

«a» и угол наклона прямой (или угловой коэффициент) «b», умноженный на |

||||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

И |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

значение переменной X. Константу «a»Стакже называют свободным членом, а |

||||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Р |

|

регрессии или B-коэффициентом. |

|

||||||||||||||

|

|

|

|

|

угловой коэффициент - коэффициентомЕ |

|

|||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

В |

|

|

|

определенный разброс наблюдений |

|||||||||||||||

|

|

|

|

|

|

|

|

Как правило всегда наблюдаетсяИ |

|||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Н |

|

|

|

. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

относительно регрессионной прямойУ |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||||||||

|

|

|

|

|

|

|

|

Остаток - |

это отклонениеЙ |

|

отдельной точки (наблюдения) от линии |

||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Ы |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

регрессии (предсказанного значения). |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Н |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Н |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

При оценивании уравнения регрессии обычно вычисляются следующие |

|||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Е |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

В |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

показатели регрессионной статистики. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Т |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Величина |

|

С |

|

|

|

|

|

|

называемая |

также |

мерой |

определенности |

|||||||||||||||||||||

|

|

|

|

|

|

|

|

R-квадрат, |

|||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

Р |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

А |

|

детерминации), |

|

|

|

характеризует |

качество полученной |

|||||||||||||||||||||||

|

|

|

|

|

(коэффициента |

|

|

|

|

|

|||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

Д |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

У |

|

прямой. Это качество выражается степенью соответствия |

||||||||||||||||||||||||||||||

|

|

|

|

|

регрессионной |

||||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

С |

|

|

|

|

данными и регрессионной моделью (расчетными данными). |

|||||||||||||||||||||||||||

|

|

|

|

|

между исходнымиО |

||||||||||||||||||||||||||||||||||||

|

|

|

|

|

Мера |

Г |

|

|

|

|

|

|

|

|

|

всегда |

находится |

в |

пределах |

интервала |

[0;1]. В |

||||||||||||||||||||

|

|

|

|

|

определенности |

||||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

Й |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

И |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

большинстве случаев значение R-квадрат находится между этими значениями, |

||||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

К |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

С |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

называемыми экстремальными. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||||

|

|

|

|

|

В |

|

Если значение R-квадрата |

|

близко |

к |

единице, |

это |

|

означает, |

что |

||||||||||||||||||||||||||

|

|

|

|

О |

|

|

|

|

|||||||||||||||||||||||||||||||||

|

|

|

Т |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

А |

|

построенная модель объясняет почти всю изменчивость соответствующих |

|||||||||||||||||||||||||||||||||||||

|

Р |

|

|

||||||||||||||||||||||||||||||||||||||

|

|

|

переменных. И наоборот, значение R-квадрата, близкое к нулю, означает |

||||||||||||||||||||||||||||||||||||||

А |

|

|

|

||||||||||||||||||||||||||||||||||||||

С |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

плохое качество построенной модели.

Множественный R - коэффициент множественной корреляции - выражает степень зависимости независимых переменных (X) и зависимой переменной (Y).

Множественный R равен квадратному корню из коэффициента детерминации, эта величина принимает значения в интервале от нуля до единицы. В простом линейном регрессионном анализе множественный R равен коэффициенту корреляции Пирсона.

Направление связи между переменными определяется на основании знаков (отрицательный или положительный) коэффициентов регрессии

|

|

|

|

|

(коэффициента «b»). |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

О |

|||||||||

|

|

|

|

|

|

|

Если |

|

знак |

при |

коэффициенте |

регрессии |

- |

положительный, |

|

|

||||||||||||||||||||

|

|

|

|

|

|

|

|

связьГ |

||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

О |

|

|

|

|

|

|

зависимой переменной с независимой будет положительной. В нашем случаеК |

|||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

С |

|

|

|

|

|

|

|

знак коэффициента регрессии положительный, |

следовательно, |

|

|

В |

|

|

|||||||||||||||||||||||||

|

|

|

|

|

|

связь также |

||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Е |

|

|

|

|

|

|

|

|

|

является положительной. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Ш |

|

|

|

|

||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Ы |

|

|

|

|

|

|

|

|

|

|

|

|

Если |

|

знак |

при |

коэффициенте |

|

регрессии |

- |

отрицательный, |

связь |

||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Н |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Р |

|

|

|

|

|

|

|

|

|

|

|

|

зависимой переменной с независимой является отрицательной (обратной). |

|

||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

ЧЕ |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Оценив уравнение регрессии, можно решать задачу прогнозирования, |

|||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

. |

|

|

значениям X |

||||

|

|

|

|

|

которая сводится к вычислению значений Y=a+b*X по заданнымГ |

|

||||||||||||||||||||||||||||||

|

|

|

|

|

при известных значениях параметров. |

|

|

|

|

|

|

|

. |

|

|

|

|

|

|

|

|

|||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

Н |

|

|

|

|

|

|

|

|

||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

НИ |

|

|

|

|

|

|

|

|

||

|

|

|

|

|

|

|

Если функция регрессии определена, интерпретирована и обоснована, и |

|||||||||||||||||||||||||||||

|

|

|

|

|

оценка точности регрессионного анализа соответствуетЕ |

требованиям, |

можно |

|||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

М |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

считать, |

|

что построенная |

модель |

и |

|

|

И |

|

|

|

значения обладают |

||||||||||||||||||||

|

|

|

|

|

|

|

|

прогнозные |

||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Т |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

достаточной надежностью. |

|

|

|

|

|

|

Е |

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||

|

|

|

|

|

|

|

|

|

Т |

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

И |

|

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|

|

|

|

|

Прогнозные значения, полученные таким способом, являются средними |

|||||||||||||||||||||||||||||

|

|

|

|

|

значениями, которые можно ожидать. С |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Р |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Е |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

В |

|

|

|

решений |

|

|

|

|

|

|

|

|

|

||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

ДеревьяИ |

|

|

|

|

|

|

|

|

|

|||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Н |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

У |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Й |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Ы |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Метод деревьев решений (decision trees) является одним из наиболее |

|||||||||||||||||||||||||||||

|

|

|

|

|

популярных |

методов |

решенияН |

задач |

|

классификации |

и прогнозирования. |

|||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Н |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Иногда этот метод DataЕMining также называют деревьями решающих правил, |

|||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

В |

|

|

и регрессии. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||

|

|

|

|

|

деревьями классификацииТ |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||||

|

|

|

|

|

|

|

Если |

|

|

|

С |

|

, т.е. |

целевая |

переменная |

|

принимает |

|

дискретные |

|||||||||||||||||

|

|

|

|

|

|

|

|

зависимаяР |

|

|

||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

А |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

значения, |

|

|

Д |

помощи |

|

метода |

|

дерева решений |

решается |

|

задача |

||||||||||||||||||||

|

|

|

|

|

|

|

при |

|

|

|

||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

У |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

С |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|

|

|

классификации. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||

|

|

|

|

|

|

|

|

О |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Г |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Если же зависимая переменная принимает непрерывные значения, то |

|||||||||||||||||||||||||||||

|

|

|

|

|

деревоЙрешений устанавливает зависимость этой переменной от независимых |

|||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

И |

|

|

|

, т.е. решает задачу численного прогнозирования. |

|

|

|

|

|

|

|

||||||||||||||||||

|

|

|

|

|

переменныхК |

|

|

|

|

|

|

|

||||||||||||||||||||||||

|

|

|

|

|

|

С |

В наиболее простом виде дерево решений - это способ представления |

|||||||||||||||||||||||||||||

|

|

|

|

|

В |

|||||||||||||||||||||||||||||||

|

|

|

|

О |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Т |

правил |

в |

|

|

иерархической, |

последовательной |

структуре. Основа |

такой |

|||||||||||||||||||||||||

|

|

А |

|

|

|

|||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

|

Р |

|

|

структуры - ответы "Да" или "Нет" на ряд вопросов. |

|

|

|

|

|

|

|

|

|

|||||||||||||||||||||||

А |

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

С |

|

|

|

|

|

|

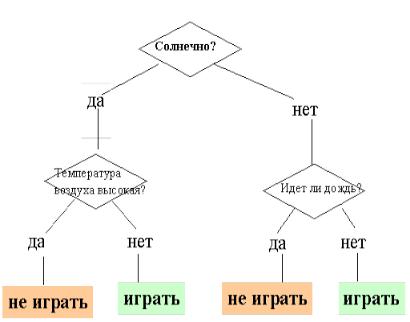

На рис.10 приведен пример дерева решений, задача которого - ответить |

|||||||||||||||||||||||||||||

|

|

|

|

|

|

|

||||||||||||||||||||||||||||||

на вопрос: "Играть ли в гольф?" Чтобы решить задачу, т.е. принять решение, играть ли в гольф, следует отнести текущую ситуацию к одному из известных классов (в данном случае - "играть" или "не играть"). Для этого требуется ответить на ряд вопросов, которые находятся в узлах этого дерева, начиная с его корня.

43

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

О |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Г |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

О |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

К |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

С |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

В |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Е |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Ш |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Ы |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Н |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Р |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

ЧЕ |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Г |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Н |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Рис.10 Дерево решений «Играть ли в гольф?» |

|

|

|

|

|

|

|

|

|

|

||||||||||||||||||

|

|

|

|

|

|

|

Первый |

|

узел |

|

дерева |

"Солнечно?" |

являетсяНИ узлом проверки, |

|

т.е. |

||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Е |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

М |

|

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|

|

|

условием. При положительном ответе на вопрос осуществляется переход к |

||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

И |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

левой части дерева, называемой левой ветвью, при отрицательном - к правой |

||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Т |

дерева является узлом проверки |

|||||||||||||||

|

|

|

|

|

части дерева. Таким образом, внутренний узелЕ |

||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Т |

|

|

|

вопрос и т.д., пока не будет |

|||||||||||||

|

|

|

|

|

определенного условия. Далее идет следующийИ |

|

|||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

С |

|

|

|

узлом решения. Для нашего |

|||||||||||||||

|

|

|

|

|

достигнут конечный узел дерева, являющийсяР |

||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Е |

|

узла: "играть" и "не играть" в гольф. |

|

|||||||||||||||||

|

|

|

|

|

дерева существует два типа конечногоВ |

|

|||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

И |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

В |

результате |

|

|

|

|

|

Н |

от |

корня |

дерева (иногда |

|

называемого |

||||||||||||||||||||

|

|

|

|

|

|

|

|

прохождения |

|

||||||||||||||||||||||||||||||

|

|

|

|

|

корневой вершиной) |

|

|

|

|

У |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

т.е. |

||||||||

|

|

|

|

|

|

до его вершины решается задача классификации, |

|

||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Й |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Ы |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

выбирается один из классов - "играть" и "не играть" в гольф. |

|

|

|

|

|

|

|

|

|

|

||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Н |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Целью |

|

|

|

|

|

Н |

|

дерева |

решения |

в |

данном |

случае |

|

является |

||||||||||||||||||

|

|

|

|

|

|

|

|

построения |

|

||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

Е |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

В |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

определение значения категориальной зависимой переменной. |

|

|

|

|

|

|

|

|

|

|

||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

Т |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

С |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

В рассмотренном примере решается задача бинарной классификации, |

||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

А |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

т.е. создается Рдихотомическая |

классификационная |

|

модель. |

|

Пример |

|||||||||||||||||||||||||||||

|

|

|

|

|

демонстрируетДработу так называемых бинарных деревьев. |

|

|

|

|

|

|

|

|

|

|

||||||||||||||||||||||||

|

|

|

|

|

|

|

|

У |

бинарных деревьев ветвление может вестись только в двух |

||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

В узлахС |

||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

О |

, |

т.е. существует |

возможность |

|

только |

|

двух |

|

ответов |

|

на |

||||||||||||||||||||

|

|

|

|

|

направленияхГ |

|

|

|

|

||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

Й |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

И |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

поставленный вопрос ("да" и "нет"). Бинарные деревья являются самым |

||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

К |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

С |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

простым, частным случаем деревьев решений. В остальных случаях, ответов |

||||||||||||||||||||||||||||||||||

|

|

|

|

|

Ви, соответственно, ветвей дерева, выходящих из его внутреннего узла, может |

||||||||||||||||||||||||||||||||||

|

|

|

|

О |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Т |

быть больше двух. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||

|

|

А |

|

|

|

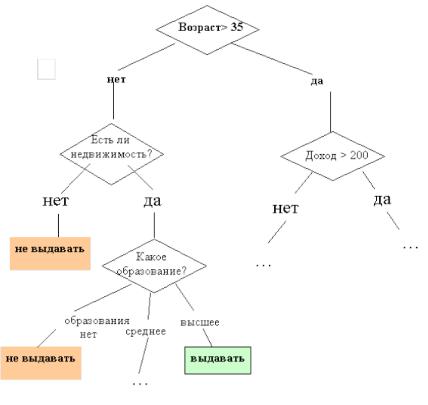

Рассмотрим более сложный пример. |

База данных, |

на основе которой |

|||||||||||||||||||||||||||||||

|

Р |

|

|

|

|

||||||||||||||||||||||||||||||||||

А |

|

|

|