- •Нейронні мережі та нейрокомп’ютери

- •Контрольні запитання

- •Історія нейронних мереж

- •Контрольні запитання

- •Штучні нейронні мережі

- •3.1 Біологічний нейрон

- •3.2 Штучний нейрон

- •3.3 Штучні нейронні мережі

- •3.4 Навчання штучної нейронної мережі

- •Контрольні запитання

- •Обгрунтування застосування нейромереж

- •4.8 Керування

- •Контрольні запитання

- •Розширена модель штучного нейрона та компоненти штучного нейрона

- •5.1 Розширена модель штучного нейрона

- •5.2 Компоненти штучного нейрона

- •5.2.1 Вагові коефіцієнти

- •5.2.2 Функція суматора

- •5.2.3 Передавальна функція

- •5.2.4 Масштабування

- •5.25 Вихідна функція

- •5.2.6 Функція похибки та поширюване назад значення

- •5.2.7 Функція навчання

- •Контрольні запитання

- •Архітектура з’єднань штучних нейронів

- •Контрольні запитання

- •Навчання штучної нейронної мережі

- •7.1 Контрольоване навчання

- •7.2 Неконтрольоване навчання

- •7.3 Оцінки навчання

- •7.4 Правила навчання

- •7.4.1 Правило Хеба

- •7.4.2 Правило Хопфілда

- •7.4.3 Правило “дельта”

- •7.4.4 Правило градієнтного спуску

- •7.4.5 Навчання методом змагання

- •Контрольні запитання

- •Перцептрон розенбалата та нейромережа зворотнього поширення похибки

- •8.1 Перцептрон Розенбалата

- •8.2 Нейромережа зворотнього поширення похибки (Back Propagation)

- •Контрольні запитання

- •Мережі delta bar delta,

- •9.3 Скерований випадковий пошук

- •Контрольні запитання

- •Нейронна мережа вищого порядку. Мережа кохонена. Квантування навчального вектора

- •10.1 Нейронна мережа вищого порядку або функціонально-пов’язана нейронна мережа

- •10.2 Мережа Кохонена

- •10.3 Квантування навчального вектора (Learning Vector Quantization)

- •Контрольні запитання

- •Мережа зустрічного поширення. Ймовірнісна нейронна мережа. Мережа хопфілда. Машина больцмана

- •11.1 Мережа зустрічного поширення (CounterРropagation)

- •Навчання мережі

- •Функціонування мережі

- •11.2 Ймовірнісна нейронна мережа

- •11.3 Мережа Хопфілда

- •Алгоритм функціонування мережі:

- •11.4 Машина Больцмана

- •Алгоритм функціонування мережі:

- •Контрольні запитання

- •Мережа хемінга. Двоскерована асоціативна пам’ять. Мережа адаптивної резонансної теорії

- •12.1 Мережа Хемінга

- •Алгоритм функціонування мережі Хемінга:

- •12.2 Двоскерована асоціативна пам’ять

- •12.3 Мережа адаптивної резонансної теорії

- •Алгоритм функціонування мережі: - ініціалізація мережі:

- •Контрольні запитання

- •Нейронна мережа на основі моделі “функціонал на множині табличних функцій”

- •13.1 Базові концепції моделі “функціонал на множині табличних функцій”

- •13.2 Навчання та функціонування нейромережі фтф

- •13.3 Алгоритм для режиму навчання нейромереж

- •13.4 Алгоритм для режиму функціонування нейромережі

- •13.5 Особливості формування передавальних функцій

- •Контрольні запитання

- •Нейромережі в задачах відображення

- •14.1 Типи задач відображення і підходи до їх вирішення

- •14.1.1 Факторний аналіз

- •14.1.2 Кореляційний аналіз

- •14.1.3 Ранжування входів

- •14.2 Вибір даних для обробки

- •14.3 Згладжування даних

- •14.4 Задачі прогнозування

- •За характером основних ознак об’єкту:

- •За числом ознак об’єкту досліджень:

- •За часом випередження розрізняють види прогнозів:

- •14.5 Адаптація нейромереж в режимах прогнозування

- •Однопараметрична задача прогнозування

- •Багатопараметрична задача прогнозування

- •Однокрокове прогнозування (передбачення)

- •Багатокрокове прогнозування

- •Багатокрокове прогнозування з перенавчанням нейромережі на кожному кроці прогнозу

- •14.6 Критерії оцінки якості функціонування мережі

- •14.7 Оцінювання точності прогнозів

- •Контрольні запитання

- •Сучасні напрямки розвитку нейрокомп’ютерних технологій

- •Загальні задачі - це задачі досить просто зводяться до обробки нейронною мережею багатовимірних векторів дійсних змінних, наприклад:

- •Нейромережеві експертні системи

- •Нейрочіпи і нейрокомп’ютери

- •Контрольні запитання

- •Перелік рекомендованих джерел

5.2 Компоненти штучного нейрона

Незалежно від розташування та функціонального призначення, всі штучні нейронні елементи мають спільні компоненти. Розглянемо сім основних компонент штучного нейрона:

- вагові коефіцієнти;

- функція суматора;

- передавальна функція;

- масштабування;

- вихідна функція;

- функція похибки та поширюване назад значення;

- функція навчання.

5.2.1 Вагові коефіцієнти

При функціонуванні нейрон одночасно отримує багато вхідних сигналів. Кожен вхід має свою власну синаптичну вагу, яка надає входу вплив, необхідний для функції суматора елемента обробки. Ваги є мірою сили вхідних зв’язків і моделюють різноманітні синаптичні сили біологічних нейронів. Ваги суттєвого входу підсилюються і, навпаки, вага несуттєвого входу примусово зменшується, що визначає інтенсивність вхідного сигналу. Ваги можуть змінюватись відповідно до навчальних прикладів, топології мережі та навчальних правил.

5.2.2 Функція суматора

Першим кроком дії нейрону є обчислення зваженої суми всіх входів. Математично, вхідні сигнали та відповідні їм ваги представлені векторами (х1, х2 ... хn) та (w1, w2 . . . wn). Добуток цих векторів є загальним вхідним сигналом. Спрощеною функцією суматора є множення кожної компоненти вектора х на відповідну компоненту вектора w: вхід1 = х1 * w1, вхід2 = х2 * w2, і знаходження суми всіх добутків: вхід1 + вхід2 + . . . + вхідn. Результатом є єдине число, а не багатоелементний вектор.

Функція суматора може бути складнішою, наприклад, вибір мінімуму, максимуму, середнього арифметичного, добутку або виконувати інший нормалізуючий алгоритм. Вхідні сигнали та вагові коефіцієнти можуть комбінуватись багатьма способами перед надходженням до передавальної функції. Особливі алгоритми для комбінування входів нейронів визначаються обраними мережевою архітектурою та парадигмою.

В деяких нейромережах функції суматора виконують додаткову обробку, так звану функцію активації, яка зміщує вихід функції суматора відносно часу. На жаль, функції активації на теперішній час обмежено досліджені і більшість сучасних нейронних реалізацій використовують функцію активації “тотожності”, яка еквівалентна її відсутності. Цю функцію доцільніше використовувати як компоненту мережі в цілому, ніж як компоненту окремого нейрона.

5.2.3 Передавальна функція

Результат функції суматора є зваженою сумою вхідних сигналів, що перетворюється у вихідний сигнал через алгоритмічний процес відомий як передавальна функція. У передавальній функції для визначення виходу нейрона загальна сума порівнюється з деяким порогом. Якщо сума є більшою за значення порога, елемент обробки генерує сигнал, в протилежному випадку сигнал не генерується або генерується гальмуючий сигнал.

Переважно застосовують нелінійну передавальну функцію, оскільки лінійні (прямолінійні) функції обмежені і вихід є просто пропорційним до входу. Застосування лінійних передавальних функцій було проблемою у ранніх моделях мереж, і їх обмеженість та недоцільність була доведена в книзі Мінскі та Пейперта “Перцептрони”.

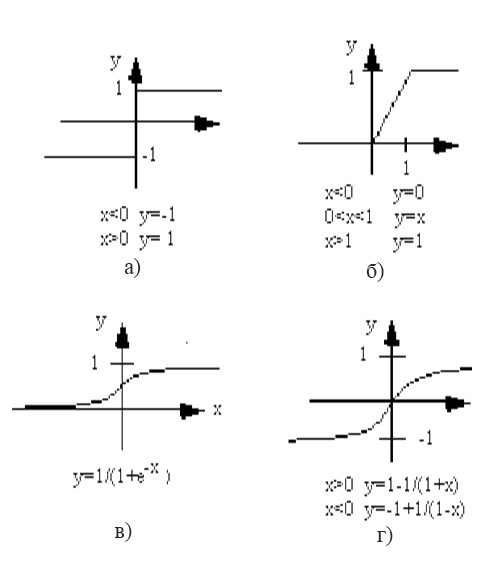

На рис.5.2 зображені типові передавальні функції.

Рисунок 5.2 – Типові передавальні функції

Для простої передавальної функції нейромережа може видавати 0 та 1, 1 та -1 або інші числові комбінації. Передавальна функція в таких випадках є “жорстким обмежувачем” або пороговою функцією (рис.5.2а).

Інший тип передавальної функції лінійна з насиченням віддзеркалює вхід всередині заданого діапазону і діє як жорсткий обмежувач за межами цього діапазону. Це лінійна функція, яка відсікається до мінімальних та максимальних значень, роблячи її нелінійною (рис.5.2б).

Наступним вибором є сигмоїда або S-подібна крива, яка наближує мінімальне та максимальне значення у асимптотах і називається сигмоїдою (рис.5.2в), коли її діапазон [0, 1], або гіперболічним тангенсом (рис.5.2г), при діапазоні [-1, 1]. Важливою рисою цих кривих є неперервність функцій та їх похідних. Застосування сигмоїдних функцій надає добрі результати і має широке застосування.

Для різних нейромереж можуть вибиратись інші передавальні функції.

Перед надходженням до передавальної функції до вхідного сигналу деколи додають однорідно розподілений випадковий шум, джерело та кількість якого визначається режимом навчання. В літературі цей шум, згадується як “температура” штучних нейронів, яка надає математичній моделі елемент реальності.