- •Архитектуры вычислительных систем

- •Понятие Архитектуры вс и общие требования предъявляемые к ней. Фон-Неймановская архитектура.

- •Общие требования

- •1. Отношение стоимость/производительность

- •2. Надежность и отказоустойчивость.

- •3. Масштабируемость.

- •4. Совместимость и мобильность программного обеспечения

- •Нейрокомпьютерные системы

- •Нейронные сети прямого распространения с дискретной функцией активации: архитектура, алгоритмы обучения, применение.

- •Алгоритмы обучения.

- •Нейронные сети обратного распространения с непрерывной функцией активации: архитектура, алгоритмы обучения, применение.

- •Конструируемые нейронные сети с конкурирующими нейронами: архитектура, применение.

- •Сеть Хопфилда

- •4. Обучаемые нейронные сети с конкурирующими нейронами: архитектура, алгоритмы обучения, применение.

- •Метод выпуклой комбинации

- •Базы данных

- •Понятие «базы данных». Основные компоненты базы данных.

- •Архитектура системы баз данных.

- •Взаимодействие приложения и субд.

- •Нормальные формы бд. Нормализация данных.

- •Язык sql для работы с реляционными базами данных.

- •Хранимые процедуры, триггеры, транзакции.

Нейронные сети обратного распространения с непрерывной функцией активации: архитектура, алгоритмы обучения, применение.

Сигмоидальные сети

Представленная на рис.1 конфигурация сигмоидальной нейронной сети функционирует следующим образом:

Цель

обучения – настройка параметров (весов)

сети таким образом, чтобы она реализовывала

заданное соответствие между входным и

выходным векторами. Для обучения

выбирается множество

![]() ,

состоящее из соответствующих друг другу

пар входных

,

состоящее из соответствующих друг другу

пар входных

![]() и выходных

и выходных

![]() векторов,

на основании такого множества выполняется

настройка параметров нейронной сети.

векторов,

на основании такого множества выполняется

настройка параметров нейронной сети.

Качество обучения определяется средней ошибкой нейронной сети на всем обучающем множестве

![]()

Алгоритм обучения разработан на основе метода обратного распространения ошибки. Он содержит модификации, включающие пакетное обучение (обучение по эпохам) и применение импульса весов связей сети, и состоит в следующем:

1. Веса связей скрытого

и выходного слоев

![]() инициализируются случайным образом.

Приращения весов связей

инициализируются случайным образом.

Приращения весов связей

![]() инициализируются нулевыми значениями.

Выбирается значение коэффициента

обучения α

из диапазона [0.001; 1] и значение коэффициента

импульса (определяющего вклад в приращение

весов сети результатов предыдущих

итераций) β

из диапазона [0.1; 0.9]. Задается точность

обучения ε.

инициализируются нулевыми значениями.

Выбирается значение коэффициента

обучения α

из диапазона [0.001; 1] и значение коэффициента

импульса (определяющего вклад в приращение

весов сети результатов предыдущих

итераций) β

из диапазона [0.1; 0.9]. Задается точность

обучения ε.

2. Суммы градиентов

весов связей

![]() инициализируются нулевыми значениями.

инициализируются нулевыми значениями.

Для каждой пары

векторов

![]() из обучающего множества выполняются

шаги 2.1-2.2.

из обучающего множества выполняются

шаги 2.1-2.2.

2.1. Вектор

![]() подается на вход нейронной сети и

вычисляются выходы нейронной сети:

подается на вход нейронной сети и

вычисляются выходы нейронной сети:

2.2. К сумме градиентов весов добавляются частные производные функции ошибки, вычисленные для обучающей пары

При этом принимается y0 = 1

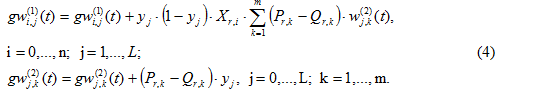

3. Вычисляются новые приращения весов на основе суммы градиентов и предыдущих приращений:

5.

Если средняя ошибка нейронной сети (2)

достигла приемлемого значения

![]() ,

то вычисления завершаются, иначе

выполняется переход к п.2.

,

то вычисления завершаются, иначе

выполняется переход к п.2.

В приведенном

выше алгоритме t=0,1,… означает номер

шага вычислений (эпохи), который

соответствует количеству предъявлений

обучающего множества для настройки

сети. Соответственно,

![]() ,

например, означает значение веса

,

например, означает значение веса

![]() на

t-ом шаге вычислений.

на

t-ом шаге вычислений.

Конструируемые нейронные сети с конкурирующими нейронами: архитектура, применение.

В конструируемой сети число и тип нейронов, граф межнейронных связей, веса входов нейронов определяются при создании сети, исходя из решаемой задачи.

Например, при конструировании сети Хопфилда , функционирующей как ассоциативная память, каждая входная последовательность из заранее определенного набора участвует в определении весов входов нейронов сети.

При подаче на входы частичной или ошибочной входной последовательности сеть через какое-то время переходит в одно из устойчивых состояний, предусмотренных при ее конструировании.

При этом на входах сети появляется последовательность, признаваемая сетью как наиболее близкая к изначально поданной.

Многие нейронные сети используют идеи конкуренции между нейронами для усиления контраста в активности нейронов. В большинстве случаем или экстремальных ситуациях, часто называемые «Победитель получает все! Остается лишь один нейрон, имеющий наибольший выходный сигнал. По способу выделения нейрона-победителя конкурирующие сети можно разделить на 2 класса — сети, веса связей которых остаются фиксированными, и сети веса связей которых меняются в ходе итерационного процесса выделения нейрона-победителя.