- •Введение Архитектура систем передачи и распределения информации

- •Эталонная модель взаимодействия открытых систем (osi – Open System Interconnection)

- •Эталонная модель internet (tcp/ip)

- •Перечень сетевых протоколов

- •Протоколы

- •Способы установления соединений

- •Режимы передачи данных

- •Типы соединений

- •Сообщения и сигналы

- •Модель стандартной одноканальная системы передачи информации

- •Аналоговые системы

- •Энтропия источника дискретных сообщений

- •Энтропия источника независимых сообщений

- •Энтропия источника зависимых сообщений

- •Избыточность источника сообщений

- •Математическая модель сообщения

- •Пропускная способность каналов

- •Дискретный канал без помех

- •Дискретный канал с помехами

- •Пропускная способность бинарного симметричного канала с помехами

- •Теоремы Шеннона для канала с шумами

- •Непрерывный канал с помехами

- •Теория сигналов Классификация сигналов

- •Геометрическое представление сигналов Множества сигналов

- •Пространство сигналов

- •Спектральное представление

- •Реальность спектра

- •Спектр дискретных сигналов

- •Системы единичных функций

- •Системы тригонометрических базисных функций

- •Двоично – ортогональные сбф

- •Упорядочение Уолша-Пэли

- •Упорядочение Адамара

- •Упорядочение Уолша-Уолша

- •Цифровое представление аналоговых сигналов

- •Общая постановка задачи дискретизации

- •Дискретизация сигналов Дискретные и цифровые сигналы

- •Спектры дискретизированных сигналов

- •Регулярность отчетов с.130

- •Восстановление сигналов

- •Квантование сигналов

- •Кодирование и декодирование сигналов

- •Аналого-цифровое преобразование Кодирование информации

- •М етоды сжатия информации

- •Методы сжатия без потерь

- •Код Шеннона-Фано (статистическое кодирование)

- •Блочное кодирование

- •Непомехоустойчивые коды

- •Принципы обнаружения и исправления ошибок

- •Переносчики информации

- •Преобразование сообщений в видеоимпульсный сигнал при передаче в основной полосе (видеоимпульсная передача)

- •Формирование линейного сигнала

- •Кодирование информации в локальных сетях

- •Аналоговая модуляция

- •Импульсная модуляция

- •Цифровая модуляция

- •Связь полосы пропускания со скоростью передачи (видеоимпульсов и радиоимпульсов)

- •Системы передачи с линейным разделением каналов Линейно-разделимые сигналы

- •Формирование канальных сигналов

- •Разделение по форме канальных сигналов

- •Временное разделение

- •Частотное разделение

- •Корреляционное разделение

- •Кодово – адресное разделение

- •Комбинированные методы линейного разделения

- •Нелинейное и комбинационное разделение каналов

- •Нелинейное разделение каналов Разделение сомножителей

- •Разделение по уровню

- •Комбинационные системы передачи

- •Обеспечение дальности связи

- •Общий принцип частотного уплотнения

Энтропия источника зависимых сообщений

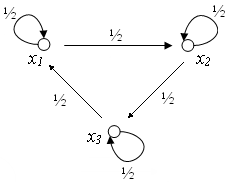

В большинстве реальных случаев появление в последовательности элемента xi зависит от того, какой элемент xj был предшествующим.

Между различными состояниями системы существует статистическая связь, которая может быть связана графом вероятности перехода. Тогда взаимосвязь элементов сообщений или состояний системы характеризуется матрицей условных вероятностей:

Для зависимых элементов энтропия источника H(x) получается усреднением условной энтропии H(x|xj) по вероятностям появления элементов.

![]()

Пример

Найти энтропию источника, описываемую графом вероятности перехода. Вероятности состояний P(x1), P(x2), P(x3) равны.

![]()

Решение

Нетрудно заметить, что

Тогда

![]()

Ответ: энтропия источника H(x)=1.

Избыточность источника сообщений

Если бы сообщения передавались бы с помощью равновероятных букв алфавита и между собой статистически независимых, то энтропия таких сообщений была бы максимальной. На самом деле реальные сообщения строятся из неравновероятных букв алфавита с наличием статистических связей между буквами. Поэтому энтропия реальных сообщений - Hр, оказывается много меньше оптимальных сообщений - Hо. Допустим, нужно передать сообщение, содержащее количество информации, равное I. Источнику, обладающему энтропией на букву, равной Hр, придется затратить некоторое число символов (сообщений) nр, то есть I=npHp . Если энтропия источника была бы Н0, то пришлось бы затратить меньше символов на передачу этого же количества информации I= n0H0

![]() .

.

Таким образом, часть символов nр - nо являются как бы лишними, избыточными. Таким образом, мера удлинения реальных сообщений по сравнению с оптимально закодированными и представляет собой избыточность D.

![]()

Но наличие избыточности нельзя рассматривать как признак несовершенства источника сообщений. Наличие избыточности способствует повышению помехоустойчивости сообщений. Высокая избыточность естественных языков обеспечивает надежное общение между людьми.

Математическая модель сообщения

Алфавит сообщения z={z1,z2,…,zn)

Сигнальный алфавит x={x1,x2,…,xm)

Пропускная способность каналов

Для организации эффективной передачи информации по каналу требуется решение следующих задач:

Определение максимально возможной скорости передачи данных по каналу;

Разработка кодов, позволяющих увеличить скорость передачи информации

Согласование канала с источником с целью передачи информации с минимальными потерями

Введение понятий энтропии, количества информации, скорости выдачи информации источником, избыточности позволяют характеризовать свойства информационных систем. Однако для сравнения информационных систем только такого описания недостаточно. Обычно нас интересует не только передача данного количества информации, но передача его в возможно более короткий срок; не только хранение определенного количества информации, но хранение с помощью минимальной по объему аппаратуры и т.п.

Важнейшей характеристикой канала является пропускная способность канала C, которая определяется как наибольшая возможная скорость передачи по данному каналу

C=vxmax{I(Y,X } бит/сек ,

где vx – предельная скорость передачи по каналу элементарных сигналов x1, x2,…, xn.

Эту скорость можно выразить через среднюю продолжительность символов (импульсов) ср передаваемого сигнала

vx = 1/ ср

Рассмотрим расчет пропускной способности для трех видов каналов:

дискретный канал без помех

дискретный канал с помехами

непрерывный канал с помехами