- •Національний авіаційний університет вступ в системне управління організаціями

- •Список скорочень Передмова

- •Еволюція управлінської думки

- •1.1. Структурний підхід до організації великих систем управління. Ієрархічні структури. Формалізація понять „управління” та „об’єкт управління”.

- •Об' ект управління

- •1.2. Принципи управління. Програмне управління. Управління зі зворотним зв’язком. Стратегічне та ситуаційне управління механізм організаційного управління

- •Принципи організаційного управління

- •Стратегічне та ситуаційне управління в організаційних системах

- •Структура системи управління

- •2.1. Моделі системи управління (неперервна, дискретна, одномірна, багатомірна, детермінована, стохастична, лінійна, нелінійна). Схема формування моделі організаційних систем.

- •2.2. Системний підхід до управління складною системою (алгоритм впровадження системного підходу). Науковий метод вирішення проблем: системний підхід. Системний підхід в організації управління

- •Інформаційно-комунікаційні аспекти

- •Надійність інформації.

- •2.9. Організація комунікативних процесів.

- •Процес передачі інформації.

- •Зразки комунікаційної мережі.

- •3.1. Управлінські рішення. Класифікація управлінських рішень (загальна характеристика та особливості управлінських рішень).

- •Метод зіставлення

- •Метод фільтрації

- •Метод розпізнавання ситуації

- •Застосування методу експертних оцінок в процесі прийняття рішень

- •Ієрархічний тип структур керування

- •Лінійна організаційна структура

- •Лінійно-штабна організаційна структура

- •Дивізіонна структура керування

- •Органічний тип структур керування

- •Бригадна (крос - функціональна) структура керування

- •Проектна структура керування

- •Матрична (програмно-цільова) структура керування

- •Багатомірна організаційна структура

- •Поділ відповідальності

- •Багатомірна організаційна структура й фінансування програм

- •Ранжування показників якості функціонування

- •3 Підходи

- •7 Напрямки

- •11Рис. 1. Багаторівнева ієрархія проблеми

- •11.1.1Т аблиця 1

- •11.1.1.1Матриця попарних порівнянь критеріїв

- •11.1.1.1.1Тобто

- •Багатокритеріальний вибір варіантів системи

- •Контроль у сфері організаційного управління

- •Принципи роботи з персоналом

- •Принципи організації роботи з персоналом

- •Система управління персоналом Завдання, принципи, аспекти, зміст управління персоналом

- •Елементи системи управління персоналом

- •Побудова дерева цілей і виділення функціональних задач.

- •Розробка математичної моделі задачі.

- •Розробка алгоритму рішення задачі.

- •Розробка алгоритму впровадження системного підходу до управління інформаційними системами

- •2.1. Науковий метод управління

- •Управлінський цикл.

- •Управлінська інформація і закономірності її руху.

- •Характетістики управлінської інформації

- •Зібрання і наради як Форма обміну управлінською інформацією.

- •Організація ділових бесід.

- •Питання самоконтролю

Інформаційно-комунікаційні аспекти

Теорія інформації це наука, що вивчає закономірності, пов'язані з отриманням, передачею, обробкою і зберіганням інформації. її основні положення були сформульовані Сенноном в 40-х роках н.е. Теорія інформації є необхідним складовим управління і грає важливу роль в науковому менеджменті.

Інформація наявність деяких відомостей про стан об'єкта і навколишнє зовнішнє середовище. Будь-яка інформація, щоб бути переданою, повинна бути закодована. Сигналами можуть бути світлові або світлові імпульси, сигнали і т.д. Щоб вирішити задачі інформації, треба навчитися вимірювати кількість обсягу інформації, що передається, пропускну спроможність каналу.

Отримала назву Ентропії міри невизначеного стану фізичної системи.

Будь-яке повідомлення являє собою сукупність відомостей про деяку фізичну систему. Міра невизначеності фізичної системи визначається не тільки числом його можливих станів, але і числом його ймовірностей.

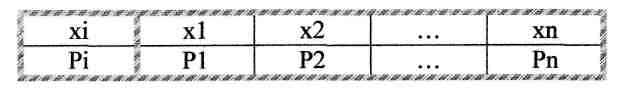

Розглянемо деяку величину X, яке характеризує стан системи. Тоді

Рі = Р(Х~хі) ймовірність того, що система при стані хі буде визначатися цим вираженням

Для опису міри невизначеної системи не важливе чисельне значення кожного х, а важлива міра.

Як міра апріорного невизначення в теорії застосовується спеціальна одиниця вимірювання ентропії. Поняття ентропії є основним

Н(Х) = -

(

![]() *

*

![]() ,

,

![]() )

)

Ентропія володіє рядом властивостей:

1. Звертається в нуль, коли одне з складових достовірне, а інший стан неможливий;

2. При заданому числі станів вона звертається в максимум, коли ці стани різновірогідні;

3. Володіє властивістю адитивності, тобто коли декілька незалежних систем об'єднані в одну, то ентропія складається.

Алгоритм ентропії системи рівний 1.

Надійність інформації.

Надійність передачі інформації визначається надійністю з'єднання елементів в інформаційній системі.

При послідовному з'єднанні елементів вихід з ладу хоч би одного елемента приводить до відмови всієї системи. Імовірність безвідмовної роботи буде дорівнювати виробленню ймовірностей безвідмовної роботи кожного елемента системи.

Рс =

Р1*Р2*...*Рn; Рс =![]() Pc;

Рс(t) =

Рі (t).

Pc;

Рс(t) =

Рі (t).

Якщо в рівнянні імовірність безвідмовної роботи однакова, то

Рс(t) = П Раі (t), де (а = n)

При паралельному з'єднанні елементів система загалом відмовляє при виході з ладу всіх елементів. Імовірність відмови системи рівно імовірності відмови всіх елементів.

qc(t) = q1(t)*q2(t)*...*qn(t);

qс(і) = qi (t) ; Рс(ї) = 1- qі (t) — ймовірність безвідказної роботи

![]() —

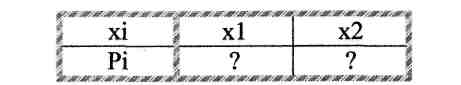

Тривалість

сигналу;

—

Тривалість

сигналу;

—

Час процесу передачі інформації ,

де

—

Час процесу передачі інформації ,

де

![]() — час переносу інформації і

— час переносу інформації і

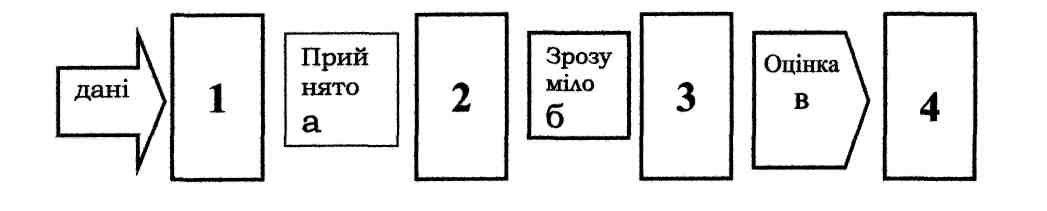

Процес сприйняття (передачі) інформації.

Розглянемо як проходження через три фільтра:

1 Фізичний фільтр;

2 Соматичний фільтр;

3 Прагматичний фільтр;

4 Використана інформація;

а Статистична інформація;

б Семантична інформація;

в Прагматична інформація.

2.9. Організація комунікативних процесів.

Надійність і ефективність передачі інформації залежить від комунікабельності, тобто передачі інформації від одного суб'єкта іншому. Як суб'єкти можуть виступати як окремі особи, так і організації.

Обмін інформації включає три етапи:

1. Ініціювання;

2. Передача інформації від джерела в пункт призначення;

3. Вплив інформації на одержувач і його відгук.