- •Раздел 1. Элементы теории вероятностей и математической статистики 2

- •Раздел 2. Основы проверки статистических гипотез 65

- •Раздел 1. Элементы теории вероятностей и математической статистики

- •1. Основные определения и теоремы

- •1.1. Предмет теории вероятности

- •1.2. Событие как результат испытания

- •1.3. Частость и вероятность. Классическое определение вероятности

- •1.4. Теорема сложения вероятностей

- •1.5. Теорема умножения вероятностей

- •2. Повторные независимые испытания

- •2.1. Биномиальное распределение вероятностей

- •2.2. Наивероятнейшее число появлений события

- •2.3. Асимптотическая формула биномиального распределения (локальная терема Лапласа). Формула Пуассона

- •2.4. Интегральная теорема Лапласа

- •Упражнения.

- •3. Случайная величина и ее числовые характеристики

- •3.1. Случайная величина и ее распределение

- •3.2. Математическое ожидание и его свойства

- •3.3. Дисперсия и среднее квадратическое отклонение

- •3.4. Нормальный закон распределения и понятие о теореме Ляпунова

- •4. Закон больших чисел

- •4.1. Неравенства Маркова и Чебышева

- •4.2. Теорема Чебышева

- •5. Основные сведения из математической статистики

- •5.1. Генеральная совокупность и выборка

- •5.2. Устойчивость выборочных средних

- •5.3. Определение параметров выборки с помощью теоремы Ляпунова

- •5.4. Понятие о доверительных границах для средних

- •5.5. Примеры математической обработки данных выборочного наблюдения

- •5.6. Понятие о критериях согласия

- •6. Элементы теории корреляции

- •6.1. Функциональная и корреляционная зависимости

- •6.2. Линейная корреляция.

- •6.3. Коэффициент корреляции

- •6.4. Упрошенный способ вычисления коэффициента корреляции

- •6.5. Простейшие случаи криволинейной корреляции

- •6.6. Понятие о множественной корреляции

- •Упражнения

- •Раздел 2. Основы проверки статистических гипотез

- •1. Статистические модели

- •2. Проверка статистических гипотез (общие положения)

- •3. Примеры статистических моделей и гипотез, ранги и ранжирование

- •4. Проверка статистических гипотез (прикладные задачи)

- •4.1. Схема испытаний Бернулли

- •4.2. Критерий знаков для одной выборки

- •5. Проверка гипотез в двухвыборочных задачах

- •5.1. Критерий Манна-Уитни

- •5.2. Критерий Уилкоксона

- •6. Парные наблюдения

- •6.1. Критерий знаков для анализа парных повторных наблюдений

- •6.2. Анализ повторных парных наблюдений с помощью знаковых рангов (критерий знаковых ранговых сумм Уилкоксона)

- •Список использованной литературы

- •Список рекомендуемой литературы

6.3. Коэффициент корреляции

В рассмотренном примере корреляционной

связи оба коэффициента регрессии

![]() и

и

![]() положительны. В таком случае корреляцию

называют положительной, что имеет место

при изменении изучаемых количественных

признаков в одинаковом направлении (х

и у одновременно возрастают или

одновременно убывают).

положительны. В таком случае корреляцию

называют положительной, что имеет место

при изменении изучаемых количественных

признаков в одинаковом направлении (х

и у одновременно возрастают или

одновременно убывают).

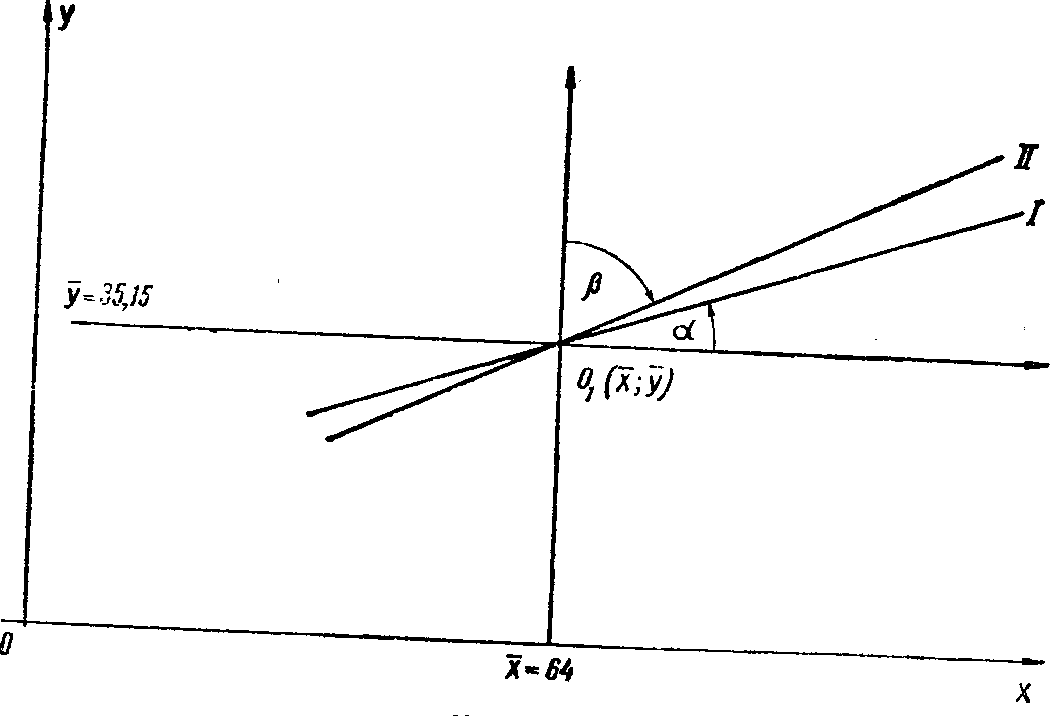

Прямые при положительных коэффициентах

регрессии образуют острые углы с

соответствующими осями координат (рис.

14) — у прямой регрессии у по х

коэффициент регрессии

![]() ,

где

— острый угол, образованный

прямой I

с осью Ох, а у прямой регрессии х

по y

коэффициент регрессии

,

где

— острый угол, образованный

прямой I

с осью Ох, а у прямой регрессии х

по y

коэффициент регрессии

![]() ,

где

— острый угол, образованный

прямой II

с осью Оу. При отрицательных

коэффициентах регрессии прямые регрессии

образуют с соответствующими осями тупые

углы.

,

где

— острый угол, образованный

прямой II

с осью Оу. При отрицательных

коэффициентах регрессии прямые регрессии

образуют с соответствующими осями тупые

углы.

Для большей наглядности на рис.

14 показано положение прямых регрессии

относительно новой системы координат

с началом в точке

![]() пересечения этих прямых.

пересечения этих прямых.

Рис. 14

Сами по себе значения коэффициентов регрессии не позволяют судить о тесноте связи между х и у. Это зависит от величины угла, образованного прямыми регрессии. Чем меньше этот угол, тел; теснее корреляционная связь между х и у.

При слиянии этих двух прямых в одну имеет место линейная функциональная зависимость между х и у.

В качестве меры тесноты линейной корреляционной связи принимается коэффициент корреляции

![]()

со знаком, совпадающим со знаками

коэффициентов регрессии. При этом, если

прямые I

и II

совпадают, то

![]() и

и

![]() .

Но тогда

.

Но тогда

![]() и, следовательно,

и, следовательно,

![]() .

.

Обращение коэффициента корреляции в 1 или в -1 является, как это можно доказать, необходимым и достаточным признаком. линейной функциональной зависимости между х и у.

Корреляционная таблица в таких случаях состоит из расположенных лишь на одной диагонали частот значений х и у.

Вместе с тем, когда, по крайней мере,

один из углов

или

равен нулю, то и

![]() ,

а значит, и между рассматриваемыми

величинами не существует ни функциональной,

ни корреляционной линейной зависимости.

Однако в этом случае между х и у

возможны нелинейные корреляционные и

даже функциональные связи.

,

а значит, и между рассматриваемыми

величинами не существует ни функциональной,

ни корреляционной линейной зависимости.

Однако в этом случае между х и у

возможны нелинейные корреляционные и

даже функциональные связи.

Корреляционная зависимость между х и у (для положительных коэффициентов регрессии) имеет место, когда коэффициент корреляции, как это можно доказать, выражается правильной дробью (0 < r < 1). При этом связь между переменными тем теснее, чем ближе коэффициент корреляции к 1.

Введенное определение коэффициента

корреляции в виде

![]() позволяет на основании выражений

коэффициентов регрессии получить

удобную формулу для непосредственного

вычисления коэффициента корреляции.

позволяет на основании выражений

коэффициентов регрессии получить

удобную формулу для непосредственного

вычисления коэффициента корреляции.

Если обратиться к выражениям коэффициентов прямых регрессии

![]() и

и

![]() ,

,

то можно заметить, что знаменатели в обоих выражениях обозначают дисперсии соответствующих рядов распределений:

![]() и

и

![]() .

.

Отсюда можно получить для коэффициента корреляции формулу

![]() ,

,

которая

сразу показывает, что между независимыми

величинами корреляции не существует,

так как для таких величин выполняется

равенство ![]() .

.

Замечание. Последнее равенство

является приближенным, а поэтому если

коэффициент корреляции очень мал

![]() ,

считают, что линейной корреляции между

х и у нет.

,

считают, что линейной корреляции между

х и у нет.

Записанная выше формула позволяет выразить каждый коэффициент регрессии через коэффициент корреляции.

Так, коэффициент регрессии у по x

![]() ,

,

а коэффициент регрессии х по у

![]() .

.

Такие выражения коэффициентов регрессии показывают, что составление уравнений прямых регрессии может быть облегчено, если будет найдено значение коэффициента корреляции. Для его вычисления следует использовать выражения числителя и знаменателя:

![]() .

.

Тогда можно вычислить коэффициент корреляции по формуле

.

.

Пример 1. В табл. 6 дана группировка 135 сахаропесочных заводов по размеру производственных основных средств в млн. руб. (х) и по среднесуточной переработке свеклы в тыс. ц (у). Требуется определить коэффициент корреляции и составить уравнения регрессии.

Таблица 6

x |

4 |

5 |

6 |

7 |

8 |

9 |

10 |

11 |

12 |

|

1,75 2,25 2,75 3,25 3,75 4,25 |

4 5 3 |

6 9 4 3 |

9 15 6 2 3 |

2 10 7 7 3 2 |

2 7 8 2 2 |

1

1 3 1 |

1

2 2 |

2 |

1 |

21 42 25 24 13 10 |

|

12 |

22 |

35 |

31 |

21 |

6 |

5 |

2 |

1 |

135 |

Расположение рядов распределения значений у в табл. 6 позволяет наметить линейную корреляционную связь между х и у.

Для отыскания коэффициента корреляции составим вспомогательную таблицу.

Таблица 7

|

|

|

|

|

|

|

|

21 42 25 24 13 10 |

211,75 422,25 252,75 243,25 133,75 104,25 |

213,0625 425,0625 257,5625 2410,5625 1314,0625 1018,0625 |

1,75114 2,25250 2,75171 3,25161 3,75102 4,2593 |

12 22 35 31 21 6 5 2 1 |

124 225 356 317 218 69 510 211 112 |

1216 2225 3536 3149 2164 681 5100 2121 1144 |

428,00 451,50 683,75 787,75 865,75 921,00 1018,75 118,50 124,25 |

N=135 |

369,25 |

1082,9375 |

2533,25 |

135 |

891 |

6237 |

2533,25 |

Следует пояснить, что вторые множители

в четвертом столбце

![]() получены из данных табл. 6

суммированием произведений каждого

числа внутренней строки на соответствующее

значение у (например, 114=44+65+96+27;

171= 45+66+77+87+110).

получены из данных табл. 6

суммированием произведений каждого

числа внутренней строки на соответствующее

значение у (например, 114=44+65+96+27;

171= 45+66+77+87+110).

Так как суммирование этих вторых

множителей дает сумму всех значений у,

то сумма

![]() ,

и это равенство подтверждает правильность

подсчета суммы всех значений у.

Аналогична структура вторых множителей

в последнем столбце. Например, 28

= 41,75+52,25+33,25.

Здесь суммирование вторых множителей

дает сумму всех значений х, а потому

равенство

,

и это равенство подтверждает правильность

подсчета суммы всех значений у.

Аналогична структура вторых множителей

в последнем столбце. Например, 28

= 41,75+52,25+33,25.

Здесь суммирование вторых множителей

дает сумму всех значений х, а потому

равенство

![]() служит для подтверждения правильности

подсчета. Вместе с тем итоговые суммы

по четвертому и последнему столбцам

являются в то же время суммами всех

участвующих в таблице парных произведений

ху. Отсюда

служит для подтверждения правильности

подсчета. Вместе с тем итоговые суммы

по четвертому и последнему столбцам

являются в то же время суммами всех

участвующих в таблице парных произведений

ху. Отсюда ![]() .

.

По данным подсчетов имеем:

Отсюда

![]() и

и

![]() и

коэффициент корреляции

и

коэффициент корреляции

![]() .

.

Для составления уравнений прямых регрессии определяем коэффициенты регрессии:

Таким образом, уравнение прямой регрессии у по х

![]() или

или

![]()

а уравнение прямой регрессии х по у

![]() или

или

![]()

Сравнение коэффициента корреляции в

этом примере

![]() с коэффициентом корреляции в ранее

рассмотренном примере распределения

растений житняка

с коэффициентом корреляции в ранее

рассмотренном примере распределения

растений житняка

![]()

показывает на большую тесноту связи между, общим весом и весом семян. Это согласуется со структурой соответствующих корреляционных таблиц. Табл. 1 распределения растений житняка характерна четким смещением рядов распределения значений у при малой степени рассеяния этих значений, а табл. 6 по сахаропесочным заводам дает малозаметное смещение рядов распределения значений у при значительной степени рассеяния этих значений.

y

y