- •Орієнтовний перелік питань для підсумкового контролю знань

- •Тема 1. Математичне моделювання як метод наукового пізнання економічних явищ і процесів

- •1.1 Економетрика як наука, об’єкт, предмет, мета та задачі. Основні характеристики економічної системи як об’єкта моделювання

- •1.2 Поняття моделі. Математична модель, основні етапи процесу моделювання, класифікація моделей

- •Етапи проведення економетричних досліджень

- •Тема 2. Моделі парної регресії та їх дослідження

- •2.1 Приклади парних зв’язків в економіці

- •Модель споживання

- •Модель пропозиції та попиту

- •Найпростіша кон'юнктурна модель (модель Кейнса)

- •Виробнича функція Кобба-Дугласа

- •2.2 Парна регресія

- •2.2.1 Специфікація моделі

- •2.2.2 Визначення параметрів рівняння регресії за допомогою методу найменших квадратів

- •Тема 3. Загальна лінійна економетрична модель

- •3.1 Загальний вид лінійної економетричної моделі, її структура та етапи побудови

- •3.2 Деяка інформація про випадкові збудники

- •3.3 Умови Гауса-Маркова. Гомоскедастичні та гетероскедастичні моделі

- •Тема 4. Лінійна парна регресія

- •4.1 Загальний вид лінійної парної моделі

- •4.2 Визначення оцінок параметрів парної лінійної регресії за допомогою мнк

- •4.3 Властивості оцінок, а також залишків мнк, їх характеристика

- •4.4 Аналіз рівнянь лінійної регресії і властивості вибіркового коефіцієнту кореляції

- •4.5 Дисперсійний аналіз та поняття коефіцієнта детермінації, його властивості

- •Властивості коефіцієнта детермінації

- •4.6 Перевірка лінійної моделі на адекватність. Поняття -критерію Фішера

- •4.7 Перевірка значимості параметрів регресійної моделі та коефіцієнту кореляції

- •4.8 Побудова інтервалів довіри для параметрів регресійної моделі

- •4.9 Зона довіри для лінії регресії

- •4.10 Прогноз і інтервал довіри для прогнозу

- •4.11 Коефіцієнт еластичності

- •Тема 5. Нелінійна парна регресія

- •5.1 Загальні відомості

- •5.2 Метод лінеаризації

- •5.3 Методи обчислення невідомих параметрів нелінійних моделей

- •5.4 Перевірка адекватності квадратичного рівняння регресії

- •5.5 Довірчий інтервал і прогноз для нелінійної моделі

- •5.6 Коефіцієнти еластичності для нелінійних моделей

- •5.7 Аналіз монопольного ринку

- •Коефіцієнт еластичності попиту

- •Тема 6. Множинна регресія

- •6.1 Загальні відомості

- •6.2 Вибір та аналіз усіх можливих факторів, які впливають на процес або показник, що досліджується

- •6.2.1 Поняття про мультиколінеарність та її вплив на оцінки параметрів моделі

- •6.2.2 Порядок виявлення та усунення мультиколінеарності

- •6.2.3 Виявлення мультиколінеарності в масиві факторів за допомогою алгоритму Фаррара-Глобера

- •6.2.4 Алгоритм усунення мультиколінеарності

- •6.3 Вибір виду рівняння регресії

- •6.4 Загальна модель множинної лінійної регресії

- •6.5 Емпірична модель множинної лінійної регресії

- •6.6 Визначення коефіцієнтів рівняння множинної лінійної регресії

- •6.7 Перевірка адекватності множинної регресійної моделі

- •6.8 Прогноз і довірчий інтервал для прогнозу множинної регресії

- •Тема 7. Економетричні моделі динаміки

- •7.1 Методи моделювання часових рядів

- •7.2 Автокореляція часового ряду

- •Властивості коефіцієнта автокореляції

- •7.3 Моделювання тенденції часового ряду: згладжування та аналітичне вирівнювання

- •7.4 Автокореляція залишків в множинній регресії

- •7.4.1 Поняття про автокореляцію залишків, її природа, причини виникнення і наслідки

- •7.4.2 Визначення наявності автокореляції залишків

- •Алгоритм тесту Дарбіна-Уотсона

- •Обмеження на застосування критерія Дарбіна-Уотсона

- •Словник

- •Рекомендована література Основна:

- •Додаткова:

4.3 Властивості оцінок, а також залишків мнк, їх характеристика

В лінійній моделі

(4.13) коефіцієнт

(нахил) має назву коефіцієнту регресії,

який показує середнє змінення результату

при зміненні фактору

на одну одиницю. Коефіцієнт регресії

завжди має найменування. Якщо

![]() ,

то зв’язок між ознаками прямий, якщо

,

то зв’язок між ознаками прямий, якщо

![]() ,

то зв’язок зворотній, якщо

,

то зв’язок зворотній, якщо

![]() ,

то лінійний зв’язок відсутній.

,

то лінійний зв’язок відсутній.

Формально параметр

– це початок відліку або значення

![]() при

при

![]() (тобто точка перетину з віссю ординат).

Цей параметр може не мати економічного

змісту, адже спроби економічно

інтерпретувати цей параметр можуть

привести до абсурду, особливо, якщо

(тобто точка перетину з віссю ординат).

Цей параметр може не мати економічного

змісту, адже спроби економічно

інтерпретувати цей параметр можуть

привести до абсурду, особливо, якщо

![]() .

Інтерпретувати можливо лише знак при

параметрі

.

Якщо

.

Інтерпретувати можливо лише знак при

параметрі

.

Якщо

![]() ,

то відносне змінення результату

відбувається повільніше, ніж змінення

фактору

(варіація результату менше варіації

фактору).

,

то відносне змінення результату

відбувається повільніше, ніж змінення

фактору

(варіація результату менше варіації

фактору).

Отриманi результати, зокрема формули (4.11) i (4.12), дають змогу зробити ряд висновків.

1. Оцінки МНК є функціями від вибірки.

2. Оцінки МНК є точковими оцінками теоретичних коефіцієнтів регресії.

З. Вiдповiдно до

формули (4.12) емпірична пряма регресії

обов’язково проходить через точку

![]() .

.

4. Емпіричне рівняння

регресії побудоване в такий спосіб, що

сума відхилень (залишків)

![]() ,

а також середнє значення відхилення

,

а також середнє значення відхилення

![]() дорівнюють нулю:

дорівнюють нулю:

|

(4.18) |

5. Випадкові

відхилення

![]() некорельованi зi спостереженими значеннями

некорельованi зi спостереженими значеннями

![]() залежної змінної

.

залежної змінної

.

6. Випадкові

відхилення

некорельовані зi спостереженими

значеннями

![]() незалежної змінної

i з оціненими

за лінійною регресійною моделлю

значеннями залежної змінної

незалежної змінної

i з оціненими

за лінійною регресійною моделлю

значеннями залежної змінної

![]() .

.

4.4 Аналіз рівнянь лінійної регресії і властивості вибіркового коефіцієнту кореляції

Знайдемо щільність зв’язку між залежною величиною і незалежною . Рівняння регресії завжди доповнюється показником, який характеризує ступінь щільності зв’язку між ознаками. Найпростішим критерієм, який дає кількісну оцінку зв’язку між двома показниками, при використанні лінійної регресії виступає вибірковий коефіцієнт кореляції (або лінійний коефіцієнт кореляції).

Лінійний коефіцієнт

кореляції

![]() (

(![]() )

характеризує ступінь щільності лінійної

кореляційної залежності, тобто показує

наскільки розкидані експериментальні

статистичні дані відносно прямої лінії

регресії:

)

характеризує ступінь щільності лінійної

кореляційної залежності, тобто показує

наскільки розкидані експериментальні

статистичні дані відносно прямої лінії

регресії:

|

(4.19) |

де

![]() – коефіцієнт коваріації, який характеризує

не лише зв’язок між випадковими

величинами

і

,

а й їх розсіяння:

– коефіцієнт коваріації, який характеризує

не лише зв’язок між випадковими

величинами

і

,

а й їх розсіяння:

|

(4.20) |

Підставивши (4.20) в (4.19), маємо:

|

(4.21) |

Отже, вибірковий коефіцієнт кореляції характеризує ступінь вираженості лінійної залежності і .

Нагадаємо, що рівняння парної лінійної регресії можна представити в будь-якій з трьох форм запису:

Тип рівняння |

Регресія на |

Регресія на |

Рівняння прямої з кутовим коефіцієнтом |

|

|

Центроване рівняння (рівняння прямої,яка проходить через задану точку) |

|

|

Стандартизоване рівняння |

|

|

Структура цих рівнянь дозволяє зробити наступні висновки:

1. Обидві прямі проходять через точку з координатами і в цій точці перетинаються (рис. 4.2).

Рисунок 4.2 – Перетин прямих регресії

2. Розглянемо

випадок, коли

![]() .

При цьому обидва стандартизованих

рівняння регресії матимуть вид:

.

При цьому обидва стандартизованих

рівняння регресії матимуть вид:

![]() .

Це означає, що прямі регресії співпадають

– зливаються в одну. Це характерно для

випадку, коли розкиду даних спостережень

немає, а отже всі точки кореляційного

поля лежать точно на одній прямій

регресії (рис. 4.3).

.

Це означає, що прямі регресії співпадають

– зливаються в одну. Це характерно для

випадку, коли розкиду даних спостережень

немає, а отже всі точки кореляційного

поля лежать точно на одній прямій

регресії (рис. 4.3).

Рисунок 4.3 – Співпадіння прямих регресій

В цьому випадку між і існує лінійна функціональна залежність.

3. Розглянемо

випадок, коли

![]() .

При цьому стандартизовані рівняння

регресії приймають вид:

.

При цьому стандартизовані рівняння

регресії приймають вид:

|

(4.22) |

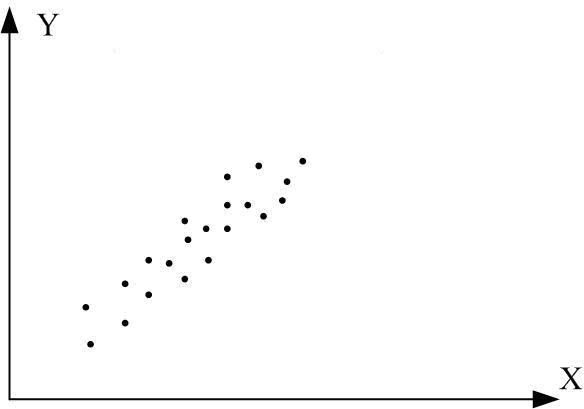

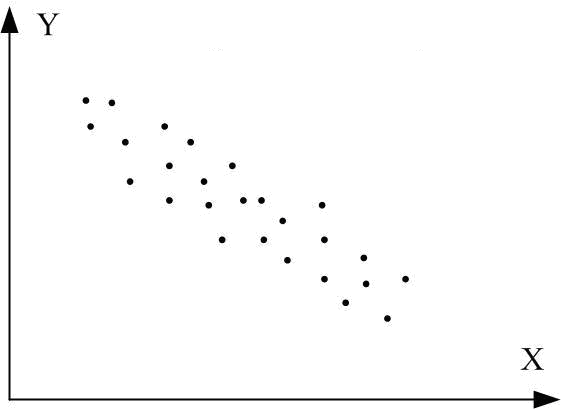

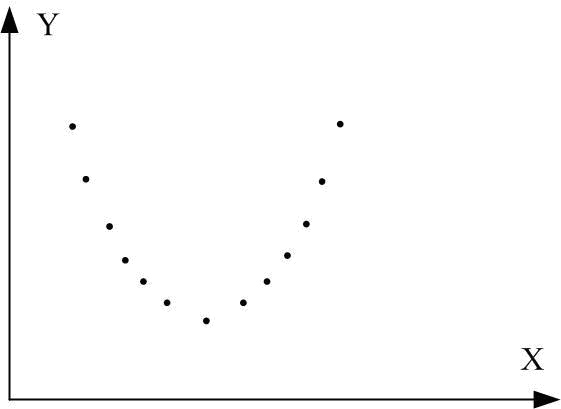

Це означає, що пряма регресії на горизонтальна, а на – вертикальна. Тобто, прямі регресії перпендикулярні одна одній і лінійний зв’язок у даному випадку відсутній. Це можливо у двох випадках: а) залежності між факторами немає взагалі (рис. 4.4 а); б) залежність є, і можливо дуже тісна, але вона не є лінійною (рис. 4.4 б).

а) б)

Рисунок 4.4 – Перпендикулярність прямих регресії

4. Знак показує якою є залежність – зростаючою чи спадаючою. Знак залежить від знака чисельника (4.19), що є мірою коваріації за вибіркою двох змінних:

![]() – обидві прямі

регресії зростаючі (додатня регресія),

– обидві прямі

регресії зростаючі (додатня регресія),

![]() – обидві прямі

регресії спадаючі (від’ємна регресія).

– обидві прямі

регресії спадаючі (від’ємна регресія).

Отже, вибірковий коефіцієнт кореляції (при достатньо великому обсязі вибірки ) так же, як коефіцієнт кореляції двох випадкових величин має наступні властивості:

Коефіцієнт кореляції може бути додатнім або від’ємним. Знак

біля значення

коефіцієнта кореляції вказує на напрямок

зв’язку: «+» – прямий, «–» – зворотній.

біля значення

коефіцієнта кореляції вказує на напрямок

зв’язку: «+» – прямий, «–» – зворотній.Коефіцієнт кореляції може приймати значення від –1 до 1, тобто

або

або

.

.

Чим ближче

![]() до нуля, тим більший розкид статистичних

даних відносно прямої регресії, тим ця

кореляційна залежність слабша.

до нуля, тим більший розкид статистичних

даних відносно прямої регресії, тим ця

кореляційна залежність слабша.

Чим ближче до одиниці, тим менший розкид статистичних даних відносно прямої регресії, тим ця кореляційна залежність тісніша.

Якщо

![]() ,

то прямі

регресії наближаються одна до іншої.

Якщо

,

то прямі

регресії наближаються одна до іншої.

Якщо

![]() ,

то прямі

регресії віддаляються одна від іншої

аж до перпендикулярності.

,

то прямі

регресії віддаляються одна від іншої

аж до перпендикулярності.

Чим ближче коефіцієнт кореляції до одиниці, тим зв’язок між ознаками щільніший:

![]() – зв’язку немає;

– зв’язку немає;

![]() – зв’язок слабкий;

– зв’язок слабкий;

![]() – зв’язок помірний;

– зв’язок помірний;

![]() – зв’язок помітний;

– зв’язок помітний;

![]() – зв’язок сильний;

– зв’язок сильний;

![]() – зв’язок дуже

сильний;

– зв’язок дуже

сильний;

![]() – зв’язок повний.

– зв’язок повний.

За своєю природою він симетричний, тобто коефіцієнт кореляції між і (

)

той же, що й між

і

(

)

той же, що й між

і

( ).

).Він незалежний по відношенню до вибору початку системи координат і масштабу вздовж осей координат, тобто, якщо визначимо

і

і

,

де

,

,

,

,

і

– константи,

то коефіцієнт

кореляції між

,

де

,

,

,

,

і

– константи,

то коефіцієнт

кореляції між

і

і

матиме те ж

значення, що й між початковими змінними

і

.

матиме те ж

значення, що й між початковими змінними

і

.Якщо і статистично незалежні, коефіцієнт кореляції між ними дорівнює нулю, але якщо

,

це не означає, що дві змінні незалежні.

Іншими словами, нульовий коефіцієнт

кореляції не обов’язково означає

незалежність (рис. 4.5 з).

,

це не означає, що дві змінні незалежні.

Іншими словами, нульовий коефіцієнт

кореляції не обов’язково означає

незалежність (рис. 4.5 з).Коефіцієнт кореляції є мірою тільки лінійної асоціативності або лінійної залежності; він незастосовний для опису нелінійної залежності. Так, на рис. 4.5, з

є точна залежність, хоча

є точна залежність, хоча

.

.

|

|

а) |

б) |

|

|

в) |

г) |

|

|

д) |

є) |

|

|

ж) |

з) |

Рисунок 4.5 – Кореляційний коефіцієнт для різних випадків вибірок

а)

![]() ;

б)

;

б)

![]() ;

в)

;

в)

![]() близький до 1; г)

близький до –1;

близький до 1; г)

близький до –1;

д) додатній, близький до 0; є) r від’ємний, близький до 0; ж) ; з)

Хоча є мірою лінійної асоціативності між двома змінними, це необов’язково означає який-небудь причинно-наслідковий зв’язок, як було відзначено раніше.

,

, .

.