- •Информалогия

- •Информация

- •Определение информации

- •Виды информации

- •Теория информации

- •Понятие кибернетики

- •Основные понятия кибернетики

- •Теория информации

- •Кибернетика

- •Концепция Винера

- •Современная кибернетика

- •Прообраз эвм

- •Прообраз эвм

- •История программирования

- •Отечественные ученые.

- •Машина Тьюринга

- •Развитие кибернетики

- •Направления кибернетики

- •Теоретическая кибернетика

- •Техническая кибернетика

- •Биологическая кибернетика

- •Социальная кибернетика

- •Развитие кибернетики

- •Развитие эвм

- •Развитие компьютерных технологий

- •Компьютика

- •Информациология

- •Информатика

- •Информационные революции

Информалогия

В основе понятия «информатизация общества» лежит понятие «информация». В конце 1950-х гг., когда американским инженером Р. Хартли была сделана попытка ввести количественную меру информации, передаваемой но каналам связи, возникла информалогия наука о процессах и задачах передачи, распределения, обработки и преобразования информации.

Информация

Информация - это совокупность знаний о фактических данных и зависимостях между ними. Выделяют три фазы существования информации:

- ассимилированная информация (представление сообщений в сознании человека, наложенное на систему его понятий и оценок);

- документированная информация (сведения, зафиксированные в знаковой форме на физическом носителе);

- передаваемая информация (сведения, рассматриваемые в момент передачи информации от источника к приемнику).

В дальнейшем будем рассматривать только документированную и передаваемую информацию.

Определение информации

Информация - это сведения или данные, объективно отражающие различные стороны и элементы окружающего мира и деятельности человека на определенном этапе развития общества, представляющие для него какой -либо интерес и материализованные в форме, удобной для использования, передачи, хранения или обработки ( преобразования) человеком или

автоматизированными средствами.

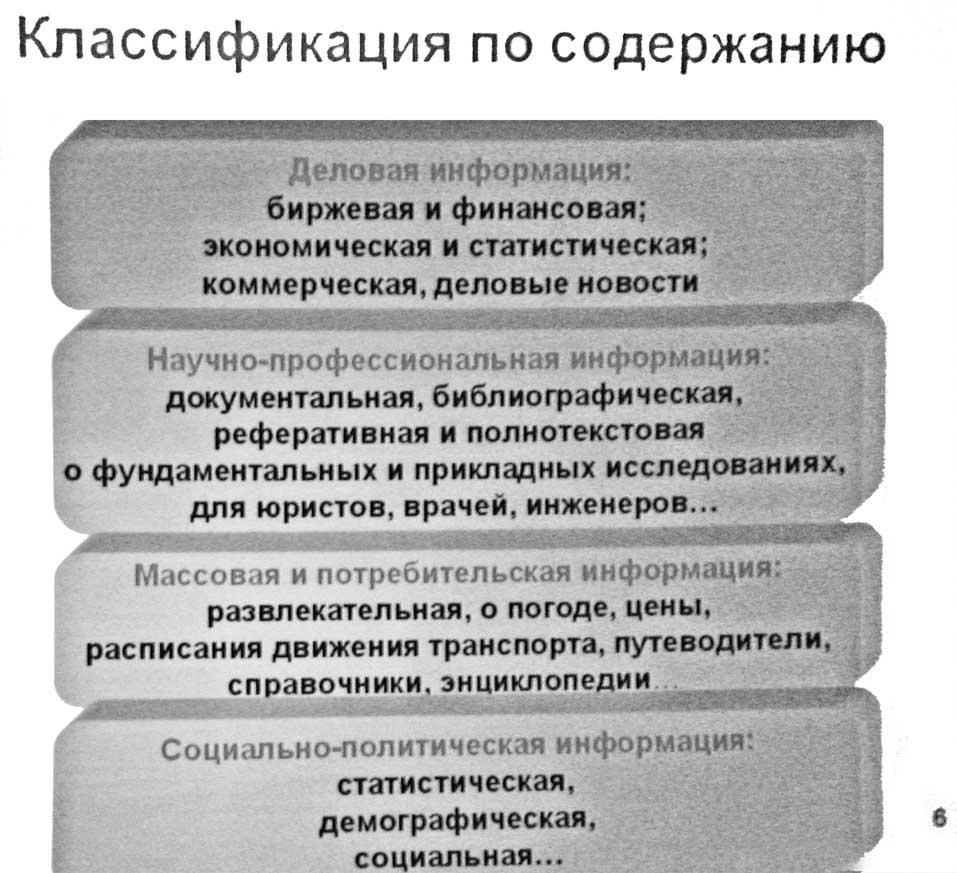

Виды информации

Информацию как продукт производства и применения отличает прежде всего предметное содержание. Она очень разнообразна и подразделяется по виду обслуживаемой ею человеческой деятельности: научная, техническая, производственная, управленческая, экономическая, социальная, правовая, массовая, и т.д.

Теория информации

Теория информации К. Шеннона позволяла ставить и решать задачи об оптимальном кодировании передаваемых сигналов с целью повышения пропускной способности каналов связи.

В работах Р. Хартли и К. Шеннона информация рассматривается лишь в своей внешней оболочке. представленной отношениями сигналов, знаков и сообщений друг другу, т.е. синтаксическими отношениями. Количественная мера Хартли-Шеннона не претендуют на оценку содержательной (семантической) или

ценностной, полезной (прагматической) стороны передаваемого сообщения.

Понятие кибернетики

Новый этап теоретического расширения понятия «информация» связан с кибернетикой (греч. kiber - над, nautus -моряк, кормчий, управляющий рулем, отсюда - искусство управления) - наукой об управлении и связи в живых организмах, обществе и машинах, технических системах. Впервые термин «кибернетика» встречается в работах древнегреческого философа Платона (около 427 - 347 г.г. до н.э.). в которых он обозначил правила управления обществом.

Основные понятия кибернетики

Через две с лишним тысячи лет французский физик А.И.Ампер (1775-1836) в своей работе «Опыт философских наук» (1834) термин «кибернетика» также применил к науке об управлении обществом.

Теория информации

Важнейшие для кибернетики проблемы измерения количества информации были разработаны американским инженером и математиком К. Шенноном (1916-2001), опубликовавшим в 1948 г классический труд «Теория передачи электрических сигналов при наличии помех» в котором заложены основные идеи существенного раздела кибернетики - теории информации.