Обучение без учителя

Алгоритмы обучения Хебба

Сигнальный метод обучения Хебба

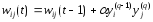

Изменение весов производится по правилу:

|

|

(11) |

где  – выходное значение i-го

нейрона (q-1)-го

слоя;

– выходное значение i-го

нейрона (q-1)-го

слоя;

– выходное значение j-го

нейрона (q)-го

слоя;

– выходное значение j-го

нейрона (q)-го

слоя;

и

и

– весовой коэффициент синапса,

соединяющего эти нейроны на t-й

и (t-1)-й

итерациях соответственно;

– весовой коэффициент синапса,

соединяющего эти нейроны на t-й

и (t-1)-й

итерациях соответственно;

– коэффициент скорости обучения.

При обучении по данному методу усиливаются связи между возбужденными нейронами.

Дифференциальный метод обучения Хебба

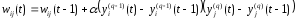

Изменение весов производится по правилу:

|

|

(12) |

где  и

и

– выходное значение i-го

нейрона (q-1)-го

слоя на t-й

и (t-1)-й

итерациях соответственно;

– выходное значение i-го

нейрона (q-1)-го

слоя на t-й

и (t-1)-й

итерациях соответственно;

и

и

– выходное значение j-го

нейрона (q)-го

слоя на t-й

и (t-1)-й

итерациях соответственно.

– выходное значение j-го

нейрона (q)-го

слоя на t-й

и (t-1)-й

итерациях соответственно.

Более интенсивно обучаются синапсы, соединяющие нейроны, выходы которых увеличиваются наиболее динамично.

Алгоритм обучения для обоих методов [4]:

Шаг 1. На стадии инициализации всем весовым коэффициентам присваиваются небольшие случайные значения.

Шаг 2. На входы НС подается входной образ и сигналы распространяются по всем слоям.

Шаг 3. Производится изменение весовых коэффициентов по одной из указанных формул.

Шаг 4. Пока выходные значения сети не стабилизируются с заданной точностью, переход к шагу 2.

На шаге 2 НС попеременно предъявляются все образы входного набора.

Вид откликов на каждый класс входных образов заранее неизвестен и представляет собой произвольное сочетание состояний нейронов входного слоя, обусловленное случайным распределением весов на стадии инициализации. Схожие образы относятся к одному классу. Топология классов в выходном слое сети определяется путем тестирования. Для приведения откликов НС к удобному представлению можно дополнить НС одним слоем, обученным, например, по алгоритму обучения однослойного персептрона выдавать требуемые отклики.

Алгоритм обучения Кохонена

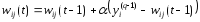

Изменение весов производится по правилу [4]:

|

|

(13) |

Обучение сводится к минимизации разницы между входными сигналами нейрона, поступающими с выходов нейронов предыдущего слоя, и весовыми коэффициентами его синапсов.

Алгоритм обучения сходен с алгоритмом Хебба. Основное отличие в том, что на шаге 3 из всего слоя выбирается нейрон, значения синапсов которого максимально походят на входной образ, и подстройка весов производится только для него. Подстройка весов выбранного нейрона называется аккредитацией [2].

Критерии выбора аккредитуемого нейрона:

а) Максимум скалярного произведения вектора весов синапсов нейрона и вектора входа нейрона.

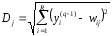

б) Минимум расстояния между этими векторами:

|

|

(14) |

Иногда слишком часто получающие аккредитацию нейроны принудительно исключаются из рассмотрения, чтобы уравнять права всех нейронов слоя.

С целью сокращения длительности процесса обучения нормируют входные образы и начальные значения весовых коэффициентов:

|

|

(15) |

где n – количество входных сигналов.

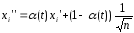

Чтобы избежать отрицательных последствий случайного выбора весовых коэффициентов, используют метод выпуклой комбинации. Входные нормализованные образы подвергаются преобразованию:

|

|

(16) |

где (t) – коэффициент, изменяющийся в процессе обучения от нуля до единицы, в результате чего вначале на входы сети подаются практически одинаковые образы, а с течением времени они все больше сходятся к исходным.

,

, ,

, .

. .

. ,

, ,

, ,

,