- •Базовые понятия теории информации: информация, сообщение, сигнал. Виды и свойства информации

- •Дискретные и непрерывные сообщения. Алфавит сообщений. Сигналы и знаки. Классификация сигналов. Цифровой сигнал

- •Количественная мера информации. Свойства количества информации

- •Энтропия. Свойства энтропии

- •Энтропия объектов с дискретным и непрерывным множеством состояний. Среднее количество информации

- •Понятие канала связи. Информационные характеристики каналов связи. Скорость передачи и пропускная способность канала

- •Цели и виды преобразования информации. Кодирование, модуляция

- •Равномерное кодирование. Префиксные коды

- •Метод Шеннона-Фано для сжатия при известной статистике сообщения

- •Метод Хафмена для сжатия при известной статистике сообщения

- •Арифметическое кодирование при известной статистике сообщения

- •Метод Хафмена для сжатия при неизвестной статистике сообщения

- •Словарные методы сжатия сообщения. Метод lz77

- •Словарные методы сжатия сообщения. Метод lzss

- •Особенности работы программ-архиваторов. Сжатие информации с потерями (!!!в работе)

- •Информационный канал его составляющие и характеристики

- •Способы кодирования двоичной информации

- •Помехозащитное кодирование. Коды с обнаружением ошибок. Коды с исправлением ошибок

- •Блочные коды. Избыточность кода. Расстояние Хэмминга. Вес слова (!!!в работе)

- •Матричное помехозащитное кодирование.

- •Групповые помехозащитные коды.

- •Полиномиальные помехозащитные коды.

- •Циклические избыточные коды

- •Шифрование данных. Примеры простых методов шифрования. Шифр-перестановка и шифр-смещение

- •Виды каналов связи. Их характеристики. Фильтр нижних частот

- •Способы передачи и обработки сигналов в системах пдс

- •Амплитудная модуляция и ее характеристики. Схема амплитудного модулятора

- •Частотная модуляция и ее характеристики. Схема частотного модулятора

- •Фазовая модуляция и ее характеристики. Схема фазового модулятора

- •Информационные процессы в природе, обществе, технике. Информационная деятельность человека

- •Информационные технологии и их составляющие

- •Понятие системы и ее свойства

- •Понятие архитектуры информационной системы

- •Разработка архитектуры приложений

- •Система менеджмента качества (смк)

- •Стандарты iso серии 9000

- •Модель уровней зрелости cmm

- •Основные понятия открытых систем.

- •История развития технологии открытых систем.

- •Эталонная модель взаимодействия открытых систем.

- •Технология передачи информации в модели взаимодействия открытых систем.

- •Физический уровень взаимодействия открытых систем.

- •Канальный уровень взаимодействия открытых систем.

- •Сетевой уровень взаимодействия открытых систем.

- •Транспортный уровень взаимодействия открытых систем.

- •Сеансовый уровень взаимодействия открытых систем.

- •Представительный уровень взаимодействия открытых систем.

- •Прикладной уровень взаимодействия открытых систем.

- •Технология поиска информации в Интернет. Поисковые инструменты.

- •Технология поиска информации в Интернет. Поисковые машины.

- •Технология поиска информации в Интернет. Каталоги, подборки ссылок.

- •Технология поиска информации в Интернет. Базы данных адресов.

- •Технология поиска информации в Интернет. Поиск в архивах Gopher и система поиска ftp файлов.

- •Технология поиска информации в Интернет. Система поиска в конференциях, системы мета-поиска, системы поиска людей.

- •Свойства и процесс восприятия.

- •Этапы восприятия

-

Количественная мера информации. Свойства количества информации

Если производится измерение с некоторой погрешностью, то чем больше произведено измерений, тем больше информации об измеряемом объекте.

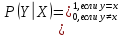

Пусть передатчик передаёт сообщение, ассоциируемое с СВX. В канале связи накладывается аддитивный шум Z. Т.е. на принимающей стороне получаютY=X+Z. В этой схеме можно говорить о количестве информации, содержащейся в СВY по сравнению с СВ X. Чем ниже уровень помех (дисперсия Z мала), тем больше информации можно получить из Y.

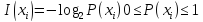

Мера измерения

количества инф-и, которую несёт в себе

элемент

:

:

Пусть CВX

и Y

заданы законами распределения P(X=xi)=pi,

P(Y=yj)=qj,

где

;

j=

;

j= ,

и совместным распределениемP(x=xi,

y=yj)=pij.

,

и совместным распределениемP(x=xi,

y=yj)=pij.

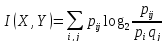

Оценка количества информации, содерж. В X относительно Y, определяется как:

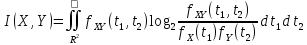

Для непрерывных

СВXиY,заданных

плотностями распределения

вероятностей ,

, и

и ,

аналогичная

формула имеет вид:

,

аналогичная

формула имеет вид:

Свойства меры информации:

1) I(X, Y) 0,I(X, Y) = 0 если X и Y независимы;

2) I(X,Y)= I(Y,X);

3) I(X,

Y) = HX + HY - H(X, Y),

гдеH(X,

Y) = -

4) I(X, Y) I(X, X). Если I(X, Y) = I(X, X), то X — функция от Y.

-

Энтропия. Свойства энтропии

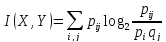

ПустьCВ

X

и Y

заданы законами распределения P(X=xi)=pi,

P(Y=yj)=qj,где

;

j=

;

j= ,

и совместным распределениемP(x=xi,

y=yj)=pij.Оценка

количества информации, содерж. В X

относительно Y,

определяется как:

,

и совместным распределениемP(x=xi,

y=yj)=pij.Оценка

количества информации, содерж. В X

относительно Y,

определяется как:

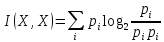

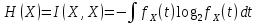

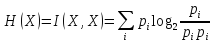

Отсюда можно получить оценку I(X,X) –инф-ю сообщения о себе самом:

![]()

=

=

Данная величина наз. энтропией и обозначается H(X).

Энтропия ДСВ – это минимум количества бит, которые необходимо передать по каналам связи о текущем значении данной ДСВ.

Свойства энтропии:

1) H(X) = 0 ->X — константа;

2) I(X,

Y) = HX + HY - H(X, Y),

гдеH(X,

Y) = -

3) I(X, Y) I(X, X). Если I(X, Y) = I(X, X), то X — функция от Y.

-

Энтропия объектов с дискретным и непрерывным множеством состояний. Среднее количество информации

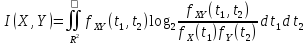

а) Для непрерывных

случайных величин, заданных плотностями

распределения вероятностей

,

, и

и

:

:

б) Для ДСВ, заданных законами распределения P(X=xi)=pi, P(Y=yj)=qjи совместным распределениемP(x=xi, y=yj)=pij:

![]()

Тогда энтропия:

=

=

Энтропия также определяется как среднее количество информации, приходящееся на одно сообщение источника, вырабатывающего независимые сообщения.Чем больше энтропия, тем большую информацию в среднем несет одно сообщение источника.

-

Понятие канала связи. Информационные характеристики каналов связи. Скорость передачи и пропускная способность канала

Канал связи – это среда и средства передачи информации.

При передаче информации в канале связи могут возникнуть помехи – шумы (гармонические, импульсные, флуктуационные, мультипликативные).

Информационный канал — это совокупность устройств, объединенных линиями связи, предназначенных для передачи инф-ии от источника инф-ии (начальногоустр-ва канала) до ее приемника (конечного устр-ва канала).

Линии связи обеспечивают прохождение инф. сигналов между устр-вами канала. Информация обычно передается при помощи эл. тока (по проводам), света (по оптоволокну), э/м волн радиодиапазона (в пространстве), звука (в плотной среде: атмосфере, воде и т.п.) и прочих.

Устройства канала — это, как правило, репитеры, передающие усиленным принятый сигнал.

Технические характеристики канала определяются принципом действия входящих в него устр-в, видом сигнала, св-вами и составом физической среды, в которой распространяются сигналы, св-вами применяемого кода.

Эффективность канала хар-тся скоростью и достоверностью передачи информации, надежностью работы устр-в и задержкой сигнала во времени.Задержка сигнала во времени — это интервал времени от отправки сигнала передатчиком до его приема приемником. Достоверность и надёжность напрямую связана с наличием шумов.

В соответствии со структурой вх. и вых. сигналов выделяют каналы:

-

дискретные (сигналы на входе и выходе представляют собой последовательность символов некоторых алфавитов);

-

непрерывные (входные и выходные сигналы представляют собой функции от непрерывного параметра (времени)).

Математической

моделью шумов является совокупность

условных вероятностей: ->канал без шумов

->канал без шумов

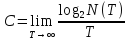

Способность канала

передавать информацию характеризуется

ёмкостью

или пропускной

способностью канала:

N (T) — число всех возможных сигналов

Для вычисления

максимальной скорости передачи в канале

с шумом при известной ёмкости канала и

энтропии источника используют теорему

Шеннона:

.

.