- •Информационные технологии

- •Литература

- •Понятие технологии и его содержание

- •Критерии современной технологии

- •Понятие информационной технологии

- •Уровни ит

- •Компоненты ит

- •Этапы развития (глобальной) информационной технологии

- •Знания - наука - общественное производство – знания

- •Первый информационный барьер

- •Никита Николаевич Моисеев

- •Компьютерная эпоха развития ит

- •Этапы развития нит

- •Понятие информации

- •Виды информации

- •Свойства, характеристики информации

- •Измерение информации

- •Статистическое количество информации

- •Семантическое количество информации

- •Прагматическая мера информации

- •Качество информации

- •Классификация систем управления.

- •Классификация систем управления по их обеспеченности ресурсами

Измерение информации

Существуют разные подходы к определению количества информации

Для измерения информации используются два параметра: количество информации и объем данных. Эти параметры имеют разные выражения и интерпретацию в зависимости от подхода.

Объем данных в сообщении измеряется количеством символов (разрядов) в этом сообщении. В различных системах счисления один разряд имеет различный вес и соответственно меняется единица измерения данных

Разные подходы к количеству информации

Структурный – рассматривается технический аспект, связанный с хранением и передачей информации, используя различные виды материальных носителей.

Статистический – количество информации определяется как мера неопределенности, снимаемой при поступлении информации.

Семантический – оценивается смысловое содержание информации и ее ценность..

Структурное количество информации

Проблемами хранения информации, передачи ее по каналам связи и задачами определения количества информации занимались X. Найквист (1924 г.) и Р.Хартли (1928 г.).

В 1928 г. Р.Хартли связал количество информации с числом состояний физической системы. Поскольку он работал инженером в телеграфной компании, он рассуждал о количестве информации, содержащемся в телеграфном тексте. Р.Хартли заложил основы теории информации, определив логарифмическую меру количества информации.

Формула Хартли определяет количество информации, содержащееся в сообщении длины n.

Имеется алфавит А, из букв которого составляется сообщение :)

| A | = m

Количество сообщений, которое можно принять

N = m n

Количество информации:

I = log N = n log m

Единицы измерения информации

Различие

двоичными кратными единицами, обозначаемыми согласно ГОСТ8.417-2002 как «Кбайт», «Мбайт», «Гбайт» и т. д. (два в степенях кратных десяти);

единицами килобайт, мегабайт, гигабайт и т. д., понимаемыми как научные термины(десять в степенях кратных трём).

Последние по определению

равны соответственно

![]() байт.

байт.

В качестве терминов для «Кбайт», «Мбайт», «Гбайт» и т. д. МЭКпредлагает «кибибайт», «мебибайт», «гибибайт»

Ральф Винтон Лайон Хартли (англ. Ralph Vinton Lyon Hartley, родился 30 ноября 1888 в Ели, штате Невада, умер 1 мая 1970.)

Американский учёный-электронщик. Он предложил генератор Хартли, преобразование Хартли и сделал вклад в становление теории информации.

Статистическое количество информации

Шенноном была предложена

формула для вычисления среднего

количества информации, содержащейся в

некоторой совокупности сообщений

![]() ,

если известны вероятности появления

этих сообщений

,

если известны вероятности появления

этих сообщений![]() :

:

![]() .

.

Определяемую этой

формулой величину можно рассматривать

как математическое ожидание количества

информации, получаемого при передаче

сообщений из данного множества. Величину

![]() называют собственной информацией

сообщения

называют собственной информацией

сообщения![]() .

.

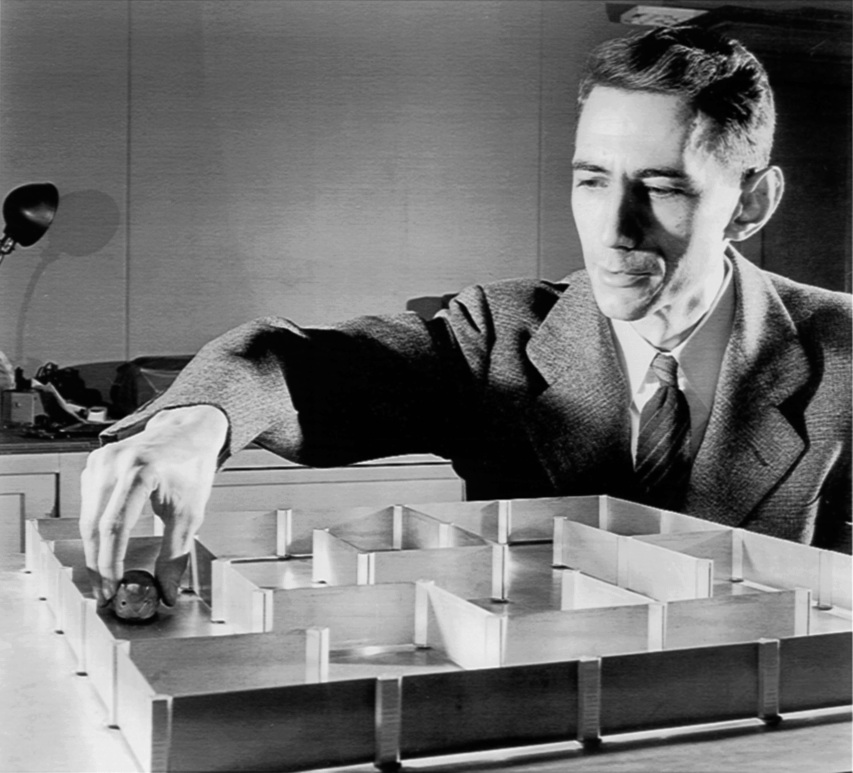

Клод Элвуд Шеннон (англ. Claude Elwood Shannon; 30 апреля 1916 — 24 февраля 2001) —основатель математической теории информации; предопределил развитие общей теории дискретных автоматов — важного направления кибернетикию