Лекция 5 Модели искусственных нейронных сетей

План

1. Однослойный персептрон.

2. Многослойный персептрон.

3. Сеть Хопфилда.

4. Сеть Хемминга.

5. Двунаправленная ассоциативная память.

6. Сети встречного распространения.

Нейроны располагают связями двух типов: 1) внутренними – с нейронами той же сети; 2) внешними – с нейронами других сетей или внешним миром.

1. Однослойный персептрон

П ервой

моделью искусственных НС стала однослойная

НС, предложенная в 1962 г. Ф.Розенблаттом,

получившая название персептрон. Структура

персептрона показана на рис. 5.1.

ервой

моделью искусственных НС стала однослойная

НС, предложенная в 1962 г. Ф.Розенблаттом,

получившая название персептрон. Структура

персептрона показана на рис. 5.1.

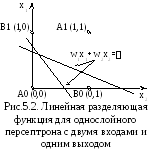

Персептроном называется нейронная сеть, состоящая из одного слоя формальных нейронов Мак-Каллока, соединенных с помощью весовых коэффициентов с множеством входов.

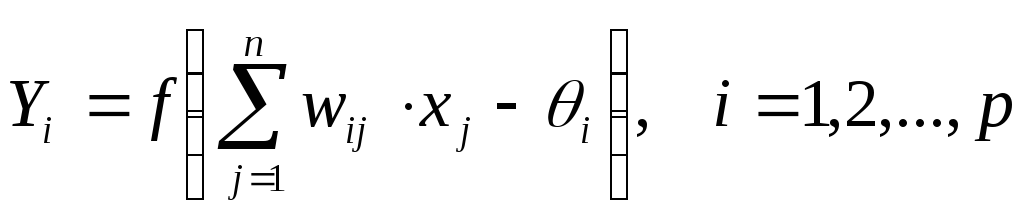

Выходные сигналы персептрона формируются согласно выражению

,

(5.1)

,

(5.1)

где активационная функция f является ступенчатой функцией (функция единичного скачка).

Для обучения рассматриваемой сети используется дельта-правило.

2. Многослойный персептрон

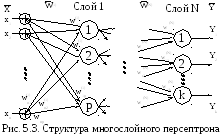

Самой

известной и, возможно, наиболее

распространенной моделью НС является

многослойный персептрон (МПн). Элементы

МПн разделены на несколько слоев (число

их произвольно), внутри слоя элементы

можно считать линейно упорядоченными

и не взаимодействующими между собой.

Каждый элемент сети (кроме элементов

первого слоя) получает входной сигнал

от каждого элемента предыдущего слоя,

и выходной сигнал элемента (кроме

элементов последнего слоя) поступает

на вход элементов последующего слоя

(рис. 5.3). Количество нейронов в слоях

может быть произвольным. Обычно во всех

скрытых слоях одинаковое количество

нейронов. В таких сетях нет обратных

связей, поэтому они относятся к классу

сетей прямого распространения.

Самой

известной и, возможно, наиболее

распространенной моделью НС является

многослойный персептрон (МПн). Элементы

МПн разделены на несколько слоев (число

их произвольно), внутри слоя элементы

можно считать линейно упорядоченными

и не взаимодействующими между собой.

Каждый элемент сети (кроме элементов

первого слоя) получает входной сигнал

от каждого элемента предыдущего слоя,

и выходной сигнал элемента (кроме

элементов последнего слоя) поступает

на вход элементов последующего слоя

(рис. 5.3). Количество нейронов в слоях

может быть произвольным. Обычно во всех

скрытых слоях одинаковое количество

нейронов. В таких сетях нет обратных

связей, поэтому они относятся к классу

сетей прямого распространения.

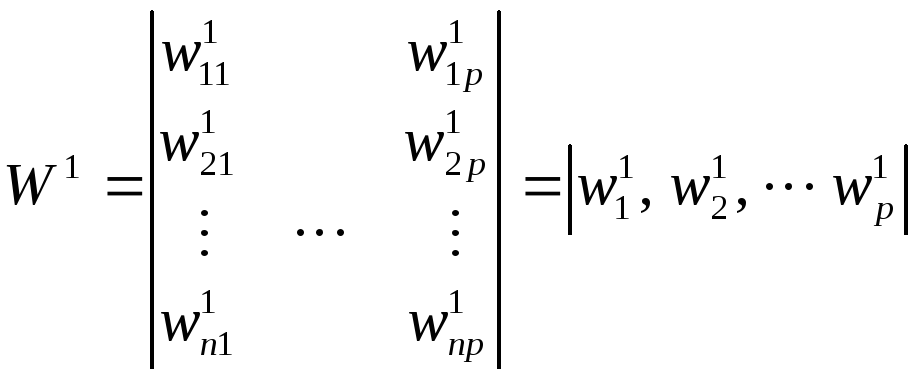

Матрица Wkорганизована следующим образом: столбцы – это вектораwik(веса каждого нейронаk-го слоя)

.

.

Активность нейрона чаще всего задается нелинейной функцией от синаптического возбуждения.

Наиболее распространенная процедура обучения для многослойного персептрона – обучение на основе обратного распространения ошибки (back propagation error) – ВР-алгоритм.

Сложноть задач, решаемых МСП, существенно зависит от количества слоев и нейронов в слоях. С увеличением количества слоев вследствие нелинейности пороговых функций потенциальные классификационные свойства персептрона возрастают.

На

рис. 5.4 представлены выпуклые области.

На

рис. 5.4 представлены выпуклые области.

Пусть имеется двухслойная сеть, состоящая из трех нейронов (рис. 5.5). Чтобы порог был превышен и на выходе появилась единица, требуется, чтобы оба нейрона первого уровня на выходе имели единицу. Таким образом, выходной нейрон реализует логическую функцию И. В такой сети каждый нейрон первого слоя разбивает плоскость входных значений х1-х2 на две полуплоскости, один обеспечивает единичный выход для входов ниже верхней линии, другой – для входов выше нижней линии. На рис. 5.5 показан результат такого разбиения, где выходной сигнал нейрона второго слоя равен единице только внутри V-образной области. Следует отметить, что не все выходные области первого слоя должны пересекаться.

Если в первом слое использовать три нейрона, то можно задать область треугольной формы. Т.о., с увеличением числа нейронов во входном слое возрастает число граней выпуклого многоугольника. Точки, не составляющие выпуклой области, не могут быть отделены от других точек плоскости двухслойной сетью.